или у вас там сетка 25гб+?

У меня Thunderbolt 30gb 👌

Vladislav

Vladislav

привет, планирую купить такой же. как они на чтение/запись? заявленные 3200/1000 держат?

Под ZFS? Или в сферическом вакууме?

жюн

жюн

А мне жирные видеофайлы кидать - должно хватать

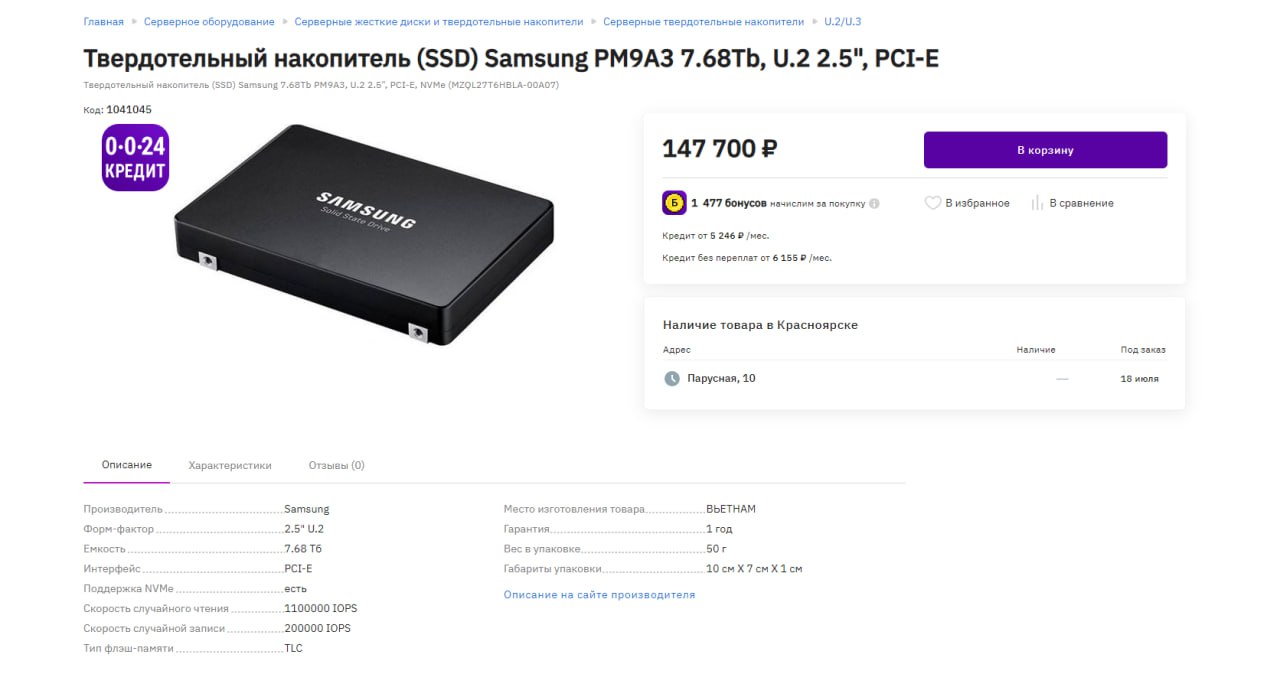

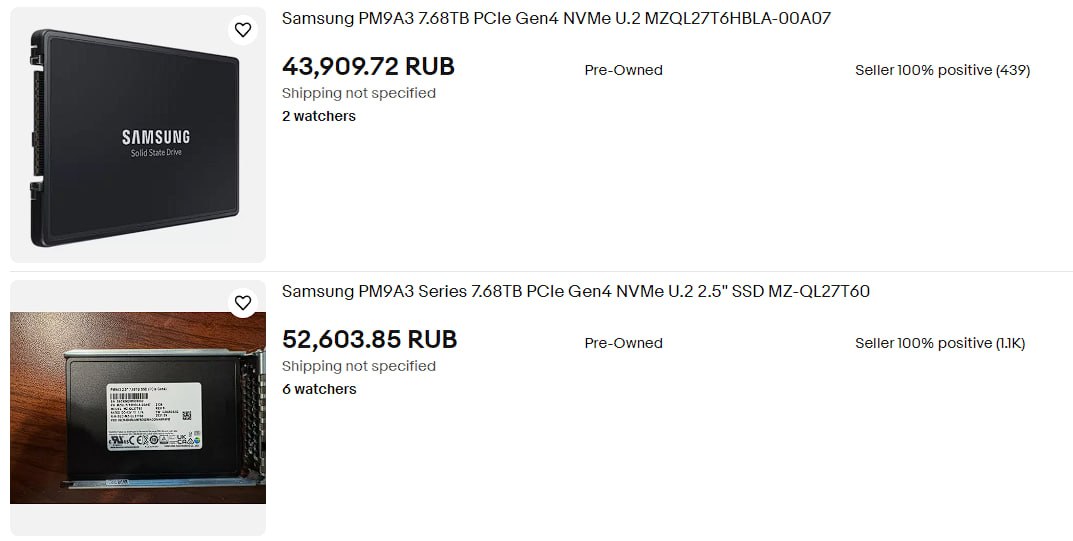

посмотрел самсунг, там чет ценник х3 почти за тот же обхём)

Evgeniy

Evgeniy

тогда зачем оно надо?

такой диск проживёт ещё очень долго, и не будет содержать в себе проблем хдд.

а сетка даже на 10Гб относительно доступна уже сейчас, через 5 лет она уже будет стоять во всех материнках, как сейчас 2.5

жюн

жюн

такой диск проживёт ещё очень долго, и не будет содержать в себе проблем хдд.

а сетка даже на 10Гб относительно доступна уже сейчас, через 5 лет она уже будет стоять во всех материнках, как сейчас 2.5

если больше пары дисков - 10г не дадут разницы в скорости

жюн

жюн

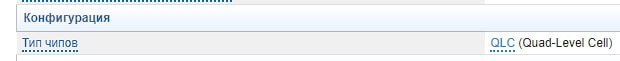

у интела, кстати, ресурс мемный, первый раз вижу такое:

12300 TBW - при последовательной записи, 2800 TBW - при случайной записи

Georg🎞️🎥

Georg🎞️🎥

интелы на 200к иопсов записи тоже дорогие будут

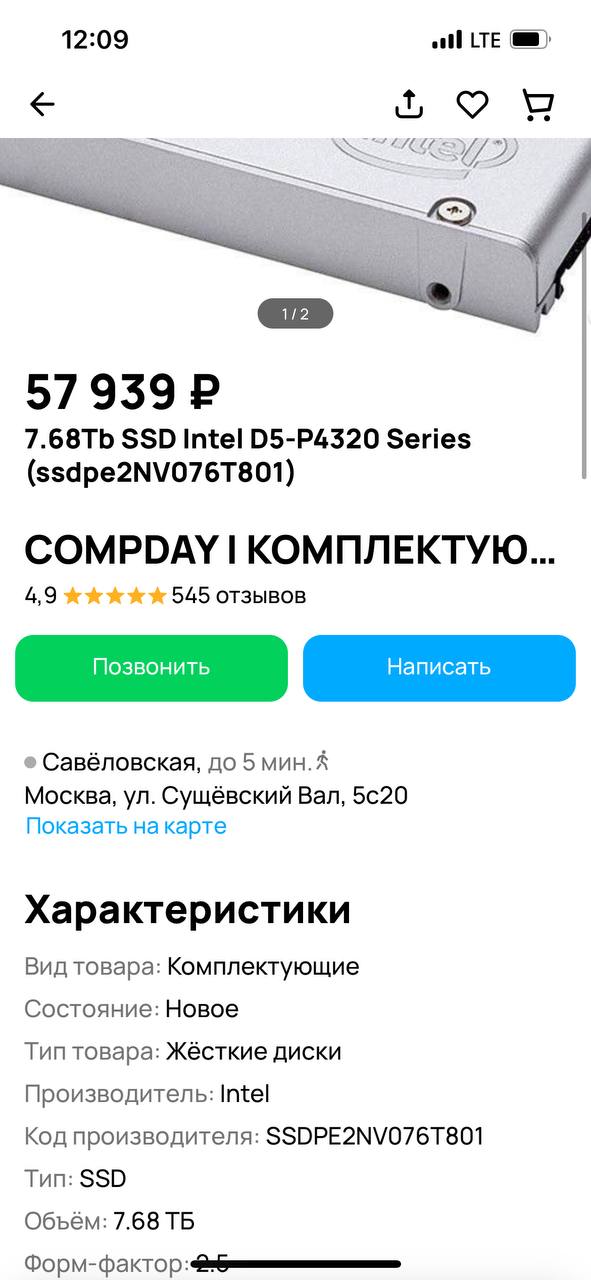

Меня интересует объем и скорость линейные … не для zfs. Брал

Georg🎞️🎥

Georg🎞️🎥

не для зфс, но по итогу зфс?)

Нет, таскать на выездные сессии .. где надо несколько тер быстро записать …

1 штука на пробу пока

жюн

жюн

Для zfs оптаны на arc2 есть 🤔

поюзал я arc2, профит сомнительный

% попаданий маленький был слишком, пожалел ssd, поставил его на запись)

Georg🎞️🎥

Georg🎞️🎥

поюзал я arc2, профит сомнительный

% попаданий маленький был слишком, пожалел ssd, поставил его на запись)

У меня пока тоже не особо 🤔видать настроил криво … вроде терабайты инфы гонял на тесте - а в arc2 почти ничего :((((

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

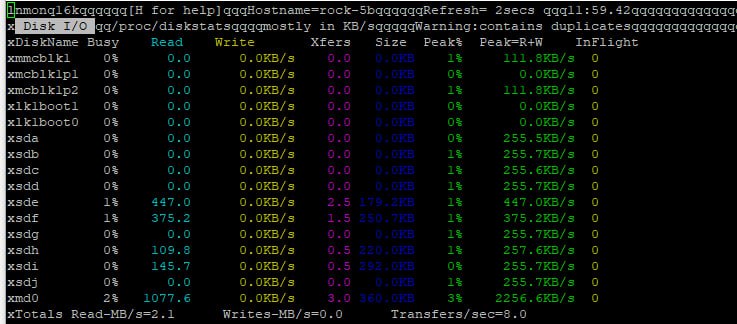

zpool iostat -vyln 1 5 , пробовал просто раз в секунду, бывает 3-5к операций на запись.

zfs-2.1.11-pve1

zfs-kmod-2.1.11-pve1

debian 11 от проксмокса 7

Тогда надо проверять, что со стороны ОС туда идёт и что прокс показывает по чтению/записи также в iotop и nmon

У тебя на special vdev ещё кладутся special_small_blocks

https://forum.proxmox.com/threads/zfs-metadata-special-device.129031/

https://openzfs.github.io/openzfs-docs/man/master/7/zpoolconcepts.7.html

Nikolay

Nikolay

Тогда надо проверять, что со стороны ОС туда идёт и что прокс показывает по чтению/записи также в iotop и nmon

У тебя на special vdev ещё кладутся special_small_blocks

https://forum.proxmox.com/threads/zfs-metadata-special-device.129031/

https://openzfs.github.io/openzfs-docs/man/master/7/zpoolconcepts.7.html

Nikolay

Nikolay

Dexex

Dexex

Ну чтож... Два года использования zfs и syncoid скрипта. Полет нормальный.

Оптимальное решение мое а том, что на proxmox создан отдельный пул под бекап из медленных hdd и реплицировано в датасет.

Получается две копии.

Из практики выяснилось, что синхронизация пулов не должна быть прям 3s или сколько там, потому что в момент бекапа система нагружена - у меня стоит 6ч и в строго нужное время запускается, когда окно копирования на локальный пул завершено

George

George

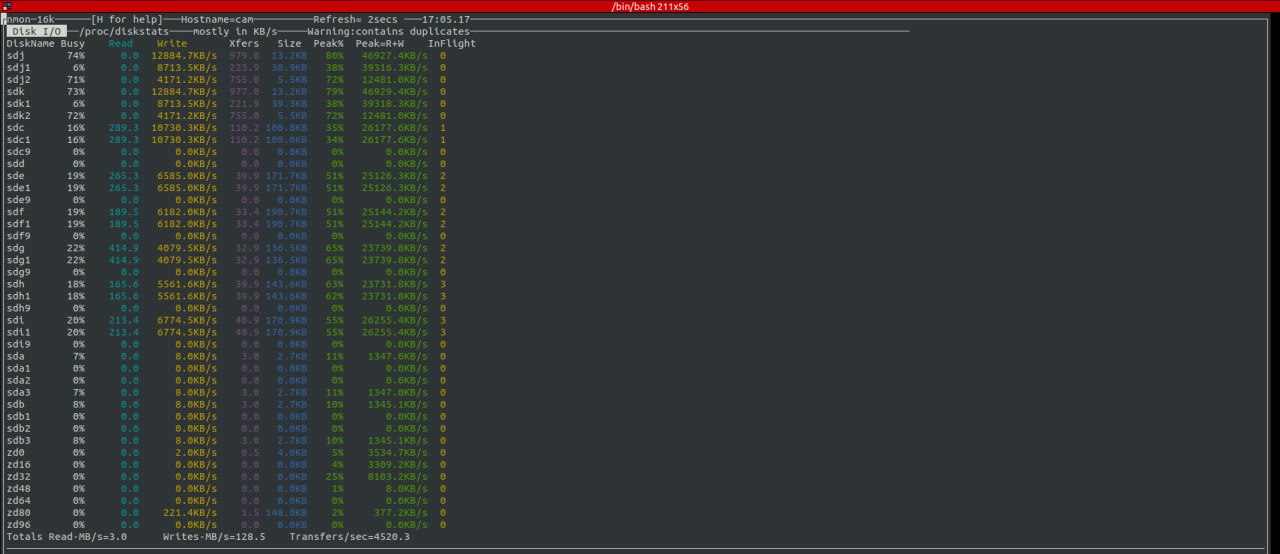

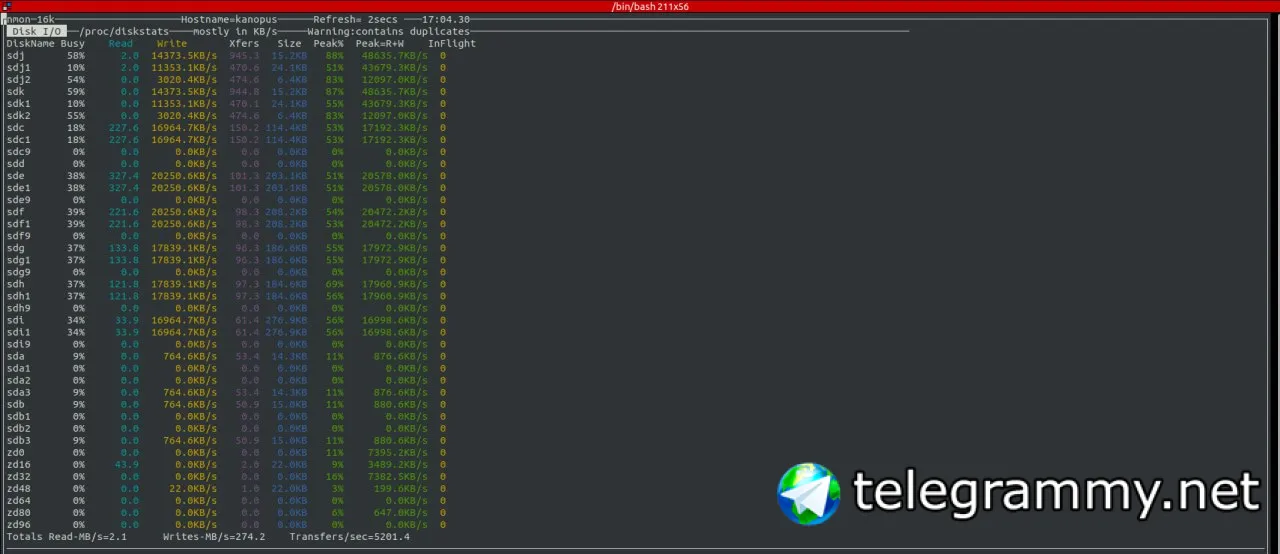

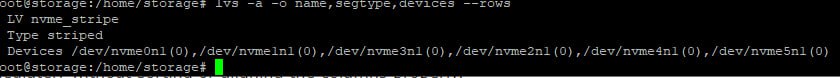

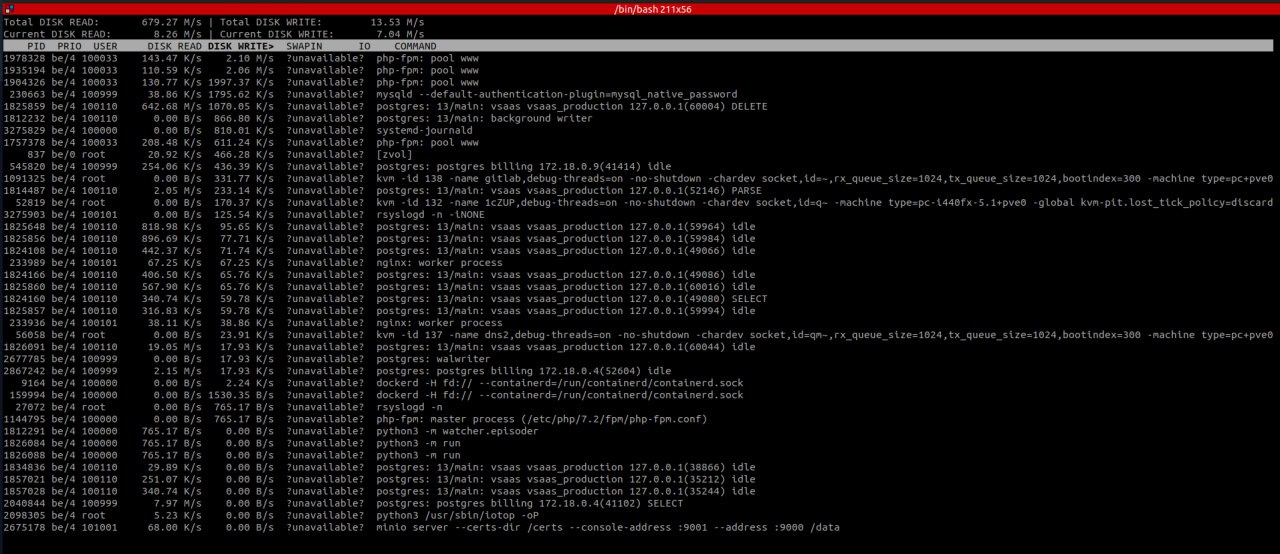

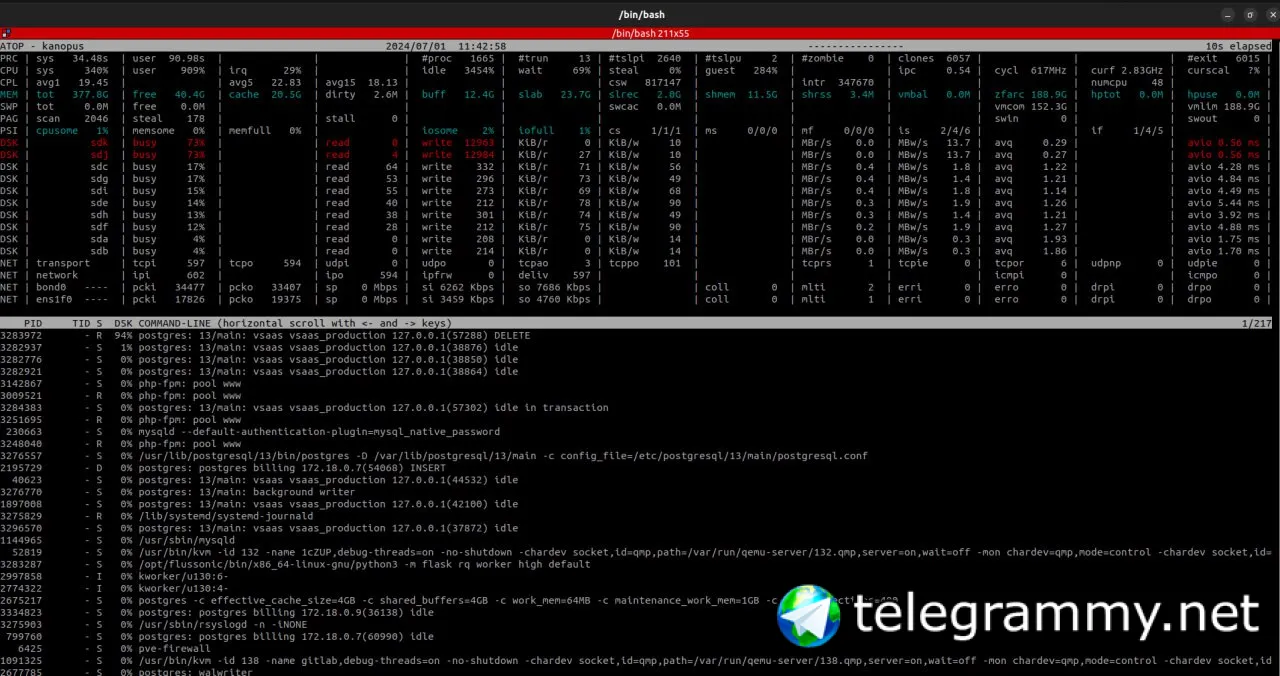

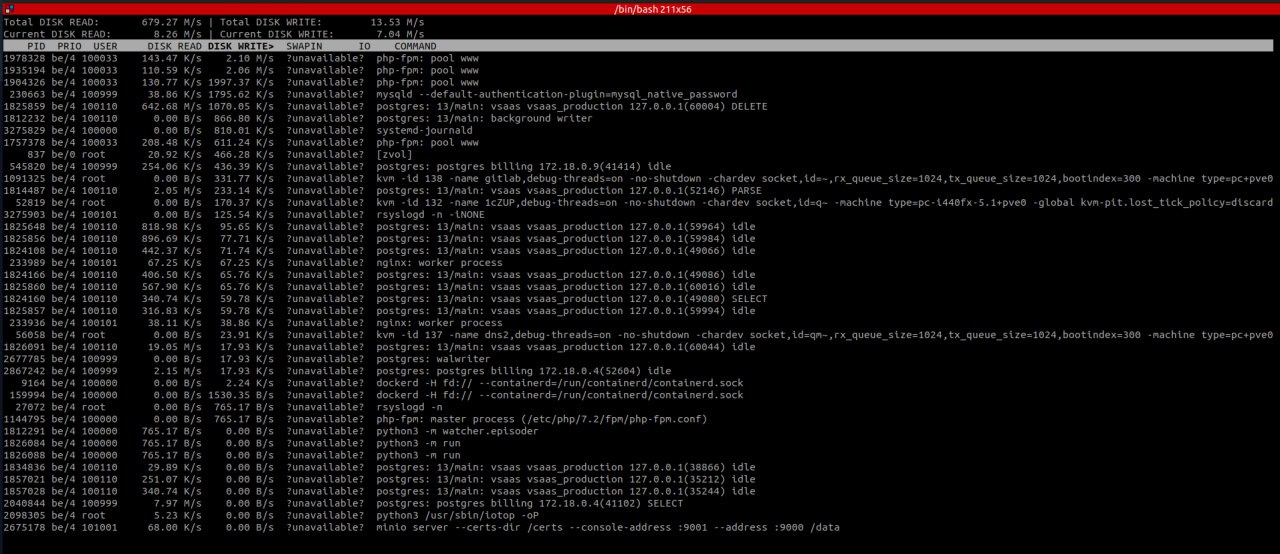

@gmelikov Может чего подскажешь, куда копнуть. На запись нагрузки большой нету, но при этом на special vdev прилетает бешенное кол-во операций записи. На сам пул нагрузки такой нету большой, по 5-10 Мб пишет. В замешательстве. zfs на proxmox zfs-2.1.11-pve1 , zfs-kmod-2.1.11-pve1

Что с atime? Какие параметры вдевов/датасетов менялись? стоит показать zpool get all на vdev и zfs get all на датасет постгри

Nikolay

Nikolay

Что с atime? Какие параметры вдевов/датасетов менялись? стоит показать zpool get all на vdev и zfs get all на датасет постгри

пул: mega atime off local

Ничего не менял, работало, а потом случайно заметил. Мониторинга загрузки дисков не было, как давно сказать не могу. Но по началу точно не было.

пул: https://pastebin.com/raw/WDe84Hn7

датасет с постгрес: https://pastebin.com/raw/PHiJZqc0

George

George

пул: mega atime off local

Ничего не менял, работало, а потом случайно заметил. Мониторинга загрузки дисков не было, как давно сказать не могу. Но по началу точно не было.

пул: https://pastebin.com/raw/WDe84Hn7

датасет с постгрес: https://pastebin.com/raw/PHiJZqc0

ещё iostat -x 5 пиковый тоже покажи

и можно чекнуть ещё zpool iostat -r 5

Vladislav

Vladislav

Nikolay

Nikolay

ещё iostat -x 5 пиковый тоже покажи

и можно чекнуть ещё zpool iostat -r 5

iostat https://pastebin.com/raw/zxqWkXFz

zpool iostat https://pastebin.com/raw/p7agyWN1

Nikolay

Nikolay

Чекаешь хост через iotop и nmon (средний размер блока)

Чекаешь гостевую ОС через iotop и nmon

Смотришь показания

эти команды размер блока не показывают же.

Vladislav

Vladislav

эти команды размер блока не показывают же.

Ну тогда, дополнительно размер блока через

iostat -tkx 1 -d /dev/???

Можешь ещё blktrace посмотреть

https://strugglers.net/~andy/blog/2019/05/20/measuring-linux-io-readwrite-mix-and-size/

Sergey

Sergey

Nikolay

Nikolay

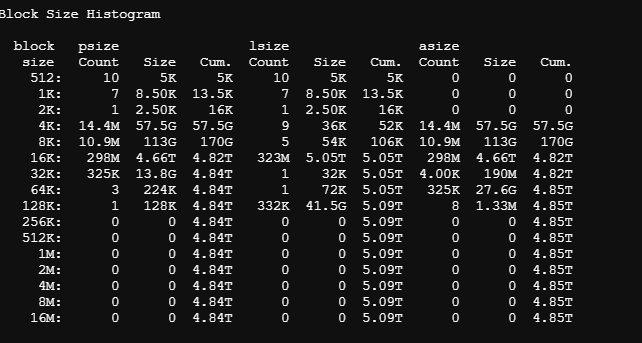

#Вопрос: А правильно ли понимаю: Вот вывод команды: zpool iostat -r 5 https://pastebin.com/raw/af28ZRGF

Что по факту у меня гостевые ОС пишут в большинстве своём 4К и 8К блоками ? При ashift=13 у меня программный размер блока 4К и диски тоже по 4К.

Получается вмместо одного блока 4К записи на диск, при record_size=128K , пишется 128/4=32 блока на диск. Нагрузка на пул больше, НО влияет ли это кол-во записей в special vdev ? По идее же нет, туда пишется инфа про ОДИН 128К сектор, а не 32 раза про 4К сектора ? Т.е. неподходящий размер блока не будет же увеличивать нагрузку на special vdev ? Спасибо

Vladislav

Vladislav

#Вопрос: А правильно ли понимаю: Вот вывод команды: zpool iostat -r 5 https://pastebin.com/raw/af28ZRGF

Что по факту у меня гостевые ОС пишут в большинстве своём 4К и 8К блоками ? При ashift=13 у меня программный размер блока 4К и диски тоже по 4К.

Получается вмместо одного блока 4К записи на диск, при record_size=128K , пишется 128/4=32 блока на диск. Нагрузка на пул больше, НО влияет ли это кол-во записей в special vdev ? По идее же нет, туда пишется инфа про ОДИН 128К сектор, а не 32 раза про 4К сектора ? Т.е. неподходящий размер блока не будет же увеличивать нагрузку на special vdev ? Спасибо

Лучше бы дал вывод сравнение между nmon & iotop из ОС и из гипервизора...

Nikolay

Nikolay

Лучше бы дал вывод сравнение между nmon & iotop из ОС и из гипервизора...

Допустим nmon, с какими опциями смотреть ? есть d и -D

Nikolay

Nikolay

Vladislav

Vladislav

Наверное я неправильно понял. "размер блока" я подумал про как при выводе zpool iostat -r , а тут получается речь про объём данных ?

Размер блока данных на запись, ну типо, какого размера система отправляет IO

Artem

Artem

Размер блока данных на запись, ну типо, какого размера система отправляет IO

Там же усредненное за интервал, не?

Nikolay

Nikolay

Размер блока данных на запись, ну типо, какого размера система отправляет IO

теперь понял, не о том подумал изначально

Maxim

Maxim

Алексей

Алексей