Станислав

Станислав

Как раз "фиксация" TXG и происходит

Evgeniy

Evgeniy

подскажите по бэкапам, пожалуйста.

есть два ZVOL'а на двух NVME дисках в stripe, плюс для HDD в зеркале. хочу ZVOL'ы бэкапить на HDD (раз в неделю, наверное), чтобы в случае выхода из строя одного NVME просто начать работать с (плюс-минус) той же самой информацией, но только с HDD.

возможны ли в ZFS и в частности какие-то "инкрементальные" бэкапы zvol'ов, чтобы не мучать HDD и не лить каждый раз 5ТБ? ZFS используется в TrueNAS SCALE, возможно там есть что-то такое

Fedor

Fedor

подскажите по бэкапам, пожалуйста.

есть два ZVOL'а на двух NVME дисках в stripe, плюс для HDD в зеркале. хочу ZVOL'ы бэкапить на HDD (раз в неделю, наверное), чтобы в случае выхода из строя одного NVME просто начать работать с (плюс-минус) той же самой информацией, но только с HDD.

возможны ли в ZFS и в частности какие-то "инкрементальные" бэкапы zvol'ов, чтобы не мучать HDD и не лить каждый раз 5ТБ? ZFS используется в TrueNAS SCALE, возможно там есть что-то такое

При использовании снимков (для удобства управления) и функционала send/receive возможно передавать инкрементальные данные.

Evgeniy

Evgeniy

Eugen

Eugen

подскажите по бэкапам, пожалуйста.

есть два ZVOL'а на двух NVME дисках в stripe, плюс для HDD в зеркале. хочу ZVOL'ы бэкапить на HDD (раз в неделю, наверное), чтобы в случае выхода из строя одного NVME просто начать работать с (плюс-минус) той же самой информацией, но только с HDD.

возможны ли в ZFS и в частности какие-то "инкрементальные" бэкапы zvol'ов, чтобы не мучать HDD и не лить каждый раз 5ТБ? ZFS используется в TrueNAS SCALE, возможно там есть что-то такое

очень сильно зависит от того, что за данные хранятся.

условно говоря, то, что подходит для репликации архива картинок, то может привести к кровавой драме, если мы снепшотами наивно "бекапим" реляционную СУБД, к примеру.

редко изменяемые данные, которые лежат в статическом виде - можно сендом гонять.

если же там, к примеру, какая-то виртуальная инфраструктура или датастор для серверов - так себе идея.

Evgeniy

Evgeniy

очень сильно зависит от того, что за данные хранятся.

условно говоря, то, что подходит для репликации архива картинок, то может привести к кровавой драме, если мы снепшотами наивно "бекапим" реляционную СУБД, к примеру.

редко изменяемые данные, которые лежат в статическом виде - можно сендом гонять.

если же там, к примеру, какая-то виртуальная инфраструктура или датастор для серверов - так себе идея.

Считай, что архив картинок, достаточно редко изменяемый

Nikolay

Nikolay

Vladislav

Vladislav

Nikolay

Nikolay

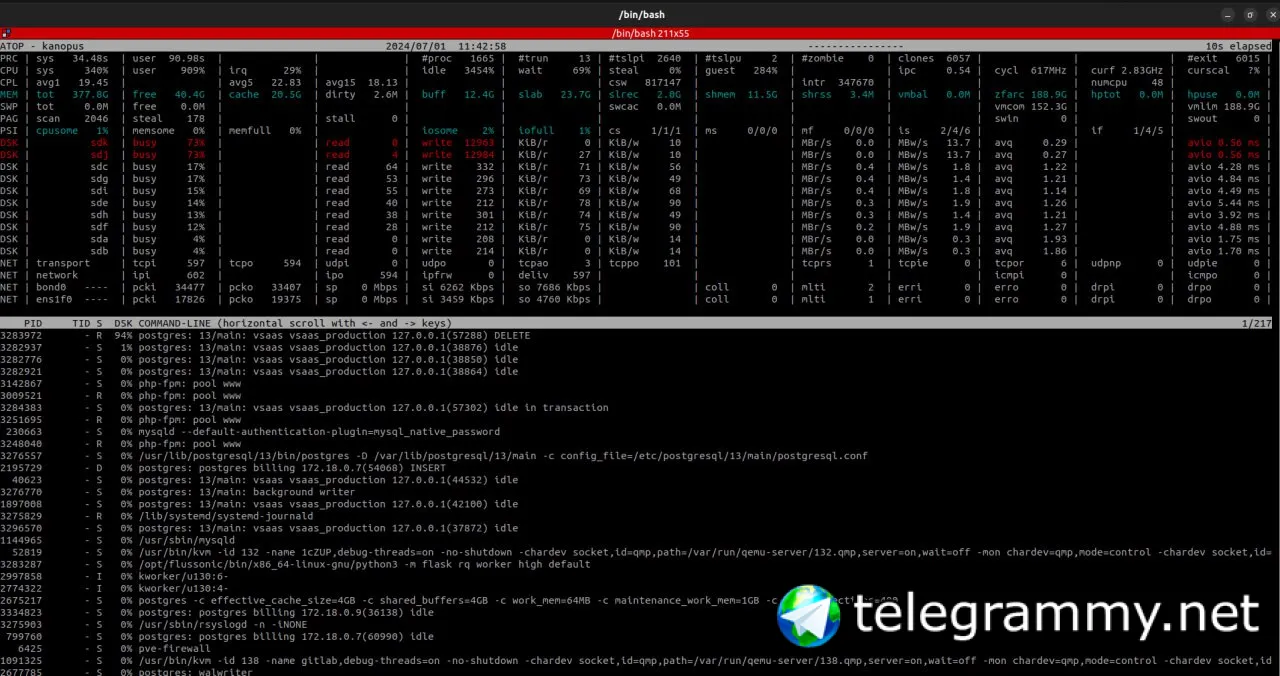

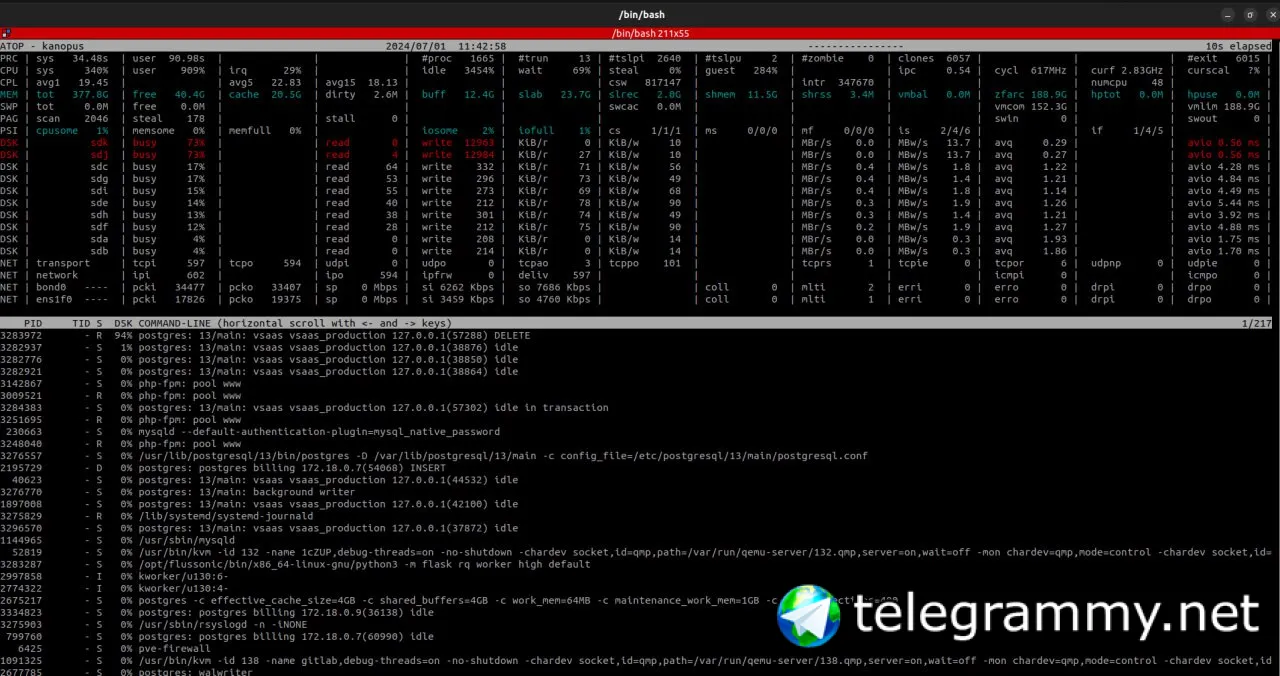

С какими параметрами iostat запускался? Какая версия ОС? Какая версия ZFS?

zpool iostat -vyln 1 5 , пробовал просто раз в секунду, бывает 3-5к операций на запись.

zfs-2.1.11-pve1

zfs-kmod-2.1.11-pve1

debian 11 от проксмокса 7

Sergey

Sergey

А собирать пул из кучи vdev(зеркал) разного размера это нежелательно? Или когда ваяешь из говна конфетку то покатит? Просто есть мысли чтобы не было 2 пула (из 4тб дисков и 1тб дисков). А этот один пул обвешать slog, special дисками чтоб взлетело прям. (не прод)

Nikolay

Nikolay

А собирать пул из кучи vdev(зеркал) разного размера это нежелательно? Или когда ваяешь из говна конфетку то покатит? Просто есть мысли чтобы не было 2 пула (из 4тб дисков и 1тб дисков). А этот один пул обвешать slog, special дисками чтоб взлетело прям. (не прод)

Вроде нельзя из дисков разного размера собрать пул. Команда ошибку выдаст.

Nikolay

Nikolay

Или будет ограничение по минимальному размеру. Потеряешь в объеме, в твоём случае 3 Тб с каждого диска.

Sergey

Sergey

Или будет ограничение по минимальному размеру. Потеряешь в объеме, в твоём случае 3 Тб с каждого диска.

Да не будет никаких ограничений

Станислав

Станислав

А собирать пул из кучи vdev(зеркал) разного размера это нежелательно? Или когда ваяешь из говна конфетку то покатит? Просто есть мысли чтобы не было 2 пула (из 4тб дисков и 1тб дисков). А этот один пул обвешать slog, special дисками чтоб взлетело прям. (не прод)

Не проще забыть про 1Тб диски? Тогда от них мало, только мороки добавляют

Sergey

Sergey

Не проще забыть про 1Тб диски? Тогда от них мало, только мороки добавляют

Еврейские привычки...) можно ещё два по 2тб докинуть

George

George

Вроде нельзя из дисков разного размера собрать пул. Команда ошибку выдаст.

Можно, вопрос только в неравномерности нагрузки на вдевы

smokerock

smokerock

Vladislav

Vladislav

Nikita

Nikita

первая мысль - smr, но, судя по заявлению вендора, таки, нет. https://blog.westerndigital.com/wp-content/uploads/2020/10/wd-red-family.png

smokerock

smokerock

Раз грешим на аппаратные проблемы - где аппаратное описание?

Сейчас полностью аппаратную проблему исключаю, так как заменили вообще все железо, вместе с HBA контроллером, шлейфами и тд.

Vladislav

Vladislav

smokerock

smokerock

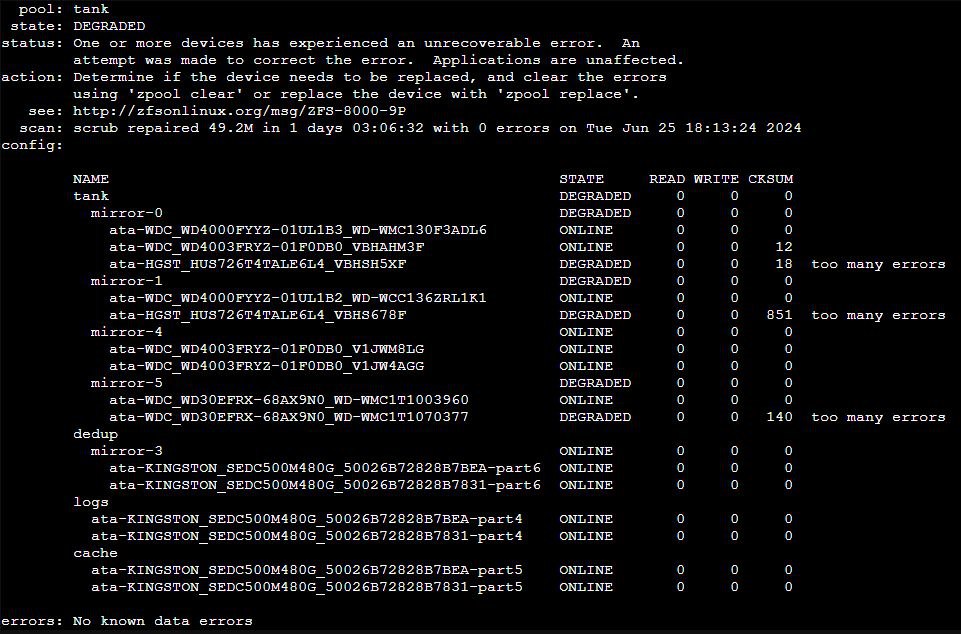

Есть одно, НО в первом зеркале смарт живого диска с ошибками, но хрень в том, поменять его не можем, потому что все подкидываемые к нему диски собственно выпадают в DEGRADED.

smokerock

smokerock

Второе НО, в первом зеркале, второй диск чудом не отвалился, которые имеет 12 ошибок CKSUM

smokerock

smokerock

Ну собственно, после перезагрузки счётчики сбрасываются, стартуешь скраб, на моменте repairing начинает сыпаться

victor

victor

А когда последний раз у вас работал скраб?

Так же на проблемном этом пуле, работает дедупликация.

Александр

Александр

Блок питания проверяли? Нагрузку вытягивает? Часто по питанию посадка бывает и винты выпадает в ожидание.

smokerock

smokerock

Блок питания проверяли? Нагрузку вытягивает? Часто по питанию посадка бывает и винты выпадает в ожидание.

Одно из первых что проверяли после памяти и шлейфов, подкидывали новый

Илья

Илья

Одно из первых что проверяли после памяти и шлейфов, подкидывали новый

А что по железу, есть описание сервера

Vladislav

Vladislav

smokerock

smokerock

ASUS P10S-X Series - 4 x Intel(R) Xeon(R) CPU E3-1220 v5 @ 3.00GHz (1 Socket)

32 GB RAM

Linux 5.4.124-1-pve #1 SMP PVE 5.4.124-1 (Wed, 23 Jun 2021 13:47:09 +0200)

Proxmox 6.4-13

ZFS: Loaded module v2.0.4-pve1, ZFS pool version 5000, ZFS filesystem version 5

cat /sys/module/zfs/version

2.0.4-pve1

Vladislav

Vladislav

ASUS P10S-X Series - 4 x Intel(R) Xeon(R) CPU E3-1220 v5 @ 3.00GHz (1 Socket)

32 GB RAM

Linux 5.4.124-1-pve #1 SMP PVE 5.4.124-1 (Wed, 23 Jun 2021 13:47:09 +0200)

Proxmox 6.4-13

ZFS: Loaded module v2.0.4-pve1, ZFS pool version 5000, ZFS filesystem version 5

cat /sys/module/zfs/version

2.0.4-pve1

Оффтопик, но Вам точно нужен ZFS в такой конфигурации?

Не отговариваю, но призываю задуматься о целесообразности

victor

victor

Оффтопик, но Вам точно нужен ZFS в такой конфигурации?

Не отговариваю, но призываю задуматься о целесообразности

Вполне хватает для наших задач

victor

victor

Более того, есть точно такой же прокс в этом же кластере, с такой же версией zfs. Проблем нет

victor

victor

Vladislav

Vladislav

Иначе бы понятия *неповторяемые ошибки* не существовало бы и абсолютно все ошибки могли бы быть воспроизведены

victor

victor

Ну, однозначно проблема есть, это да. Обновление у меня запланировано как один из вариантов, конечно.

Evgeniy

Evgeniy

При использовании снимков (для удобства управления) и функционала send/receive возможно передавать инкрементальные данные.

спасибо большое, основной бэкап льётся.

плюс инкремент тоже вроде сработал на тестовом датасете

root@truenas[/home/admin]# zfs send -v -I POOL_NVME_COMMON/backup_test@backup_test_snap3 POOL_NVME_COMMON/backup_test@backup_test_snap4 | zfs receive -vF WD_8TB/backup_test1

send from @backup_test_snap3 to POOL_NVME_COMMON/backup_test@backup_test_snap4 estimated size is 3.61G

total estimated size is 3.61G

TIME SENT SNAPSHOT POOL_NVME_COMMON/backup_test@backup_test_snap4

receiving incremental stream of POOL_NVME_COMMON/backup_test@backup_test_snap4 into WD_8TB/backup_test1@backup_test_snap4

22:20:05 1.35G POOL_NVME_COMMON/backup_test@backup_test_snap4

22:20:06 2.86G POOL_NVME_COMMON/backup_test@backup_test_snap4

received 3.62G stream in 27.86 seconds (133M/sec)

Evgeniy

Evgeniy

Но это полноценным бекапом считаться не может. Максимум - репликой

а почему не может?

цеплял перелитый на другие диски тестовый датасет к виндовой тачке по iscsi - всё работает

жюн

жюн

вопрос по механике - если зеркало бахнуть на ssd и хард, запись будет ограничена скоростью харда?

Fedor

Fedor

бекап - копия данных, изолированная от источника в достаточной степени согласно модели угроз. хранить на том же сервере - ну такой себе бекап.

Evgeniy

Evgeniy

бекап - копия данных, изолированная от источника в достаточной степени согласно модели угроз. хранить на том же сервере - ну такой себе бекап.

ну сорян, у меня не энтерпрайз уровень :)

у меня была цель сохранить данные при выходе из строя одного из дисков в страйпе, этого в целом достаточно

Evgeniy

Evgeniy

Ivan

Ivan

Georg🎞️🎥

Georg🎞️🎥

привет, планирую купить такой же. как они на чтение/запись? заявленные 3200/1000 держат?

Плюс минус похоже )) но к меня он в боксе с Thunderbolt подключением

Алексей

Алексей