George

George

недавно сделали ещё rebuild, он как раз в draid юзается, вот он сильно быстрее но со своими нюансами, например он не проверяет чексуммы в процессе https://openzfs.github.io/openzfs-docs/Basic%20Concepts/dRAID%20Howto.html#rebuilding-to-a-distributed-spare

Vladislav

Vladislav

там отдельно улучшали и обычный ресильвер

Да, это я нашёл (правда не понял в чем улучшение)

Но восстановление же поблочное при условии наличия этого блока в текущей существующей TXG группе?

Alex

Alex

Так,

Первое, никогда не будет перестроения рейда с максимальной скоростью диска.

Второе, у Вас массив будет отдыхать на весь период ребилда?

Третье, если есть zvol, то как бэ он немного большим будет, поэтому всегда стоит считать относительно 80% размера пула.

Поэтому наихудший сценарий это 30-50 МБ/с

Почему 80% пула, когда восстановление идет 1 диска? второе, все сильно зависит от конкретного окружения, например, ресилвер может восстанавливать 1 диск из 10, тогда чтение будет условно с 10 и тогда запись будет на уровне максимальной для диска. Поэтому все таике прогнозы мало обоснованы

Vladislav

Vladislav

Почему 80% пула, когда восстановление идет 1 диска? второе, все сильно зависит от конкретного окружения, например, ресилвер может восстанавливать 1 диск из 10, тогда чтение будет условно с 10 и тогда запись будет на уровне максимальной для диска. Поэтому все таике прогнозы мало обоснованы

Ты бы прочитал все слова в пункте 3.... А не цеплялся бы за 80%

Alex

Alex

Ты бы прочитал все слова в пункте 3.... А не цеплялся бы за 80%

ды к ты бы почитал мой ответ и подумал

Vladislav

Vladislav

Я тоже сомневаюсь в этом, иначе можно было бы откатиться на любое количество транзакций при необходимости

А все, понял о чём речь

Zfs ребилдит не по физическим блокам, а по существующим логическим транзакциям, начиная с самой старой, иными словами, ребилд превращается в случайное чтение на крупном массиве

И вроде бы даже писали об этом выше кому-то

Vladislav

Vladislav

И что убыстрить ребилд можно только флагом - блочное восстановление

А нет, это про replace было

Vladislav

Vladislav

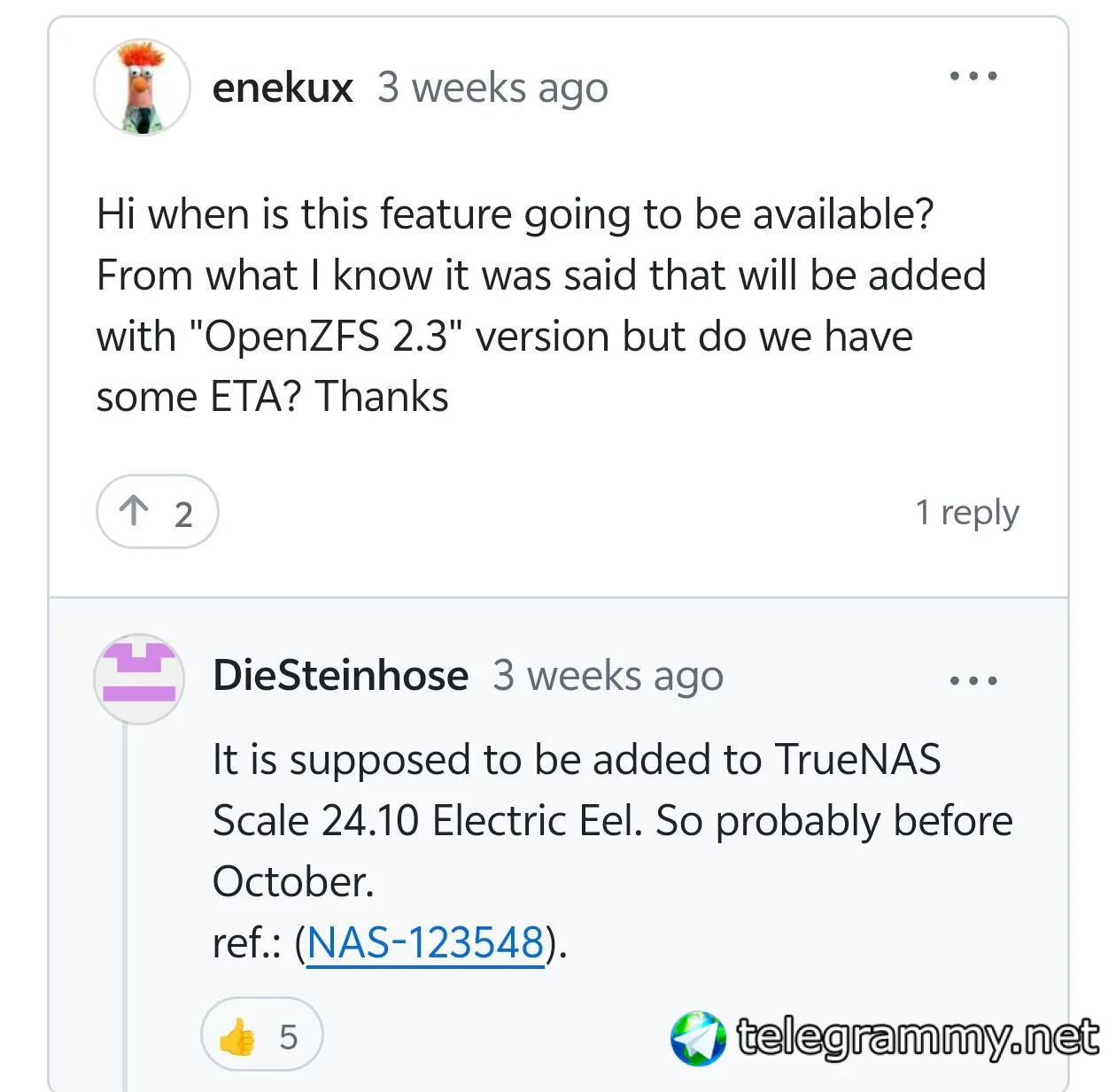

мужики, ачо там нынче, raidz можно доп. дисками расширять?

Его в мастер добавили аж в ноябре

Vladislav

Vladislav

а не, зря быканул, линк есть на презу

Да, там в презентации описано, не совсем классический ребилд, но хоть что-то

жюн

жюн

Да, там в презентации описано, не совсем классический ребилд, но хоть что-то

по факту то энивей всё двигается долго и мучительно

жюн

жюн

Да, в самом zfs её ещё не включили

залепили ещё ребилды между уровням raidz, в целом то +- так же должно быть, если достаточно свободного места

Алексей

Алексей

Ребята, всем привет, я понимаю что возмжоно не по адресу, но больше спросить негде.

в общем мне нужно перегнать 120 тер с одного массива на другой.

исходный массив на 12 дисках exos 16тб организован в виде двух mdadm raid6 соединенных с помощью lvm в один массив (типа raid60)

второй массив состоит из 16 таких же дисков и организован в виде raidz2 x 2 (страйп из двух raidz2 по 8 дисков)

Оба массивы собраны внутри одного HBA LSI 9211-16i (24 диска воткнуты в корзину и 4 диска напрямую через 8087-4сата)

на втором массиве создан zvol точно такого же объема как и лвм.

при попытке сделать дд с одного на другой - скорость около 200мегабайт/сек

если читать с первого в /dev/null скорость 800мегабайт/сек (что меня устраивает)

если писать во второй с оперативки то скорость в районе 1гигабайт/сек (что меня тоже устраивает)

выручайте братцы, невкурю где я не прав!

Ivan

Ivan

Станислав

Станислав

Алексей

Алексей

я имею в виду что если читать первый массив с помощью дд в девнулл то читается со скоростью 800

Sergey

Sergey

Алексей

Алексей

в пуле нет ни slog на ssd ни special на ssd ? только nl-sas?

ничего это нет, и это не нужно для последовательной записи

Vladislav

Vladislav

Станислав

Станислав

я имею в виду что если читать первый массив с помощью дд в девнулл то читается со скоростью 800

А, понял, массивы то на одной машине. Провтыкал

Алексей

Алексей

У тебя медленная скорость ZFS на запись?

да, пишет медленно если читать с первого массива. Если писать с оперативки, то он вполне себе гигабайт в секунду прожовывает

Sergey

Sergey

ничего это нет, и это не нужно для последовательной записи

для такой конфигурации это очень хороший результат. Попробуйте еще убрать sync

Vladislav

Vladislav

Алексей

Алексей

Станислав

Станислав

да, пишет медленно если читать с первого массива. Если писать с оперативки, то он вполне себе гигабайт в секунду прожовывает

Так узкое место, скорее всего, HBA LSI 9211-16i. Ему одновременно и читать и писать приходиться

Алексей

Алексей

Так узкое место, скорее всего, HBA LSI 9211-16i. Ему одновременно и читать и писать приходиться

ну не на столько же , не надо)))

Станислав

Станислав

ну не на столько же , не надо)))

Запустите одновременно чтение с первого в /dev/null и запись во второй из оперативки)

Vladislav

Vladislav

да, я писал из тмпфс

mount /dev/tmpfs /tmp/tmpfs

dd if=/dev/random of=/tmp/tmpfs/test.disk

А затем же

dd if=/tmp/test.disk of=/dev/zvol

?

Алексей

Алексей

mount /dev/tmpfs /tmp/tmpfs

dd if=/dev/random of=/tmp/tmpfs/test.disk

А затем же

dd if=/tmp/test.disk of=/dev/zvol

?

абсолютно верно, за исключением косметики в виде размера блока

George

George

Vladislav

Vladislav

Так узкое место, скорее всего, HBA LSI 9211-16i. Ему одновременно и читать и писать приходиться

С учётом теста выше - я бы сказал что так и есть

Vladislav

Vladislav

Запустите одновременно чтение с первого в /dev/null и запись во второй из оперативки)

Можешь проверить вот так

Vladislav

Vladislav

Georg🎞️🎥

Georg🎞️🎥

Так узкое место, скорее всего, HBA LSI 9211-16i. Ему одновременно и читать и писать приходиться

В каком месте он узкий ?)

Станислав

Станислав

В каком месте он узкий ?)

Мы точно модели ещё не знаем. Но у контроллера узким местом в таких режимах работы может выступать процессор на нём.

Georg🎞️🎥

Georg🎞️🎥

Мы точно модели ещё не знаем. Но у контроллера узким местом в таких режимах работы может выступать процессор на нём.

Он же просто пробрасывает винты в систему … да и даже про иопс если говорить, даже мои древние hba по 40-50к иопс… вот и вопрос , какая узость на 20 винтах

George

George

Станислав

Станислав

Запустите одновременно чтение с первого в /dev/null и запись во второй из оперативки)

@underflow17 этот вариант не проверен?)

Алексей

Алексей

@underflow17 этот вариант не проверен?)

нууууу даа....

поэтому и молчу в тряпочку. есть одна гипотеза сейчас проверяю.

Georg🎞️🎥

Georg🎞️🎥

Ребят, я в общем думаю тупо проц не тащит. Завтра попробую другой поставить

Что именно он не тащит ? 30 дисков ?

Станислав

Станислав

290k iops, ваши диски выдают столько ?

Так Алексей написал, что проц на серваке не тянет, судя по всему

Georg🎞️🎥

Georg🎞️🎥

Так Алексей написал, что проц на серваке не тянет, судя по всему

Ааааа этот проц … да что там такое стоит то 😰

Artem

Artem

Roman

Roman

Group Butler

Group Butler