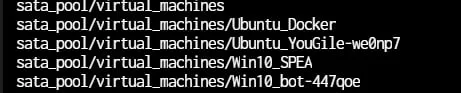

смотреть надо zfs list

Arseniy

Arseniy

Станислав

Станислав

Arseniy

Arseniy

Станислав

Станислав

Nikita

Nikita

George

George

George

George

Aleksey

Aleksey

Arseniy

Arseniy

Fedor

Fedor

Dexex

Dexex

Dexex

Dexex

Dexex

Dexex

Dexex

Dexex

Dexex

Dexex

Vladislav

Vladislav

Fedor

Fedor

Dexex

Dexex

Vladislav

Vladislav

Evgeny

Evgeny

Dexex

Dexex

Evgeny

Evgeny

Илья

Илья

Vladislav

Vladislav

Vladislav

Vladislav

Dexex

Dexex

Dexex

Dexex

Dexex

Dexex

Vladislav

Vladislav

Konstantin

Konstantin

Konstantin

Konstantin

Vladislav

Vladislav

Fedor

Fedor

Alexander

Alexander

Alex

Alex

llacqie

llacqie

Alex

Alex

Alexander

Alexander

Alexander

Alexander

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Станислав

Станислав

Vladislav

Vladislav