Похоже тут нет смысла мучаться с синтетикой, нужен так сказать натурный тест, с использованием собственно энжикса

взять и нагрузить вебгрузилкой 👍

edo1

edo1

fio numjobs=1 bs=4k size=4k iodepth=1 rw=read filename=/zfs/1.tmp & fio numjobs=1 bs=4k size=4k iodepth=1 rw=read filename=/zfs/2.tmp & fio numjobs=1 bs=4k size=4k iodepth=1 rw=read filename=/zfs/3.tmp ......

Условно так, количество файлов через ctrl-c —> ctrl-v сделаете

Не смешно.

Там несколько миллионов инод, доступ к файловый, разумеется, случайный, что и вызывает рост доли arc, занятой метаданными

Vladislav

Vladislav

Не смешно.

Там несколько миллионов инод, доступ к файловый, разумеется, случайный, что и вызывает рост доли arc, занятой метаданными

:)))))

Вот тут человек шутку оценил

George

George

Не смешно.

Там несколько миллионов инод, доступ к файловый, разумеется, случайный, что и вызывает рост доли arc, занятой метаданными

я на wrk делал имитацию нужной нагрузки когда для cdn тестил zfs под nginxом, к слову

edo1

edo1

Так мне интересны теоретические измышления, почему на dnode выделено 10% от метаданных в памяти?

Andrey

Andrey

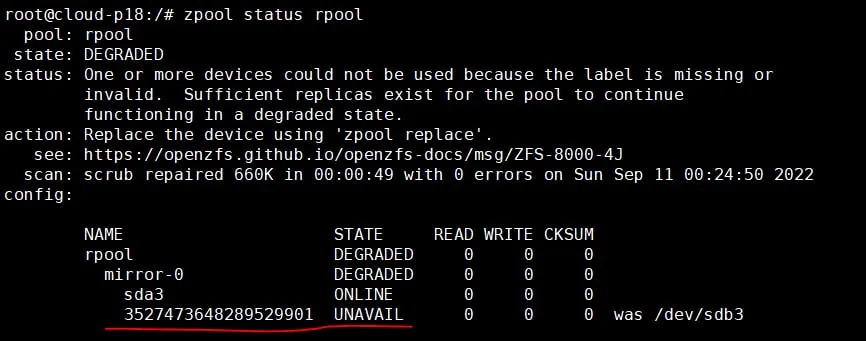

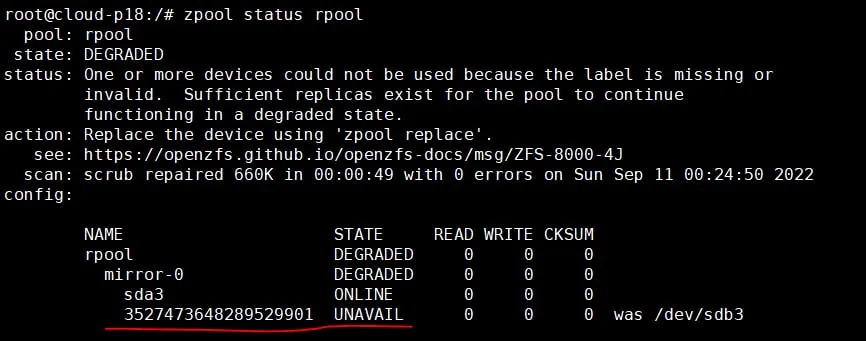

всем привет, подскажите, первый раз меняю диск в рейде

есть raid1 из двух дисков, один требует замены, делать буду на горячую, я верно понимаю, просто вытаскиваю требуемый, вставляю новый и zpool replace -f <пул> <старое устройство> <новое устройство>

никаких больше нюансов?

Art

Art

всем привет, подскажите, первый раз меняю диск в рейде

есть raid1 из двух дисков, один требует замены, делать буду на горячую, я верно понимаю, просто вытаскиваю требуемый, вставляю новый и zpool replace -f <пул> <старое устройство> <новое устройство>

никаких больше нюансов?

Вытаскивать проблемный диск не нужно и не стоит. Ведь после этого пул будет в состояние degraded, это опасное

Добавляешь новый диск в систему физически

Делаешь реплейс

Дожидаешься пока закончится ресилвер

Убираешь проблемный диск из системы

Andrey

Andrey

Art

Art

а у меня и так сейчас состояние degraded

Аа, диск совсем сбойный уже... Ну тогда разницы нет, получается

Georgij

Georgij

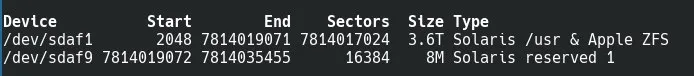

Возможно, в пул добавлен не весь диск, а раздел на нем. Т.е. перед replace надо скопировать разметку.

Алексей

Алексей

Georgij

Georgij

С форума truenas: Преимущества использования раздела вместо необработанного дискового устройства:

1) Таблица разделов документирует содержимое и структуру диска и повышает совместимость с другими ОС.

2) Использование раздела, меньшего, чем необработанный размер диска, дает дополнительную свободу действий для замены неисправного диска диском другого размера/геометрии/марки.

Ivan

Ivan

есть ли инфа когда релиз 2.1.6 ?

ну или хотя бы может втащат 5.19 в 2.1.5 ...

в дебиане с релизом ядра 5.19 в sid стали собираться zfs модули

Andrey

Andrey

Ivan

Ivan

Aleksei

Aleksei

Fedor

Fedor

https://github.com/openzfs/zfs/releases только 5.18

да, я видел, но у меня уже давно работает

но лучше всё же 2.1.6)

Aleksei

Aleksei

это номер предыдущего диска?

на сколько я помню это идентификатор который zfs пишет на диски при добавлении в пул. сейчас диска нет, но zfs знает идентификатор и поймет что именно ты хочешь заменить.

Δαρθ

Δαρθ

да, я видел, но у меня уже давно работает

но лучше всё же 2.1.6)

да блин не хочу колхозить и компилять

а в дистре 5.19 не станет поддержтваться или пока 2.1.5 не покажет 5.19 или пока 2.1.6 ее релизнется

Vladislav

Vladislav

да блин не хочу колхозить и компилять

а в дистре 5.19 не станет поддержтваться или пока 2.1.5 не покажет 5.19 или пока 2.1.6 ее релизнется

2.1.5 не покажет 5.19, потому что там нет коммитов для 5.19

Владимир

Владимир

https://zrepl.github.io/ - кто-то пользуется ?

схоронил), может как нибудь переделаю свою репликаицию, хотя она пока не подводила)

Shaker

Shaker

Да у нас тоже свои скрипты есть, и постоянно меняются. Потом кто-то предложил написать на golang утилиту, а она оказалась, уже есть, и ровно как надо.

Владимир

Владимир

https://zrepl.github.io/quickstart/continuous_server_backup.html

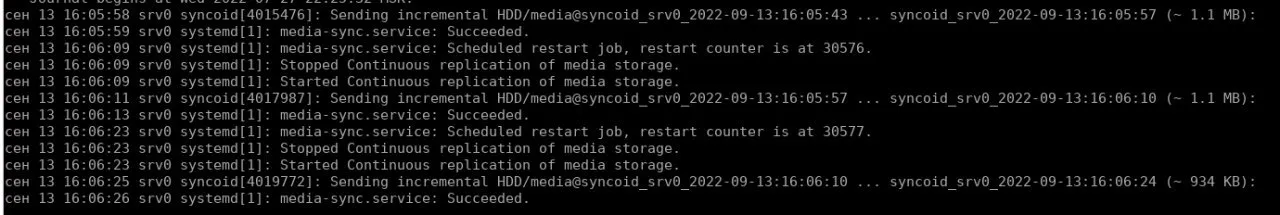

я так делаю только сам, через системд службу

Shaker

Shaker

Да я думаю, что у большинства типа: while true; do nc -l -p 9904 | mbuffer -q -s 128k -m 8G | pv | zfs receive blablatank/blablavol o ; done

Владимир

Владимир

Владимир

Владимир

Да я думаю, что у большинства типа: while true; do nc -l -p 9904 | mbuffer -q -s 128k -m 8G | pv | zfs receive blablatank/blablavol o ; done

почти, я взял прослойку в виде синкоида

Ivan

Ivan

https://zrepl.github.io/ - кто-то пользуется ?

на первый взгляд похоже на zfs-autobackup на питоне

Vladimir

Vladimir

у меня такой скриптик запускается через crontab раз в день, работает совместно с zfs-auto-snapshot , backup-root настроен с ssh keys в /root/.ssh/config

#! /bin/bash

# get last two daily snapshots

# and send incremental copy

d=$(date +%Y-%m-%d)

last_backup=$(ssh -T backup-root "zfs list -t snapshot|grep home@zfs-auto-snap_daily|tail -n 1 |cut -d ' ' -f 1|cut -d / -f 2")

last_local=$(/sbin/zfs list -t snapshot|grep export/home@zfs-auto-snap_daily|tail -n 1 |cut -d ' ' -f 1|cut -d / -f 2)

if [[ "${last_backup}" != "${last_local}" ]];then

/sbin/zfs send -I \

export/$last_backup export/$last_local | \

ssh backup-root zfs receive -o compress=lz4 -v -F backup-tnl/home

fi

# cleanup hourly snapshots

ssh -T backup-root "bash -s" <<END

# remove all hourly snapshots

zfs list -t snapshot|grep home@zfs-auto-snap_hourly|cut -d ' ' -f 1 > /tmp/$d.lst

# keep last 14 daily snapshots only

zfs list -t snapshot|grep home@zfs-auto-snap_daily|cut -d ' ' -f 1|head -n -14 >> /tmp/$d.lst

# keep last 4 weekly snapshots only

zfs list -t snapshot|grep home@zfs-auto-snap_weekly|cut -d ' ' -f 1|head -n -4 >> /tmp/$d.lst

n_cleanup=\$(cat /tmp/$d.lst|wc -l)

if [[ \$n_cleanup -gt 0 ]];then

echo "Going to clean \$n_cleanup snapshots"

for s in \$(cat /tmp/$d.lst);do

zfs destroy -v \$s

done

else

echo "Nothing to cleanup"

fi

END

Владимир

Владимир

Vladislav

Vladislav

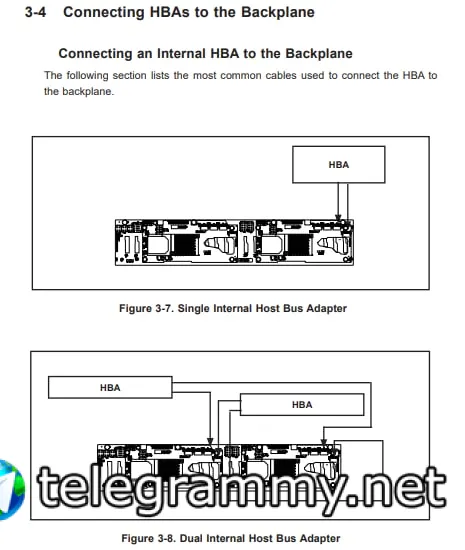

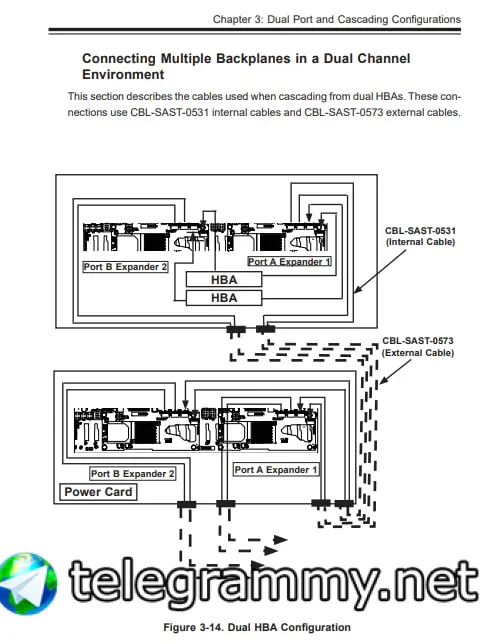

В тему отказоустойчивости - для SAS дисков есть схема с ZFS и рейд контроллером, а есть ли в свободном доступе бэкплейн для u.2 дисков?

Shaker

Shaker

Vladislav

Vladislav

В смысле забесплатно ?

Нет конечно, но и не в стоимость сервера. Мне интересно как они выглядят и какой у них разъём подключения

Shaker

Shaker

Да выглядят как обычный BP, разъемы HD sas, как правило, есть с резервированием, есть без. Резервированием nvme если честно никто не пользовались.

Vladislav

Vladislav

https://aliexpress.ru/item/1005004329776315.html

Да я вот тоже наткнулся на Алике, задумался

Vladislav

Vladislav

Maksim

Maksim

С форума truenas: Преимущества использования раздела вместо необработанного дискового устройства:

1) Таблица разделов документирует содержимое и структуру диска и повышает совместимость с другими ОС.

2) Использование раздела, меньшего, чем необработанный размер диска, дает дополнительную свободу действий для замены неисправного диска диском другого размера/геометрии/марки.

зашёл в чат поинтересоваться может ли быть ситуация, что новый диск на писечку меньше и из-за этого в вдев не собирается, а тут буквально на днях уже ответили. очень удобно)

Ivan

Ivan

зашёл в чат поинтересоваться может ли быть ситуация, что новый диск на писечку меньше и из-за этого в вдев не собирается, а тут буквально на днях уже ответили. очень удобно)

если зфсу отдать весь диск он сам сделает на нем партиций

Vladislav

Vladislav

у меня там нет lsblk почему-то. нашёл скрипт, но он пустого места не показал(

Я имел ввиду Гугл, но ладно

Gpart show