Pbs делать своп на zfs через отдельный раздел

Так он сам создал, я создал пул из 20 дисков, добавлял диски по dev/disk/by-id/ целиком, сейчас смотрю и вижу разметку как выше

Device Start End Sectors Size Type

/dev/sdx1 128 4194304 4194177 2G Linux swap

/dev/sdx2 4194432 5860533134 5856338703 2.7T Solaris /usr & Apple ZFS

Ну и вопрос какого фига)

Fedor

Fedor

Кстати. @gmelikov подскажи плз - свап на зол использовать уже можно, он стабилен? Были как-то времена, когда он мог систему повесить. По аналогии с вставанием системы колом при высоком io на странных медленных носителях

Ivan

Ivan

Ну тогда, чтобы убрать проблемы с записью в swap можно zswap использовать.

это может отсрочить, но не решить проблему

LordMerlin

LordMerlin

Хотя, вот тоже странно, видимо от дистрибутива зависит. Все Проксмоксы, что ставил на raidz ни разу не делали раздел своп.

George

George

Станислав

Станислав

Кстати. @gmelikov подскажи плз - свап на зол использовать уже можно, он стабилен? Были как-то времена, когда он мог систему повесить. По аналогии с вставанием системы колом при высоком io на странных медленных носителях

У меня на 2.1.2 норм живёт, но почти не используется, так как ОЗУ с запасом

Евгений

Евгений

zfs set aclmode=passthrough rpool

zfs set aclinherit=passtrhough rpool

setfacl -m u:root:rwx /rpool/data/test/

setfacl: /rpool/secure/data/test/: Operation not supported

Привет, подскажите что делаю не так.

Евгений

Евгений

Владимир

Владимир

в общем это тоже самое что и снапшот, только снапшот держит блоки, а закладка нет, она только хранит инфу что такие блоки были

Egor

Egor

я такую конструкцию использую:

gpart backup da0 | ssh admin@backup dd of=/mnt/backup/test/`uname -n`/da0.backup

zfs send -R zroot@clear | ssh admin@backup "gzip -1cf > /mnt/backup/test/`uname -n`/da0p3.img.gz"

Первая команда переносит по сети на бэкап-сервер копию таблицы разделов, вторая - снапшот clear. Т.о. можно выполнять full-backup любой машины, хоть физической хоть виртуальной (и разворачивать хоть на физике хоть в ВМ)

Владимир

Владимир

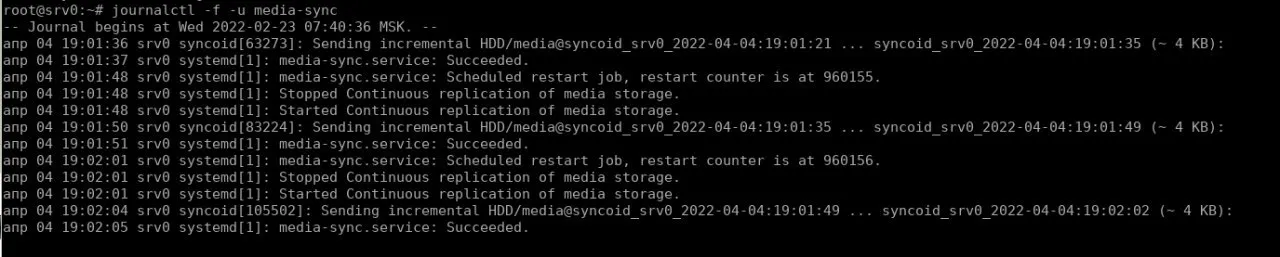

[Unit]

Description=Continuous replication of media storage

After=network.target

[Service]

ExecStart=/usr/sbin/syncoid root@0.0.0.0:HDD/media HDD/media --create-bookmark

Restart=always

RestartSec=10000ms

StartLimitInterval=0

[Install]

WantedBy=multi-user.target

Владимир

Владимир

я так понимаю у самого zfs тоже есть такой функционал, саноид это просто удобная прослойка для работы с этим

George

George

Может кто ставил линухи на нативно шифрованный zfs? Он вообще может грузиться с такого диска?

может, не помню шифровал ли вообще весь рут, но хомяк точно шифровал. Нюансы только с бут пулом, либо юзать efistub

Станислав

Станислав

Может кто ставил линухи на нативно шифрованный zfs? Он вообще может грузиться с такого диска?

Есть пару серверов с зашифрованным рутом.

Нужно только /boot вынести либо на обычный раздел, либо в отдельный пул, который будет соответствовать требования бут-пула для grub.

Если UEFI загрузка, то EFI раздел всегда отдельно, у него вообще свои требования к файловой системе

Станислав

Станислав

При перезагрузке нужно будет ввести пароль либо прямо на компе, либо, как я сделал, подключившись по ssh в initramfs, вызвать zfs unlock, ввести пароль и вуаля.

Для этой возможности нужно установить dropbear-initramfs, настроить его

Также, при шифрованном root, нужно установить zfs-initramfs

Murmuring

Murmuring

Здравствуйте 👋

Подскажите пожалуйста. При сборке сервера поменял диски местами случайно и теперь состояние пула degraded. Можно как то это исправить ?

Murmuring

Murmuring

Zfs по идее ориентируется на метаданввн диски а не на его физическое расположение

А он у меня выпал в degraded, из-за смены пути (dev/sda, dev/sdb и т.д.)

Andrey

Andrey

-d dir|device

Uses device or searches for devices or files in dir. The -d option can be specified multiple times.

Mikhail

Mikhail

Приветствую.

Помогите плиз разобратся в связке iscsi+zvol на Linux.

Что имеют - это чтение-запись через iscsi в разы медленнее (по latency - 1мс на zfs, 10-50мс - через iscsi).

Что заметил и что смущается - в OS постоянно пересоздаются ZFS треды:

root 2749615 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_iss]

root 2749639 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_iss]

root 2749644 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_iss]

root 2749646 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_0]

root 2749649 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_1]

root 2749650 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_1]

root 2749652 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_0]

root 2756892 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_iss_h]

root 2756895 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_iss_h]

root 2757139 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_h]

root 2757794 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

root 2757797 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

root 2757800 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

root 2758032 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

root 2758137 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

через 10 сек:

root 2780308 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

root 2781053 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_iss]

root 2781097 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_iss]

root 2781099 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_iss]

root 2781110 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_1]

root 2781112 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_0]

root 2781113 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_0]

root 2781116 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_1]

root 2781284 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

root 2781285 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

root 2781509 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

root 2781540 0.0 0.0 0 0 ? S< 17:58 0:00 [z_wr_int_h]

root 2781550 0.0 0.0 0 0 ? S< 17:58 0:00 [zvol]

Что они такие не постоянные и зачем ядро их постоянно плодит и убивает? Это какая-то недонастройка модуля?

Vladislav

Vladislav

Mikhail

Mikhail

А что по памяти? Кто с другой стороны? Какая скорость Линка? Что между инициатором и таргетом?

Тупит именно таргет сторона, проверил через tcpdump. Между iscsi command и респонсом до 40 мс, хотя zil пишется за 1 миллисекунд. Там raidz на 10 nvme

Mikhail

Mikhail

А то может у Вас все в разных сетях и маршрутизация через кору в двух хопах от сервера

Пакеты все в пределах 150мкс ходят, иногда за 50мкс. Но там копейки по нагрузке получаются.

Mikhail

Mikhail

Более того, отключил sync на zvol - так и диски стали отдыхать, иногда сбрасывая накопившееся.

Okhsunrog

Okhsunrog

Aba

Aba

central

central

Δαρθ

Δαρθ

Maksym

Maksym