George

George

В данном случае считать, что разница до 10% является погрешностью, но это чисто jfyi. Плюс на чтение если блок не сжался хотя бы на 12.5%, то он будет записал в исходном виде и чтение будет исходного блока без разжатия. Чисто в качестве инфы

Владимир

Владимир

Владимир

Владимир

именно поэтому я так понимаю в данном случае без сжатия быстрее, потому что попытки сжать тратят время и только замедляют запись..., а пишется всё равно без сжатия)

Владимир

Владимир

Провёл тесты по записи и чтению файла таблицы Postgresql весом 541017 байт

Рейтинг по занятому в итоге месту

272933 zstd-fast-2

272941 zstd-fast-1

272949 gzip-5

272949 zstd-fast-3

272953 lz4

272953 zstd-fast-4

272957 gzip

272957 gzip-8

272965 gzip-9

272965 zstd-14

272973 gzip-2

272973 gzip-4

272973 gzip-6

272973 zstd-5

272973 zstd-9

272977 on

272981 gzip-7

272981 zstd-12

272981 zstd-15

272981 zstd-4

272989 gzip-1

272989 zstd

272989 zstd-1

272989 zstd-17

272989 zstd-18

272989 zstd-19

272993 zstd-fast-5

272997 gzip-3

272997 zstd-3

272997 zstd-8

273005 zstd-10

273005 zstd-11

273013 zstd-16

273013 zstd-2

273013 zstd-7

273021 zstd-6

273029 zstd-13

274985 zstd-fast-6

283061 zstd-fast-7

291305 zstd-fast-8

308045 zstd-fast-10

315405 zstd-fast-9

355113 lzjb

465545 zstd-fast-50

494373 zstd-fast-30

498029 zstd-fast-20

513641 zstd-fast-60

514425 zstd-fast-40

515649 zstd-fast-70

515925 zstd-fast-80

516257 zstd-fast-90

516533 zstd-fast-100

516733 zle

517493 zstd-fast-500

518281 zstd-fast-1000

541017 off

Рейтинг по затраченному времени на запись

zstd-fast-2 0m5,792s

zstd-fast-4 0m5,810s

zstd-fast-6 0m5,825s

zstd-3 0m5,888s

zstd-fast-10 0m5,916s

gzip-1 0m5,929s

gzip-3 0m5,966s

zstd 0m5,977s

zstd-8 0m6,027s

zstd-fast-1 0m6,261s

zstd-1 0m6,676s

zstd-2 0m6,710s

zstd-5 0m6,807s

zstd-fast-9 0m6,815s

gzip-9 0m6,839s

zstd-9 0m6,843s

zstd-fast-3 0m6,860s

on 0m6,919s

lzjb 0m6,931s

zstd-13 0m6,940s

zstd-fast-50 0m6,991s

zstd-fast-7 0m7,244s

zstd-fast-100 0m7,295s

zstd-fast-1000 0m7,575s

zstd-fast-20 0m7,625s

zstd-fast-90 0m7,626s

zstd-10 0m7,662s

zstd-fast-30 0m7,723s

zstd-fast-70 0m7,941s

off 0m7,970s

zstd-fast-60 0m8,660s

zstd-fast-5 0m8,903s

zstd-fast-80 0m9,103s

lz4 0m9,104s

gzip-7 0m9,717s

zstd-fast-8 0m9,818s

zstd-6 0m9,947s

gzip-5 0m10,313s

gzip-8 0m10,591s

zstd-fast-500 0m10,755s

zstd-14 0m10,772s

zstd-fast-40 0m11,190s

zle 0m11,265s

gzip-4 0m11,301s

zstd-4 0m11,403s

gzip-2 0m12,094s

zstd-7 0m12,775s

gzip-6 0m14,020s

gzip 0m18,246s

zstd-12 0m20,912s

zstd-11 0m23,507s

zstd-18 0m28,346s

zstd-16 0m29,338s

zstd-15 0m38,595s

zstd-19 0m50,360s

zstd-17 0m53,334s

Рейтинг по затраченному времени на чтение

zstd-4 0m3,856s

lz4 0m3,883s

zstd-3 0m3,910s

zstd-11 0m3,911s

zstd-fast-8 0m3,936s

zstd-fast-6 0m3,937s

zstd-fast-5 0m3,943s

zstd-fast-2 0m3,983s

zstd-7 0m3,995s

gzip-4 0m4,012s

zstd-fast-3 0m4,025s

gzip 0m4,030s

gzip-5 0m4,082s

lzjb 0m4,107s

zstd-1 0m4,188s

gzip-6 0m4,204s

on 0m4,239s

zstd-fast-4 0m4,506s

zstd-12 0m4,667s

gzip-7 0m5,045s

zstd-fast-1000 0m5,061s

gzip-8 0m5,262s

zstd-fast-100 0m5,282s

zstd-fast-20 0m5,292s

zstd-fast-70 0m5,334s

zstd-fast-10 0m5,419s

gzip-2 0m5,476s

zstd-6 0m5,714s

zle 0m5,732s

zstd-fast-30 0m5,944s

zstd-10 0m6,170s

off 0m6,203s

zstd-fast-500 0m6,378s

zstd-fast-60 0m6,636s

zstd-14 0m6,650s

zstd-fast-40 0m6,916s

zstd-15 0m7,089s

gzip-9 0m7,716s

gzip-3 0m7,818s

zstd-fast-7 0m7,873s

zstd-fast-80 0m7,900s

zstd-16 0m8,115s

zstd-8 0m8,438s

zstd 0m8,515s

zstd-5 0m8,530s

zstd-2 0m8,540s

gzip-1 0m8,634s

zstd-13 0m8,958s

zstd-9 0m9,546s

zstd-fast-90 0m9,556s

zstd-19 0m9,591s

zstd-18 0m9,807s

zstd-17 0m11,449s

zstd-fast-50 0m13,015s

zstd-fast-9 0m14,598s

Тест проводился в SSD пуле с одним vdev mirror из INTEL_SSDSC2KG960G8 с принудительным sync и выключенным arc кешем и ресайзблоком 8кб процессор AMD 3950X

Владимир

Владимир

Ну сходи в код и убедись

та я вроде убедился)), забил на разборки нет времени), но случай в тесте забавный)

Aleksey

Aleksey

Владимир

Владимир

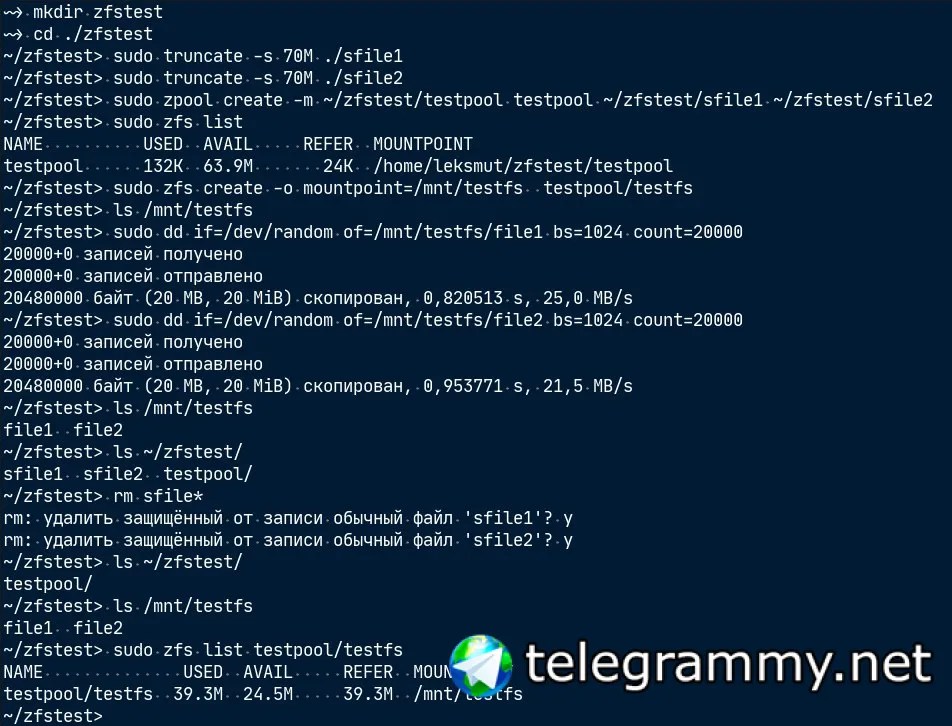

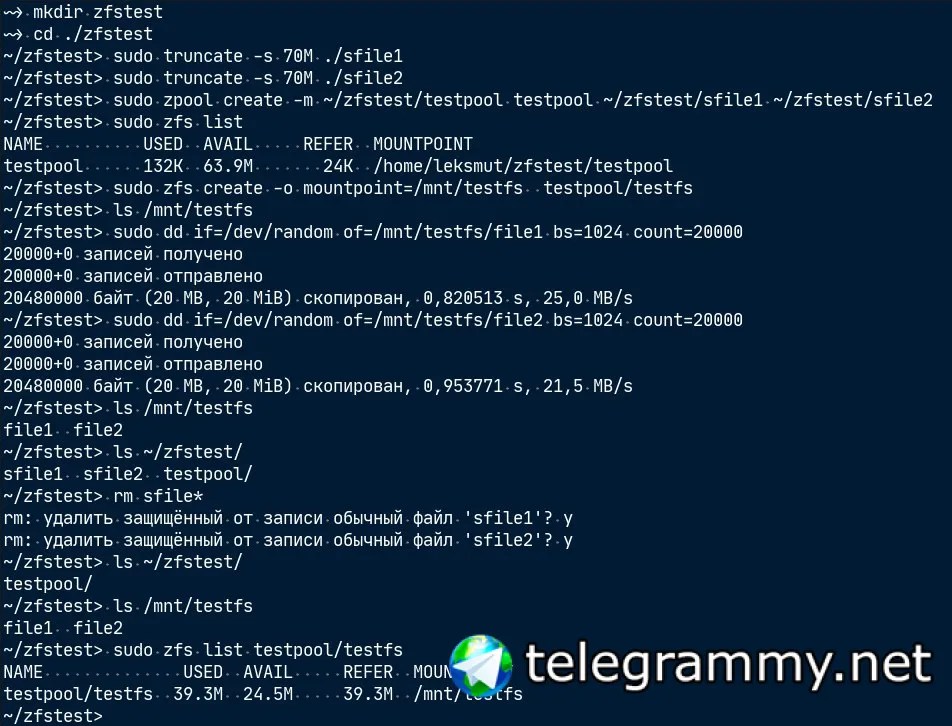

George

George

George

George

если хочется тестить "потерю" или "сбой" диска, то это нужно делать не через файлы, а через блочку

Aleksey

Aleksey

если хочется тестить "потерю" или "сбой" диска, то это нужно делать не через файлы, а через блочку

тестирую хранение в виде нескольких файлов файловой системы. хотя говорят что это только для экспериментов. мне кажется это удобно для некоторых целей. в купе с шифрованием удобно такую конструкцию заливать в недружественные облака (например мэйл ру по webdav, халявный терабайт всем же раздавали, у них была акция) для резервной копии домашнего фотоальбома\архива. обычным штатным методом zfs туда синхронизировать не получится, как я понимаю. единственное я не уверен, что файлы-устройства будут иметь верную дату модификации, чтоб заливать только измененные, это надо еще протестить будет. возможно zfs тронет все файлы-устройства при размонтировании. и тогда ничего не получится. сейчас чтоб добиться и шифрования и разбиения на файлы терабайтного архива приходится городить велосипед из веракрипт тома внутри vmdk тома, поддерживающего разбиение на 2GB чанки. такая матрешка получается.

Sergey

Sergey

тестирую хранение в виде нескольких файлов файловой системы. хотя говорят что это только для экспериментов. мне кажется это удобно для некоторых целей. в купе с шифрованием удобно такую конструкцию заливать в недружественные облака (например мэйл ру по webdav, халявный терабайт всем же раздавали, у них была акция) для резервной копии домашнего фотоальбома\архива. обычным штатным методом zfs туда синхронизировать не получится, как я понимаю. единственное я не уверен, что файлы-устройства будут иметь верную дату модификации, чтоб заливать только измененные, это надо еще протестить будет. возможно zfs тронет все файлы-устройства при размонтировании. и тогда ничего не получится. сейчас чтоб добиться и шифрования и разбиения на файлы терабайтного архива приходится городить велосипед из веракрипт тома внутри vmdk тома, поддерживающего разбиение на 2GB чанки. такая матрешка получается.

почему не использовать то, что для этого предназначено? к примеру rclone который умеет и шифровать и лить в облака, а тут как предполагается менять данные? выкачивать и закачивать образ ФС целиком?) зачем тогда вообще зфс для этого?

Aleksey

Aleksey

почему не использовать то, что для этого предназначено? к примеру rclone который умеет и шифровать и лить в облака, а тут как предполагается менять данные? выкачивать и закачивать образ ФС целиком?) зачем тогда вообще зфс для этого?

сейчас заливаются rsync'ом те 2ГБ части тома, которые изменились. том представлен в виде 500 шт 2ГБ файликов. попробую что-то аналогично на zfs сделать. zfs удобна из-за всех ее фич шифрование, дедупликация, сжатие + можно добавлять новые файлы-тома и расширять пространство по мере надобности. отпишусь по итогам.

Sergey

Sergey

сейчас заливаются rsync'ом те 2ГБ части тома, которые изменились. том представлен в виде 500 шт 2ГБ файликов. попробую что-то аналогично на zfs сделать. zfs удобна из-за всех ее фич шифрование, дедупликация, сжатие + можно добавлять новые файлы-тома и расширять пространство по мере надобности. отпишусь по итогам.

ну это мягко говоря изврат и возможность выстрелить себе в ногу)

Sergey

Sergey

вообще не знал, что rclone может шифровать и синхронизировать папку. может и правда изврат.

он же позволит отдельно файлами манипулировать

Sergey

Sergey

ну даже если он не мог бы, по идее есть тулзы, которые могут шифровать файлы а их уже можно rsyncом

Aleksey

Aleksey

ну кстати сходу могу сказать один минус. если много мелких файлов и разветвленная структура архива, то завязнет синхронизация. тут же мы синхронизируем 500 довольно больших одинаковых блоков по 2ГБ. это и при копировании и про закачке куда-то удобнее. имхо. я пробовал enсFS или как-то так она на лету шифрует всё пофайлово. но это у меня не завелось.

George

George

zfs умеет в частичный ресильвер, т.е. если сделать миррор, и один "диск" offline'ить, то при его online он по txg будет только изменившееся обновлять

Sergey

Sergey

Всем привет. Обновил свой livecd, теперь там zfs 2.1.4

https://git.s-morozov.net/sergey/archlive-zfs/releases/tag/2022.03.30

vint._.243

vint._.243

Собрать для себя рабочий сквош образ с поддержкой всего нужного

И разворачивать его любой ливкой с необходимым инструментом и поддержкой нужных fs и блочных устройств

На всем что нужно

офф образа не всегда взлетают там где надо и с нужной конфигурацией

vint._.243

vint._.243

Если он дает подгрузить нужный тебе образ, то нет ничего сложного

загрузил ливку, разметил диски

подтянул образ, развернул

в случае с zfs даже fstab править не потребуется (только загрузчик поставить, да конфиг сети подравить)

и можно в ребут

Aleksey

Aleksey

Владимир

Владимир

Владимир

Владимир

Aleksey

Aleksey

оно распределяет равномерно по вдевам, + вроде как учитывает загруженность

а можно настраивать алгоритм?

Владимир

Владимир

а можно настраивать алгоритм?

на сколько мне известно нет, но ты подожди может что-то ответят

Aleksey

Aleksey

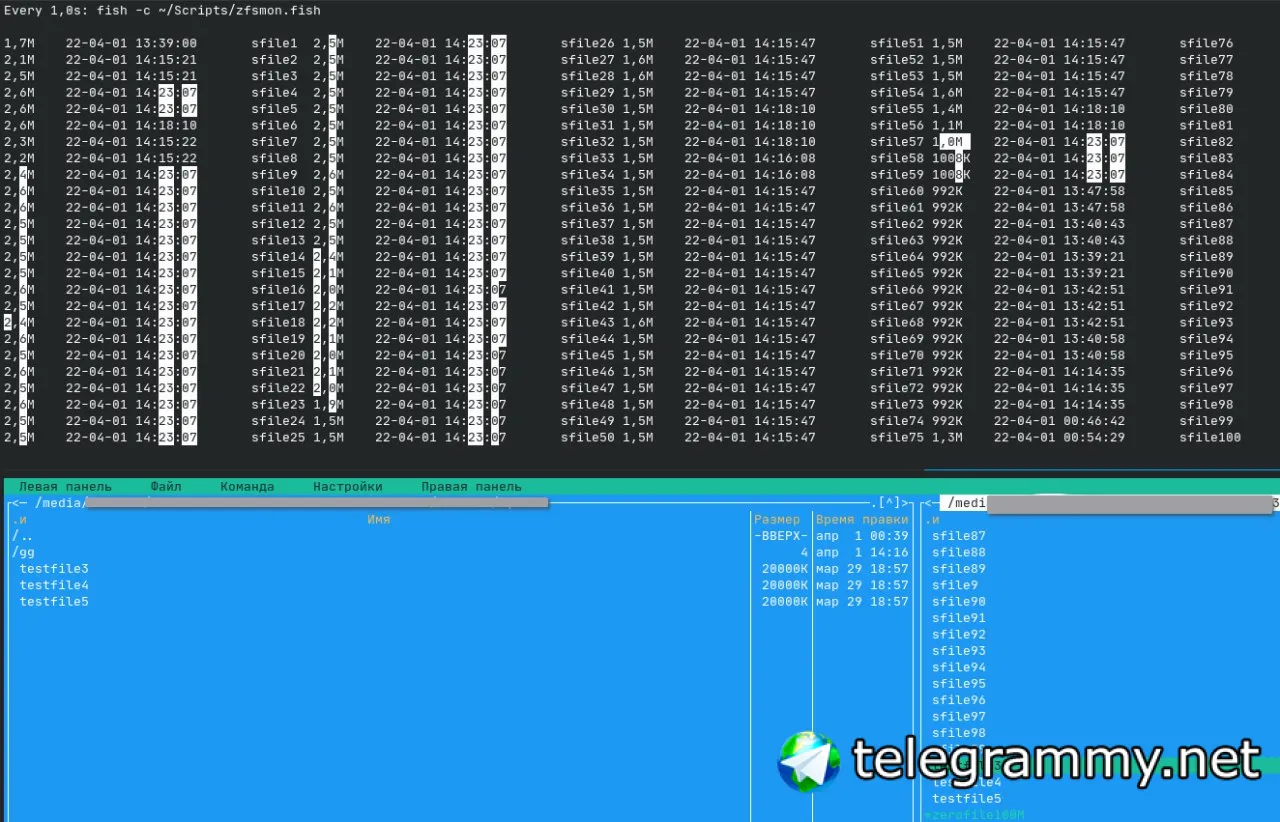

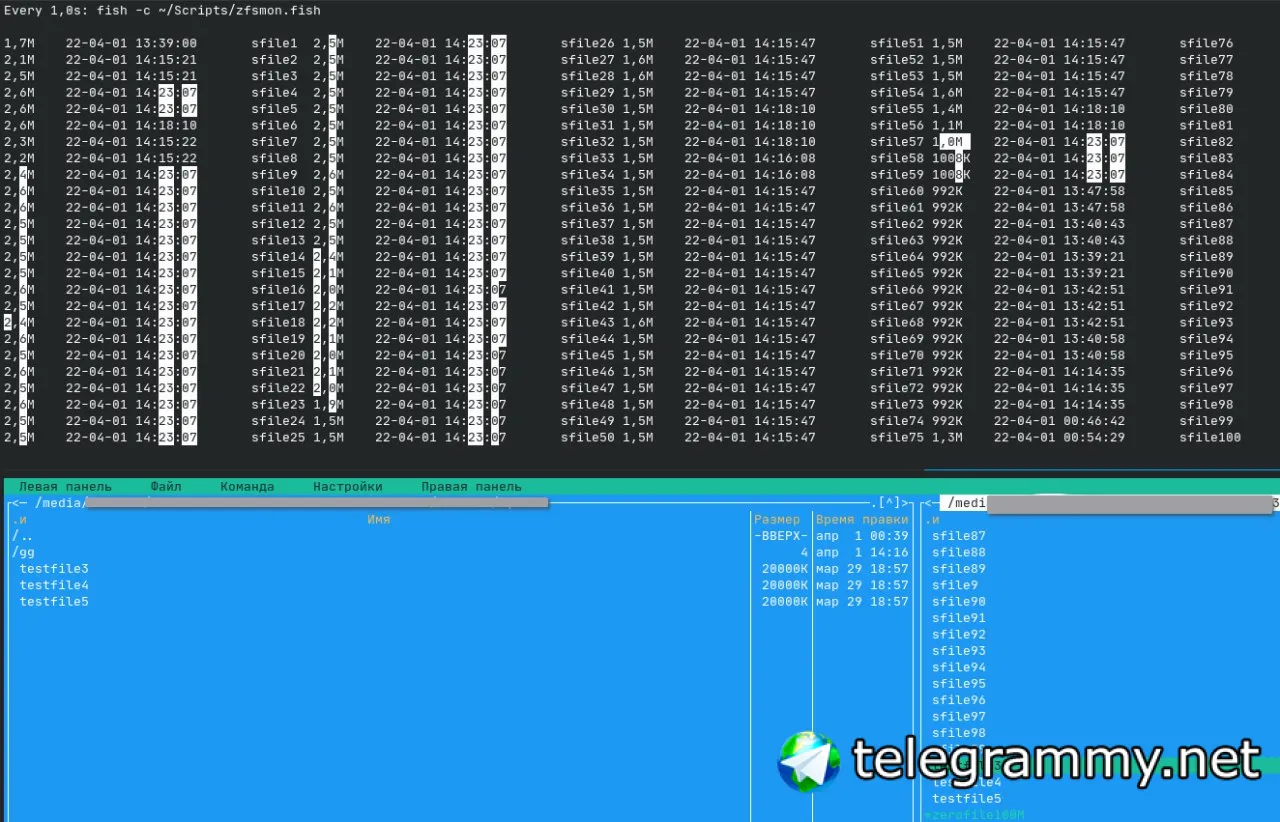

это своего рода изврат для бекапирования ФС на облако. я хочу потом измененные файлы vdev отправлять на облако. но если меняется так много при копировании копеечного файла, то это не варик.

Александр

Александр

Александр

Александр

Сжатия эффективность не вижу я

А, "занятое место" можно проинтерпретировать по-разному, и я воспринял сложнее, чем надо

Владимир

Владимир

потому что имеет самую высокую производительность записи и малый вес, а чтение улучшится когда включится арк

Okhsunrog

Okhsunrog

Владимир

Владимир

А как можно датасет из lz4 в zstd перевести? Чтобы данные пережались?

речь про чистый хост или в проксмоксе виртуалка или контейнер?

Okhsunrog

Okhsunrog

речь про чистый хост или в проксмоксе виртуалка или контейнер?

Нет, просто хост. Два диска по 4тб стоят в mirror, заполнены где-то на 1.5тб

Владимир

Владимир

Нет, просто хост. Два диска по 4тб стоят в mirror, заполнены где-то на 1.5тб

создать ещё один датасет с нужными параметрами и передить в него данные

George

George

потому что имеет самую высокую производительность записи и малый вес, а чтение улучшится когда включится арк

Стоит учесть что arc нынче сжатые данные хранит, и только часть временно в разжатом виде

Владимир

Владимир

Fedor

Fedor

Стоит учесть что arc нынче сжатые данные хранит, и только часть временно в разжатом виде

Как-то видел, что л2арк счётчик свободного места уходил в почти -1 в иллюмос, это как раз из-за этого?

George

George

Как-то видел, что л2арк счётчик свободного места уходил в почти -1 в иллюмос, это как раз из-за этого?

l2arc в таком случае тоже хранит сжатое, но по причине такого поведения не скажу

Олег

Олег

в pbs создал рейдz, добавлял целые диски (не rpool), сейчас смотрю разметку диска и диву диваюсь))) он swap раздел добавил))) встает вопрос как заменить диск? копировать разметку или просто диск так же добавить

Device Start End Sectors Size Type

/dev/sdx1 128 4194304 4194177 2G Linux swap

/dev/sdx2 4194432 5860533134 5856338703 2.7T Solaris /usr & Apple ZFS

central

central

Egor

Egor