зашёл в чат поинтересоваться может ли быть ситуация, что новый диск на писечку меньше и из-за этого в вдев не собирается, а тут буквально на днях уже ответили. очень удобно)

Создание разделов имеет смысл на потребительском nvme используемом в качестве ZIL

Maksim

Maksim

root@truenas[~]# gpart show

=> 40 488397088 ada0 GPT (233G)

40 1024 1 freebsd-boot (512K)

1064 488374272 2 freebsd-zfs (233G)

488375336 21792 - free - (11M)

=> 40 7814037088 ada1 GPT (3.6T)

40 88 - free - (44K)

128 4194304 1 freebsd-swap (2.0G)

4194432 7809842696 2 freebsd-zfs (3.6T)

=> 40 7814037088 ada2 GPT (3.6T)

40 88 - free - (44K)

128 4194304 1 freebsd-swap (2.0G)

4194432 7809842696 2 freebsd-zfs (3.6T)

Выглядит так, что не сделали хвостик с конца. Или неважно с конца или с начала он создаётся?

Vladislav

Vladislav

root@truenas[~]# gpart show

=> 40 488397088 ada0 GPT (233G)

40 1024 1 freebsd-boot (512K)

1064 488374272 2 freebsd-zfs (233G)

488375336 21792 - free - (11M)

=> 40 7814037088 ada1 GPT (3.6T)

40 88 - free - (44K)

128 4194304 1 freebsd-swap (2.0G)

4194432 7809842696 2 freebsd-zfs (3.6T)

=> 40 7814037088 ada2 GPT (3.6T)

40 88 - free - (44K)

128 4194304 1 freebsd-swap (2.0G)

4194432 7809842696 2 freebsd-zfs (3.6T)

Выглядит так, что не сделали хвостик с конца. Или неважно с конца или с начала он создаётся?

В теории не имеет, если truenas может в сложную математику, но я не могу найти на форумах постик который подтвердил бы это

Maksim

Maksim

В теории не имеет, если truenas может в сложную математику, но я не могу найти на форумах постик который подтвердил бы это

спасибо. ну ладно, в любом случае это домашняя машинка и смерть будет не так страшна, всё суперважное дублируется на другом компе ещё, но есть шанс что меня просто спасёт удаление свапа в крайнем случае

Δαρθ

Δαρθ

Ivan

Ivan

а из этого не следует что если диск меняется на другой с чуть другим размером то уже надо вручную его бить точно под размер?

не знаю что случится, если появится диск иного размера. если само не сделается, то будет шанс руками сделать.

Vladislav

Vladislav

а из этого не следует что если диск меняется на другой с чуть другим размером то уже надо вручную его бить точно под размер?

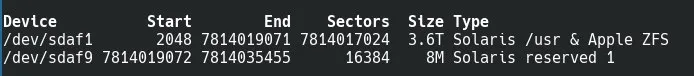

Нет, этот раздел в конце именно потому что его можно спокойно менять в размерах

Т.е. добавив диск в ZFS пул (предположим с количеством секторов на 20 меньше) - это никак не повлияет, потому что эти 20 секторов будут в последнем разделе, а ZFS будет работать с партицией ZFS

Andrey

Andrey

Всем привет. Подскажите для того кто в танке, что делаю не так:

fio --name=fiotest --filename=/testzfs/.tmp --size=128Gb --rw=randread --bs=8K --direct=1 --numjobs=64 --ioengine=libaio --iodepth=32 --group_reporting --runtime=60

fiotest: (g=0): rw=randread, bs=(R) 8192B-8192B, (W) 8192B-8192B, (T) 8192B-8192B, ioengine=libaio, iodepth=32

...

fio-3.25

Starting 64 processes

fiotest: Laying out IO file (1 file / 131072MiB)

Jobs: 64 (f=5): [f(4),r(1),f(38),r(2),f(6),r(1),f(6),r(1),f(5)][100.0%][r=238MiB/s][r=30.5k IOPS][eta 00m:00s]

fiotest: (groupid=0, jobs=64): err= 0: pid=3822629: Fri Sep 16 13:05:14 2022

read: IOPS=28.2k, BW=220MiB/s (231MB/s)(12.9GiB/60002msec)

slat (usec): min=5, max=14821, avg=2269.42, stdev=644.50

clat (nsec): min=1290, max=105471k, avg=70384225.28, stdev=4307655.72

lat (usec): min=271, max=109194, avg=72653.96, stdev=4379.65

clat percentiles (usec):

| 1.00th=[60031], 5.00th=[63701], 10.00th=[65274], 20.00th=[67634],

| 30.00th=[68682], 40.00th=[69731], 50.00th=[70779], 60.00th=[71828],

| 70.00th=[72877], 80.00th=[73925], 90.00th=[74974], 95.00th=[77071],

| 99.00th=[80217], 99.50th=[81265], 99.90th=[85459], 99.95th=[86508],

| 99.99th=[90702]

bw ( KiB/s): min=183507, max=239809, per=99.96%, avg=225227.59, stdev=114.92, samples=7616

iops : min=22913, max=29970, avg=28149.55, stdev=14.37, samples=7616

lat (usec) : 2=0.01%, 4=0.01%, 50=0.01%, 500=0.01%, 750=0.01%

lat (usec) : 1000=0.01%

lat (msec) : 2=0.01%, 4=0.01%, 10=0.01%, 20=0.02%, 50=0.05%

lat (msec) : 100=99.91%, 250=0.01%

cpu : usr=0.15%, sys=2.31%, ctx=1605260, majf=0, minf=24787

IO depths : 1=0.1%, 2=0.1%, 4=0.1%, 8=0.1%, 16=0.1%, 32=99.9%, >=64=0.0%

submit : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

complete : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.1%, 64=0.0%, >=64=0.0%

issued rwts: total=1689920,0,0,0 short=0,0,0,0 dropped=0,0,0,0

latency : target=0, window=0, percentile=100.00%, depth=32

Run status group 0 (all jobs):

READ: bw=220MiB/s (231MB/s), 220MiB/s-220MiB/s (231MB/s-231MB/s), io=12.9GiB (13.8GB), run=60002-60002msec

И этот же диск, но

Andrey

Andrey

fio --name=fiotest --filename=/dev/nvme1n1 --size=128Gb --rw=randread --bs=8K --direct=1 --numjobs=64 --ioengine=libaio --iodepth=32 --group_reporting --runtime=60

fiotest: (g=0): rw=randread, bs=(R) 8192B-8192B, (W) 8192B-8192B, (T) 8192B-8192B, ioengine=libaio, iodepth=32

...

fio-3.25

Starting 64 processes

Jobs: 64 (f=64): [r(64)][100.0%][r=3533MiB/s][r=452k IOPS][eta 00m:00s]

fiotest: (groupid=0, jobs=64): err= 0: pid=2776780: Fri Sep 16 12:34:34 2022

read: IOPS=452k, BW=3530MiB/s (3702MB/s)(207GiB/60010msec)

slat (nsec): min=1380, max=7002.8k, avg=4005.97, stdev=28480.68

clat (usec): min=17, max=33125, avg=4526.81, stdev=3128.68

lat (usec): min=20, max=33355, avg=4530.88, stdev=3131.38

clat percentiles (usec):

| 1.00th=[ 1221], 5.00th=[ 1237], 10.00th=[ 1254], 20.00th=[ 1762],

| 30.00th=[ 2278], 40.00th=[ 2900], 50.00th=[ 3752], 60.00th=[ 4555],

| 70.00th=[ 5538], 80.00th=[ 6849], 90.00th=[ 8979], 95.00th=[11207],

| 99.00th=[14091], 99.50th=[14746], 99.90th=[16188], 99.95th=[16581],

| 99.99th=[20317]

bw ( MiB/s): min= 1125, max=11420, per=100.00%, avg=3535.42, stdev=34.50, samples=7616

iops : min=144022, max=1461881, avg=452525.89, stdev=4415.84, samples=7616

lat (usec) : 20=0.01%, 50=0.01%, 100=0.01%, 250=0.01%, 500=0.01%

lat (usec) : 750=0.01%, 1000=0.01%

lat (msec) : 2=27.14%, 4=26.54%, 10=38.94%, 20=7.36%, 50=0.01%

cpu : usr=1.25%, sys=3.37%, ctx=26751184, majf=0, minf=40744

IO depths : 1=0.1%, 2=0.1%, 4=0.1%, 8=0.1%, 16=0.1%, 32=100.0%, >=64=0.0%

submit : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

complete : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.1%, 64=0.0%, >=64=0.0%

issued rwts: total=27116983,0,0,0 short=0,0,0,0 dropped=0,0,0,0

latency : target=0, window=0, percentile=100.00%, depth=32

Run status group 0 (all jobs):

READ: bw=3530MiB/s (3702MB/s), 3530MiB/s-3530MiB/s (3702MB/s-3702MB/s), io=207GiB (222GB), run=60010-60010msec

Ivan

Ivan

да, в проксе создал сторадж на /dev/nvme1n1

сравни с другой фс и не забудь про fsync. разница будет поменьше. но у zfs тормозят чексуммы и кэш, в версии 3.0 проблему с медленным чтением nvme должны решить.

Andrey

Andrey

таки рядом есть такой же диск, но с lvm, Примерно аналогичная история, но там не уверен что правильно --filename указал

Ivan

Ivan

Model Number: KINGSTON SEDC1500M1920G

это шлак. с fsync он медленней на запись, чем некоторые sata ssd.

Andrey

Andrey

покажите

cat /sys/module/zfs/parameters/zfs_nocacheflush

cat /sys/module/zfs/parameters/zfs_nocacheflush

0

Andrey

Andrey

ну вообще не помогло:

fio --name=fiotest --filename=/zfstest/.tmp --size=128Gb --rw=randread --bs=8K --direct=1 --numjobs=64 --ioengine=libaio --iodepth=32 --group_reporting --runtime=60

fiotest: (g=0): rw=randread, bs=(R) 8192B-8192B, (W) 8192B-8192B, (T) 8192B-8192B, ioengine=libaio, iodepth=32

...

fio-3.25

Starting 64 processes

Jobs: 64 (f=64): [r(64)][100.0%][r=45.3MiB/s][r=5797 IOPS][eta 00m:00s]

fiotest: (groupid=0, jobs=64): err= 0: pid=3713059: Fri Sep 16 13:52:19 2022

read: IOPS=7688, BW=60.1MiB/s (62.0MB/s)(3605MiB/60016msec)

slat (usec): min=5, max=36548, avg=8318.41, stdev=4614.72

clat (nsec): min=1800, max=503356k, avg=257254245.69, stdev=43779717.52

lat (msec): min=5, max=522, avg=265.57, stdev=44.86

clat percentiles (msec):

| 1.00th=[ 186], 5.00th=[ 207], 10.00th=[ 215], 20.00th=[ 228],

| 30.00th=[ 236], 40.00th=[ 243], 50.00th=[ 249], 60.00th=[ 257],

| 70.00th=[ 266], 80.00th=[ 279], 90.00th=[ 313], 95.00th=[ 355],

| 99.00th=[ 405], 99.50th=[ 418], 99.90th=[ 447], 99.95th=[ 456],

| 99.99th=[ 472]

bw ( KiB/s): min=21072, max=77328, per=99.84%, avg=61412.92, stdev=142.72, samples=7616

iops : min= 2634, max= 9666, avg=7676.08, stdev=17.85, samples=7616

lat (usec) : 2=0.01%, 4=0.01%, 10=0.01%

lat (msec) : 10=0.01%, 20=0.01%, 50=0.04%, 100=0.06%, 250=51.50%

lat (msec) : 500=48.37%, 750=0.01%

cpu : usr=0.06%, sys=0.57%, ctx=438675, majf=0, minf=5005

IO depths : 1=0.1%, 2=0.1%, 4=0.1%, 8=0.1%, 16=0.2%, 32=99.6%, >=64=0.0%

submit : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

complete : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.1%, 64=0.0%, >=64=0.0%

issued rwts: total=461460,0,0,0 short=0,0,0,0 dropped=0,0,0,0

latency : target=0, window=0, percentile=100.00%, depth=32

Run status group 0 (all jobs):

READ: bw=60.1MiB/s (62.0MB/s), 60.1MiB/s-60.1MiB/s (62.0MB/s-62.0MB/s), io=3605MiB (3780MB), run=60016-60016msec

Dmitriy

Dmitriy

и во время фио сделайте в другой консоли watch -n 1 "zpool iostat -vylqL 1 1 && zpool iostat -ry 1 1"

Andrey

Andrey

данные по lspci -vv

e1:00.0 Non-Volatile memory controller: Kingston Technology Company, Inc. Device 5012 (rev 03) (prog-if 02 [NVM Express])

Subsystem: Kingston Technology Company, Inc. Device 5012

Physical Slot: 1

Control: I/O- Mem+ BusMaster+ SpecCycle- MemWINV- VGASnoop- ParErr- Stepping- SERR- FastB2B- DisINTx+

Status: Cap+ 66MHz- UDF- FastB2B- ParErr- DEVSEL=fast >TAbort- <TAbort- <MAbort- >SERR- <PERR- INTx-

Latency: 0, Cache Line Size: 64 bytes

Interrupt: pin A routed to IRQ 94

NUMA node: 1

IOMMU group: 104

Region 0: Memory at a2320000 (64-bit, non-prefetchable) [size=16K]

Expansion ROM at a2300000 [disabled] [size=128K]

Capabilities: [40] Power Management version 3

Flags: PMEClk- DSI- D1- D2- AuxCurrent=0mA PME(D0-,D1-,D2-,D3hot-,D3cold-)

Status: D0 NoSoftRst- PME-Enable- DSel=0 DScale=0 PME-

Capabilities: [50] MSI: Enable- Count=1/8 Maskable+ 64bit+

Address: 0000000000000000 Data: 0000

Masking: 00000000 Pending: 00000000

Capabilities: [70] Express (v2) Endpoint, MSI 00

DevCap: MaxPayload 512 bytes, PhantFunc 0, Latency L0s unlimited, L1 unlimited

ExtTag- AttnBtn- AttnInd- PwrInd- RBE+ FLReset+ SlotPowerLimit 75.000W

DevCtl: CorrErr+ NonFatalErr+ FatalErr+ UnsupReq-

RlxdOrd+ ExtTag- PhantFunc- AuxPwr- NoSnoop- FLReset-

MaxPayload 512 bytes, MaxReadReq 512 bytes

DevSta: CorrErr+ NonFatalErr- FatalErr- UnsupReq+ AuxPwr+ TransPend-

LnkCap: Port #0, Speed 8GT/s, Width x4, ASPM not supported

ClockPM+ Surprise- LLActRep- BwNot- ASPMOptComp+

LnkCtl: ASPM Disabled; RCB 64 bytes, Disabled- CommClk+

ExtSynch- ClockPM- AutWidDis- BWInt- AutBWInt-

LnkSta: Speed 8GT/s (ok), Width x4 (ok)

TrErr- Train- SlotClk+ DLActive- BWMgmt- ABWMgmt-

DevCap2: Completion Timeout: Range ABCD, TimeoutDis+ NROPrPrP- LTR+

10BitTagComp- 10BitTagReq- OBFF Via message, ExtFmt- EETLPPrefix-

EmergencyPowerReduction Not Supported, EmergencyPowerReductionInit-

FRS- TPHComp- ExtTPHComp-

AtomicOpsCap: 32bit- 64bit- 128bitCAS-

DevCtl2: Completion Timeout: 50us to 50ms, TimeoutDis- LTR- OBFF Disabled,

AtomicOpsCtl: ReqEn-

LnkCap2: Supported Link Speeds: 2.5-8GT/s, Crosslink- Retimer- 2Retimers- DRS-

LnkCtl2: Target Link Speed: 8GT/s, EnterCompliance- SpeedDis-

Transmit Margin: Normal Operating Range, EnterModifiedCompliance- ComplianceSOS-

Compliance De-emphasis: -6dB

LnkSta2: Current De-emphasis Level: -3.5dB, EqualizationComplete+ EqualizationPhase1+

EqualizationPhase2+ EqualizationPhase3+ LinkEqualizationRequest-

Retimer- 2Retimers- CrosslinkRes: unsupported

Capabilities: [b0] MSI-X: Enable+ Count=16 Masked-

Vector table: BAR=0 offset=00002000

PBA: BAR=0 offset=00002100

Capabilities: [100 v2] Advanced Error Reporting

UESta: DLP- SDES- TLP- FCP- CmpltTO- CmpltAbrt- UnxCmplt- RxOF- MalfTLP- ECRC- UnsupReq+ ACSViol-

UEMsk: DLP- SDES- TLP- FCP- CmpltTO- CmpltAbrt- UnxCmplt- RxOF- MalfTLP- ECRC- UnsupReq+ ACSViol-

UESvrt: DLP+ SDES+ TLP- FCP+ CmpltTO+ CmpltAbrt- UnxCmplt+ RxOF+ MalfTLP+ ECRC+ UnsupReq- ACSViol-

CESta: RxErr- BadTLP- BadDLLP- Rollover- Timeout- AdvNonFatalErr+

CEMsk: RxErr- BadTLP- BadDLLP- Rollover- Timeout- AdvNonFatalErr-

AERCap: First Error Pointer: 00, ECRCGenCap+ ECRCGenEn- ECRCChkCap+ ECRCChkEn-

MultHdrRecCap- MultHdrRecEn- TLPPfxPres- HdrLogCap-

Andrey

Andrey

данные по lspci -vv

HeaderLog: 00000000 00000000 00000000 00000000

Capabilities: [158 v1] Secondary PCI Express

LnkCtl3: LnkEquIntrruptEn- PerformEqu-

LaneErrStat: 0

Capabilities: [178 v1] Latency Tolerance Reporting

Max snoop latency: 0ns

Max no snoop latency: 0ns

Capabilities: [180 v1] L1 PM Substates

L1SubCap: PCI-PM_L1.2+ PCI-PM_L1.1+ ASPM_L1.2- ASPM_L1.1- L1_PM_Substates+

PortCommonModeRestoreTime=10us PortTPowerOnTime=10us

L1SubCtl1: PCI-PM_L1.2- PCI-PM_L1.1- ASPM_L1.2- ASPM_L1.1-

T_CommonMode=0us

L1SubCtl2: T_PwrOn=10us

Kernel driver in use: nvme

Kernel modules: nvme

Andrey

Andrey

и во время фио сделайте в другой консоли watch -n 1 "zpool iostat -vylqL 1 1 && zpool iostat -ry 1 1"

Every 1.0s: zpool iostat testzfs -vylqL 1 1 && zpool iostat testzfs -ry 1 1 pvecore6: Fri Sep 16 14:11:42 2022

capacity operations bandwidth total_wait disk_wait syncq_wait asyncq_wait scrub trim syncq_read syncq_write asyncq_read asyncq_write scrubq_read trimq_write

pool alloc free read write read write read write read write read write read write wait wait pend activ pend activ pend activ pend activ pend activ pend activ

----------- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- -----

testzfs 128G 1.61T 24.9K 71 3.11G 840K 3ms 142us 414us 51us 1ms 3us - 91us - - 51 10 0 0 0 0 0 0 0 0 0 0

nvme1n1p1 128G 1.61T 24.9K 71 3.11G 840K 3ms 142us 414us 51us 1ms 3us - 91us - - 50 10 0 0 0 0 0 0 0 0 0 0

----------- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- -----

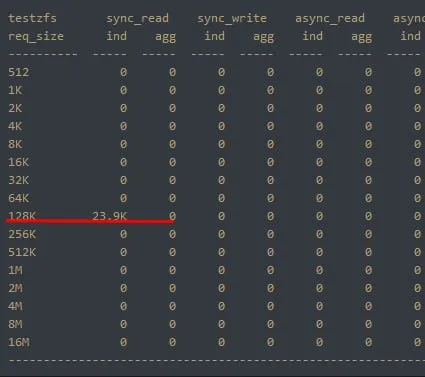

testzfs sync_read sync_write async_read async_write scrub trim

req_size ind agg ind agg ind agg ind agg ind agg ind agg

---------- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- -----

512 0 0 0 0 0 0 0 0 0 0 0 0

1K 0 0 0 0 0 0 0 0 0 0 0 0

2K 0 0 0 0 0 0 0 0 0 0 0 0

4K 0 0 0 0 0 0 0 0 0 0 0 0

8K 0 0 0 0 0 0 0 0 0 0 0 0

16K 0 0 0 0 0 0 0 0 0 0 0 0

32K 0 0 0 0 0 0 0 0 0 0 0 0

64K 0 0 0 0 0 0 0 0 0 0 0 0

128K 23.9K 0 0 0 0 0 0 0 0 0 0 0

256K 0 0 0 0 0 0 0 0 0 0 0 0

512K 0 0 0 0 0 0 0 0 0 0 0 0

1M 0 0 0 0 0 0 0 0 0 0 0 0

2M 0 0 0 0 0 0 0 0 0 0 0 0

4M 0 0 0 0 0 0 0 0 0 0 0 0

8M 0 0 0 0 0 0 0 0 0 0 0 0

16M 0 0 0 0 0 0 0 0 0 0 0 0

----------------------------------------------------------------------------------------------

Dmitriy

Dmitriy

примерно это

------------------------------------------------------------------------

ZFS Subsystem Report Fri Sep 16 10:35:57 2022

Linux 5.4.195-1-pve 2.0.7-pve1

Machine: pv-d (x86_64) 2.0.7-pve1

ARC status: HEALTHY

Memory throttle count: 0

ARC size (current): 98.7 % 11.8 GiB

Target size (adaptive): 100.0 % 12.0 GiB

Min size (hard limit): 25.0 % 3.0 GiB

Max size (high water): 4:1 12.0 GiB

Most Frequently Used (MFU) cache size: 14.6 % 1.3 GiB

Most Recently Used (MRU) cache size: 85.4 % 7.7 GiB

Metadata cache size (hard limit): 75.0 % 9.0 GiB

Metadata cache size (current): 26.6 % 2.4 GiB

Dnode cache size (hard limit): 10.0 % 921.6 MiB

Dnode cache size (current): 73.6 % 678.3 MiB

ARC hash breakdown:

Elements max: 810.3k

Elements current: 35.7 % 289.4k

Collisions: 1.2M

Chain max: 3

Chains: 1.2k

ARC misc:

Deleted: 36.0M

Mutex misses: 3.4k

Eviction skips: 979.1k

ARC total accesses (hits + misses): 1.3G

Cache hit ratio: 97.6 % 1.3G

Cache miss ratio: 2.4 % 31.0M

Actual hit ratio (MFU + MRU hits): 97.4 % 1.3G

Data demand efficiency: 95.1 % 441.9M

Data prefetch efficiency: 14.9 % 8.6M

Dmitriy

Dmitriy

и раз уже начали разбираться, вывод

smartctl -x /dev/nvme1n1

smartctl -x /dev/nvme0n1

cat /proc/mdstat

Dmitriy

Dmitriy

Dmitriy

Dmitriy

не вижу в выводе какая версия zfs

ZFS Subsystem Report Fri Sep 16 10:35:57 2022

Linux 5.4.195-1-pve 2.0.7-pve1

Machine: pv-d (x86_64) 2.0.7-pve1

Dmitriy

Dmitriy

интересен этот раздел

Supported LBA Sizes (NSID 0x1)

Id Fmt Data Metadt Rel_Perf

0 - 512 0 2

1 - 512 8 2

2 - 512 16 2

3 + 4096 0 0

4 - 4096 8 0

5 - 4096 64 0

6 - 4096 128 0

central

central