Писалось мимо датасета прям в пул. А после ребута датасет смонтировался поверх данных

хех, я ж говорил, что это надо проверить)

Mikhail

Mikhail

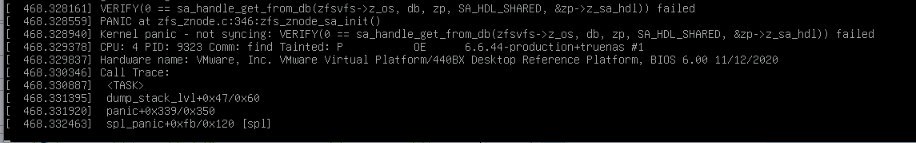

https://forums.truenas.com/t/truenas-nfs-random-crash/9200/28

Спасибо, попробовал, параметр применяется, проверил, но всё то же самое.

Vladislav

Vladislav

Vladislav

Vladislav

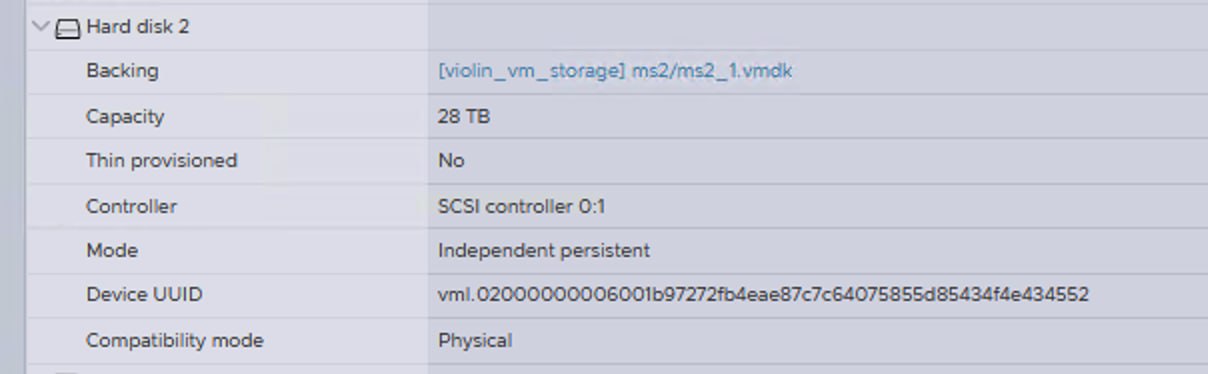

Либо ты пробрасываешь FC адаптер \ LAN карту и цепляешь уже на уровне ОС диски Луны, или ты пробрасываешь этот LUN как RDM или цепляешь диск с датастора

Nikita

Nikita

Но эффект один и тот же и на вм и на реплике даташита на железе (на железе рэид из ssd)

I got confused for the second time... "datasheet"? О_о

Vladislav

Vladislav

Но эффект один и тот же и на вм и на реплике даташита на железе (на железе рэид из ssd)

Тогда рекомендую сюда https://ixsystems.atlassian.net/jira/software/c/projects/NAS/issues

Vladislav

Vladislav

Спасибо прочитал, но там нету про мой случай ничего

В смысле? Это не читать надо, а писать там

Dexex

Dexex

Мда, какая интересная проблема, мне чёт стало аж не по себе.

Поделюсь странной проблемой, которая недавно возникла.

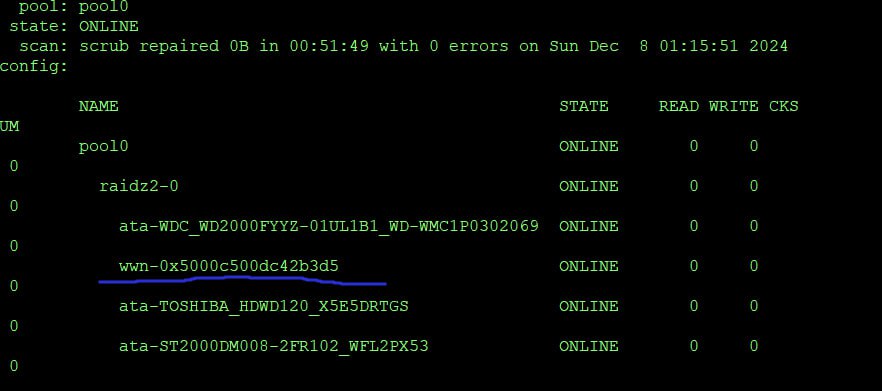

Создан обычный raidz2 массив. Все нормально работало.

Как то после перезагрузки один диск стал failted.

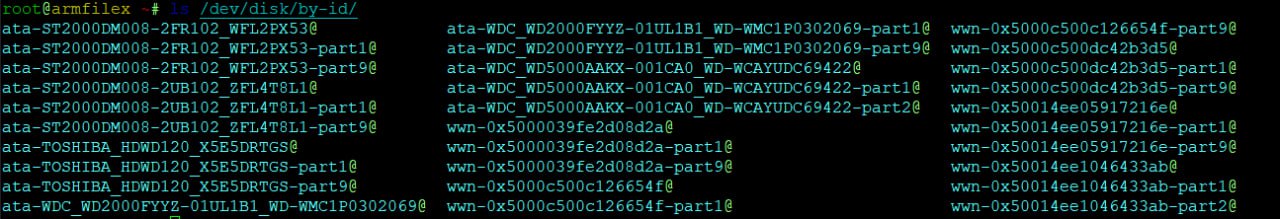

Долго копал и не мог понять. Суть в том, что один диск был добавлен в массив по букве как я понял, сделал detach и replace этого диска, ну тупо подключил его назад по uid и начался resilver.

Диск стал видится как wикучацифр. Но всё работает.

Dexex

Dexex

Постоянный страх с массивами делать их по буквам, потому что часто они могу между собой меняться почему то. Как я понимаю не находить нужный диск на нужном месте. По иду поэтому буду в дальнейшем любые массивы создавать. Очень странно. У меня на гипервизоре одном постоянно диски между собой путаются при перезагрузке, zfs не умеет почему то их различать.

Konstantin

Konstantin

Александр

Александр

Постоянный страх с массивами делать их по буквам, потому что часто они могу между собой меняться почему то. Как я понимаю не находить нужный диск на нужном месте. По иду поэтому буду в дальнейшем любые массивы создавать. Очень странно. У меня на гипервизоре одном постоянно диски между собой путаются при перезагрузке, zfs не умеет почему то их различать.

По id-ам, разумеется. Я не понимаю, как можно запутать zfs

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

Постоянный страх с массивами делать их по буквам, потому что часто они могу между собой меняться почему то. Как я понимаю не находить нужный диск на нужном месте. По иду поэтому буду в дальнейшем любые массивы создавать. Очень странно. У меня на гипервизоре одном постоянно диски между собой путаются при перезагрузке, zfs не умеет почему то их различать.

Ради тестов менял местами (порты) диски в raidz2 и оно само всё нормально поняло что где

Konstantin

Konstantin

Ради тестов менял местами (порты) диски в raidz2 и оно само всё нормально поняло что где

проверяли id или devname ?

Dexex

Dexex

Ради тестов менял местами (порты) диски в raidz2 и оно само всё нормально поняло что где

Было такое. Менял. Потом все равно запутывалось. В зависимости не понятно от чего диски могут путаться. Причем это даже опасно. Потому что может быть даже еще хуже, могут все буквы съехать. Я не знаю почему zfs не умеет диски сопостовлять.

Dexex

Dexex

Вот так и должно быть и это правильно

То есть до этого диск был с именем устройства в статусе как остальные. А потом он failted ушел, и я его детачил и replace по uid делал

Dexex

Dexex

Да вот именно, что по буквам это вообще не понятный рандом как он конкретно их цепляет не понятно. По wwn получается самое надежное.

Dexex

Dexex

Особенно когда два контроллера на плате стоит. Один в материнке, второй в pcie например. Вот у меня путаница возникает, они летают по шинам после перезагрузки

Konstantin

Konstantin

ata-* уникален только в контексте данной системы и может зависеть от способа подключения устройства.

wwn-* гарантированно уникален для каждого устройства в мире, благодаря стандартизации WWN.

Dexex

Dexex

Вот такие нежданичики дико напрягают. Менять диск, когда он абсолютно рабочий по сути, если не проверять

Δαρθ

Δαρθ

Konstantin

Konstantin

На моей памяти мне ниразу не приходилось лазить в правила вдева для дисков, сетевушки - да

жюн

жюн

Утро!

я как-то в доке таблицу видел, по скоростям raidz, страйпов и т.п., но сейчас что-то найти не могу

подкиньте, пожалуйста

Ivan

Ivan

Коллеги, подскажите, у кого может уже был опыт использования и сборки массива на nvme дисках.

Есть в наличии 8 хороших nvme дисков enterprise уровня.

Планирую собрать один vdev raidz2 на них. Также будет 1 Тб оперативы. Вопрос в следующем, может есть какие важные нюансы при создании и исполнении nvme дисков, на что стоит обратить внимание? Стоит ли делать отдельными девайсами ZIL или SLOG в данном случае? Возможно есть какие-то вещи, которые стоит проделать, дабы меньше изнашивать диски, и тем самым им продлить жизнь. В общем, вопрос из серии, поделитесь живым опытом. Спасибо

Dexex

Dexex

Коллеги, подскажите, у кого может уже был опыт использования и сборки массива на nvme дисках.

Есть в наличии 8 хороших nvme дисков enterprise уровня.

Планирую собрать один vdev raidz2 на них. Также будет 1 Тб оперативы. Вопрос в следующем, может есть какие важные нюансы при создании и исполнении nvme дисков, на что стоит обратить внимание? Стоит ли делать отдельными девайсами ZIL или SLOG в данном случае? Возможно есть какие-то вещи, которые стоит проделать, дабы меньше изнашивать диски, и тем самым им продлить жизнь. В общем, вопрос из серии, поделитесь живым опытом. Спасибо

Я не думаю, что на таких дисках это требуется. У них внутренние механизмы есть и все в них заложено. Просто создавайте массив и пользуйтесь.

Vladislav

Vladislav

Ivan

Ivan

Вот Вы и поделитесь с сообществом как оно

Так с удовольствием, как соберу и поработаю с ним. До этого не было опыта сборки на nvme. Пока делиться нечем)

Vladislav

Vladislav

А заодно опишите:

- Блочный доступ? Файловый?

- Паттерн нагрузки - vdi, веб, БД, иное (read/write %)

- Куда это будет выдаваться (конечные пользователи/виртуализация)

И т.д.

Ivan

Ivan

А заодно опишите:

- Блочный доступ? Файловый?

- Паттерн нагрузки - vdi, веб, БД, иное (read/write %)

- Куда это будет выдаваться (конечные пользователи/виртуализация)

И т.д.

Попробую. Вообще хранилище будет создаваться для хранения больших файлов как правило 30+ мб и до сотен мегов. В основном файлы картинок и видео. Количество одновременных пользователей порядка 40.

Vladislav

Vladislav

Попробую. Вообще хранилище будет создаваться для хранения больших файлов как правило 30+ мб и до сотен мегов. В основном файлы картинок и видео. Количество одновременных пользователей порядка 40.

Не уверен, что при таких нагрузках в nvme массиве много смысла, но рекомендую поставить это все дело на мониторинг

- нагрузка на канал

- нагрузка на vdev

- время отклика дисков

Vladislav

Vladislav

Vladislav

Vladislav

И перед тем как это пускать в прод взять 5-8 машинок клиентов и сделать что-то подобное

https://github.com/jdkruzr/test-networkspeed

Ivan

Ivan

Не уверен, что при таких нагрузках в nvme массиве много смысла, но рекомендую поставить это все дело на мониторинг

- нагрузка на канал

- нагрузка на vdev

- время отклика дисков

А почему? Это низкая нагрузка или наоборот высокая. Дело в том, что с этого хранилища постоянно будут работать пользователи, и переход на такой вариант сподвиг меня именно опыт работы на обычном нашем хранилище из 12ти обычных hdd, но там правда 6 vdev в mirror. Так вот пользователи ощущают периодически фризы программ временами. И наблюдение показало, что судя по всему дисковая подсистема не справляется с потоком запросов.

Fedor

Fedor