Fedor

Fedor

Алексей

Алексей

я проверил типа уберблоки (насколько я понял можно откатиться на один из предыдущих) там в списке все уберблоки с меткой времени уже после ребута

Алексей

Алексей

но там было проще, файлы в другом датасете не показывались (якобы пусто) но сам датасет имел вес. ну я так понял что надо отмонтировать и примонтировать и всё будет ок подобные глюки ловил не раз

просто решил ребутнуть поскольку это было проще

Алексей

Алексей

но там было проще, файлы в другом датасете не показывались (якобы пусто) но сам датасет имел вес. ну я так понял что надо отмонтировать и примонтировать и всё будет ок подобные глюки ловил не раз

просто решил ребутнуть поскольку это было проще

как и предполагалось, после ребута этот глюк ушел, и файлы в этом датасете появились. но вот исчезли в другом датасете....

Алексей

Алексей

да

неделю назад было создано 4 датасета (в один момент) и два последних после ребута обунлились

Fedor

Fedor

если получится раскопать, напиши, плз. может, ребята тут ещё подскажут, как найти старые блоки

Алексей

Алексей

ну да, тут как бы я уже простился с этими файлами.

просто интересно поковыряться попробовать

Vladislav

Vladislav

По виду это очень похоже, что файлы писались в пустоту, у меня такое было, когда я убил пул лежащий под этим датасетом....

Вообще.... Хм, первая мысль действительно, что по тому пути где писались файлы сейчас лежит не тот пул

Vladislav

Vladislav

Ребята, всем привет, прошу помощи!

после перезагрузки сервера из датасета исчезли все данные.

датасет на месте, а файлов нет.

ума не приложу как это вообще могло произойти, что можно сделать по горячим следам, куда можно/нужно посмотреть?

Проверь zfs umount /<путь>

И ls -lah /<путь>

Alisa

Alisa

Можете подсказать как корректно средствами zfs создать массив 2N+2, т.е. RAID10 и 2 диска резервных активных (желательно как парити). Про вариант один на один и так в курсе - но это не совсем корректно.

Алексей

Алексей

Alexey

Alexey

Можете подсказать как корректно средствами zfs создать массив 2N+2, т.е. RAID10 и 2 диска резервных активных (желательно как парити). Про вариант один на один и так в курсе - но это не совсем корректно.

zpool create -o ashift=12 tank mirror /dev/disk/by-id/[disk1] /dev/disk/by-id/[disk2] mirror /dev/disk/by-id/[disk3] /dev/disk/by-id/[disk4] spare /dev/disk/by-id/[disk5] /dev/disk/by-id/[disk6]

но лучше такой тип пулов не создавать.

Alexey

Alexey

https://translated.turbopages.org/proxy_u/en-ru.ru.37850fbe-675fc8f1-a9c9f742-74722d776562/https/docs.oracle.com/cd/E18752_01/html/819-5461/gayrd.html

Alisa

Alisa

zpool create -o ashift=12 tank mirror /dev/disk/by-id/[disk1] /dev/disk/by-id/[disk2] mirror /dev/disk/by-id/[disk3] /dev/disk/by-id/[disk4] spare /dev/disk/by-id/[disk5] /dev/disk/by-id/[disk6]

но лучше такой тип пулов не создавать.

Будут ли spare автоматически использоваться при потере какого-то из зеркальных дисков или надо будет вручную делать? (речь при такой конфигурации)

Если например добавить autoreplace=on?

Nikita

Nikita

Будут ли spare автоматически использоваться при потере какого-то из зеркальных дисков или надо будет вручную делать? (речь при такой конфигурации)

Если например добавить autoreplace=on?

Во FreeBSD раньше для этого нужно было включать zfsd_enable. Опыты на тестовом массиве дадут точные и актуальные для вашей системы ответы.

Алексей

Алексей

Алексей

Алексей

А что было? Что случилось?

Писалось мимо датасета прям в пул. А после ребута датасет смонтировался поверх данных

Станислав

Станислав

Писалось мимо датасета прям в пул. А после ребута датасет смонтировался поверх данных

Ох и веселье. Кстати, уже всплывала подобная история в чате. Когда новый датасет отображался как примонтированный, а по факту данные не туда улетали

Алексей

Алексей

Ох и веселье. Кстати, уже всплывала подобная история в чате. Когда новый датасет отображался как примонтированный, а по факту данные не туда улетали

Да не то слово, но хорошо что закончилось хорошо

Khajiit

Khajiit

Опыт — штука такая, он приходит сразу после того, как был нужен…

Собственно, почему я делаю chattr +i на каждый mountpoint

Александр

Александр

Писалось мимо датасета прям в пул. А после ребута датасет смонтировался поверх данных

А, красивый вариант)) Но по zfs list -s used можно догадаться о многом

Алексей

Алексей

А, красивый вариант)) Но по zfs list -s used можно догадаться о многом

да ну я как бы видел после ребута что used 96K

Александр

Александр

да ну я как бы видел после ребута что used 96K

Т.е. по объему понятно, что данные не пропали. Остается, как обычно, пустяк, сообразить, где...

Алексей

Алексей

Т.е. по объему понятно, что данные не пропали. Остается, как обычно, пустяк, сообразить, где...

непонятно т.к. я не знал сколько там точно данных, но хотя конечно мог бы сообразить по разнице суммы юзеда в датасетах с юзедом в пуле , но считать было лень уже ночью

Vladislav

Vladislav

В процессе когда ты видишь пустую папку - не всегда есть возможность сходу общую картину увидеть

Mikhail

Mikhail

Ivan

Ivan

Ivan

Ivan

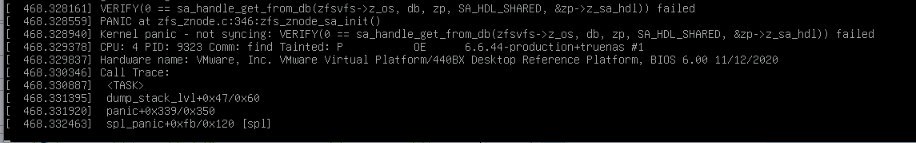

Но на реплике на железке тоже самое

https://forums.truenas.com/t/truenas-nfs-random-crash/9200/28