Vladislav

Vladislav

🦊 Лиса

🦊 Лиса

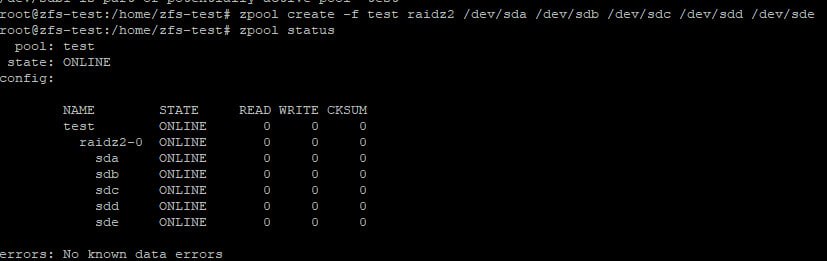

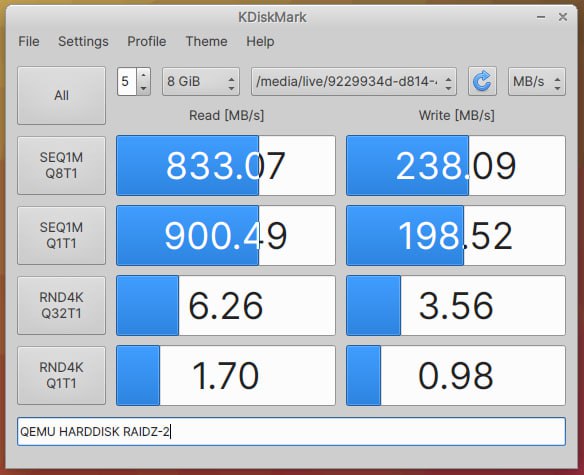

вот такая картина была перед выниманием шестого

pool: tank

state: DEGRADED

status: One or more devices has experienced an unrecoverable error. An

attempt was made to correct the error. Applications are unaffected.

action: Determine if the device needs to be replaced, and clear the errors

using 'zpool clear' or replace the device with 'zpool replace'.

see: https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-9P

scan: resilvered 192K in 00:00:01 with 0 errors on Fri Nov 29 20:08:30 2024

config:

NAME STATE READ WRITE CKSUM

tank DEGRADED 0 0 0

raidz2-0 DEGRADED 0 0 0

virtio-tank1 OFFLINE 0 0 0

virtio-tank2 ONLINE 0 0 0

virtio-tank3 DEGRADED 0 0 0 external device fault

virtio-tank4 OFFLINE 0 0 0

virtio-tank5 DEGRADED 0 0 0 too many errors

virtio-tank6 DEGRADED 0 0 0 too many errors

errors: No known data errors

🦊 Лиса

🦊 Лиса

🦊 Лиса

🦊 Лиса

zpool offline tank virtio-tank1

zpool offline tank virtio-tank4

zpool offline -f tank virtio-tank5

zpool offline -f tank virtio-tank3

zpool offline -f tank virtio-tank6

то есть вот такой ход действий был таки

🦊 Лиса

🦊 Лиса

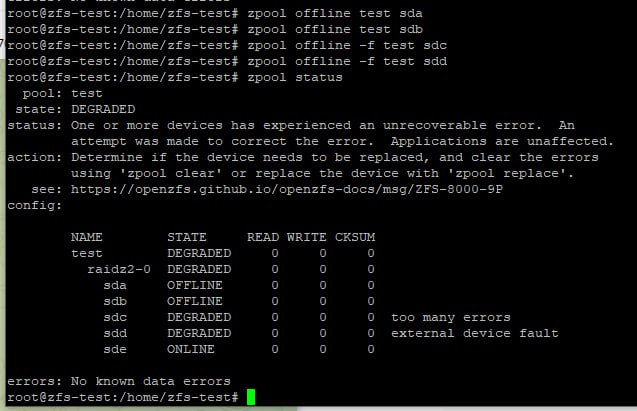

91 sudo zpool offline tank virtio-tank4

93 sudo zpool offline tank virtio-tank1

95 sudo rm /tank/filler

96 sudo dd if=/dev/urandom of=/tank/filler bs=8M

98 sudo zpool online tank virtio-tank4

101 sudo zpool offline tank virtio-tank4

103 sudo zpool online tank virtio-tank4

106 sudo zpool offline tank virtio-tank4

107 sudo zpool offline tank virtio-tank5 // не дал

108 sudo zpool offline tank virtio-tank5 -f

118 sudo zpool offline tank virtio-tank6 -f

121 sudo zpool offline tank virtio-tank3 -f

124 sudo rm /tank/filler

125 sudo dd if=/dev/urandom of=/tank/filler bs=8M

здесь отключаю tank6, пул переходит в SUSPENDED, dd повисает в ядре

147 sudo zpool online tank virtio-tank1 // не дает, пишет чето про io suspended

150 sudo zpool clear tank virtio-tank5 // повисает в ядре

156 sudo zpool clear -nFX tank virtio-tank4 // повисает в ядре

смотрю sudo cat /proc/11427/stack, там видно что он (zpool clear) висит в ioctl

ребутаюсь

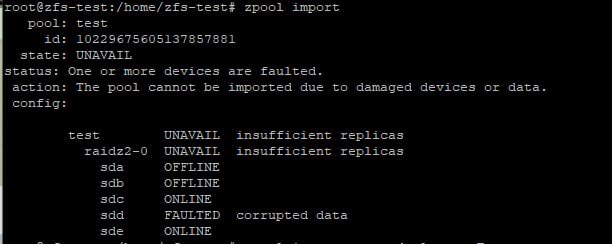

после этого я не могу импортировать пул

вот точный полный список действий

Vladislav

Vladislav

Во-первых, с этим можно пойти открыть issue

Во-вторых, либо надо смотреть как через sdb почистить статус диска, либо заняться пересозданием пула

🦊 Лиса

🦊 Лиса

ну что issue открывать надо, это понятно

мне изначально больше интересен способ вывода диска из offline без импорта пула, мало ли кто занимался таким

Vladislav

Vladislav

всмысле?

Ну, чтобы перевести устройство из offline тебе нужен активный пул, но чтобы получить активный пул тебе нужно чтобы девайс был онлайн

🦊 Лиса

🦊 Лиса

Vladislav

Vladislav

В обычно ситуации - если у тебя прям умерло 4 диска в raidz-2 - то это ГГ, типо, offline обычно не делается на живые диски, а если и делается, то у них будет слишком большое расхождение по txg, чтобы их можно было бы использовать

🦊 Лиса

🦊 Лиса

В обычно ситуации - если у тебя прям умерло 4 диска в raidz-2 - то это ГГ, типо, offline обычно не делается на живые диски, а если и делается, то у них будет слишком большое расхождение по txg, чтобы их можно было бы использовать

не, у меня было 2 диска в офлайне, третий бы он не дал

после этого я отключаю "физически" третий диск, и пул почти моментально становится suspended

по этому по идее все должно быть ок

Vladislav

Vladislav

ну и три диска были faulted, да

но пул при этом был живой

Это потому что он в память пишет

🦊 Лиса

🦊 Лиса

ну и три диска были faulted, да

но пул при этом был живой

и он писал что applications unaffected

🦊 Лиса

🦊 Лиса

pool: tank

state: DEGRADED

status: One or more devices has experienced an unrecoverable error. An

attempt was made to correct the error. Applications are unaffected.

action: Determine if the device needs to be replaced, and clear the errors

using 'zpool clear' or replace the device with 'zpool replace'.

see: https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-9P

scan: resilvered 192K in 00:00:01 with 0 errors on Fri Nov 29 20:08:30 2024

config:

NAME STATE READ WRITE CKSUM

tank DEGRADED 0 0 0

raidz2-0 DEGRADED 0 0 0

virtio-tank1 OFFLINE 0 0 0

virtio-tank2 ONLINE 0 0 0

virtio-tank3 ONLINE 0 0 0

virtio-tank4 OFFLINE 0 0 0

virtio-tank5 DEGRADED 0 0 0 external device fault

virtio-tank6 ONLINE 0 0 0

errors: No known data errors

George

George

перевели монументальную статью о дедупе в ZFS, и как он изменится в релизе 2.3 https://habr.com/ru/companies/vk/articles/863904/

Maksim

Maksim

ArtAnt

ArtAnt

перевели монументальную статью о дедупе в ZFS, и как он изменится в релизе 2.3 https://habr.com/ru/companies/vk/articles/863904/

Название как бы намекает, читать смысла нет, все равно использовать не стоит?

George

George

Название как бы намекает, читать смысла нет, все равно использовать не стоит?

разбор в статье, приключение на 30 минут :)

Vladislav

Vladislav

а direct io разве не решает эту задачу?

Спорно. Работает только для zfs mountpoint, zvol не поддерживается

Nikita

Nikita

Спорно. Работает только для zfs mountpoint, zvol не поддерживается

ну да, вспомнил... но direct io для zvol "in development", так что остаётся ждать, пока мимо проплывут трупы врагов. или поучаствовать))

Vladislav

Vladislav

Slach

Slach

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

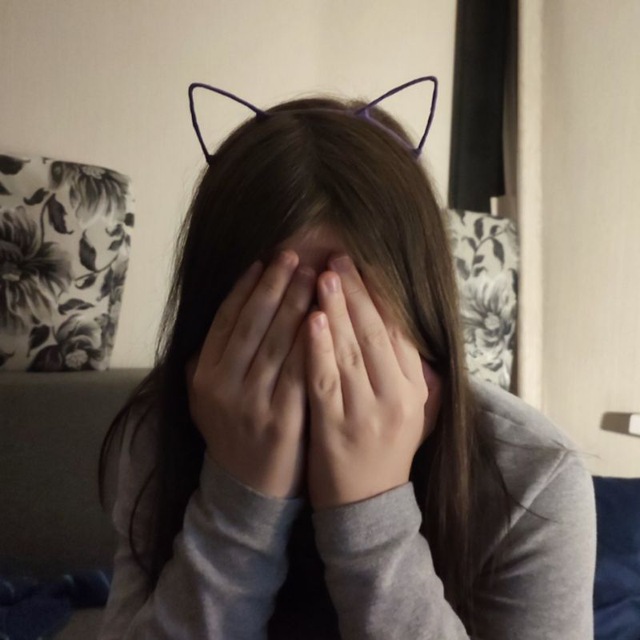

ну read вроде норм

https://storage.toshiba.com/docs/enterprise-hdd-documents/ehdd-mg08-d-product-overview_rev0s.pdf

а write выглядит как будто не распаралелился...

random на SATA HDD всегда убогие к сожалению...

Zfs зеркало собрал, на этих ж дисках, цифры плюс минус такие же

Slach

Slach

Zfs зеркало собрал, на этих ж дисках, цифры плюс минус такие же

а если без ZFS и Raid контроллера просто ext4 mdadm raid10?

Slach

Slach

Это вот не пробовал

ну просто узкое место либо raid контроллер, либо SATA

либо файловая система...

непонятно как у вас RAIDZ он поверх raid контроллера работает? или все таки отдельно напрямую с дисками через JBOD?

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

Alexey

Alexey

Не рекомендуется использовать zfs поверх raid массивов: аппаратных или программных. Это приводит к резкому падению производительности. В raidz должны входить непосредственно блочные устройства - диски. Переведите контроллер в HBA режим.

Илья

Илья

ну read вроде норм

https://storage.toshiba.com/docs/enterprise-hdd-documents/ehdd-mg08-d-product-overview_rev0s.pdf

а write выглядит как будто не распаралелился...

random на SATA HDD всегда убогие к сожалению...

Так и должно быть, iops на запись одного vdev равно iops одного диска

Алексей

Алексей

Ребята, всем привет, прошу помощи!

после перезагрузки сервера из датасета исчезли все данные.

датасет на месте, а файлов нет.

ума не приложу как это вообще могло произойти, что можно сделать по горячим следам, куда можно/нужно посмотреть?

Fedor

Fedor

все уберблоки которые есть в пуле уже послеребутные, такое ощущение что до ребута их нет

в хистори что написано?

Roman

Roman