До reboot?

Да

Rodion

Rodion

Vladislav

Vladislav

[Service]

Type=notify

# the specific user that our service will run as

User=user_svc

Group=user_svc

Хм а если кроном запустить

1 1 * * * su username -c "/path/to/your/script.sh"

?

Rodion

Rodion

Хм а если кроном запустить

1 1 * * * su username -c "/path/to/your/script.sh"

?

Вот это какая-то непонятная заморочка получится. У меня таже проблема на AstraLinux, но там я грешил на его своеобразные права и т.д.

Vladislav

Vladislav

Извиняюсь, не догоняю: чего нет: пакета zfs, датапула, или ещё чегото?

Не делать маунт zfs в эту папку

Rodion

Rodion

Не делать маунт zfs в эту папку

В смысле "маунт zfs"?

Rodion

Rodion

Не делать маунт zfs в эту папку

сейчас так

sudo /sbin/zfs create datapool/yeyrrgqn

sudo mkdir /opt/datapool/yeyrrgqn/pg_data

sudo chown user_svc:user_svc /opt/datapool/yeyrrgqn/pg_data

scp by paramico from service

А тут из bash уже ничего не видно.

Vladislav

Vladislav

Rodion

Rodion

То же самое, но без zfs create

то есть сделать не zfs create, а просто mkdir ? сейчас проверим...

Vladislav

Vladislav

то есть сделать не zfs create, а просто mkdir ? сейчас проверим...

Да, не создавать пул zfs

Rodion

Rodion

Да, не создавать пул zfs

убрал zfs create, добавил -p в mkdir?, чтобы сразу весь путь создавал - опять ничего не видно :(

Vladislav

Vladislav

убрал zfs create, добавил -p в mkdir?, чтобы сразу весь путь создавал - опять ничего не видно :(

Тогда проблема в скрипте демона

Fedor

Fedor

Georg🎞️🎥

Georg🎞️🎥

Fedor

Fedor

Fedor

Fedor

В канале proxmox особенные?

судя по контексту вопроса, там была блокировка диска на уровне сторадж лока самого пве

Ivan

Ivan

Други, помогите советом. Я перерыл весь инет, но рабочего решения так и не нашел. Причем даже сам поиск решения в инете выдает настолько скудные результаты, что возникает впечатление, что 1) с этим мало кто сталкивался и это не особо людям мешает, 2) решить проблему нельзя.

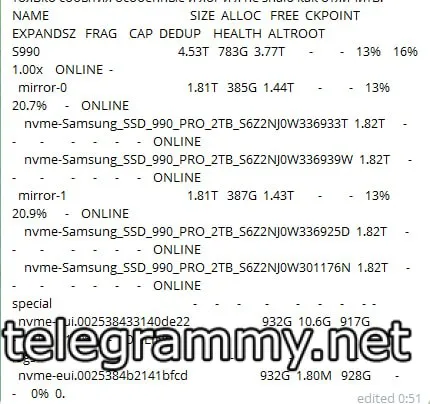

Дело вот в чем. Имеется пул на сервере, в пуле много датасетов, и сабсетов. Пул расшарен по NFS. Причем, я пробовал шарить как средствами ZFS, так и средствами самого NFS.

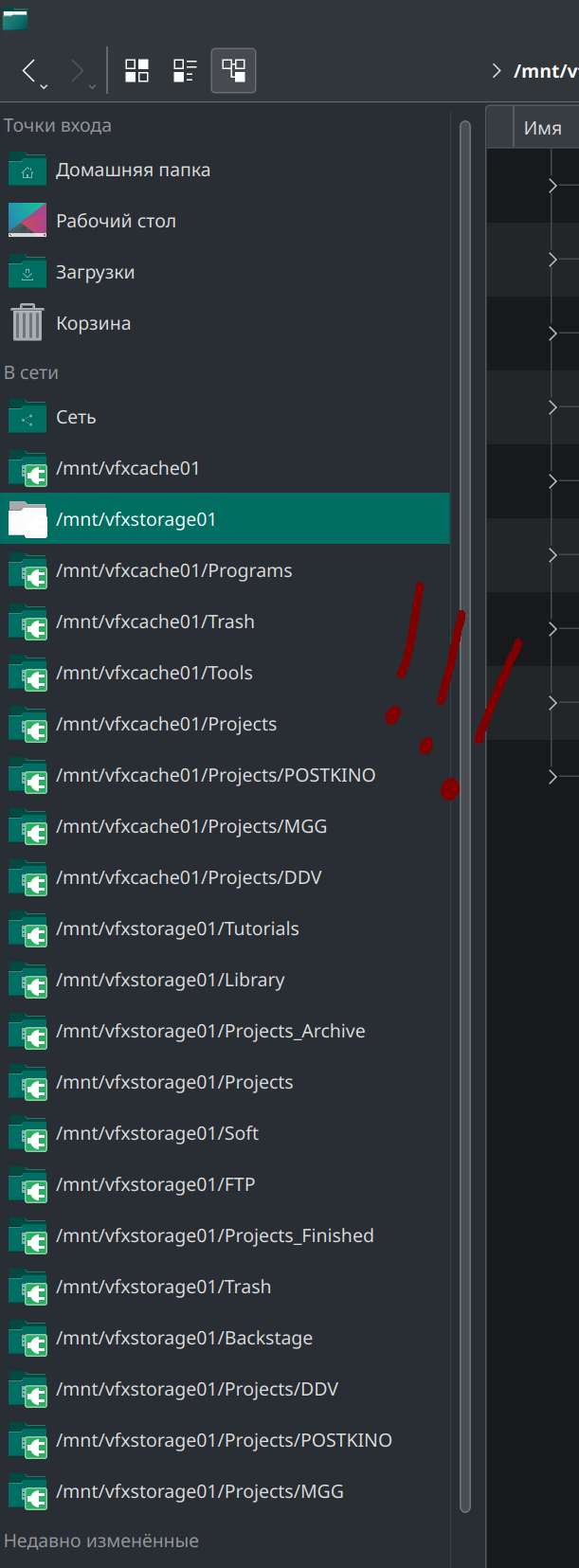

Когда клиент монтирует на своей машине головной пул, то автоматом монтируются и все датасеты и субдатасеты, как отдельные шары. В принципе нормальная ситуация, как и должно быть. Но проблема в том, что когда клиенты начинают использовать KDE Dolphin для работы с папками на серваке, то левая панель становиться просто вся забита отдельными шарами на каждый датасет. Это не смертельно, конечно, но весьма неудобно для пользователей.

Вопрос, можно ли как-то монтировать только головной пул на клиенте, но при этом получить доступ ко всем вложенным датасетам?

Раньше до использования ZFS на серверах, клиенты монтировали просто головную папку на серваке и все. Щас делают то же самое, но за монтированием головного пула автоматом все датасеты тоже монтируются, как отдельные шары.

Понимаю, что вопрос не совсем напрямую касается ZFS, но я думаю, что лучше спросить именно пользователей ZFS, потому что наверняка они сталкивались с этим и больше вероятность, что было какое-то найдено решение.

Vladislav

Vladislav

Ivan

Ivan

Вообще это не первая моя попытка решить эту проблему, первые пару не дали результатов. Щас просто появилось время вернуться к проблеме.

Итак, первое что я попробовал средствами ZFS оставить расшаренной только головной пул, а остальные датасеты отключить шаринг. Результата это не дало. На машинах клиентах, не смотря на то, что по команде showmount -e serverIP выдавалась только одна шара, при монтировании пула, монтировались как отдельные шары и все датасеты.

Второе, что я попробовал это отключить шаринг силами ZFS и установить шаринг пула через /etc/exports силами самого NFS. Результат ровно такой же.

Дальнейшие попытки были связаны с различной игрой с параметрами монтирования в /etc/exports, в частности убирал crossmnt, что приводило к нужному результату в dolphin, но тогда все папки датасетов были пустые. И т.д. hide, nohide, монтирование по NFSv3, v4. Результат тот же.

Это текущие настройки /etc/exports

/mnt/vfxcache01 192.168.20.0/24(sync,wdelay,hide,crossmnt,no_subtree_check,mountpoint,anonuid=1000,anongid=1000,sec=sys,rw,secure,root_squash,all_squash)

Ivan

Ivan

Касательно запросов гугла по которым искал ответы, если честно уже сбился с вариантов, но все плюс минус выводят на одни и те же статьи, где решения нет. Начинал с "how to avoid nfs to mount each zfs dataset as separate share" и т.д. в разных вариациях

Ivan

Ivan

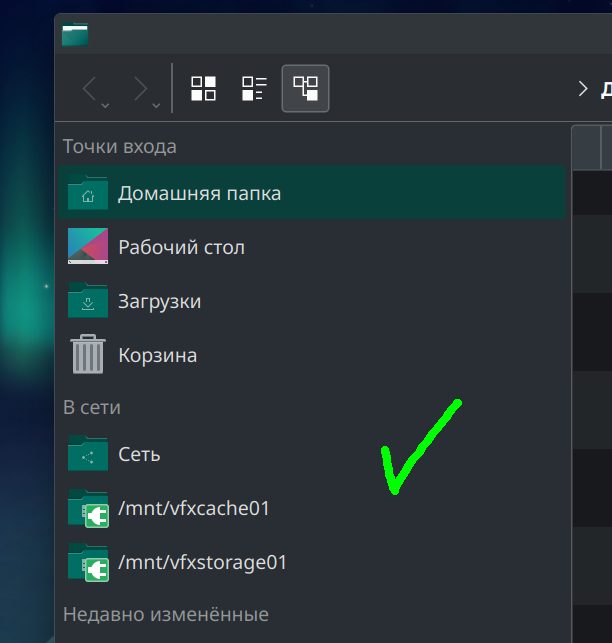

Щас пробую найти варианты может как в Dolphin ограничить в настройках, или как замаскировать отображение подмонтированных ресурсов, фиг знает. Я если честно, уже, как мне кажется начал искать экзотические решения, т.к. силами NFS и ZFS я это решить не смог

Δαρθ

Δαρθ

это же фишка зфс -- каждый датасет и поддатасет -- отдельные маунтпоинты на хосте. НФС по каким-то соображениям это реплицирует.

Сергей

Сергей

Щас пробую найти варианты может как в Dolphin ограничить в настройках, или как замаскировать отображение подмонтированных ресурсов, фиг знает. Я если честно, уже, как мне кажется начал искать экзотические решения, т.к. силами NFS и ZFS я это решить не смог

Вы не сможете перейти границу точек монтирования разных файловых систем в NFS. Samba запустите. Или поищите userspace NFS решение. Любой процесс, работающий не в ядре.

Vladislav

Vladislav

Ivan

Ivan

Ну твой вопрос находится в Гугле от декабря да

Я и до этого пытался найти решение, пока безуспешно. Юзеры просто жалуются что это слегка мешает. Как я уже сказал, это не смертельно, но решить конечно хочется как-то

Vladislav

Vladislav

Ivan

Ivan

Ivan

Ivan

Но даже если бы в Xfce было бы решение, то я бы не смог перевести всех юзеров на него. Все привыкли к KDE

Vladislav

Vladislav

Но даже если бы в Xfce было бы решение, то я бы не смог перевести всех юзеров на него. Все привыкли к KDE

Да, но это один из методов тестирования где кроется возможное решение

Ivan

Ivan

Просто интересно, а если представить себе, что на серваке сотни датасетов, и сабсетов, а такое наверняка есть у кого-то, там тогда Dolphin бы просто повис бы )).

Есть конечно, одно решение, это просто убрать из Dolphin вкладку Network, и сделать закладки на основные папки. Но блин, немного костыльное, как мне кажется решение.

Игорь

Игорь

Δαρθ

Δαρθ

Ivan

Ivan

Можете подробнее расписать? Изменения конфигов, установка свойств датасетов - что именно делалось?

Можете подробнее расписать? Изменения конфигов, установка свойств датасетов - что именно делалось?

Ну собственно я уже писал, что я делал. Попробую еще раз. Просто не вижу смысла писать конкретные команды и конфиги, т.к. тут просто будет в чате огромная партянка из текста.

Как я уже писал выше.

1) Пробовал расшарить только головной пул. Т.е. делал zfs set sharenfs=on <pool>, а на все датасеты снимал шаринг, т.к. параметры шаринга наследуются.

2) Пробовал отключить харинг силами ZFS полностью. И настроить настроить его чисто через /etc/exports. Параметры стандартные 192.168.20.0/24(sync,wdelay,hide,crossmnt,no_subtree_check,mountpoint,anonuid=1000,anongid=1000,sec=sys,rw,secure,root_squash,all_squash)

В итоге в обоих случаях, если посмотреть exportfs -v на серваке, то выдавалась одна папка - сам пул, а на клиенте если посмотреть showmount -e server, то он тоже видел одну папку. Но как только монтируется пул на клиенте, сразу автоматом монтируются и все датасеты, как отдельные устройства. Откуда клиент узнает о датасетах как отдельных устройствах, фиг знает.

И далее я уже игрался с параметрами монтирования и шаринга, типо crossmnt, hide, nohide, шаринг и монтирование nfsv3 и nfsv4. Результат тот же.

Ivan

Ivan

думаю с этого надо начать

Дело в том, что я не думаю что это проблема Dolphin. Потому что если подмонтировать пул, а потом посмотреть вывод команды mount | grep nfs. То увидим отдельный маунт на каждый датасет. А долпхин просто это тоже видит и отдельными устройствами отображает.

Δαρθ

Δαρθ

Дело в том, что я не думаю что это проблема Dolphin. Потому что если подмонтировать пул, а потом посмотреть вывод команды mount | grep nfs. То увидим отдельный маунт на каждый датасет. А долпхин просто это тоже видит и отдельными устройствами отображает.

man exports, читать про nohide

это фишка нфс и никуда от нее не деться. и фишка зфс, аналогично

Ivan

Ivan

man exports, читать про nohide

это фишка нфс и никуда от нее не деться. и фишка зфс, аналогично

Пробовал и crossmnt и hide и nohide, и в разных комбинациях их. Все одинаково. Разве что ,если убрать из парамметров crossmnt, то да смонтируется пул и папки датасетов, но они будут пустые, а если проверить mount | grep nfs то да будет один маунт на сам пул. Но как вы понимаете, это не решение ))

Δαρθ

Δαρθ

Пробовал и crossmnt и hide и nohide, и в разных комбинациях их. Все одинаково. Разве что ,если убрать из парамметров crossmnt, то да смонтируется пул и папки датасетов, но они будут пустые, а если проверить mount | grep nfs то да будет один маунт на сам пул. Но как вы понимаете, это не решение ))

я имел в виду прочитать и понять что подругому не сделать

Vladislav

Vladislav

Δαρθ

Δαρθ

А вот тем временем у меня опять на реплике в снапшоте какие-то файлы занулились, а другие и вовсе стали другого содержимого. Это как. в порядке вещей?

передаю так: 2.2.2-r1 -> 2.1.7 -> 2.1.1

Я конечно пока ещё чекаю хеши файлов чтоб узнать где попортилось, но всё же, какой-то из пулов заражён и его токо грохать?

Ivan

Ivan

А вот тем временем у меня опять на реплике в снапшоте какие-то файлы занулились, а другие и вовсе стали другого содержимого. Это как. в порядке вещей?

передаю так: 2.2.2-r1 -> 2.1.7 -> 2.1.1

Я конечно пока ещё чекаю хеши файлов чтоб узнать где попортилось, но всё же, какой-то из пулов заражён и его токо грохать?

Это в продолжение https://t.me/ru_zfs/69354

Roman

Roman

Group Butler

Group Butler