СПАСИБО СПАСИБО СПАСИБО 🙏🙏🙏🙏

Пожалуйста)))

Denis

Denis

Приветствую, нужна помощь. Переустановил на сервере debian с 11 на 12 и столкнулся с проблемой. Посреди ночи примерно раз в 2-3 дня без каких либо видимых причин одно ядро на процессоре застревает в 100% iowait. Дисковой нагрузки нет, сами диски целые, в dmesg пусто. Из подозреваемых либо ядро, либо модуль zfs. Изначально и то и другое ставил из backports - ядро 6.5.10 и zfs 2.2.2. На багтрекере пишут, что с ядрами 6.4 была регрессия, которую пофиксили в 6.4.8 и 6.5.0-rc4 (https://bugzilla.kernel.org/show_bug.cgi?id=217699). Однако у меня проблема возникает и с более новым ядром и после возврата на штатное 6.1. В связи с этим вопрос, может не ядро виновато? Кто-нибудь сталкивался с подобным в zfs 2.2.2? Куда ещё копать?

Если кому интересно, zfs оказалась не виновата. Это баг в ядре. Обе версии в репозиториях debian оказались ему подвержены. Скомпилировал 6.6.14 из гита, третий день полёт нормальный. Возможно, что помогло бы отключение io_uring на виртуалках.

Александр🇷🇺

Александр🇷🇺

Ivan

Ivan

Vladislav

Vladislav

Denis

Denis

в новых ядрах поменялось понятие iowait

А что именно поменялось? По ссылке не нашел конкретики.

Denis

Denis

Это не баг, это фича

А, ну то есть подпрыгивающий от нуля до 100% посреди ночи на простаивающем сервере iowait, и остающийся на этом уровне до перезагрузки - это фича. Ну хорошо. 😁

Denis

Denis

https://t.me/vitastor/31878

Ну так по этим ссылкам как раз и есть описание бага. И пишут "Yes 6.4.8 has the fix and works fine now.". Проблема была в том, что в debian-е не fixed на ядре 6.5.

Что именно в рассчётах поменялось, ничего не написано. То, что это ожидание дисковой нагрузки, а не сама нагрузка и так понятно.

Ivan

Ivan

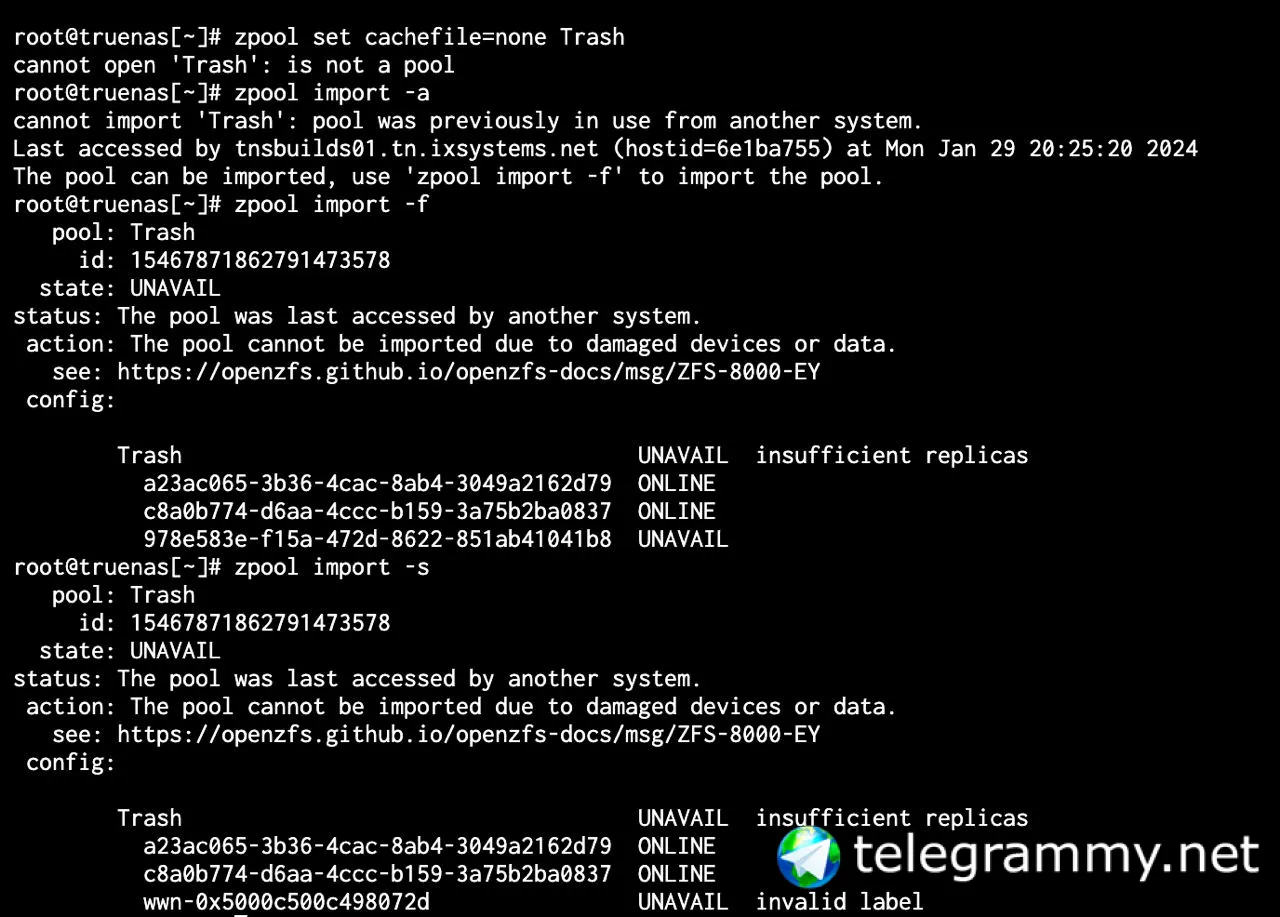

root@truenas[~]# zpool set cachefile=none Trash

cannot open 'Trash': is not a pool

root@truenas[~]# zpool import -a

cannot import 'Trash': pool was previously in use from another system.

Last accessed by tnsbuilds01.tn.ixsystems.net (hostid=6e1ba755) at Mon Jan 29 20:25:20 2024

The pool can be imported, use 'zpool import -f' to import the pool.

root@truenas[~]# zpool import -f

pool: Trash

id: 15467871862791473578

state: UNAVAIL

status: The pool was last accessed by another system.

action: The pool cannot be imported due to damaged devices or data.

see: https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-EY

config:

Trash UNAVAIL insufficient replicas

a23ac065-3b36-4cac-8ab4-3049a2162d79 ONLINE

c8a0b774-d6aa-4ccc-b159-3a75b2ba0837 ONLINE

978e583e-f15a-472d-8622-851ab41041b8 UNAVAIL

root@truenas[~]#

Vladislav

Vladislav

как оживить

Пока что все выглядит будто у Вас диск помер и как вариант сделать импорт ручками через zpool import -d <путь до дисков>

Sergey

Sergey

Всем привет! Пытаюсь перенести lxc контейнер работающий в zfs, на одиночный диск. Все это крутится в Проксе, не особо шарю в теме. Заранее благодарю за напутствия.

Fedor

Fedor

Всем привет! Пытаюсь перенести lxc контейнер работающий в zfs, на одиночный диск. Все это крутится в Проксе, не особо шарю в теме. Заранее благодарю за напутствия.

Привет, можно воспользоваться стандартным инструментарием прокса, сделать бекап, развернуть, проверить и переключить нагрузку. С зфс в этом варианте взаимодействовать не придётся.

Sergey

Sergey

Привет, можно воспользоваться стандартным инструментарием прокса, сделать бекап, развернуть, проверить и переключить нагрузку. С зфс в этом варианте взаимодействовать не придётся.

получается через бекап самый простой вариант. Я думмал, мож я чего не туда тыкаю, про бекап была мысль, но подумал было бы не плохо разобраться. Благодарю

Fedor

Fedor

получается через бекап самый простой вариант. Я думмал, мож я чего не туда тыкаю, про бекап была мысль, но подумал было бы не плохо разобраться. Благодарю

Управление зфс в случае с проксмоксом спрятано в его логике, ручные действия могут скорее повредить, чем помочь

max

max

Vladislav

Vladislav

Ну так по этим ссылкам как раз и есть описание бага. И пишут "Yes 6.4.8 has the fix and works fine now.". Проблема была в том, что в debian-е не fixed на ядре 6.5.

Что именно в рассчётах поменялось, ничего не написано. То, что это ожидание дисковой нагрузки, а не сама нагрузка и так понятно.

Там суть в io_uring и то что крутые ребята поменяли подсчет io_wait и включили туда статы от io_uring, только забыли сообщить тем кто пишет io_uring

instant

instant

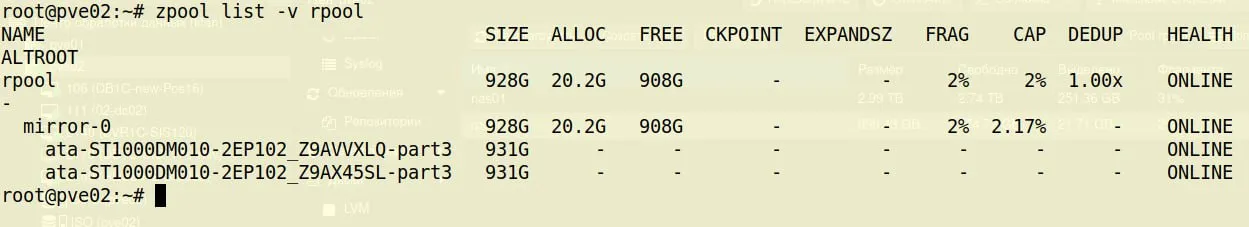

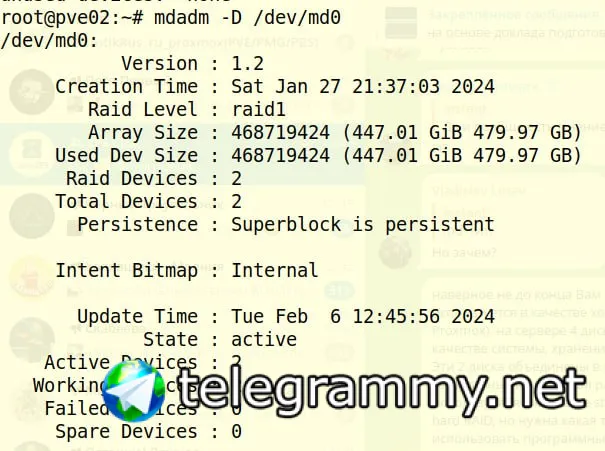

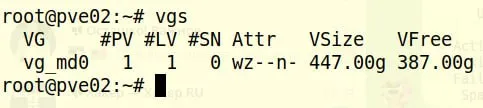

наверное не до конца Вам изложил вводные. Сервер используется в качестве хоста виртуализации ( установлен Proxmox). на сервере 4 диска. 2 из них шпиндель 7200 - в качестве системы, хранения iso образов и temp обраов для LXC. Эти 2 диска объединены в miror на zfs и являются загрузочными (как писал ранее) . Остальные 2 диска ssd intel, используются в качестве storage. Т.К. на данном сервере нет hard RAID, но нужна какая то отказоустойчивость, решил использовать программный miror RAID MD. LVM для удобства нарезания слоев для виртуальных машин. Вот, признался как на духу....

Group Butler

Group Butler

Roman

Roman

central

central

The Join Captcha Bot

The Join Captcha Bot

Vladislav

Vladislav

Алексей

Алексей