Free

Free

ща закончу эксперименты и солью их обратно, возможно даже номинально дороже

За почти бесплатно можешь мне слить, я тогда тоже экспериментатором стану 😉

Free

Free

Кот Матроскин

Кот Матроскин

Vladislav

Vladislav

Любая ФС превратится в какаху, если Вы ожидаете, что на 5400 дисках consumer like будет 99.9999% надёжности и не делаете бэкапов))))

Vladislav

Vladislav

Т.е. ZFS все таки какаха для надежности.

Особенно если диски имеют пометку - только для видеонаблюдени*

Кот Матроскин

Кот Матроскин

Кот Матроскин

Кот Матроскин

Особенно если диски имеют пометку - только для видеонаблюдени*

А что с ними не так?

В видеонаблюдениии можно битые блоки допускать?

Vladislav

Vladislav

Тем более эта серия слегка срановатая (нет тут нет ошибки)

"Жесткий диск с пониженным уровнем шума. Данный HDD предназначен для использования в бытовых цифровых видеомагнитофонах."

Если собираешь систему из того, что было под рукой - результат слегка ожидаем

Free

Free

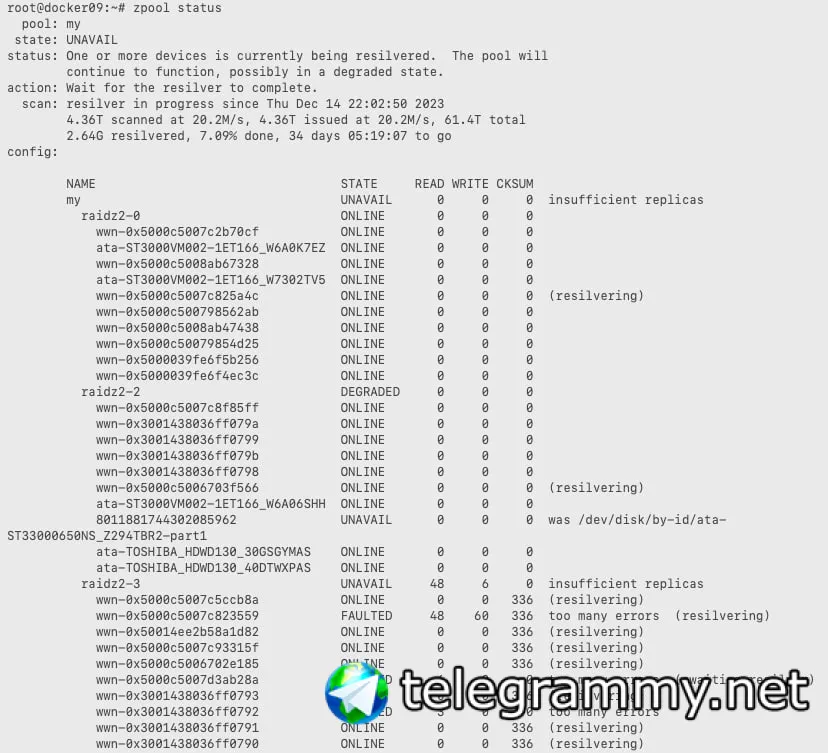

Ресильвер-то чем закончился ?

Там бессмысленно было бы его ждать.

Это проект Storj, через 30 дней все данные превращаются в тыкву, а там ресилверинг обещали за 34 дня (причем это время всё время росло)

Free

Free

Тем более эта серия слегка срановатая (нет тут нет ошибки)

"Жесткий диск с пониженным уровнем шума. Данный HDD предназначен для использования в бытовых цифровых видеомагнитофонах."

Если собираешь систему из того, что было под рукой - результат слегка ожидаем

Ну тот, кто эту систему собирал, за полтора года окупил её два раза, прежде чем вышел из проекта и мне продал.

А я покупал в основном из-за накопившихся данных, а не железа. Из расчета постепенно мигрировать их куда-нибудь, поддерживая жизнь raidz2 заменой дисков при необходимости.

Но очень уж неожиданно одно из устройств сразу на нескольких дисках рассыпаться стало.

Vladislav

Vladislav

Free

Free

Не, он по личным обстоятельствам сразу несколько серверов продал. Некоторые вполне себе из новых дисков. Вот недавно один из участников чата с одного из его серверов всё мигрировал и вполне себе приличные внутренности (Exos x16) в новую систему вставил.

Это только мне не повезло 😞

Алексей

Алексей

Не, он по личным обстоятельствам сразу несколько серверов продал. Некоторые вполне себе из новых дисков. Вот недавно один из участников чата с одного из его серверов всё мигрировал и вполне себе приличные внутренности (Exos x16) в новую систему вставил.

Это только мне не повезло 😞

Там и были exos. Я внутри них мигрировал

Denis

Denis

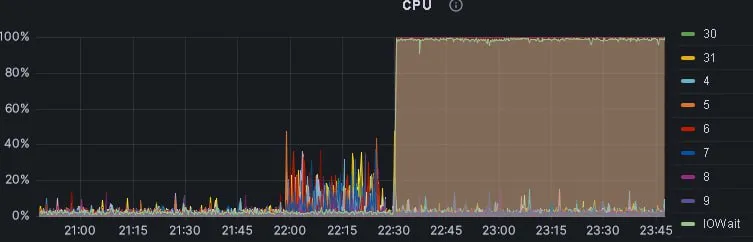

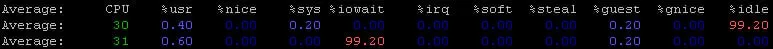

Приветствую, нужна помощь. Переустановил на сервере debian с 11 на 12 и столкнулся с проблемой. Посреди ночи примерно раз в 2-3 дня без каких либо видимых причин одно ядро на процессоре застревает в 100% iowait. Дисковой нагрузки нет, сами диски целые, в dmesg пусто. Из подозреваемых либо ядро, либо модуль zfs. Изначально и то и другое ставил из backports - ядро 6.5.10 и zfs 2.2.2. На багтрекере пишут, что с ядрами 6.4 была регрессия, которую пофиксили в 6.4.8 и 6.5.0-rc4 (https://bugzilla.kernel.org/show_bug.cgi?id=217699). Однако у меня проблема возникает и с более новым ядром и после возврата на штатное 6.1. В связи с этим вопрос, может не ядро виновато? Кто-нибудь сталкивался с подобным в zfs 2.2.2? Куда ещё копать?

Кот Матроскин

Кот Матроскин

Диски видеонаблюдения

Не читается сектор?

ПОХЕР

Пропускаем

Это вроде отключается кстате.

Кот Матроскин

Кот Матроскин

Там бессмысленно было бы его ждать.

Это проект Storj, через 30 дней все данные превращаются в тыкву, а там ресилверинг обещали за 34 дня (причем это время всё время росло)

Это та самая лавочка, которая за хранение файлов у себя, платит немного денег?

Кот Матроскин

Кот Матроскин

Приветствую, нужна помощь. Переустановил на сервере debian с 11 на 12 и столкнулся с проблемой. Посреди ночи примерно раз в 2-3 дня без каких либо видимых причин одно ядро на процессоре застревает в 100% iowait. Дисковой нагрузки нет, сами диски целые, в dmesg пусто. Из подозреваемых либо ядро, либо модуль zfs. Изначально и то и другое ставил из backports - ядро 6.5.10 и zfs 2.2.2. На багтрекере пишут, что с ядрами 6.4 была регрессия, которую пофиксили в 6.4.8 и 6.5.0-rc4 (https://bugzilla.kernel.org/show_bug.cgi?id=217699). Однако у меня проблема возникает и с более новым ядром и после возврата на штатное 6.1. В связи с этим вопрос, может не ядро виновато? Кто-нибудь сталкивался с подобным в zfs 2.2.2? Куда ещё копать?

Страшно теперь мне мои сервера переводить на ZFS что то, совсем не дружит дебиан с ZFS...

Denis

Denis

Страшно теперь мне мои сервера переводить на ZFS что то, совсем не дружит дебиан с ZFS...

Рядом 2 сервака на debian прекрасно работают. Только версия zfs там 2.1.11. Не думаю, что дистрибутив виноват.

Кот Матроскин

Кот Матроскин

Рядом 2 сервака на debian прекрасно работают. Только версия zfs там 2.1.11. Не думаю, что дистрибутив виноват.

В этом и страх, что из коробки ZFS нет, и всё работает методом костылей, и всегда можно получить кирпич после апдейта.

Nikita

Nikita

жюн

жюн

В этом и страх, что из коробки ZFS нет, и всё работает методом костылей, и всегда можно получить кирпич после апдейта.

зато ext4 из коробки, и кирпичи апдейтами не делались, да-да)

жюн

жюн

Страшно теперь мне мои сервера переводить на ZFS что то, совсем не дружит дебиан с ZFS...

proxmox тот же никаких проблем не видят в дебиане+zfs

Алексей

Алексей

Приветствую, нужна помощь. Переустановил на сервере debian с 11 на 12 и столкнулся с проблемой. Посреди ночи примерно раз в 2-3 дня без каких либо видимых причин одно ядро на процессоре застревает в 100% iowait. Дисковой нагрузки нет, сами диски целые, в dmesg пусто. Из подозреваемых либо ядро, либо модуль zfs. Изначально и то и другое ставил из backports - ядро 6.5.10 и zfs 2.2.2. На багтрекере пишут, что с ядрами 6.4 была регрессия, которую пофиксили в 6.4.8 и 6.5.0-rc4 (https://bugzilla.kernel.org/show_bug.cgi?id=217699). Однако у меня проблема возникает и с более новым ядром и после возврата на штатное 6.1. В связи с этим вопрос, может не ядро виновато? Кто-нибудь сталкивался с подобным в zfs 2.2.2? Куда ещё копать?

https://forum.proxmox.com/threads/proxmox-ve-8-1-3-abnormal-load.139142/

Не ваш случай?

Denis

Denis

Нет. У меня ни одного процесса в состоянии D нет. Диски все HDD кроме кэша, но на нём autotrim-а не запущено. Вообще никаких признаков нагрузки по процессам не видно.

Кот Матроскин

Кот Матроскин

зато ext4 из коробки, и кирпичи апдейтами не делались, да-да)

Мне ext4 и mdadm не нравится тем, что вместо данных может быть тыква, и не узнаешь об этом...

жюн

жюн

Мне ext4 и mdadm не нравится тем, что вместо данных может быть тыква, и не узнаешь об этом...

я про баг недавний в ядре, что у людей данные потерялись

жюн

жюн

И как же RAID1 делать?

железно, либо zfs

у меня недостаточно большой/разнообразный парк, этих вариантов хватает

Кот Матроскин

Кот Матроскин

Да

И много платят?

По факту, что то типо p2p раздачи файлов?

Там же доступность вроде в несколько копий?

жюн

жюн

Рисковые какие...

Бэкапы делаются на другой диск и на центральную хранилку, схема ещё до меня была принята такая

Алексей

Алексей

И много платят?

По факту, что то типо p2p раздачи файлов?

Там же доступность вроде в несколько копий?

Полтора доллара за хранение 1тб за месяц. Учитываются так назвваемые терабайто-часы хранятся. Еще немного доплачивают за трафик но там копейки

Алексей

Алексей

И много платят?

По факту, что то типо p2p раздачи файлов?

Там же доступность вроде в несколько копий?

данные хранятся не в виде копий, используются коды стирания, с коэффициентом ~2,86

Ivan

Ivan

Други, подскажите, пожалуйста, мне для закрепления понимания.

1) Я правильно понимаю, что потеря L2ARC, если он скажем на отдельном SSD, не ведёт к потере пула, т.к. все данные в L2ARC есть в самом пуле?

2) Потеря SLOG девайса, который на отдельном ссд, но без mirror, не ведёт к потере пула, а только к потере данных не записанных в пул за последние 5 сек?

3) Потеря Special Dev на отдельном ссд с метаданными, если он не в mirror, ведёт к потере пула?

Все верно? Или есть ситуации когда и в п.1 и п.2 пул теряется?

Алексей

Алексей

Vladislav

Vladislav

Vladislav

Vladislav

Владислав, книжка очень помогла, а вот ваш пиз...ешь не особо 😂

О, смог имя корректно написать)

Если бы книжка помогла - вопросов не было бы. Я уже молчу, что вместо теста таких элементарных вещей ты снова веришь на слово рандомным людям из чата

А если бы сказали нет? Что тогда?

Ivan

Ivan

О, смог имя корректно написать)

Если бы книжка помогла - вопросов не было бы. Я уже молчу, что вместо теста таких элементарных вещей ты снова веришь на слово рандомным людям из чата

А если бы сказали нет? Что тогда?

Это тоже было бы полезной информацией, в отличие от вашего пиздежа))

Vladislav

Vladislav

Это тоже было бы полезной информацией, в отличие от вашего пиздежа))

Круто)

Когда проверка чего-то занимает 10-15 минут - верить на слово в чатиках всегда классная затея))))

Ivan

Ivan

Круто)

Когда проверка чего-то занимает 10-15 минут - верить на слово в чатиках всегда классная затея))))

Ну во первых не без тестов. Но тесты штука такая, можно что и упустить. Во вторых, лишнее подтверждение того, что правильно понял или не понял от живых людей тоже крайне полезно. В третьих, мне насрать что, конкретно вы, Владислав, там думаете, и тем более на ваши оценки. То что вы редкостный токсичный Му..ак не знает разве что ленивый в этом чате)) 😂

Xash

Xash

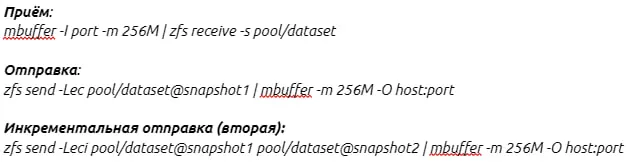

Доброго дня.

Есть задача, чтение статей и документаций не дали мне ответ на вопрос.

Есть пул "backuppool".

Есть на другом сервере датасет "storage/backuppool"

Существует ли простое решение сделать так, чтобы они были клонами.

Vladislav

Vladislav

Xash

Xash

send recv уже смотрели?

Согласно инструкциям, получается скопировать снапшот один раз. Новый снапшот не получается отправить, потому что требует уничтожить на целевом датасете старый.

Vladislav

Vladislav

Согласно инструкциям, получается скопировать снапшот один раз. Новый снапшот не получается отправить, потому что требует уничтожить на целевом датасете старый.

Прочтите ещё раз как пользоваться zfs send | receive

https://www.reddit.com/r/zfs/comments/2yyohg/full_backup_with_zfs_send/

Xash

Xash

Прочтите ещё раз как пользоваться zfs send | receive

https://www.reddit.com/r/zfs/comments/2yyohg/full_backup_with_zfs_send/

У меня reddit заблочен почему то. Так что вряд ли.

Алексей

Алексей

жюн

жюн

WD Red SN700 - эта хня вродь как спецом разработана по такое, но что-то медленовата будто на последовательных операция, чего думаете?

Vladislav

Vladislav

Stepan

Stepan

Привет! Кто-нибудь сталкивался с такой проблемой?

Я использую Ubuntu 22.04 с ZFS 2.1.5. На этой системе есть sparse ZVOL на несколько терабайт, который я подключаю к винде через iSCSI. В определенный момент мы заметили, что данные начали пропадать.

Когда я запускаю chkdsk, он находит ошибки, исправляет их и на какое-то время все приходит в норму. Но через некоторое время данные снова повреждаются.

Мы делаем снапшоты этого ZVOL-тома для резервного копирования. В момент создания снимка, мы отключаем диск от Windows-системы.

Можно как то у zfs узнать консистентность датасета?

Vladislav

Vladislav

l2arc ж

Хорошо, ему и сата ссд будет хватать, поэтому особо не смотри на скорость, там всё равно не последовательное чтение

Vladislav

Vladislav

Shaker

Shaker