Vladislav

Vladislav

Привет! Кто-нибудь сталкивался с такой проблемой?

Я использую Ubuntu 22.04 с ZFS 2.1.5. На этой системе есть sparse ZVOL на несколько терабайт, который я подключаю к винде через iSCSI. В определенный момент мы заметили, что данные начали пропадать.

Когда я запускаю chkdsk, он находит ошибки, исправляет их и на какое-то время все приходит в норму. Но через некоторое время данные снова повреждаются.

Мы делаем снапшоты этого ZVOL-тома для резервного копирования. В момент создания снимка, мы отключаем диск от Windows-системы.

Можно как то у zfs узнать консистентность датасета?

Да, я видел пост, нет, это касается копирования внутри самого zfs как ФС, не когда это zvol наружу как я понял

@gmelikov, баг с корраптом же только на ФС и zvol никак не затронут был?

жюн

жюн

Хорошо, ему и сата ссд будет хватать, поэтому особо не смотри на скорость, там всё равно не последовательное чтение

пул на хардах после определённого кол-ва дисков будто пошустрее саташника будет

Stepan

Stepan

на реддите под катом такое:

Apparently block cloning just aggrevates the issue...

Какжется как раз мой случай

Vladislav

Vladislav

Все диски живые.

Тогда, самое банальное, у Вас iscsi таргет только один инициатор ведь трогает?

Georg🎞️🎥

Georg🎞️🎥

пул на хардах после определённого кол-ва дисков будто пошустрее саташника будет

Эммм .. в линейном чтении разве что

Vladislav

Vladislav

на реддите под катом такое:

Apparently block cloning just aggrevates the issue...

Какжется как раз мой случай

Block cloning это просто reflink

Stepan

Stepan

Как думаете, может влиять различие размера блока?

На волюме volblocksize 16K. На ntfs 8k.

То что читал, пишут. что самое плохое что может быть в такой ситуации это write amplification.

Vladislav

Vladislav

Vladislav

Vladislav

Block cloning это просто reflink

В теории конечно Вы могли наткнуться на этот баг, но если бы он был настолько постоянным и заметным - его бы раньше нашли

George

George

Да, я видел пост, нет, это касается копирования внутри самого zfs как ФС, не когда это zvol наружу как я понял

@gmelikov, баг с корраптом же только на ФС и zvol никак не затронут был?

если речь про клонирование блоков то только для ФС

Xash

Xash

[Unit]

Description=Continuous replication of media storage

After=network.target

[Service]

ExecStart=/usr/sbin/syncoid root@0.0.0.0:HDD/media HDD/media --create-bookmark

Restart=always

RestartSec=10000ms

StartLimitInterval=0

[Install]

WantedBy=multi-user.target

Итог - в сравнении с rsync быстрее процентов на 15-20. Чудес нет. Но оно работает.

Fedor

Fedor

@neurox как у этого бота запрет снимается ?

Привет! Удаляется из рестрикта в телеге, больше ничего не нужно. А кого забанило?

Ivan

Ivan

Привет! Удаляется из рестрикта в телеге, больше ничего не нужно. А кого забанило?

не забанило, просто ссылки не дает кидать

Кот Матроскин

Кот Матроскин

Полтора доллара за хранение 1тб за месяц. Учитываются так назвваемые терабайто-часы хранятся. Еще немного доплачивают за трафик но там копейки

Электричества не больше наматывается, чем выходит оплаты?)

Алексей

Алексей

Электричества не больше наматывается, чем выходит оплаты?)

вот, можешь полюбопытствовать http://th3van.dk

Станислав

Станислав

George

George

Eugen

Eugen

Доброго дня суток. Если есть хранилище 10 дисков 2.5 sas по 900гб и 3 ссд по кеши разные. Как лучше зфс настроить.

Я думал о одном ссд под l2 кеш, и 2 диска ссд зарейдить под запись. Весь массив по сути зарейдить в один пирог зфс. Это здравая мысль или если более путевые решения? Использовать буду для виртуализации разношерстой...

Denis

Denis

А что за проц? Случаем не ryzen?

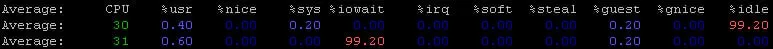

Нет, Xeon E5-2690. Сделал даунгрейд zfs на 2.1.11, посмотрим на результат. Пока нормально.

Denis

Denis

autotrim включен?

Уже спрашивали. Autotrim выключен, как был по-умолчанию, и ни один процесс ни юзерский, ни ядерный не висит в состоянии D.

Eugen

Eugen

По syncoid. Очень мощно грузит подсистему дисков. Не включайте в момент работы.

Не особо он что то грузит, он больше сеть грузит.

riv

riv

Согласно инструкциям, получается скопировать снапшот один раз. Новый снапшот не получается отправить, потому что требует уничтожить на целевом датасете старый.

По тому что новые снимки нужно пересылать в инкрементальном режиме вручную или использовать syncoid (команда из пакета sanoid) для их автоматической репликации. Ещё надо будет что-то придумать, чтобы удалять уже пересланные снимки.

Это очень дешевый и черезвычайно быстрый медод репликации, можно производить репликацию и через ssh-соединение, что работает в syncoid из ксробки

riv

riv

Привет! Кто-нибудь сталкивался с такой проблемой?

Я использую Ubuntu 22.04 с ZFS 2.1.5. На этой системе есть sparse ZVOL на несколько терабайт, который я подключаю к винде через iSCSI. В определенный момент мы заметили, что данные начали пропадать.

Когда я запускаю chkdsk, он находит ошибки, исправляет их и на какое-то время все приходит в норму. Но через некоторое время данные снова повреждаются.

Мы делаем снапшоты этого ZVOL-тома для резервного копирования. В момент создания снимка, мы отключаем диск от Windows-системы.

Можно как то у zfs узнать консистентность датасета?

Впечатление такое, что источник ошибок сам iscsi или процесс его отключения

Xash

Xash

По тому что новые снимки нужно пересылать в инкрементальном режиме вручную или использовать syncoid (команда из пакета sanoid) для их автоматической репликации. Ещё надо будет что-то придумать, чтобы удалять уже пересланные снимки.

Это очень дешевый и черезвычайно быстрый медод репликации, можно производить репликацию и через ssh-соединение, что работает в syncoid из ксробки

Если снимков нет на стороне источников, а в текущем снапшоте изменились данные - засинкает разницу?

Free

Free

Если снимков нет на стороне источников, а в текущем снапшоте изменились данные - засинкает разницу?

Разве в снапшоте может что-то измениться?😳

riv

riv

Если снимков нет на стороне источников, а в текущем снапшоте изменились данные - засинкает разницу?

Ну так это уничтожит изменения данных в целевом датасете. Сключом --force он это сделает. Двустороння синхронизация - это не однозначная задача, которая как я понимаю должна решаться в каждом случае индивидуально, т.к. надо как-то разрешать конфиликты.

riv

riv

Если снимков нет на стороне источников, а в текущем снапшоте изменились данные - засинкает разницу?

syncoid создает снимки на источнике, синхронизация проводится аномарно, передачей снимка за снимком.

Станислав

Станислав

Nikita

Nikita

По тому что новые снимки нужно пересылать в инкрементальном режиме вручную или использовать syncoid (команда из пакета sanoid) для их автоматической репликации. Ещё надо будет что-то придумать, чтобы удалять уже пересланные снимки.

Это очень дешевый и черезвычайно быстрый медод репликации, можно производить репликацию и через ssh-соединение, что работает в syncoid из ксробки

есть еще zxfer, например... а для автоматизации создания снимков - zfstools. правда на линь их нужно немного подпиливать, но там не страшно. И у меня, вроде были линёвые форки, могу скинуть.

Nikita

Nikita

Если снимков нет на стороне источников, а в текущем снапшоте изменились данные - засинкает разницу?

Инкрементная передача снимков возможна только в одном случае - на источнике и приёмнике имеется снимок, относительно которого передаётся разница.

Т.е. вы можете создать снимок 1, передать его.

Создать снимок 2, передать его инкрементно относительно 1.

Удалить снимок 1 (везде, или только в одном из местоположений)

Создать снимок 3 и передать его относительно 2.

Как только у источника и получателя пропадает общий снимок, инкрементная передача невозможна.

Nikita

Nikita

Итог - в сравнении с rsync быстрее процентов на 15-20. Чудес нет. Но оно работает.

А преимущества передачи снопшотов по сравнению с rsync начинают быть заметны на инкрементной передаче, особенно, если файлов достаточно много. И при использовании снимков вы пропускаете этап проверки всех этих файлов.

Eugen

Eugen

Nikita

Nikita

А снимок надо удалять? Он же сам не удалится.

Ну, смотря чем вы пользуетесь) В каких то программах его и создавать не надо, за вас всё софт делает.

riv

riv

есть еще zxfer, например... а для автоматизации создания снимков - zfstools. правда на линь их нужно немного подпиливать, но там не страшно. И у меня, вроде были линёвые форки, могу скинуть.

Буду благодарен. У меня жту функцию выполняют самописные bash-скрипты.

Кстати, есть скрипт, который проверчет что всё впорядке с бекапом. Он создаёт sqlite-базу данных и записывает в неё:

- информацию о хранящихся на backup-сервере снимках: их именах и giud;

- подключается к каждому, указанному в конфигурации гипервизору proxmox, и записывсет в несколько таблиц в базе данных информацию о найденных виртуальных машинах, их zvol, снимках на этих zvol и отношениях между ними.

Затем скрипт выполняет sql-запрос, кстати написанный chat-gpt :-) и вычисляет zvol и виртуальные машины у которых не найдено актуальных резервных копий и выводит предлагаемые правки конфигрурационных файлов к скрипту создания снимков и скрипту передачи снимков.

Я понемногу допиливаю этот скрипт. Ближайщее время, план рую бобавить функционал сбора и сопоставления информации о smb- и nfs-шарах, хранящихся в zfs.

riv

riv

Инкрементная передача снимков возможна только в одном случае - на источнике и приёмнике имеется снимок, относительно которого передаётся разница.

Т.е. вы можете создать снимок 1, передать его.

Создать снимок 2, передать его инкрементно относительно 1.

Удалить снимок 1 (везде, или только в одном из местоположений)

Создать снимок 3 и передать его относительно 2.

Как только у источника и получателя пропадает общий снимок, инкрементная передача невозможна.

Поправочка: разницу можно отправлять не только между двумя снимками, но и мнжду снимком и закладкой (zfs bookmark). В отличие от zfs-снимков, zfs-bookmark не занимают места. Syncoid может после успешной передачи конвертировать переданный снимок в закладку, кроме того он автоматически продолжает прерванные передачи, что очень удобно.

riv

riv

А преимущества передачи снопшотов по сравнению с rsync начинают быть заметны на инкрементной передаче, особенно, если файлов достаточно много. И при использовании снимков вы пропускаете этап проверки всех этих файлов.

Приимущества передачи снимков ещё и в их консистентности. Работающую базу данных нельзя rsync-ом во время работы бекапить, а снимками можно.

Andrey

Andrey

riv

riv

Зачем?

По тому, что из-за ниличия снимка, растёт занимаемое место при записи в пул. Подумайте о том, что снимок блокирует данные на которве он ссылается. Если вы удалили файл после создания снимка, место занимаемое файлом не высвободится пока вы не удалите все снимки, где этот файл существует. Если вы перезаписали часть файла после создания снимка, эта новая информация займёт свободное место и оно не освободится, пока существуют снимки блокирующие её удаление перезаписанной информации.

Снимки это как машина времени.

riv

riv

Нет

Приведите, пожалуйста, примеры. Я давно работаю с zfs и поднятие со снимка в точности соответствует ситуации неожиданной пртери питания. Не встречал баз данных, которые портятся от этого.

Eugen

Eugen

По тому, что из-за ниличия снимка, растёт занимаемое место при записи в пул. Подумайте о том, что снимок блокирует данные на которве он ссылается. Если вы удалили файл после создания снимка, место занимаемое файлом не высвободится пока вы не удалите все снимки, где этот файл существует. Если вы перезаписали часть файла после создания снимка, эта новая информация займёт свободное место и оно не освободится, пока существуют снимки блокирующие её удаление перезаписанной информации.

Снимки это как машина времени.

Нет, это старые снимки хранят, они хранят вес изменений в фс, если синкать и избавляться за одно от старых, то ничего лишнего балластом храниться не будет.

Vladislav

Vladislav

riv

riv

Нет, это старые снимки хранят, они хранят вес изменений в фс, если синкать и избавляться за одно от старых, то ничего лишнего балластом храниться не будет.

На нагруженных по io системах, сразу после создания снимка нсчинается рост занятого места. Представьте что это относительна не большая и дорогая ssd с базой данных, какой-нибудь optane. По этому, лучше всего как можно быстрее передать снимок к месту его хоанения и конвертировать переданный снимок в закладку, что высвободит всё занятое место.

riv

riv

А зачем?

https://github.com/psy0rz/zfs_autobackup

Изучу. У меня есть ряд требований к системе, например, у меня сотни vm и они постоянно создаются и удалчются. Я так автоматизировал проверку актуальности бекапов и их наличие для новых машин.

Andrey

Andrey

Сами по себе бд на zfs не портятся, тут все так. Использоваие снапшотов для клонирования бд, в частности oracle, вот тут появляются нюансы.

Я тоже давно использую zfs

riv

riv

Сами по себе бд на zfs не портятся, тут все так. Использоваие снапшотов для клонирования бд, в частности oracle, вот тут появляются нюансы.

Я тоже давно использую zfs

Тогда было бы интересно узнать о нюансах :-) век живи - век учись

Eugen

Eugen

На нагруженных по io системах, сразу после создания снимка нсчинается рост занятого места. Представьте что это относительна не большая и дорогая ssd с базой данных, какой-нибудь optane. По этому, лучше всего как можно быстрее передать снимок к месту его хоанения и конвертировать переданный снимок в закладку, что высвободит всё занятое место.

Я повторюсь, используй синкод. И почаще. В итоге старое будет удаляться и не занимать места.пррсто почаще делать и все. Там не так уж много этих данных будет гоняться.

Vladislav

Vladislav

Я повторюсь, используй синкод. И почаще. В итоге старое будет удаляться и не занимать места.пррсто почаще делать и все. Там не так уж много этих данных будет гоняться.

подтверждаю, sanoid/syncoid очень хорошо работает даже на коде ZFS 3-х годичной давности

Кот Матроскин

Кот Матроскин

Кто то использовал WD Purpure под RAIDZ?

А то выше говорили что они ошибки пропускают, но ведь там стриминг только при использовании соответствующих ATA команд, а по умолчанию обычный диск с TLER и не более того.

Nikita

Nikita

Vladislav

Vladislav

Кто то использовал WD Purpure под RAIDZ?

А то выше говорили что они ошибки пропускают, но ведь там стриминг только при использовании соответствующих ATA команд, а по умолчанию обычный диск с TLER и не более того.

???

Это логика работы самого микрокода контроллера HDD.

"Это интерфейс, который все жесткие диски с поддержкой Streaming Feature Set предоставляют хост-контроллеру. А вот как диск распорядится полученными параметрами — вопрос к микропрограмме. Набор алгоритмов AllFrame, разработанных WD для дисков Purple, пришел на смену «технологии» SilkStream, которая применялась в дисках WD-RE GP."

Artem

Artem