???

Это логика работы самого микрокода контроллера HDD.

"Это интерфейс, который все жесткие диски с поддержкой Streaming Feature Set предоставляют хост-контроллеру. А вот как диск распорядится полученными параметрами — вопрос к микропрограмме. Набор алгоритмов AllFrame, разработанных WD для дисков Purple, пришел на смену «технологии» SilkStream, которая применялась в дисках WD-RE GP."

Не отключить это никак?)

Vladislav

Vladislav

Фиолетовый просто скипает их, красный пытается 5(?) секунд, помечает, что надо будет потом его восстановить (когда нагрузка уйдёт) и идёт дальше

Остальные пытаются пока либо не считают, либо не пройдёт секунд 15 вроде и сразу пытаются восстановить данные с него

Nick

Nick

Vladislav

Vladislav

Vladislav

Vladislav

но может я неудачно ппа выбираю и надо поставить не из ppa:arter97/zfs ?

Самый лучший вариант собирать самому

Nick

Nick

в готовых ppa докидывают и как-то поддерживают убунту-специфичные патчи и бекпорты из мастера. Я сам это не осилю по времени :(

Nick

Nick

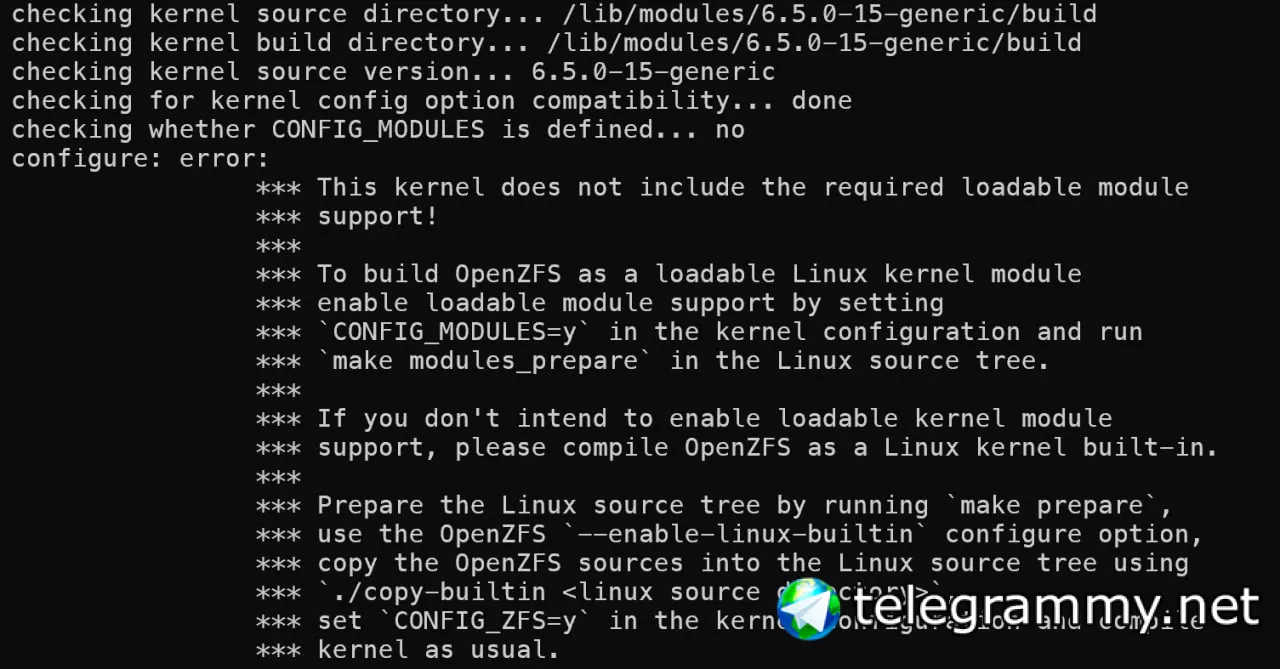

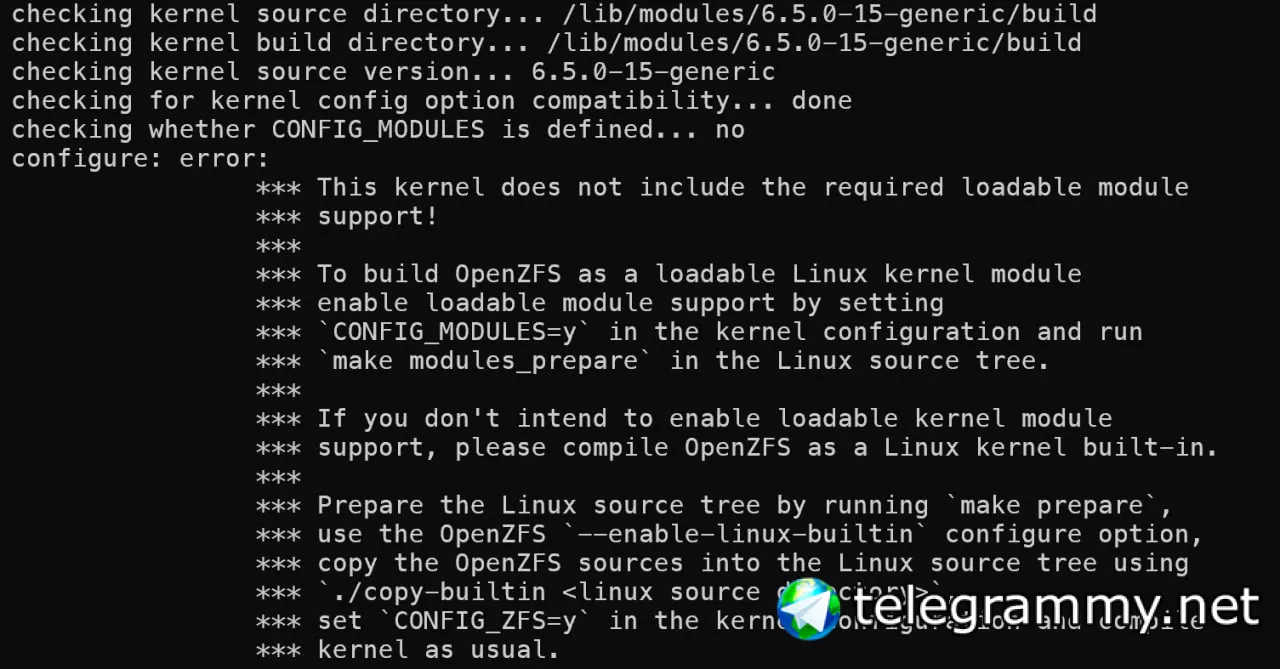

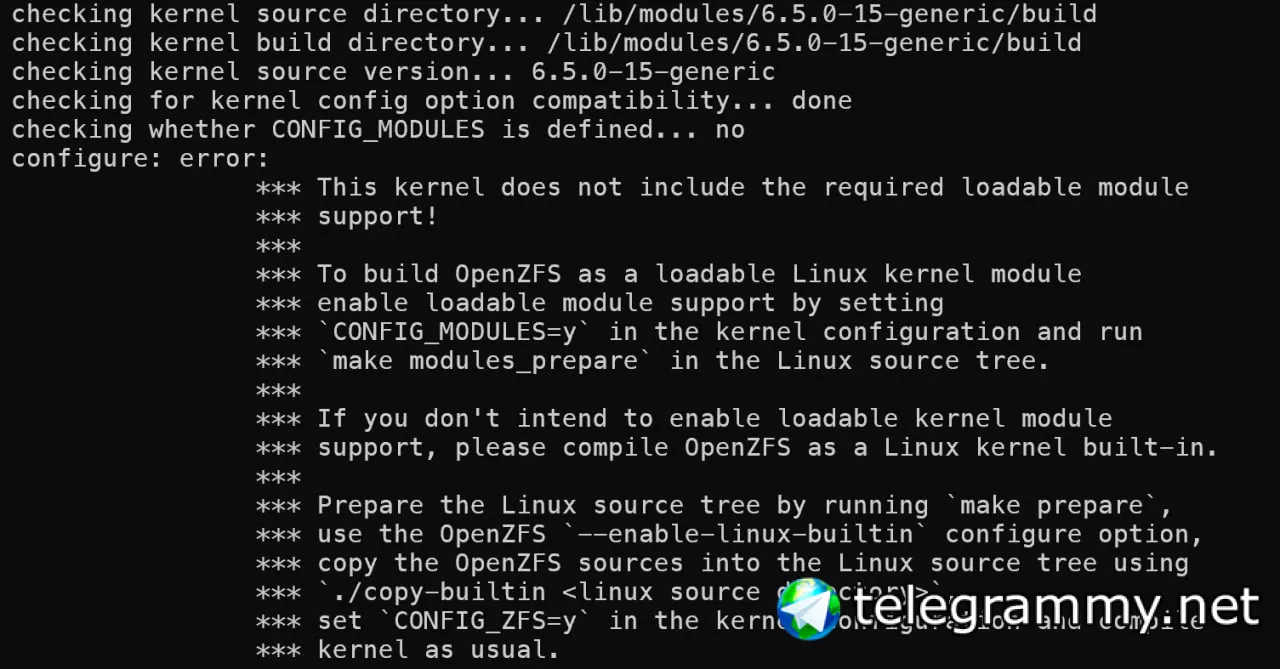

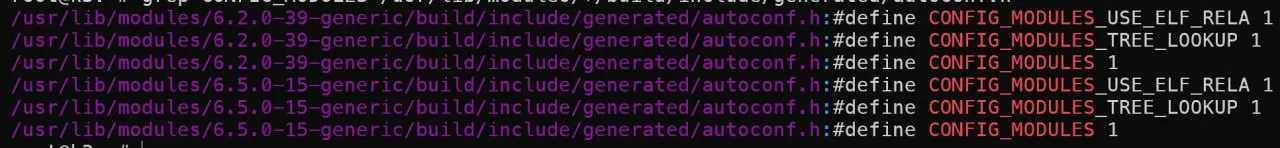

с ppa:mike-mlb/zfs-release то же самое. в /var/lib/dkms/zfs/2.2.2/build/make.log (с первым ппа то же самое)

DKMS make.log for zfs-2.2.2 for kernel 6.5.0-14-generic (x86_64)

Sat Jan 27 22:28:05 MSK 2024

make: *** No targets specified and no makefile found. Stop.

Vladislav

Vladislav

в готовых ppa докидывают и как-то поддерживают убунту-специфичные патчи и бекпорты из мастера. Я сам это не осилю по времени :(

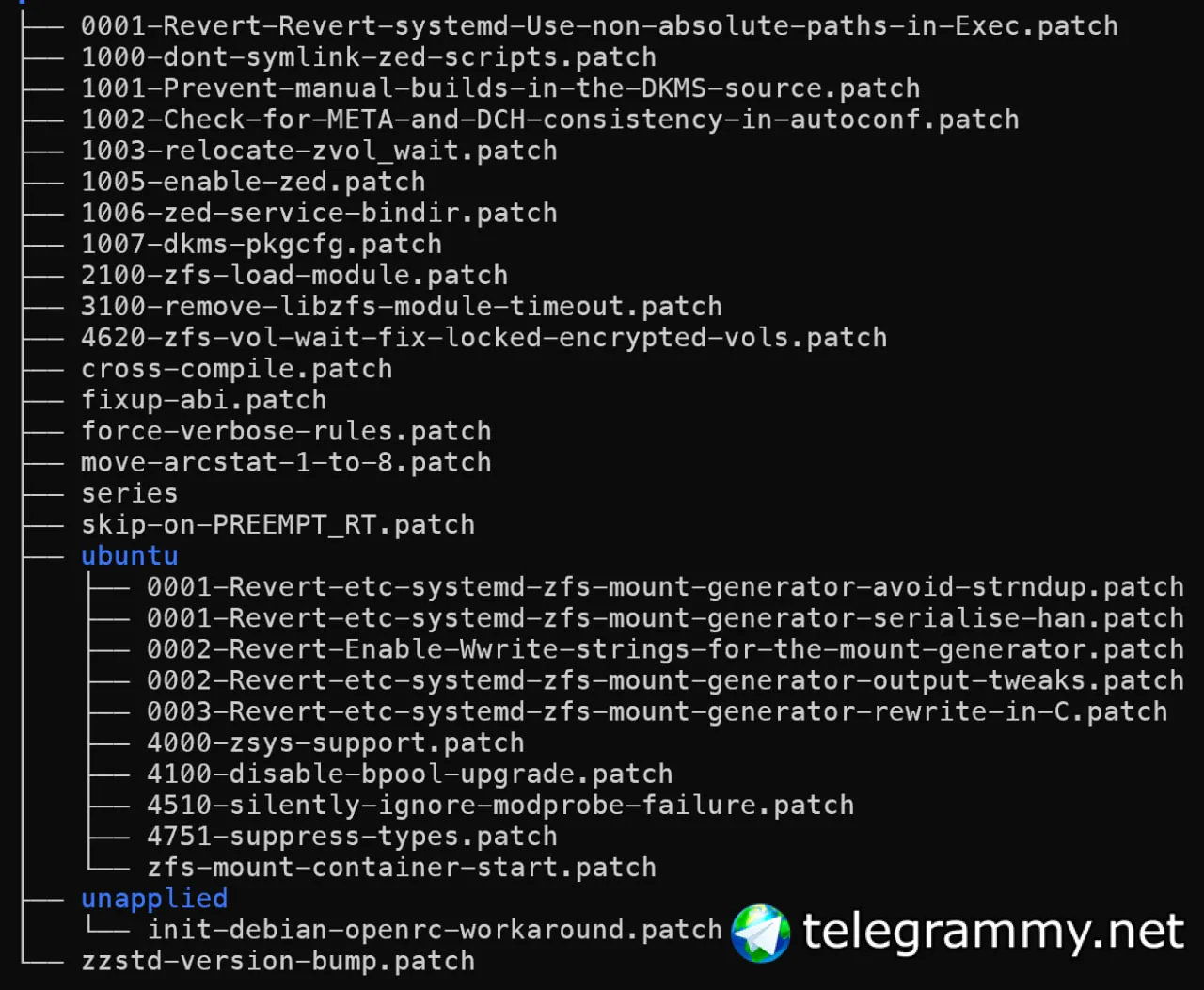

Я не уверен, что за специфичные патчи есть для ubuntu......

Vladislav

Vladislav

У них есть специфичные патчи да, и поэтому у них версия слегка по нумерации отличается, но эти патчи приводят к

https://bugs.launchpad.net/ubuntu/+source/zfs-linux/+bug/1906476

Vladislav

Vladislav

Nick

Nick

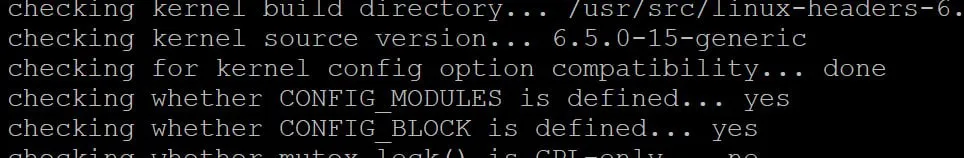

что любопытно - в варианте поставить родное от noble (с пиннингом по мотивам https://devblog.yvn.no/posts/zfsutils-linux-and-hwe-kernels/ ) точно так же не работает, ну т.е. видимо дело не в zfs, а в убунте (

Vladislav

Vladislav

да, на чистой в виртуалке у меня тоже завелось. Но вот на существующем сервере как собрать?

Надо проверять, поставить из ppa, забилдить ванилу, поставить deb пакеты

Vladislav

Vladislav

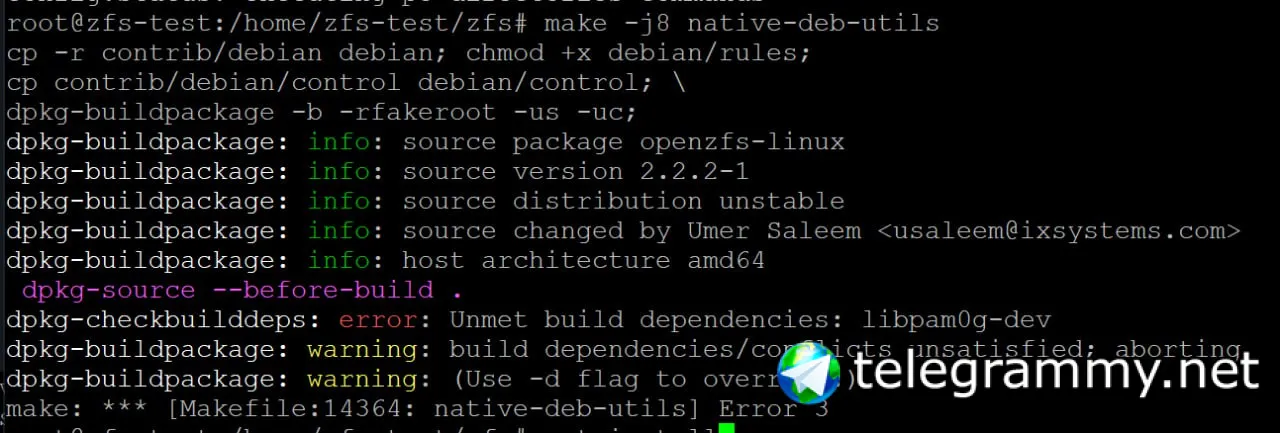

@gmelikov кстати говоря, на вики не хватает пакета libpam0g-dev для билда через native-deb-utils

Xash

Xash

По ext4 что могу сказать. Так то на qcow скорость норм. Но конечно xfs лучше для ssd. Дедупликация таки. Мой кейс это чисто один сервер виртуализировать чтобы переносить бекапы и т.д. ну может контейнер маленький не более. Выбирайте xfs, если из не zfs.

Кот Матроскин

Кот Матроскин

Фиолетовый просто скипает их, красный пытается 5(?) секунд, помечает, что надо будет потом его восстановить (когда нагрузка уйдёт) и идёт дальше

Остальные пытаются пока либо не считают, либо не пройдёт секунд 15 вроде и сразу пытаются восстановить данные с него

Фиолетовый вроде только при соответствующей ATA команде так делает, т.е. технология не обязательная.

А остальные пытаются до талого исправить, вешая IO, именно по этому битые блюшки например вешаются часто.

George

George

@gmelikov кстати говоря, на вики не хватает пакета libpam0g-dev для билда через native-deb-utils

пулл реквесты приветствуются, с меня ревью и влитие)

Xash

Xash

Скоро, уже есть пачти в ядре.

А если у меня на zfs твердотелы, то мне надо что то сетить в пул?

Xash

Xash

А преимущества передачи снопшотов по сравнению с rsync начинают быть заметны на инкрементной передаче, особенно, если файлов достаточно много. И при использовании снимков вы пропускаете этап проверки всех этих файлов.

Да вот наблюдаю за работой syncoid пока 4 дня полет норм. Мне в принципе по чесноку, если все будет гуд не нужны никакие pbs. А зачем тогда?

Вот я слил в пул локальный, оттуда реплицировал и погнали дальше по стораджам. Так смысл в нем тогда?

Xash

Xash

Типа -> локальный -> сетевой датасет серв1 -> сетевой датасет серв2 и т.д.

Я могу эти хранилища подключить на любых гипервизорах и сливать оттуда бекапы если надо.

Xash

Xash

Ну ща вот добрасывать сверх что было норм. А вот когда я первый раз запустил на 3тб - ой оно мне забило.

Игорь

Игорь

Да вот наблюдаю за работой syncoid пока 4 дня полет норм. Мне в принципе по чесноку, если все будет гуд не нужны никакие pbs. А зачем тогда?

Вот я слил в пул локальный, оттуда реплицировал и погнали дальше по стораджам. Так смысл в нем тогда?

Если сбой хоста или хост с гипервизором взломан, старые снимки удалены, а в текущее состояние образов записан мусор? Обычная синхронизация всё это и распространит дальше.

Xash

Xash

Если сбой хоста или хост с гипервизором взломан, старые снимки удалены, а в текущее состояние образов записан мусор? Обычная синхронизация всё это и распространит дальше.

Оу ну если оно взломано, тогда все пипец при любом раскладе. Есть у меня недельный бекап отдельный вообще тупо рсинком. На долгое хранение до года что кладет. А больше никак

Xash

Xash

Просто сервачок на подоконнике с ссд на долговременное. И оно не мешает, просто копирует туда с одной реплики и все

Игорь

Игорь

Оу ну если оно взломано, тогда все пипец при любом раскладе. Есть у меня недельный бекап отдельный вообще тупо рсинком. На долгое хранение до года что кладет. А больше никак

Если взломан гипервизор, это не факт, что взломан PBS

Vladislav

Vladislav

Если сбой хоста или хост с гипервизором взломан, старые снимки удалены, а в текущее состояние образов записан мусор? Обычная синхронизация всё это и распространит дальше.

это не мешает использовать бэкап второго уровня.

складывать на второй сервер под своим пользователем и рутом хранить дополнительные снимки

nanomechanic

nanomechanic

где можно подсмотреть адекватные параметры модуля zfs для raidz2 на жестких дисках, с огромным количеством снэпшотов. подключил очередной сервер с которого сливаю снэпшоты полученные посредством zfs-auto-snapshot и налетел на невероятные тормоза. думал мой тюнинг в основном на тему vdev cache и очередей кривой (пул помер, перешел в suspended), отключил, понадеевшись на дефолт/авто-тюнинг, вышло еще хуже

nanomechanic

nanomechanic

единственное что более-менее помогло это выставить dbuf_metadata_cache_max_bytes 12гб, памяти на сервере достаточно

Xash

Xash

В том то и дело, что тюнить zfs - очень коварная история. Авто снапшот скрипт, когда он мне там наплодил снапшотов - выкинул. Проще crontab четко прописать, чем отдать это скрипту, который их множит как ненормальный.

Xash

Xash

Сколько я не тюнил zfs - чуда не происходило. Объективно слишком мало положительных изменений из за которых это стоило бы делать.

Xash

Xash

не, мне надо много снэпшотов для возможности отката

zfs snapshot /dataset переменная твоя каждые сколько там минут?

nanomechanic

nanomechanic

дело не в том что на исходнике много снэпшотов, а в том что на приемнике может тысяч 30 уже

Xash

Xash

Снаашоты чистить тоже надо. Зачем тебе снаашоты на месяц или на сколько там. Ограничь это. zfs-prune-snapshot хорошо работает. Я очищаю например более 2х недель.

Xash

Xash

дело не в том что на исходнике много снэпшотов, а в том что на приемнике может тысяч 30 уже

Так выбери дельту в каком промежутке хранить. Зачищай излишки, будет быстрее.

Xash

Xash

Никак. Тюнинг zfs себя не оправдал ни разу. Оперативы добавить только, но оно и так динамически по моему.

nanomechanic

nanomechanic

если бы я собирался чистить то спросил бы сколько снэпшотов/датасетов оно вынесет если дать ему гигов 50 оперативки

nanomechanic

nanomechanic

Xash

Xash

вот тут оно настраивается

Ну и все больше там ниче мне не дало. Я столько перерыл всяких статей. На SSD поставил и красота.

nanomechanic

nanomechanic

#options zfs zfs_vdev_cache_size=1310720

#options zfs zfs_vdev_cache_max=131072

#options zfs zfs_vdev_cache_bshift=17

#options zfs zfs_read_chunk_size=1310720

#options zfs zfs_vdev_async_read_max_active=16

#options zfs zfs_vdev_async_read_min_active=8

#options zfs zfs_vdev_async_write_max_active=16

#options zfs zfs_vdev_async_write_min_active=8

#options zfs zfs_vdev_sync_read_max_active=16

#options zfs zfs_vdev_sync_read_min_active=8

#options zfs zfs_vdev_sync_write_max_active=16

#options zfs zfs_vdev_sync_write_min_active=8

#options zfs zfs_top_maxinflight=320

#options zfs zfs_txg_timeout=15

#options zfs zfs_dirty_data_max_percent=10

вот это снес, настраивал году так в 18-м, и еще больше поплохело

Xash

Xash

4tb самсунги взяли и вот это реальный тюнинг. Сама по себе zfs НЕ БЫСТРА. Что аппаратным рейдам, что mdadm, что просто как файловая система проигрывает в скорости

Fedor

Fedor

Roman

Roman