Неа)нужно было много места…просто человеку чем больше тем лучше

ну при 24 дисках - один диск это 4% - там погоды не делает - если ему не хватает именно эти 4 процента для выбора Z1 вместо хотя бы z2 - то тут всё плохо

Y

Y

Это было бы очень грустно(

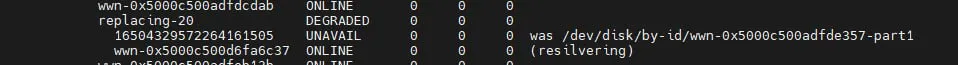

я бы не вынимал сбойный диск в процессе - а замену подключил поралельно в таком случаи (да хоть через USB карман на время ребилда, если больше воткнуть некуда) - так всё надежней

CARA

CARA

ну при 24 дисках - один диск это 4% - там погоды не делает - если ему не хватает именно эти 4 процента для выбора Z1 вместо хотя бы z2 - то тут всё плохо

Скажем так была одна монетка…и админ злоупотреблял…не волнуют диски главное что бы было больше места.он уволен и этого ничего нет….Потом был другой который не догадался переделать на з3 хотя бы и запилил туда много важного.Потом я и нарыл всю историю и плачу.

Y

Y

Скажем так была одна монетка…и админ злоупотреблял…не волнуют диски главное что бы было больше места.он уволен и этого ничего нет….Потом был другой который не догадался переделать на з3 хотя бы и запилил туда много важного.Потом я и нарыл всю историю и плачу.

тут главное крайним не оказатся - надо идти и объеснять руководству... зы ну а если на важное бэкапов нет то лучше сразу менять место работы, потом на текущего одмина повесят если дата пропадет

Y

Y

Поменять диск перенести переставить и жить хорошо план такой

мой план - цепляешь новый диск (хоть по USB) - делаешь на него реплейс - меняешь диски (если нельзя выключать - можно сделать новому и старому диску офлайн потом воткнуть новый и сделать онлайн - это можно на лету сделать - не умрёт)

CARA

CARA

мой план - цепляешь новый диск (хоть по USB) - делаешь на него реплейс - меняешь диски (если нельзя выключать - можно сделать новому и старому диску офлайн потом воткнуть новый и сделать онлайн - это можно на лету сделать - не умрёт)

Y

Y

CARA

CARA

Y

Y

а если бы не отключил - то старый бы удерживал избыточность пока не заменится , и исправил бы одиночные ошибки

Y

Y

Да я думаю и реплейс бы быстрее сделался в разы)

нет разницы , только если диск совсем мертвый и постоянно вводит в ступор контроллер или отваливается - рекомендуется его отключать

CARA

CARA

нет разницы , только если диск совсем мертвый и постоянно вводит в ступор контроллер или отваливается - рекомендуется его отключать

Мне кажется на будующее нужно оставлять просто 1 свободное место в корзине)И все)

Ivan

Ivan

Мне кажется на будующее нужно оставлять просто 1 свободное место в корзине)И все)

не лучше raidz2-3 делать ?

Denis

Denis

Подскажите насколько критично делать zfs на raid6 который собран по средствам контролера? Слышал, что zfs нужен прямой доступ к диску без прослойки в виде raid контролера.

Georg🎞️🎥

Georg🎞️🎥

Подскажите насколько критично делать zfs на raid6 который собран по средствам контролера? Слышал, что zfs нужен прямой доступ к диску без прослойки в виде raid контролера.

Переведите контролер в IT , он и будет как hba работать

Нафиг вам зависимость от модели контролера то

Fedor

Fedor

Подскажите насколько критично делать zfs на raid6 который собран по средствам контролера? Слышал, что zfs нужен прямой доступ к диску без прослойки в виде raid контролера.

Контроллер будет дополнительным источниклм возникновения потенциальных сбоев при записи, что может привести к потере консистентности

ViP

ViP

Всем доброго дня!

Есть установленый Proxmox 8 на ZFS raid1, все отлично работало пока я не решил добавить еще одну стат IP и в конфигурации сети interfaces допустил ошибку и сервер вылетел из сети.

Загрузился в режиме восстановления поключил zfs pool ,но там пусто, есть только диск виртуалок и контейнеров.

Подскажите как открыть диск что бы можно было отредактировать сеть или скопировать файлы Proxmox

Михаил

Михаил

В proxmox если система установлена на zfs, то / в rpool лежит. Попробовать его импортировать или заказать iKVM

ViP

ViP

В proxmox если система установлена на zfs, то / в rpool лежит. Попробовать его импортировать или заказать iKVM

Смонтировал, пул есть, в нем есть папка ROOT и Data( имя прокса) в папке .

В папке root фалов нет, но по идее там должны лежать все файли Проксмоса. В папке Data есть диски виртуалки и контейнера.

Шифрование в zfs не включено,

Игорь

Игорь

Смонтировал, пул есть, в нем есть папка ROOT и Data( имя прокса) в папке .

В папке root фалов нет, но по идее там должны лежать все файли Проксмоса. В папке Data есть диски виртуалки и контейнера.

Шифрование в zfs не включено,

Конфигурация сети в /etc/network/interfaces

zfs list покажет список датасетов, где смотрим, соображаем, монтируем и находим /etc

CARA

CARA

Подскажите пожалуйста хочу взять такой HBA-адаптер LSI SAS 9300-8i или стоит присмотреться к чему то другому?)

Илья

Илья

Илья

Илья

Подскажите пожалуйста хочу взять такой HBA-адаптер LSI SAS 9300-8i или стоит присмотреться к чему то другому?)

Какие диски будешь подключать?

Animal

Animal

Братва, привет. Нубский вопрос. Гуглить чот не охота )) Есть ПУЛ, на нем 1 датасет и 1 вольюм. Надо эти датасет и вольюм перенести на другой пул. Если я делаю снапшот ПУЛа и send/recv его на другой пул - переедут оба сразу два ? И дата сет и вольюм? Или надо поочередно снапшотить датасет и вольюм и по отдельности их на новый пуль отправлять ? ПС если можно как-то сразу оба отправить мб какие ключи доп надо юзать типа делать снапшот ПУЛа рекурсивно... Как? )) Сорри если сумбурно

Vladislav

Vladislav

И да, можно просто отправить снап корневого пула и он заберёт все что ниже (т.е. датасеты и zvol)

Animal

Animal

И да, можно просто отправить снап корневого пула и он заберёт все что ниже (т.е. датасеты и zvol)

ОК. СПС. доп ключей там не надо при снапе корн пула? типа кнть для рекурсии что бы все что на нем забрало. Достаточно только zfs snapshot pool_name - так?

Vladislav

Vladislav

ОК. СПС. доп ключей там не надо при снапе корн пула? типа кнть для рекурсии что бы все что на нем забрало. Достаточно только zfs snapshot pool_name - так?

Да

https://www.reddit.com/r/zfs/comments/sy3uv9/comment/hxvscei/

https://www.reddit.com/r/homelab/comments/9t2xpu/comment/e8t9yc1/

Sergey

Sergey

Коллеги, может быть есть гуру в zdb? Есть пул из 10 дисков raidz2, ashift=12, создан zvol с блоксайз 32КБ, прописан от начала до конца. Как с помощью zdb посмотреть, как произвольный рекорд 32К разместился на дисках пула?

Fedor

Fedor

почти 2 недели нет ошибки

WARNING: zfs: adding existent segment to range tree (offset=a18422c6000 size=4a000)

при этом ни ребутался, ни модуль не перезагружал

но обновлял пакеты в системе

при этом разработчики вроде как пофиксили несколько причин возникновения, возможно в след релизе уже будет

Илья

Илья

Fedor

Fedor

в теории могли какие-то данные перезаписаться, из-за которых была ошибка

по сути больше ничего

Дмитрий

Дмитрий

Всем привет!

У меня на ZFS в TrueNAS есть Datasets предназначенные для записей с камер видеонаблюдения. Можно ли как-то для них (и только для них) отключить кеш и прочие плюшки? Пока создал только их, а кеш в памяти уже на 8Гб, который никогда (надеюсь) не будет использоваться, там ж только запись идет, а ресурсы на него будут уходить постоянно.

P.S. Пул один, в нем только датасеты.

Алексей

Алексей

Всем привет!

У меня на ZFS в TrueNAS есть Datasets предназначенные для записей с камер видеонаблюдения. Можно ли как-то для них (и только для них) отключить кеш и прочие плюшки? Пока создал только их, а кеш в памяти уже на 8Гб, который никогда (надеюсь) не будет использоваться, там ж только запись идет, а ресурсы на него будут уходить постоянно.

P.S. Пул один, в нем только датасеты.

zfs set primarycache=none poolname/datasetname

Ivan

Ivan

я слегка погуглил и не нашел можно ли указать права на удаление только снапшотов. кто-нибудь знает ?

Ivan

Ivan

чет похоже нет отдельной фичи для удаления только снапов. в вишлистах просят, но запиленой фичи не видно.

Free

Free

На сервере имеется несколько пулов из одиночных дисков.

Один из пулов перешел в состояние SUSPENDED, по ошибкам zpool status показал

errors: List of errors unavailable: pool I/O is currently suspended

zpool clear этого пула приводит к зависанию команды.

После чего вообще любая команда zpool зависает.

По запросу zpool clear hang находятся аналогичные баги, датирванные 2017-18 годом, вызванные, например, кратковременным отключением USB.

У меня соединение по SATA.

lsblk диск видит.

Есть ли способ починить пул или хотя бы восстановить работу команды zpool, не перегружая сервер?

Free

Free

не ужели ты еще не понял что в таких случаях можно только ребутать )))

Ну я так и делаю, но оставалсь надежда, что есть более умные/опытные пользователи 😜.

Free

Free

На сервере имеется несколько пулов из одиночных дисков.

Один из пулов перешел в состояние SUSPENDED, по ошибкам zpool status показал

errors: List of errors unavailable: pool I/O is currently suspended

zpool clear этого пула приводит к зависанию команды.

После чего вообще любая команда zpool зависает.

По запросу zpool clear hang находятся аналогичные баги, датирванные 2017-18 годом, вызванные, например, кратковременным отключением USB.

У меня соединение по SATA.

lsblk диск видит.

Есть ли способ починить пул или хотя бы восстановить работу команды zpool, не перегружая сервер?

Вообще такое поведение команды совершенно неприличное.

Ну не может получить ответ какое-то время - так завершилась бы по таймауту с сообщением об ошибке!

Что по этому поводу разработчики знают?

@gmelikov это известный баг?

Free

Free

не ужели ты еще не понял что в таких случаях можно только ребутать )))

А вообще на этом сервере мучительно две недели уже пофайлово одна нода с ext4 на zfs переносится, дважды уже прерывать перезагрузкой приходилось - и вот опять заново запускать 🤯

Алексей

Алексей

Вообще такое поведение команды совершенно неприличное.

Ну не может получить ответ какое-то время - так завершилась бы по таймауту с сообщением об ошибке!

Что по этому поводу разработчики знают?

@gmelikov это известный баг?

Это известное поведение практически любого линукс софта

Алексей

Алексей

The Join Captcha Bot

The Join Captcha Bot

Eugen

Eugen

Evgeny

Evgeny

Shaker

Shaker