Ivan

Ivan

Free Kopcap unbanned by Ivan!

Когда всё случилось - вот такие были (я их не понял) https://t.me/ru_zfs/71458

Aleks

Aleks

Во еще чего есть, если так и не импортнется в итоге.

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html#zfs-recover

Alex

Alex

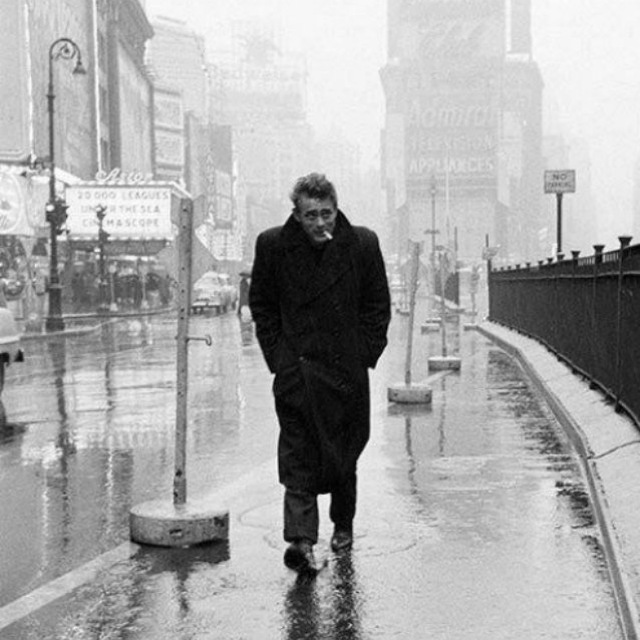

Такую хрень тут поймал на одном хосте. Там собрано два пула - один зеркало, ссд, второй - z1 из шпиндилей. Две недели назад обнаружил, что в обоих вылетело по диску - ну думаю бывает, заменили, забыли. Заодно подкрутили мониторинг... И тут сегодня, прям одновременно - нннааа!

Alex

Alex

``` pool: bigpool

state: DEGRADED

status: One or more devices is currently being resilvered. The pool will

continue to function, possibly in a degraded state.

action: Wait for the resilver to complete.

scan: resilver in progress since Mon Feb 12 16:40:38 2024

335G scanned at 89.6M/s, 130G issued at 34.9M/s, 336G total

2.81G resilvered, 38.88% done, 01:40:13 to go

config:

NAME STATE READ WRITE CKSUM

bigpool DEGRADED 0 0 0

raidz1-0 DEGRADED 9.32K 1.58K 0

spare-0 UNAVAIL 15 148 278 insufficient replicas

c9f4e1b4-e05f-f74e-9a51-0ea73d23a900 FAULTED 7 27 0 too many errors

08399cd7-4f82-8b4b-a9c7-605ce11640ad FAULTED 22 167 0 too many errors (resilvering)

0e49a9f2-0902-3a4e-8833-eaed20790620 DEGRADED 6.69K 1.38K 330 too many errors (resilvering)

7892d48e-4800-8e41-a28f-6a54f068d569 DEGRADED 6.99K 1.41K 255 too many errors (resilvering)

spares

08399cd7-4f82-8b4b-a9c7-605ce11640ad INUSE currently in use

errors: 2 data errors, use '-v' for a list

pool: ssdpool

state: DEGRADED

status: One or more devices are faulted in response to persistent errors.

Sufficient replicas exist for the pool to continue functioning in a

degraded state.

action: Replace the faulted device, or use 'zpool clear' to mark the device

repaired.

scan: resilvered 64.2G in 00:03:01 with 0 errors on Mon Feb 12 16:48:29 2024

config:

NAME STATE READ WRITE CKSUM

ssdpool DEGRADED 0 0 0

mirror-0 DEGRADED 0 0 0

8ae51db9-89d3-464a-8111-e04c2c27eb11 DEGRADED 6 28 4 too many errors

spare-1 DEGRADED 12 5 0

f00a6f06-cec7-de4b-9eed-a080ce8b83e8 FAULTED 9 75 0 too many errors

2ce51aca-a54a-d644-aee8-d82abc8e3be0 ONLINE 9 5 3

spares

2ce51aca-a54a-d644-aee8-d82abc8e3be0 INUSE currently in use```

Ivan

Ivan

Alex

Alex

ощущение, что по серверу вдарили кувалдой... но дядя Женя после игр с гранатами на такое не способен, да и железо стоит в ДЦ с допуском - вариант исключаем.

Alex

Alex

эти пулы прям на дисках сделаны или внутри файлов ? id необычные какие.

просто привязка к partition uuid , чтобы не мучиться, когда линупс жонглирует буквами в sd*

Alex

Alex

не верю, что одномоментно все диски могли так накрыться. При этом zfs, зараза, живет - данные доступны, хотя всю нагрузку я сразу убрал, конечно.

Alex

Alex

Грешу на питание, может не хватило искричества в стойке, бывает. Но там резерв и сдублированны БП, да и в IPMI было бы видно

Δαρθ

Δαρθ

Возможно скажу глупость, но имеет смысл делать uuidы разделов, входящие в одну ФС -- похожими. Например оканчивающимися на 0001 0002 0003 etc

Alex

Alex

Возможно скажу глупость, но имеет смысл делать uuidы разделов, входящие в одну ФС -- похожими. Например оканчивающимися на 0001 0002 0003 etc

меня это сейчас менее всего беспокоит =)

Alex

Alex

да, смарты вроде нормальные. Половину дисков недавно заменили. Правда , вопреки моим крикам, заменили на такие же.. Но админы сказали, что эти ехали в другом грузовике =) Понедельник, мать его.

Vladislav

Vladislav

да, смарты вроде нормальные. Половину дисков недавно заменили. Правда , вопреки моим крикам, заменили на такие же.. Но админы сказали, что эти ехали в другом грузовике =) Понедельник, мать его.

Если смарт в порядке и нет ошибок по кабелю, то проверить стоит hba и не включен ли вручную spindown и включен ли кэш на дисках

Write IO error очень похоже, что либо диски долго справлялись с тем, что на них шло (диски ведь не SMR? Прямо точно?), либо на проблему адаптером

Ivan

Ivan

просто привязка к partition uuid , чтобы не мучиться, когда линупс жонглирует буквами в sd*

привязываться к disk/by-id как-то наглядней и привычней.

Xash

Xash

``` pool: bigpool

state: DEGRADED

status: One or more devices is currently being resilvered. The pool will

continue to function, possibly in a degraded state.

action: Wait for the resilver to complete.

scan: resilver in progress since Mon Feb 12 16:40:38 2024

335G scanned at 89.6M/s, 130G issued at 34.9M/s, 336G total

2.81G resilvered, 38.88% done, 01:40:13 to go

config:

NAME STATE READ WRITE CKSUM

bigpool DEGRADED 0 0 0

raidz1-0 DEGRADED 9.32K 1.58K 0

spare-0 UNAVAIL 15 148 278 insufficient replicas

c9f4e1b4-e05f-f74e-9a51-0ea73d23a900 FAULTED 7 27 0 too many errors

08399cd7-4f82-8b4b-a9c7-605ce11640ad FAULTED 22 167 0 too many errors (resilvering)

0e49a9f2-0902-3a4e-8833-eaed20790620 DEGRADED 6.69K 1.38K 330 too many errors (resilvering)

7892d48e-4800-8e41-a28f-6a54f068d569 DEGRADED 6.99K 1.41K 255 too many errors (resilvering)

spares

08399cd7-4f82-8b4b-a9c7-605ce11640ad INUSE currently in use

errors: 2 data errors, use '-v' for a list

pool: ssdpool

state: DEGRADED

status: One or more devices are faulted in response to persistent errors.

Sufficient replicas exist for the pool to continue functioning in a

degraded state.

action: Replace the faulted device, or use 'zpool clear' to mark the device

repaired.

scan: resilvered 64.2G in 00:03:01 with 0 errors on Mon Feb 12 16:48:29 2024

config:

NAME STATE READ WRITE CKSUM

ssdpool DEGRADED 0 0 0

mirror-0 DEGRADED 0 0 0

8ae51db9-89d3-464a-8111-e04c2c27eb11 DEGRADED 6 28 4 too many errors

spare-1 DEGRADED 12 5 0

f00a6f06-cec7-de4b-9eed-a080ce8b83e8 FAULTED 9 75 0 too many errors

2ce51aca-a54a-d644-aee8-d82abc8e3be0 ONLINE 9 5 3

spares

2ce51aca-a54a-d644-aee8-d82abc8e3be0 INUSE currently in use```

Угу угу. Я вначале на такое тоже напарывался. В сислоге посмотри что там было с дисками, если получится. Я в итоге на мдадме сидел поэтому.

Тоже самое было. Не понятно абсолютно. Диски в целом при том норм, память ecc

Free

Free

Когда всё случилось - вот такие были (я их не понял) https://t.me/ru_zfs/71458

Спасибо за разбан и цитату.

А вот меня именно за ссылку на это сообщение бот и забанил 😡

Alex

Alex

Если смарт в порядке и нет ошибок по кабелю, то проверить стоит hba и не включен ли вручную spindown и включен ли кэш на дисках

Write IO error очень похоже, что либо диски долго справлялись с тем, что на них шло (диски ведь не SMR? Прямо точно?), либо на проблему адаптером

Ну если проблема с кабелем, то сразу с пятью минимум и одновременно.

Кэш на дисках не может приводить к такому аду, никак.

SSD SMR? не слышал о таком, хотелось бы это видеть =)

Да, грешу на hba. Всё на них сходится. Но удаленно увы, ничего не видать - надо вскрывать тело

Alex

Alex

привязываться к disk/by-id как-то наглядней и привычней.

"я не говорил - берите пример с меня" (с) =)

меня спросили почему - я ответил почему.

Vladislav

Vladislav

Ну если проблема с кабелем, то сразу с пятью минимум и одновременно.

Кэш на дисках не может приводить к такому аду, никак.

SSD SMR? не слышал о таком, хотелось бы это видеть =)

Да, грешу на hba. Всё на них сходится. Но удаленно увы, ничего не видать - надо вскрывать тело

Так я смотрел что ли какие диски? Модель Вы так и не указали в явном виде

Как и активный или пассивный у Вас бэкплейн

Рад, что снова вытаскивать клещами инфу про устройство сервера

Если там ssd, то выбор zfs для меня ещё более непонятен, но ладно, проблемы Ваши

Если у Вас разом выпали несколько ссд - то либо бэкплейн, либо хба

Alex

Alex

Так я смотрел что ли какие диски? Модель Вы так и не указали в явном виде

Как и активный или пассивный у Вас бэкплейн

Рад, что снова вытаскивать клещами инфу про устройство сервера

Если там ssd, то выбор zfs для меня ещё более непонятен, но ладно, проблемы Ваши

Если у Вас разом выпали несколько ссд - то либо бэкплейн, либо хба

"Такую хрень тут поймал на одном хосте. Там собрано два пула - один зеркало, ссд,"

русским по белому - ссд

Vladislav

Vladislav

Alex

Alex

> Если там ssd, то выбор zfs для меня ещё более непонятен

seriously? =))) тогда можете не отвечать

Alex

Alex

Типично, сперва насрал теперь не может даже сформулировать запрос нормально

Блин, вот знал, что здесь ты будешь.. =) ладно, хоть что-то повеселит меня сегодня

Vladislav

Vladislav

Блин, вот знал, что здесь ты будешь.. =) ладно, хоть что-то повеселит меня сегодня

*спрашивают инфу про сервер*

*Не ну ты хорошо повеселил*

Xash

Xash

Выпадение дисков это конечно такое. Проблема у меня вроде бы решилась, потому что надо чтобы хотя бы с полгода это поработало, потому вроде.

И вот что у меня.

Массив на двух контроллерах был - часть из адаптека, часть из интела. Я собрал пулы по контроллерам четко - вроде больше нет такого.

Xash

Xash

Zfs не быстр. Но рабочий пул на ssd. Потому скорость норм. Но ниже минимум в 2 раза в сравнении с mdadm

Free

Free

жди

👌И ведь дождался!

Хотя надежды уже и не было после 10 часов ожидания!

Всё это время nmon показывал 100% загрузку диска на чтение.

Я был уверен, что что-то там зависло.

А вот сейчас диск освободился и пул появился.👍

Причем без каких-либо ошибок

root@sk-UbuntuGame:~# zpool import -d /dev/disk/by-id/ -f -FX s22

root@sk-UbuntuGame:~# zpool status -v s22

pool: s22

state: ONLINE

config:

NAME STATE READ WRITE CKSUM

s22 ONLINE 0 0 0

ata-ST18000NM000J-2TV103_WR501MCY ONLINE 0 0 0

errors: No known data errors

Алексей

Алексей

Станислав

Станислав

👌И ведь дождался!

Хотя надежды уже и не было после 10 часов ожидания!

Всё это время nmon показывал 100% загрузку диска на чтение.

Я был уверен, что что-то там зависло.

А вот сейчас диск освободился и пул появился.👍

Причем без каких-либо ошибок

root@sk-UbuntuGame:~# zpool import -d /dev/disk/by-id/ -f -FX s22

root@sk-UbuntuGame:~# zpool status -v s22

pool: s22

state: ONLINE

config:

NAME STATE READ WRITE CKSUM

s22 ONLINE 0 0 0

ata-ST18000NM000J-2TV103_WR501MCY ONLINE 0 0 0

errors: No known data errors

А вы говорили данные зфс потерял) Он ух уговаривал вернуться

Free

Free

Так и чего, с ключом fx то не помогает?

zpool import -d /dev/disk/by-id/ -f -FX -o readonly=on s22

Вот -X до этого не пробовал - только -F раньше делал.

PS Команду этой рекомендации успел отправить ДО её редактирования, без readonly

Aleks

Aleks

он искал чё там можно откатить значит. я думал вы следили за активностью диска, раз говорили, что команда зависла )

Free

Free

он искал чё там можно откатить значит. я думал вы следили за активностью диска, раз говорили, что команда зависла )

Зависание ведь было не только в этом терминале, но и в других сессиях (даже если я указывал другой пул в zpool status - то есть к s22 не должно было быть обращений). И zfs тоже зависала.

George

George

Алексей

Алексей

Алексей

Алексей

коэффициент полезности 1 к 8.

на 8 бесполезных действий записи ушатывающих ресурс выдается одно полезное 😅

Vladislav

Vladislav

В идеале бы конечно будь у ZFS полноценный writeback кэш, когда ты можешь дать 2ТБ pcie 4.0 U.2 и сказать

ВСЯ запись идёт сюда, потом с неё уже заливай на HDD

Ivan

Ivan

там оператива дешевле ссд выходит, 6тб arc собрать и нормально

а если потребуется быстро писать ?

Georg🎞️🎥

Georg🎞️🎥

там оператива дешевле ссд выходит, 6тб arc собрать и нормально

6 не даст на ddr3, 6 на ddr4 уже

Denis

Denis

Всем привет! Подскажите, как лучше организовать хранилище на 12ТВ?

Есть мысль сделать на hdd+ ssd кеш

Zfs еще не использовал и не щупал, планирую попробовать

Artem

Artem

Всем привет! Подскажите, как лучше организовать хранилище на 12ТВ?

Есть мысль сделать на hdd+ ssd кеш

Zfs еще не использовал и не щупал, планирую попробовать

Самый простой вариант - парочку 16Tb ssd в зеркале 😂

PS: Какие требования, такой и ответ

Xash

Xash

Всем привет! Подскажите, как лучше организовать хранилище на 12ТВ?

Есть мысль сделать на hdd+ ssd кеш

Zfs еще не использовал и не щупал, планирую попробовать

Скорость важна критично? - mdadm xfs raid10 или 6.

Не критична скорость - zfs raidz 3.

По кешу, если есть SSD с большим ресурсом на перезапись юзай.

Denis

Denis

У меня raidz1, но я реплицирую. Это самый обычный кейс. Один диск может подохнуть.

Подскажите пожалуйста, Что значит реплицирую?

Vladislav

Vladislav

Поставьте truenas

Поверьте, не надо лезть в консоль Вам, truenas прекрасно подойдёт для того, что Вы хотите сделать

Xash

Xash

Подскажите пожалуйста, Что значит реплицирую?

Клонируешь по сети что то. Датасеть или полностью пул по сети

Denis

Denis

Поставьте truenas

Поверьте, не надо лезть в консоль Вам, truenas прекрасно подойдёт для того, что Вы хотите сделать

Была такая мысль, но хочется поковыряться и разобраться

Vladislav

Vladislav

Была такая мысль, но хочется поковыряться и разобраться

Тогда сперва прочтите ссылки из 4 поста в закрепе

Group Butler

Group Butler