Так а толку от того, что ФС цела, если данных не осталось из 300Гб?

Я очень долгое время работаю с zfs и что я только не делал, и с одиночными накопителями и с zfs поверх zvol и с ecc и без ecc и даже на углюченных компьютерах.

И по результатам моего опыта вся ваша история выглядит очень сомнительно.

Скорее я поверю в вашу ошибку: zfs создали на одном устройстве, а ищете на другом или сами де перезаписали fs на устройстве после или во время записи данных.

Станислав

Станислав

Vladislav

Vladislav

Я очень долгое время работаю с zfs и что я только не делал, и с одиночными накопителями и с zfs поверх zvol и с ecc и без ecc и даже на углюченных компьютерах.

И по результатам моего опыта вся ваша история выглядит очень сомнительно.

Скорее я поверю в вашу ошибку: zfs создали на одном устройстве, а ищете на другом или сами де перезаписали fs на устройстве после или во время записи данных.

Ну суть подобных ошибок как раз в непредсказуемости

Free

Free

Я очень долгое время работаю с zfs и что я только не делал, и с одиночными накопителями и с zfs поверх zvol и с ecc и без ecc и даже на углюченных компьютерах.

И по результатам моего опыта вся ваша история выглядит очень сомнительно.

Скорее я поверю в вашу ошибку: zfs создали на одном устройстве, а ищете на другом или сами де перезаписали fs на устройстве после или во время записи данных.

Если это про мою "пропажу" пула - то ваше предположение не верно.

Я ведь писал, чем закончилось: импорт с ключами -FX позволил "найти" и восстановить пул

riv

riv

Если это про мою "пропажу" пула - то ваше предположение не верно.

Я ведь писал, чем закончилось: импорт с ключами -FX позволил "найти" и восстановить пул

Вам надо знать, что подобный импорт может сделать пул нестабильным. Лучше всего скопировать с него данные, а пул пересоздать. Если данные не копируются через zfs send -R ... | zfs receive ... По причине ошибок чтения или ошибок контрольных сумм, то можно временно разрешить пересылать поврежденные даныые через установку параметра модуля zfs. Это можно сделать "на лету".

У меня есть ещё идея, что могло произойти. zfs разработана для работы с серверными накопителями. Их особенностью является то, что они никогда не создают ситуацию с timeout операций чтения и записи. Например, встречая нечитаемые данные, накопитель просто сообщает об ошибке чтения.

У вас мог быть накопитель с типом записи smr а не cmr. Smr-накопители могут надолго - десятки минут уходить в астрал, накопив большое количество данных для записи во внутреннем буфере. Потенциально это может вызвать недозапись несколтких ГБ данных.

SMR-накопители - это обсалютное зло, их нельзя использовать в zfs, а по моему мнению вообще нигде.

Производители стараются скрыть факт использования технологии smr. При потерях данных, они говорят, что дескать их накопители расчитаны только на бытовые нагрузки, хотя непрерывное заполнение накопителя данными и есть бытовая нагрузка. Тем не менее, производители считают что при потере данных smr-дисксми по причине их зависания при интенсивной продолжительной записи допустимо, а для кого не допустимо, мол пусть серверные покупают. Позиция, на мой взгляд, конченых ублюдков.

riv

riv

Ну суть подобных ошибок как раз в непредсказуемости

Посмотрите выше на ещё одно предположение. Таких гепредскащуемвх ошибок на роаном месте за всю историю эксплуатации zfs я не встречал. А эксплуатирую я zfs активно и на серверах и на десктопах

Алексей

Алексей

Vladislav

Vladislav

Vladislav

Vladislav

Есть люди, которые используют zfs на файлах на обычном компе поверх аппаратного рейда, и у них тоже все норм

Vladislav

Vladislav

Вот у меня всё норм было, что я zfs держал поверх 5-ого рейда (p420)

Говорю ли я теперь, что это значит, что это ок? Нет конечно

Vladislav

Vladislav

ну так то у нас у всех тут личный опыт, которым все и делятся...

Да, но и отрицать вероятность на основе личного опыта немного неправильно

riv

riv

Есть люди, которые используют zfs на файлах на обычном компе поверх аппаратного рейда, и у них тоже все норм

Вот как раз мой личный опыт показывает что использовать zfs поверх рейда - значит снизить надёжность zfs до уровня надёжности рейда, как минимум. А надёжен ли аппаратный рейд? Вполне, пока диски новые и работают илеально. Если диски работают не идеально, то аппаратный рейд опасен, а zfs в таких условиях без raid всеравно надёжен. Вот о чем говорят разработчики, заявляя что надо избегать аппаратных raid-массивов. Конечно, могут быть всевозможные дополнительные тонкие эфыекты, но это уже маловероятно. А вот вслучае упомянутых проблем с аппаратным рейдом, zfs вам никак не поможет.

жюн

жюн

Есть люди, которые используют zfs на файлах на обычном компе поверх аппаратного рейда, и у них тоже все норм

есть люди, которые гвозди в розетку совали и выжили

жюн

жюн

интернет устроен так, что о факапах своих почти не пишут:

можно найти примеры, где zfs поверх железного рейда норм работает

но вот найти примеры людей, где в такой схеме всё развалилось - постараться надо

riv

riv

Есть люди, которые используют zfs на файлах на обычном компе поверх аппаратного рейда, и у них тоже все норм

Вы понимаете, с аппаратным рейдом я неоднократно сталкивался, например с такой проблемой: диск один или оба в зеркале отлают кривые данные - не то что на них записано и рейд это не видит, накапливаются silent corruption в файлах пока не падает фс или база данных какая-нибудь. К этому моменты во всех бекапах уже давно кривые данные. И вы даже не узнаете об этой ситуации.

Zfs в этой же ситуации, но не поверх аппаратного рейда, вас во первых предупредит, во вторых, в 99.9% случаев позволит вытащить данные с двух поврежденных дисков. Ошибку чтения допустит только при наличие ошибок на обоих дисков по одинаковым lba-адресам. Но и в этом случае, во первых таких ошибок будет в десятки тысяч раз меньше чем количество ошибок на дисках, во вторых, их будет видно, а в случае zfs fs (а не zvol) вы увидите в каком файле повреждения, а какие файлы целые.

Короче, несмотря на ваше заявление, размещать zfs поверх рейда контрпролуктивно

riv

riv

интернет устроен так, что о факапах своих почти не пишут:

можно найти примеры, где zfs поверх железного рейда норм работает

но вот найти примеры людей, где в такой схеме всё развалилось - постараться надо

Это вопрос времени. Как диски устанут, так и развалится. Хотя раскажет при пеовых же ошибках, если у вас настроен мониторинг. Так что ситуация это точно не редкая, искать не надо.

Тут надо сделать оговорку, что развалится значит будут ошибки чтения. Так чтоб напроч убилась, надо чтобы рейд глючил. Но вот в этом случае тоже запросто. У меня было так с глючашим hba, перегревался и диски зависали. Zfs продержался несколько лет на нем с переодическими перезагрузками, но однажды не примонтировался. Сильно не упорствовали, восстановили с бекапа.

жюн

жюн

Это вопрос времени. Как диски устанут, так и развалится. Хотя раскажет при пеовых же ошибках, если у вас настроен мониторинг. Так что ситуация это точно не редкая, искать не надо.

Тут надо сделать оговорку, что развалится значит будут ошибки чтения. Так чтоб напроч убилась, надо чтобы рейд глючил. Но вот в этом случае тоже запросто. У меня было так с глючашим hba, перегревался и диски зависали. Zfs продержался несколько лет на нем с переодическими перезагрузками, но однажды не примонтировался. Сильно не упорствовали, восстановили с бекапа.

Та не, мой посыл о том был, что куча статей в интернетиках, как разные сорта говна исправно работают, но почти нет статей, где это говно через время разваливается

А оно обязательно разваливается.

Никита

Никита

Народ, если помрёт диск с l2arc кэшем у ZFS данные в пуле будут живы или zfs не хранит в пуле то, что в кэше?

жюн

жюн

есть твои данные, zfs далает вид, что умная, и копирует самые юзабельные данные в arc (оперативную память)

когда arc кончается, то самые неюзабельные в нём данные перемещаются из arc в l2arc

Никита

Никита

Vladislav

Vladislav

Vladislav

Vladislav

есть люди, которые гвозди в розетку совали и выжили

О чём и речь!

Говорить, что у ZFS не может быть проблем как у Free Corsair из-за не ECC памяти - полагаясь на то, что у тебя всё работает - неправильно

Vladislav

Vladislav

никто и не отрицал

Ну не скажи, @Riv1329 вполне не согласен с тем, что не ECC память могла сломать массив

riv

riv

Ну не скажи, @Riv1329 вполне не согласен с тем, что не ECC память могла сломать массив

Кстати, бывает так что пк с глючащей памятью работает нормально, но изредка зависает. А всё дело в том, что прото не выделяются глючащие блоки, если они не в начале адресного пространства. Но при копировании большого количества данных, любая фс сыпится.

Отличительный признак таких пк, если создать пару десятков файлов со случайным, но одинаковым собержимым, размером гигов по 10-20, то при чтении у них будут разные контрольные суммы.

Vladislav

Vladislav

Кстати, бывает так что пк с глючащей памятью работает нормально, но изредка зависает. А всё дело в том, что прото не выделяются глючащие блоки, если они не в начале адресного пространства. Но при копировании большого количества данных, любая фс сыпится.

Отличительный признак таких пк, если создать пару десятков файлов со случайным, но одинаковым собержимым, размером гигов по 10-20, то при чтении у них будут разные контрольные суммы.

У меня был опыт, когда ECC память умирала (буквально, она просто не справлялась с количеством ошибок) и уносила за собой всю ОС, через 1,2..6 дней, я почти 3 недели потратил на то, чтобы понять где проблема была, в итоге поменял процы + память

А по тому что Вы говорите - да, это покажет проблему с памятью

Nikita

Nikita

а вот по refs чатиков нет, там всё норм

не норм. на Storage Spaces стоит, каждую вторую перезагрузку монтируется, как raw. особенно это доставляет, когда сервер находит обновление и решает ребутнуться в ночи, а утром "дратути". На technet уже лет 5 мой пост об этом висит.

Nikita

Nikita

если у вас серверная винда находит обновы и сама ребуится - вы что-то делаете не так

ну не то, чтобы совсем сама... там сложная цепочка событий получается, но внезапности это не отменяет. Особенно поначалу весело было.

Ivan

Ivan

Ivan

Ivan

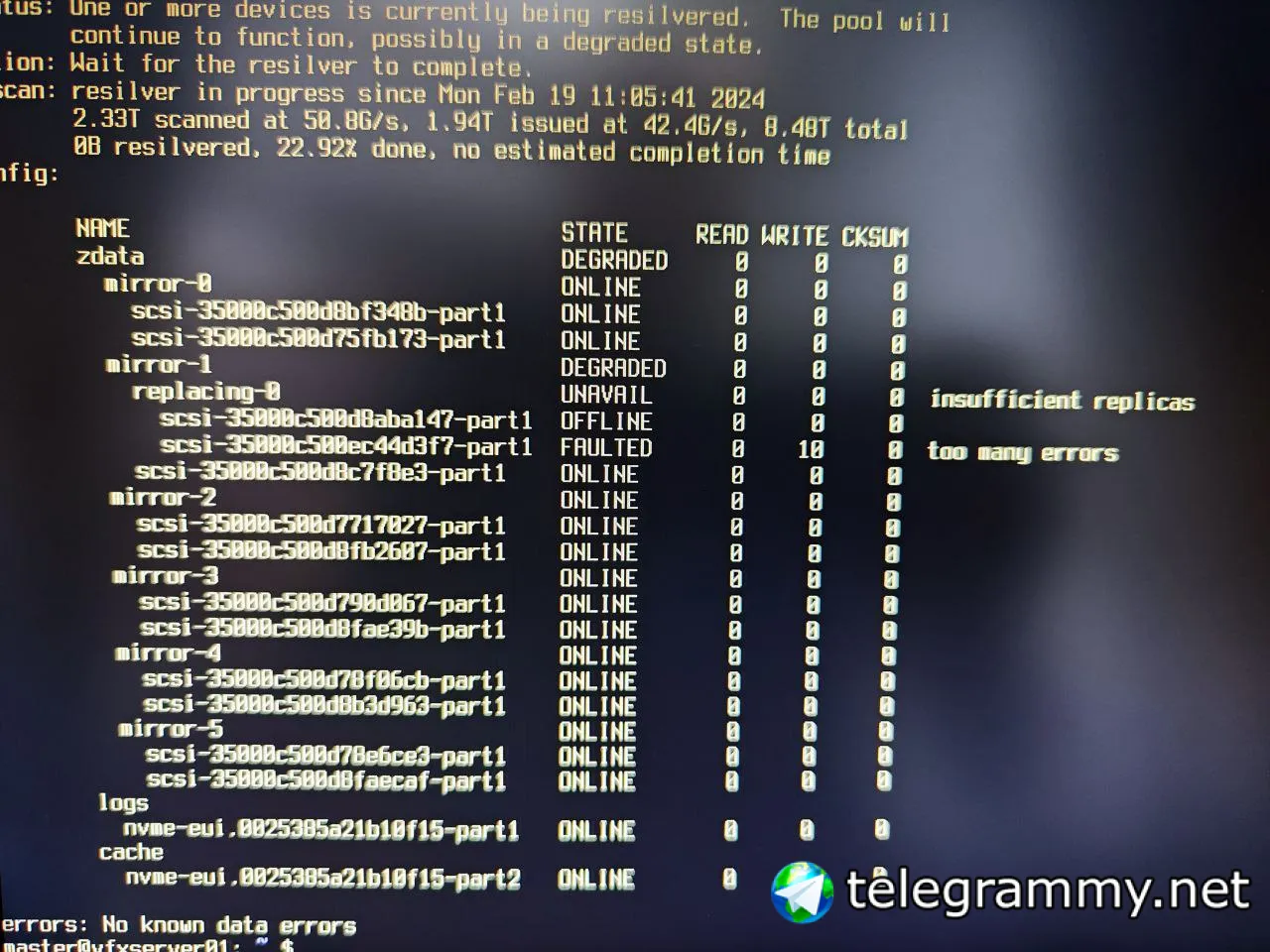

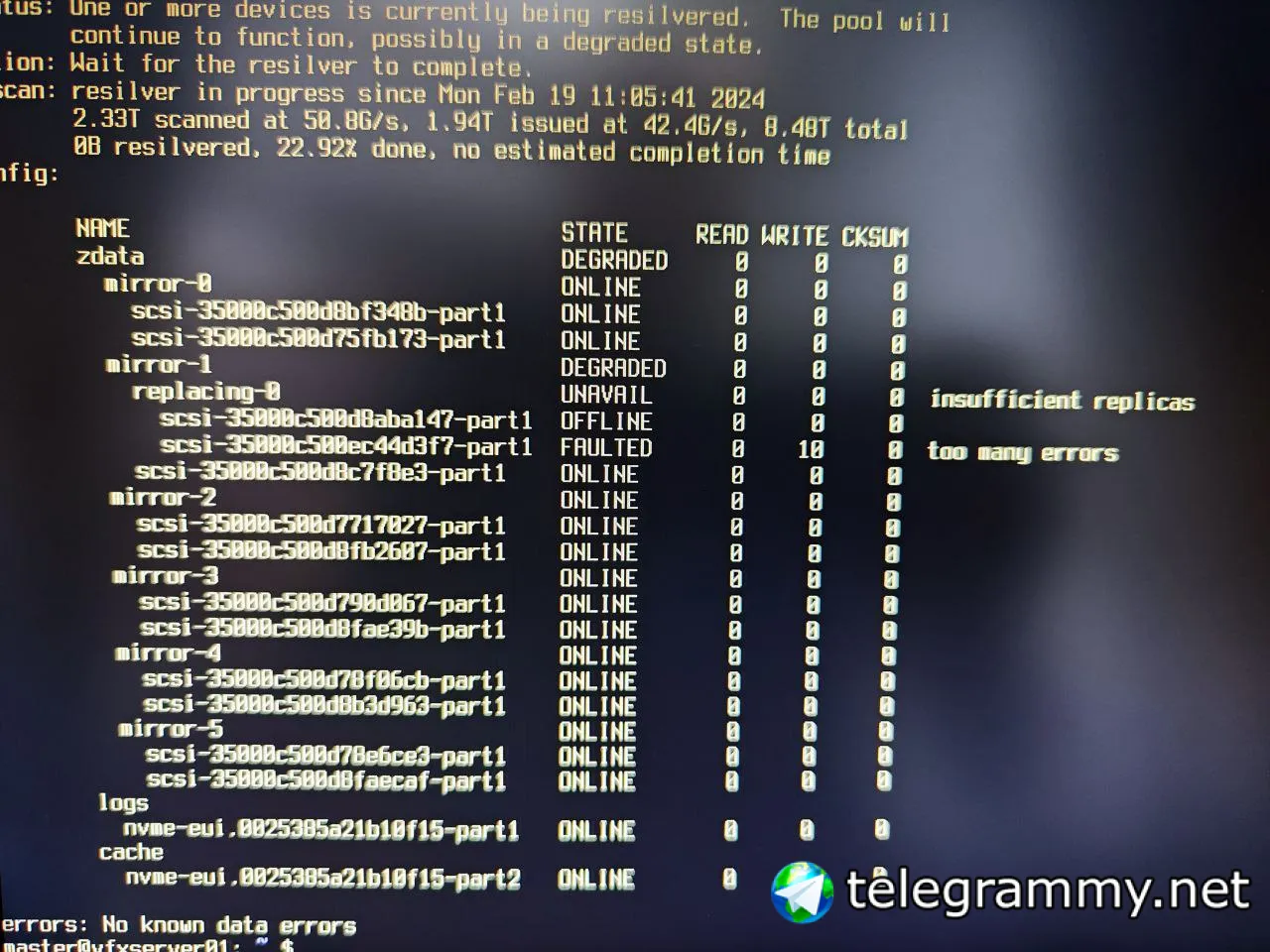

Как думаете, что это может означать? Подменный диск абсолютно новый.

проблемы с кабелем/портом/питанием

Xash

Xash

Меня вообще это все настолько задрало, что перешел на основных массивах на zfs ssd.

Есть у меня массивы которые норм на hdd. Но много необъяснимого, вот ставишь новейший диск - хопа какая то шняга. Массив с нуля пересоздаешь и заливаешь данные обратно. Вытаскиваешь сбойный диск, проверяешь - все гуд.

Ivan

Ivan

проблемы с кабелем/портом/питанием

Но тогда по идее бы и все аналогичные диски выдали бы ошибку, те что подключены по этому кабелю. У меня в серваке бэкплейн и там 3 кабеля SFF идут от бэкплейна на HBA

Ivan

Ivan

Y

Y

Ivan

Ivan

вообще конфигурация так себе... йопсов всего в 6 раз больше а рика много если нет бэкапов

Бэкапы есть. Но если честно не могу представить конфу более оптимальную по соотношению иопсам и риску

Y

Y

Бэкапы есть. Но если честно не могу представить конфу более оптимальную по соотношению иопсам и риску

ну если надо на весь объем то да .. а так я сделал всё мелкое на спешл вдев... + л2арк

Ivan

Ivan

ну если надо на весь объем то да .. а так я сделал всё мелкое на спешл вдев... + л2арк

Ну про спешал вдев я думал

Vladislav

Vladislav

Ааа, понял! Спасибо. Пойду поменяю для начала ))

Как же грустно, когда вроде книжки читал, а базовых вещей так и не узнал

Ivan

Ivan

Как же грустно, когда вроде книжки читал, а базовых вещей так и не узнал

А нахер пойти не хотите?

Vladislav

Vladislav

Бэкапы есть. Но если честно не могу представить конфу более оптимальную по соотношению иопсам и риску

А как считали риски? По какой формуле? Вероятность выхода из строя диска как высчитывали? А время на износ считали? А память ecc используете? А аварию симулировали?

Ivan

Ivan

А как считали риски? По какой формуле? Вероятность выхода из строя диска как высчитывали? А время на износ считали? А память ecc используете? А аварию симулировали?

Я уже сказал, и направил вас в нужном направлении. Не вижу смысла в общении с вами конкретно. От ваших советов толку никогда не было. По сему не вижу смысла.

Ivan

Ivan

Как же грустно, когда вроде книжки читал, а базовых вещей так и не узнал

без конкретных претензий совсем бесполезная токсичность выходит.

Vladislav

Vladislav

Я уже сказал, и направил вас в нужном направлении. Не вижу смысла в общении с вами конкретно. От ваших советов толку никогда не было. По сему не вижу смысла.

А от Ваших вопросов общий уровень интеллекта в чате падает, но никто же не посылает Вас

Vladislav

Vladislav

без конкретных претензий совсем бесполезная токсичность выходит.

Конкретные вопросы в сообщении пониже

Vladislav

Vladislav

Но люди не склонны отвечать на них, потому я сразу перешёл к финальным сообщениям с переходом на личности

Vladislav

Vladislav

Ибо за пару месяцев человек так и не выучил какая информация нужна для того, чтобы понять возможную проблему

Ivan

Ivan

бывает что при всех своих знаниях и умениях человек пропускает банальную мысль. чат для того чтобы помогать друг другу, а не упражняться в том кто кого круче.

Vladislav

Vladislav

Ivan

Ivan

Ни описания стенда

Ни сервера

Ни какая память

Ни модель дисков

Ни какой hba

в целом конечно полезно иметь шаблон, который требуется заполнить для вопроса. как на гитлабе/хабе сделано.

Vladislav

Vladislav

Ты вполне наблюдал разницу в отношении с моей стороны между теми кто пишет адекватный вопрос и теми кто заходит жопой вперёд

Vladislav

Vladislav

не надо так, с оскорблениями чат лучше не становится.

И этот гражданин ещё ни разу не зашёл не жопой вперёд, наоборот, ещё в первый раз, когда ему пытались помочь он просто слал и не отвечал на вопросы

Ivan

Ivan

не надо так, с оскорблениями чат лучше не становится.

Боюсь что проблема в том, что с данным персонажем просто еще не общались по-мужски. Вот он и позволяет себе подобные вещи.

central

central

Group Butler

Group Butler