Что такое троттлинг?

vfz.zfs.l2arc_write_max

Вы бы хоть почитали про то как он работает

Вадим «Дым» Илларионов ☭

Вадим «Дым» Илларионов ☭

И у эппл, и у линукс свои плюсы и минусы. Тут чат не про это.

У аккумуляторов та же фигня. :)

Вадим «Дым» Илларионов ☭

Вадим «Дым» Илларионов ☭

Extfat относится к семейству fat, но это так, для справки

Нет, перечитайте справку. exFAT — это про фат. А эксТ№ — "этадгугоэ же!" 😄

Fedor

Fedor

Вот кстати, интересно, планируется хотя бы теоретически, у разрабов openzfs дефрагментация?

Нет, там другие принципы хранения данных. В худшем случае нормы они фрагментированы всегда

Fedor

Fedor

Дефрагментация может иметь смысл только при линейном способе хранения данных и линейном чтении.

Δαρθ

Δαρθ

Нет, там другие принципы хранения данных. В худшем случае нормы они фрагментированы всегда

В смысле другие, не на блочном устройстве что ли? :)

Δαρθ

Δαρθ

Дефрагментация может иметь смысл только при линейном способе хранения данных и линейном чтении.

Ну вот если я хочу читать файл быстро, а зфс его раскидало буквально по всему диску, от начала до конца, то дефраг бы ускорил чтение файлов на холодную

Alexander

Alexander

Понятно, что с чтением у zfs все не так хорошо, но в 2+ раза хуже записи? Стоит еще дальше пытаться настраивать, как думаете? Или плюнуть уже...

Для сравнения - на mdraid 7-дисковый страйп с 1М chunk пишет-читает примерно одинаково 900МБ/с

Vladislav

Vladislav

Ну вот если я хочу читать файл быстро, а зфс его раскидало буквально по всему диску, от начала до конца, то дефраг бы ускорил чтение файлов на холодную

Ускорило бы да, но для этого надо сделать полную перезапись всего пула, тут у RaidZ такого нет, а Вы про пул

Vladislav

Vladislav

Для сравнения - на mdraid 7-дисковый страйп с 1М chunk пишет-читает примерно одинаково 900МБ/с

Я поэтому и спрашивал, Вам надёжность или скорость

Alexander

Alexander

Я поэтому и спрашивал, Вам надёжность или скорость

А почему нельзя на zfs надежно читать с 7 дисков данных потоково большим блоком 700 МБ/с?

Vladislav

Vladislav

Vladislav

Vladislav

Вообще, по идее, если сделать send | receive на чистый пул (с нужными флагами, которые надо смотреть в доке) - это решит проблему дефрага текущего

Fedor

Fedor

А в чём проблемы?

При большинстве сценариев данные фрагментируются снова. И эта фрагментация является ожидаемлй нормой для зфс.

Fedor

Fedor

Как Владислав уточнил выше, только с нуля записанный пул без последующей перезаписи на него будет иметь видимость дефрагментированного

Fedor

Fedor

А так - зфс не про линейность, не про скорость без настройки под задачу и не про дефранментацию

Δαρθ

Δαρθ

Fedor

Fedor

Ближайший похожий по поведению и функционалу - это лвм, там и линейность есть, но нет множества плюшек. Если там присутствует достаточный для задачи функционал и требуется максималка потскорости - лучще посмотреть на неё

Δαρθ

Δαρθ

При большинстве сценариев данные фрагментируются снова. И эта фрагментация является ожидаемлй нормой для зфс.

И тем не менее дефраг есть в ext4, xfs, btrfs (и хз где ещё)

Fedor

Fedor

Потому что, как написано выше, они обычно располагаются на линейных носителях, и там это даёт эффект. У них нет всяких cow и подобных.

Зфс больше похожа на бд с мультиверсионностью, почему для бд нет дефрагментации?

Alexander

Alexander

Для сравнения - на mdraid 7-дисковый страйп с 1М chunk пишет-читает примерно одинаково 900МБ/с

Для сравнения - 7-дисковый raidz1 пишет 650 МБ/с читает 380МБ/с. prefetch hit = 0%. 300 операций впустую. Отсюда и разница в скорости записи и чтения кмк. Соответственно вопрос - почему префетч на одной потоковой задаче чтения 0% и как это исправить.

Δαρθ

Δαρθ

Потому что, как написано выше, они обычно располагаются на линейных носителях, и там это даёт эффект. У них нет всяких cow и подобных.

Зфс больше похожа на бд с мультиверсионностью, почему для бд нет дефрагментации?

для btrfs есть, да и для бд часто бывают какие-то там оптимизации/затыкания дыр и т.д.

Vladislav

Vladislav

Vladislav

Vladislav

Есть советы конкретные? Если нет - спасибо

А смысл, если Вы не читаете? Может сперва сами поработаете над тюнингом?

Alexander

Alexander

Плюс 16гб рама под Арк на, сколько там Тб места?

Еще раз - в реальной жизни там 100000 файлов по 12МБ. Сколько тогда надо памяти, умник?

Vladislav

Vladislav

Vladislav

Vladislav

Вы хотите надёжности, но не хотите платить скоростью или стараниями или финансово

Не хотите l2arc использовать и тюнить не хотите под Ваши задачи

Alexander

Alexander

Посчитайте

Послушайте товарищ, вы надоели лично мне уже. Прошу вас не отвечать на мои сообщения

Vladislav

Vladislav

Послушайте товарищ, вы надоели лично мне уже. Прошу вас не отвечать на мои сообщения

Так выйдете из чата? :) я же не в личку Вам пишу

Vladislav

Vladislav

Не хотите - не слушайте и ждите пока толерантные к "хамству и желанию быстрого получения решения без собственного развития" люди придут и помогут

Vladislav

Vladislav

Но дяяя, сотни тысяч файлов по 12мб, это ведь целых 10 ТЕРРАБАЙТ (максимум)! Вах, действительно, никакого l2arc не хватит

Vladislav

Vladislav

Послушайте товарищ, вы надоели лично мне уже. Прошу вас не отвечать на мои сообщения

Даже такого не хватит

Кот Матроскин

Кот Матроскин

Станислав

Станислав

https://searchengines.guru/ru/forum/1088210

?

We regret to inform you that due to the tense geopolitical situation with Russia, we will be ending our contractual relationship with customers from Russia.

Political decisions have led to changes in the legal regulations that affect our business with Russian-based customers. Unfortunately, we can no longer have contracts with customers with Russian postal addresses. This will affect everyone with a Russian address stored on Hetzner Accounts.

After we analyze the customer databases, we will send the affected customers a notice of termination for all products and services on Friday, 15 December 2023. It will take effect from 31 January 2024. We recommend that you take appropriate measures now.

We very much regret the inconvenience, ask for your understanding in this challenging situation, and thank you for your continued cooperation.

We will answer any questions you may have. Please write to us by logging onto your account on our administration interface and going to “Support” in the menu.

Kind regards

Hetzner Online

Vladislav

Vladislav

Ivan

Ivan

М? А разве Хентзнер предоставлял услуги Ру сегменту после начала СВО?

Думаю стали чуть лучше проверять своих клиентов.

Вадим «Дым» Илларионов ☭

Вадим «Дым» Илларионов ☭

Но дяяя, сотни тысяч файлов по 12мб, это ведь целых 10 ТЕРРАБАЙТ (максимум)! Вах, действительно, никакого l2arc не хватит

теРРа — это земля. А триллион — это теРа. :)

Ivan

Ivan

Ребята, подскажите пожалуйста. Я добавил юзеру возможность, создавать, монтировать и уничтожать датасеты внутри другого датасета через zfs allow -u user create,mount,destroy ztest01/dataset01

Если я далее юзером делаю zfs create ztest01/dataset01/testset то получаю сообщение, что сет создан, но примонтировать его может только root. Подскажите, я какие-то ещё права не дал, что ли? Не могу понять

Fedor

Fedor

Не разбирал вопрос, отличается ли маунт зфс от маунта любых других точек монтирования.

Если не отличается, то можно посмотреть тут

https://man7.org/linux/man-pages/man2/mount.2.html

Appropriate privilege (Linux: the CAP_SYS_ADMIN capability) is

required to mount filesystems

Vladislav

Vladislav

"As iXsystems has not been able to replicate the behavior over SMB, NFS, or iSCSI, users who make use of TrueNAS for regular file or block storage operations are unlikely to be impacted."

А баг не такой проблемный как я думал однако (это всё в тему истории про 2.2.0)

Free

Free

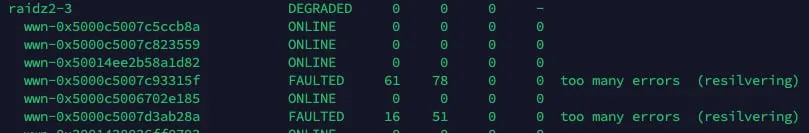

❓Можно ли изменить (не знаю какой) параметр zfs, определяющий количество ошибок, после которого устройство переходит в статус FAULTED ❓

Нагуглил только, что clear помогает, но через некоторое время снова диск отключается.

Помогите продержать в коме умирающий пул, пока из него данные выкачиваются.

Пул raidz2 полудохлый, выкачиваю из него данные send/recv, но медленно, скорость вначале 80-90 MiB/s, потом до 20-30 падает на длинном промежутке. Все другие задачи с пула снял.

Проблема в том, что на одном из vdev два диска сбоят, появляются ошибки READ/WRITE, после небольшого количество которых диски помечается как FAULTED.

Пишут, что их отключает сама zfs, когда считает, что ошибок слишком много.

Боюсь, что такое случится с каким-нибудь еще диском, и тогда весть пул FAULTED. Пусть лучше выдают пока ошибки, но не отключаются.

Как бы порог отключения повысить?

Free

Free

❓Можно ли изменить (не знаю какой) параметр zfs, определяющий количество ошибок, после которого устройство переходит в статус FAULTED ❓

Нагуглил только, что clear помогает, но через некоторое время снова диск отключается.

Помогите продержать в коме умирающий пул, пока из него данные выкачиваются.

Пул raidz2 полудохлый, выкачиваю из него данные send/recv, но медленно, скорость вначале 80-90 MiB/s, потом до 20-30 падает на длинном промежутке. Все другие задачи с пула снял.

Проблема в том, что на одном из vdev два диска сбоят, появляются ошибки READ/WRITE, после небольшого количество которых диски помечается как FAULTED.

Пишут, что их отключает сама zfs, когда считает, что ошибок слишком много.

Боюсь, что такое случится с каким-нибудь еще диском, и тогда весть пул FAULTED. Пусть лучше выдают пока ошибки, но не отключаются.

Как бы порог отключения повысить?

Vladislav

Vladislav

❓Можно ли изменить (не знаю какой) параметр zfs, определяющий количество ошибок, после которого устройство переходит в статус FAULTED ❓

Нагуглил только, что clear помогает, но через некоторое время снова диск отключается.

Помогите продержать в коме умирающий пул, пока из него данные выкачиваются.

Пул raidz2 полудохлый, выкачиваю из него данные send/recv, но медленно, скорость вначале 80-90 MiB/s, потом до 20-30 падает на длинном промежутке. Все другие задачи с пула снял.

Проблема в том, что на одном из vdev два диска сбоят, появляются ошибки READ/WRITE, после небольшого количество которых диски помечается как FAULTED.

Пишут, что их отключает сама zfs, когда считает, что ошибок слишком много.

Боюсь, что такое случится с каким-нибудь еще диском, и тогда весть пул FAULTED. Пусть лучше выдают пока ошибки, но не отключаются.

Как бы порог отключения повысить?

Попробуй ещё так поискать

https://github.com/openzfs/zfs/issues/3422

https://github.com/openzfs/zfs/issues/1897

https://serverfault.com/questions/974293/force-zfs-to-ignore-checksum-errors-without-removing-the-offending-disk

Free

Free

Попробуй ещё так поискать

https://github.com/openzfs/zfs/issues/3422

https://github.com/openzfs/zfs/issues/1897

https://serverfault.com/questions/974293/force-zfs-to-ignore-checksum-errors-without-removing-the-offending-disk

По этим ссылкам - исключение проблемы ошибок при посылке снапшотов.

У меня другая.

Посылка идет без ошибок.

Проблема в том, что безотносительно send/receive диски отключаются (переходят в статус FAULTED)

Vladislav

Vladislav

Vladislav

Vladislav

running zpool clear hdd in a loop every 500ms to clear checksum errors before they reach the threshold

Vladislav

Vladislav

Free

Free

running zpool clear hdd in a loop every 500ms to clear checksum errors before they reach the threshold

Это я сейчас руками делаю 😉.

Вопрос, как этот threshold поднять?

Vladislav

Vladislav

Это я сейчас руками делаю 😉.

Вопрос, как этот threshold поднять?

А что в ответе на пост на servefault написано?

Free

Free

adjusting zfs_checksum_events_per_second from 20 to 0 ?

Это, наверное, совсем проверку убирает?

Но не очень понятны вообще последствия 🤔

Free

Free

Алексей

Алексей