Alex

Alex

Я поиграл с тестовым пулом и получил вот такое https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-8A/

Alex

Alex

# zpool status test -v

pool: test

state: ONLINE

status: One or more devices has experienced an error resulting in data

corruption. Applications may be affected.

action: Restore the file in question if possible. Otherwise restore the

entire pool from backup.

see: https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-8A

scan: scrub repaired 0B in 00:00:00 with 1 errors on Sat Nov 25 01:42:49 2023

config:

NAME STATE READ WRITE CKSUM

test ONLINE 0 0 0

/root/test.loop ONLINE 0 0 6

errors: Permanent errors have been detected in the following files:

/test/test/asdf

Free

Free

Я поиграл с тестовым пулом и получил вот такое https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-8A/

Спасибо за тест - у меня руки бы не дошли.

Я больше теоретизирую 😉

Alex

Alex

Спасибо за тест - у меня руки бы не дошли.

Я больше теоретизирую 😉

Черт. Но я блин до этого был уверен, что такое невозможно =(

Alex

Alex

я сперва попал в нули, походу, и ничего. Нужно найти смещение с данными и тереть там. Устал, потом может еще поиграться и попробовать стукнуть точно по метаданным - может тогда захерится весь пул

Free

Free

Чертовка, а! Как они это делают?

Ну я, честно говоря, ожидал бы такого поведения.

Ведь не зря сразу говорят, что ZFS, в отличие от классических рейдов, знает диски до уровня файлов.

Спасибо вам и этому чату за прояснение неочевидных вопросов (несмотря на некоторый осадок от самоуверенных троллей, ссылающихся на "общеизвестные знания о рейдах" 😜)

Alex

Alex

Ну я, честно говоря, ожидал бы такого поведения.

Ведь не зря сразу говорят, что ZFS, в отличие от классических рейдов, знает диски до уровня файлов.

Спасибо вам и этому чату за прояснение неочевидных вопросов (несмотря на некоторый осадок от самоуверенных троллей, ссылающихся на "общеизвестные знания о рейдах" 😜)

так я сам был уверен, что пул сдохнет =(

Free

Free

так я сам был уверен, что пул сдохнет =(

У меня еще к тому же есть некоторая надежда новичка на "реализованное чудо" (которое можно представить, что могло бы быть реализовано исходя из заложенных в zfs преимуществ).

Вот про одно из таких чудес я здесь уже спрашивал (про возможность расширения объема пула при замене диска на диск бОльшего объема).

И в этой же книжке, кстати, нашел подтверждение, что какие-то движения в этом направлении есть.

Правда, одна из функций была, по описаниям, отложена на будущее (кстати, это "будущее" для книги сейчас уже наступило), а интересовавший меня вопрос про raidz был описан как "имеющийся в roadmap, но пока не запланированный"

Alex

Alex

У меня еще к тому же есть некоторая надежда новичка на "реализованное чудо" (которое можно представить, что могло бы быть реализовано исходя из заложенных в zfs преимуществ).

Вот про одно из таких чудес я здесь уже спрашивал (про возможность расширения объема пула при замене диска на диск бОльшего объема).

И в этой же книжке, кстати, нашел подтверждение, что какие-то движения в этом направлении есть.

Правда, одна из функций была, по описаниям, отложена на будущее (кстати, это "будущее" для книги сейчас уже наступило), а интересовавший меня вопрос про raidz был описан как "имеющийся в roadmap, но пока не запланированный"

ну придется увеличить все диски в vdev. Вроде расширение возможно. Проверим? :))

Free

Free

ну придется увеличить все диски в vdev. Вроде расширение возможно. Проверим? :))

Не, я там мечтал о том, чтобы страйпы записывались не на ВСЕ диски vdev (если маленький файл, например) - и тогда можно было бы играться тем, чтобы чаще такие маленькие файлы направлять на новый большой диск, чтобы на него больше страйпов приходилось.

Но это, конечно, не просто и эта надежда сейчас у меня потухла.

Vladislav

Vladislav

Free

Free

Seagate adapt Вам в ту сторону

Да я опять-таки чисто теоретически 😊.

В рамках знакомства с zfs.

Практически мне это не нужно сейчас.

Vladislav

Vladislav

Ну я, честно говоря, ожидал бы такого поведения.

Ведь не зря сразу говорят, что ZFS, в отличие от классических рейдов, знает диски до уровня файлов.

Спасибо вам и этому чату за прояснение неочевидных вопросов (несмотря на некоторый осадок от самоуверенных троллей, ссылающихся на "общеизвестные знания о рейдах" 😜)

(вот видите, Вы тоже начали пытаться найти знания сами))))

Vladislav

Vladislav

точно =)

Да, я сейчас догадался посмотреть на размер файла после моего dd)))

Забавно, что это все описывается по запросу

zfs raidz1 ube

Anton

Anton

Anton

Anton

Настройки zfs из коробки, без L2ARC и сжатия.

1. Насколько вообще уместно применение zfs под видеоданные (много записи, чтение редко) в схеме raidz2? Может быть есть более оптимальные решения?

2. Будет ли вообще выхлоп от использования ARC и L2ARC?

3. Иметь ли смысл применять сжатие?

Беглый поиск по чатам типа Astra и Flussonic, например, показал, что такое юзали под видеоархивы, только описывают это в сочувствующим что ли контексте :)

Ivan

Ivan

Настройки zfs из коробки, без L2ARC и сжатия.

1. Насколько вообще уместно применение zfs под видеоданные (много записи, чтение редко) в схеме raidz2? Может быть есть более оптимальные решения?

2. Будет ли вообще выхлоп от использования ARC и L2ARC?

3. Иметь ли смысл применять сжатие?

Беглый поиск по чатам типа Astra и Flussonic, например, показал, что такое юзали под видеоархивы, только описывают это в сочувствующим что ли контексте :)

сжатие пожатого медиаконтента нормальными кодеками смысла не имеет

Vladislav

Vladislav

Настройки zfs из коробки, без L2ARC и сжатия.

1. Насколько вообще уместно применение zfs под видеоданные (много записи, чтение редко) в схеме raidz2? Может быть есть более оптимальные решения?

2. Будет ли вообще выхлоп от использования ARC и L2ARC?

3. Иметь ли смысл применять сжатие?

Беглый поиск по чатам типа Astra и Flussonic, например, показал, что такое юзали под видеоархивы, только описывают это в сочувствующим что ли контексте :)

@Georg_post

У нас есть человек который очень много хранит медии, может он поделится своим опытом в этом

Georg🎞️🎥

Georg🎞️🎥

Ivan

Ivan

потоки с камер h264 кодек, full hd в среднем

с кривых кодеков можно что-то поджать конечно. советую провести тесты на наборе данных.

Georg🎞️🎥

Georg🎞️🎥

потоки с камер h264 кодек, full hd в среднем

Ясно

Много arc и l2 на очень редкое чтение вам не помощники ))

Сжать видос тоже особо не выйдет 🤷🏻♂️

Georg🎞️🎥

Georg🎞️🎥

Ну архивы мало кто смотрит, да.

Собирайте на raidz2 )) больше 10 винтов лучше в группу не пихать вроде 🤔

Anton

Anton

Собирайте на raidz2 )) больше 10 винтов лучше в группу не пихать вроде 🤔

Да, так и сделано, dual mirror из двух raidz2 по 10 винтов

George

George

Настройки zfs из коробки, без L2ARC и сжатия.

1. Насколько вообще уместно применение zfs под видеоданные (много записи, чтение редко) в схеме raidz2? Может быть есть более оптимальные решения?

2. Будет ли вообще выхлоп от использования ARC и L2ARC?

3. Иметь ли смысл применять сжатие?

Беглый поиск по чатам типа Astra и Flussonic, например, показал, что такое юзали под видеоархивы, только описывают это в сочувствующим что ли контексте :)

1 - очень уместно. Схему выбирайте от требований по записи, чем жире raidz - тем эффективнее по месту, но хуже по перформансу, и наоборот

2 - не очень, оставьте дефолтный arc просто

3 - нет, если пишете в файл с размером кратным recordsize, иначе просто последний блок файла займёт весь recordsize (со сжатием - не займёт). Но скорее всего проще даже не заморачиваться

единственное что можно подумать покрутить - recordsize вверх, и то не обязательно, дефолтный 128k норм

Anton

Anton

Эмми… не страйп?

ну это raid 6 0 в эквиваленте ZFS получается.

один пул из 2-х raizd2 по 10 винтов

Georg🎞️🎥

Georg🎞️🎥

ну это raid 6 0 в эквиваленте ZFS получается.

один пул из 2-х raizd2 по 10 винтов

Ну у меня так же , только 9 по 10 ))

Anton

Anton

А какое видео ?

в среднем один такой стример вывозит 700-800 камер без существенных потерь по кадрам

Georg🎞️🎥

Georg🎞️🎥

в среднем один такой стример вывозит 700-800 камер без существенных потерь по кадрам

800 потоков? 🤔на что это пишется ?

Vladislav

Vladislav

в среднем один такой стример вывозит 700-800 камер без существенных потерь по кадрам

Вопрос, а какой у Вас канал? Между камерами и хранилкой

Vladislav

Vladislav

Я полагаю 2x10gb? Lacp? Lag? Два независимых порта со своими айпи?

думаю нет, и коммутатор плохого качества :)

Vladislav

Vladislav

думаю нет, и коммутатор плохого качества :)

Так-то zfs из raid60 на 20 enterprise дисков может и хватит на 1 канал 10Г (где помимо данных ещё оверхед протокола smb\nas), по крайней мере, в теории,

Vladislav

Vladislav

Так-то zfs из raid60 на 20 enterprise дисков может и хватит на 1 канал 10Г (где помимо данных ещё оверхед протокола smb\nas), по крайней мере, в теории,

у нас еще важны буффера коммутаторов и время отклика сети

Anton

Anton

Я полагаю 2x10gb? Lacp? Lag? Два независимых порта со своими айпи?

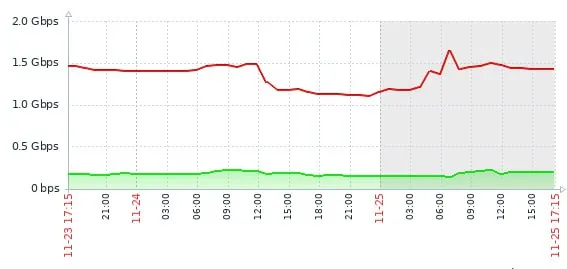

Всего трафика где-то 3.3 Gb дует и размазывается по 3 таким стримерам. Сетевуха Intel X520-DA2, коммутатор SNR S2990G-24FX.

Δαρθ

Δαρθ

порезать какойнить файл с камеры на куски recordsize (например 1мб) и пожать zstd. если куски хотя бы на 4к меньше получаться будут, смысл юзать сжатие есть.

вопрос хватит ли на сжатие всего потока процессора -- отдельный.

George

George

порезать какойнить файл с камеры на куски recordsize (например 1мб) и пожать zstd. если куски хотя бы на 4к меньше получаться будут, смысл юзать сжатие есть.

вопрос хватит ли на сжатие всего потока процессора -- отдельный.

> если куски хотя бы на 4к меньше получаться будут, смысл юзать сжатие есть.

увы не так, сейчас есть зашитая проверка что если блок не сжался на 12.5% хотя бы, то он будет записан как есть

Alex

Alex

Alex

Alex

https://www.truenas.com/community/threads/game-changer-for-zfs-2-2-intelligent-compression-that-saves-cpu-and-space.113247/

Vladislav

Vladislav

> если куски хотя бы на 4к меньше получаться будут, смысл юзать сжатие есть.

увы не так, сейчас есть зашитая проверка что если блок не сжался на 12.5% хотя бы, то он будет записан как есть

а нет чтоб вынести этот параметр в крутилки....

George

George

а нет чтоб вынести этот параметр в крутилки....

там не всё так просто) я несколько лет назад уже подход делал, трабла что старый код на это завязывается и можно сломать обратную совместимость https://github.com/openzfs/zfs/pull/9416

George

George

в 2.2 при zstd сжатии сначала есть хитрая попытка сжать с lz4, и там можно цпу сэкономить таким образом

Alex

Alex

ну я про это думал =) Там же тоже: попробуем lz4, потом zstd, но если вообще не жмется - то и ладно

Alex

Alex

вообще отсечка 12.5% выглядит высоковатой. Иногда и 5% это вполне конкретные деньги выходят... неужели не оставили крутилку?

Δαρθ

Δαρθ

George

George

это странная эвристика для больших блоков...

Это эвристика оч старая, но стоит учесть что она сильно влияет на потребление проца. И оптимальный для всех дефолт надо подобрать

Vladislav

Vladislav

эх....когда ментейнилась ZFS разрабами из illumos то фич было меньше но стабильность выше.....а тут пустили линуксятников к священному — все испоганили......теперь с ZFS во фре такой же бардак как и в линуксах

Δαρθ

Δαρθ

Ivan

Ivan

Vladislav

Vladislav

поэтому у меня дома

vfs.zfs.version.spa: 5000

на работе уже версия чуть повыше, посмотрим как поведет себя :)

Станислав

Станислав