Цифры

все замеры делались мною года 3 назад, сейчас у меян всё на ZFS

Владимир

Владимир

я не могу вам предоставить цифры, но вы сами можете их получить если не поленитесь и выполните тесты

Vladislav

Vladislav

И если мы говорим про "высоконагруженные БД", то мы говорим про enterprise level диски и HDD

Владимир

Владимир

И если мы говорим про "высоконагруженные БД", то мы говорим про enterprise level диски и HDD

я уже подчеркнул выше что у меня был очень негативный опыт с плохими дисками, и подчёркиваю что да, диски нужны нормальные

Vladislav

Vladislav

Если сравнение идёт между nvme "500ГБ Aliexpress 100000% write speed" за 5$ и HDD enterprise WD 330, ля, классное сравнение спасибо

Владимир

Владимир

Если сравнение идёт между nvme "500ГБ Aliexpress 100000% write speed" за 5$ и HDD enterprise WD 330, ля, классное сравнение спасибо

я сравнивал чтобы ты понимал на аналогичном железе

Владимир

Владимир

Если сравнение идёт между nvme "500ГБ Aliexpress 100000% write speed" за 5$ и HDD enterprise WD 330, ля, классное сравнение спасибо

у вас вообще в парке есть хоть одна тачка с zfs?

Vladislav

Vladislav

Я самоубийца делать raidz1-2-3 на таком количестве HDD (36 штук (26 data + 10 spares))? Я не настолько любитель низких скоростей

Владимир

Владимир

Я самоубийца делать raidz1-2-3 на таком количестве HDD (36 штук (26 data + 10 spares))? Я не настолько любитель низких скоростей

ну я просто подумал что может причина почему вы говорите про плохую скорость как раз в этом))

Vladislav

Vladislav

?

ZFS на nvme я тестил поверх 6x nvme PM9A3 1.92ТБ с 256 ГБ оперативы

Где сравнивал stripe-s

Vladislav

Vladislav

и скорость массива будет ограничена скоростью самой медленной пары))

Это 13 пар одинаковых дисков

Владимир

Владимир

Это 13 пар одинаковых дисков

у меня нет в работе на столько больших масивов, обычно не более 3х зеркал, может есть какие-то особенности в больших массивах, не могу знать

ViP

ViP

https://www.oracle.com/a/ocom/docs/zs7-2-datasheet-russian.pdf

так ето еще 2018 году было. за 5 лет очень сильно поменялось в плане железа

LordMerlin

LordMerlin

А вот когда говорят про БД на ZFS. Это именно линукс БД Типа Postgre и файл лежит в самой файловой системе?

Если говорить про миррор из SSD, то если делать mdadm+ext4 и на нем qcow файл диска с ntfs унутре на которой лежит MS SQL база. ТО это драматичнее будет медленнее, чем ZFS Mirror на котором как блочник лежит диск который ntfs + MS SQL?

central

central

Vladislav

Vladislav

Vladislav

Vladislav

Animal

Animal

Тут я ахуел и не понял

ну если я правильно понял у чела там пачка "слоев" слоев получилась. Фс на кукоу на мирроре а сверху бубенчики...

Vladislav

Vladislav

Михаил

Михаил

Vladislav

Vladislav

LordMerlin

LordMerlin

ну если я правильно понял у чела там пачка "слоев" слоев получилась. Фс на кукоу на мирроре а сверху бубенчики...

Хоспадя, спросил про влияние zfs именно напрямую если база лежит в ней как файл или как zvol и опосредовано, если там виртуалка.

Все такие умные.

Ну давайте, как правильно крутить mssql в виртуалке?

Animal

Animal

Хоспадя, спросил про влияние zfs именно напрямую если база лежит в ней как файл или как zvol и опосредовано, если там виртуалка.

Все такие умные.

Ну давайте, как правильно крутить mssql в виртуалке?

Хз 😂 но смысл qcow на zfs. Не вижу. У меня есть одна виртуалка с win 10прям на zvol. Но без мсскуэля.

Vladislav

Vladislav

Хоспадя, спросил про влияние zfs именно напрямую если база лежит в ней как файл или как zvol и опосредовано, если там виртуалка.

Все такие умные.

Ну давайте, как правильно крутить mssql в виртуалке?

Но отвечая на него

Собрать стенд, проверить несколько файловых систем и реализаций, выбрать наилучшую по производительности\надёжности\удобству использования

Михаил

Михаил

А вообще, оба вопросы очень косвенно относятся к ZFS

@EvgenyKus @CMAPTu

Ок, прошу прощения. В чате по Proxmox я так же задавал этот вопрос. Там помощи не дождался.

LordMerlin

LordMerlin

А вообще, оба вопросы очень косвенно относятся к ZFS

@EvgenyKus @CMAPTu

Да, согласен. Просто первая часть вопроса про базу именно по сабжу. Вторая, про абстракции - да, оффтоп.

Ivan

Ivan

Ок, прошу прощения. В чате по Proxmox я так же задавал этот вопрос. Там помощи не дождался.

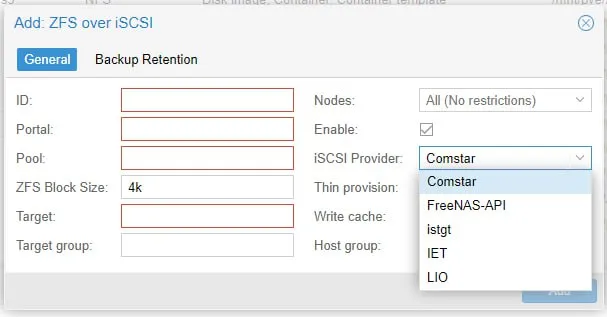

в чате пару человек только zfs over scsi юзают. экзотическая штука из-за того что подержки железом нет.

LordMerlin

LordMerlin

Хз 😂 но смысл qcow на zfs. Не вижу. У меня есть одна виртуалка с win 10прям на zvol. Но без мсскуэля.

Ээээ.

А вгде я такое сказал?

Перечитайте пожалуйста.

Вся проблема отвечающих, что ни будь написать первым.....

Vladislav

Vladislav

Хз 😂 но смысл qcow на zfs. Не вижу. У меня есть одна виртуалка с win 10прям на zvol. Но без мсскуэля.

qcow с zfs вообще не связан никак

LordMerlin

LordMerlin

Но отвечая на него

Собрать стенд, проверить несколько файловых систем и реализаций, выбрать наилучшую по производительности\надёжности\удобству использования

Так и сделано.

Прост может не то что-то получил, вот и вопрошаю.

Vladislav

Vladislav

А вот когда говорят про БД на ZFS. Это именно линукс БД Типа Postgre и файл лежит в самой файловой системе?

Если говорить про миррор из SSD, то если делать mdadm+ext4 и на нем qcow файл диска с ntfs унутре на которой лежит MS SQL база. ТО это драматичнее будет медленнее, чем ZFS Mirror на котором как блочник лежит диск который ntfs + MS SQL?

Основная проблема вопрошающих. вместо грамотно изложенного вопроса - поток сознания

LordMerlin

LordMerlin

Основная проблема вопрошающих. вместо грамотно изложенного вопроса - поток сознания

Принято, есть такой грех.

LordMerlin

LordMerlin

Хотя бы схемки запили бы, если никак не получается сформулировать нормально

Все я там нормально спросил.

Ладно. Заканчиваем оффтоп.

Vladislav

Vladislav

Если вопрос как крутить MS SQL поверх ZFS -

Вариант 1. Предпочительный

1) На Linux создаёте zvol

2) Резервируете для БД ОЗУ со стороны виртуализации

3) отдаёте zvol через kvm\qemu адаптер как диск

4) профит

Вариант 2. Странный.

1) Создаёте диск qcow на zfs пуле.

Vladislav

Vladislav

Михаил

Михаил

Если вопрос как крутить MS SQL поверх ZFS -

Вариант 1. Предпочительный

1) На Linux создаёте zvol

2) Резервируете для БД ОЗУ со стороны виртуализации

3) отдаёте zvol через kvm\qemu адаптер как диск

4) профит

Вариант 2. Странный.

1) Создаёте диск qcow на zfs пуле.

У меня был как-то вариант, похожий на 2: zfs расшаренный через nfs, на котором создавались qcow2. Девопсы пытались это сразу в прод пихнуть. Общая производительность дисковой в гостях была крайне низкая.

Vladislav

Vladislav

Насколько я помню MS sql - 64k volblocksize, dedup off, compression lz4, префетч можно делать агрессивней (смотря сколько памяти доступно)

Vladislav

Vladislav

LordMerlin

LordMerlin

Насколько я помню MS sql - 64k volblocksize, dedup off, compression lz4, префетч можно делать агрессивней (смотря сколько памяти доступно)

Да все так, и ntfs внутри тоже с 64кб отформатирована

Georg🎞️🎥

Georg🎞️🎥

Я самоубийца делать raidz1-2-3 на таком количестве HDD (36 штук (26 data + 10 spares))? Я не настолько любитель низких скоростей

У мен так 🤣🤣🤣👋raidz на 60 винтах ))

Autumn

Autumn

Хоспадя, спросил про влияние zfs именно напрямую если база лежит в ней как файл или как zvol и опосредовано, если там виртуалка.

Все такие умные.

Ну давайте, как правильно крутить mssql в виртуалке?

просто правильный recordsize выбирете, да сжатие включите

Autumn

Autumn

Ок, прошу прощения. В чате по Proxmox я так же задавал этот вопрос. Там помощи не дождался.

я не видел вопроса, но думаю что никто так зфс на проксе не гоняет, ну или очень мало кто, все его крутят локально прямо на проксе и юзают сразу датасет или звол

Autumn

Autumn

У мен так 🤣🤣🤣👋raidz на 60 винтах ))

Я вот себе тоже задал вопрос, как по другому? В том же чате про прокс я кидал свежие тесты, там есть рейд60 против рейд10 на шпинделях, могу кинуть сюда, но тест был под виртуализацию и бэкапы прежде всего сравнить разные варианты организации пулов, так что не для всех актуален. Касательно шпинделей и рейд 60 против рейд 10, каждый может оценить скорость, но результат по объему дискового явно не в пользу 10-го.

Autumn

Autumn

В принципе тест ради этого и затевался, потому что надо под связку прокс+зфс взять в ЦОДе сервера, а там железо максимум на 10 ссд и вот меня жаба просто придушила на 3.8 или 7.6 ТБ ссдхах делать 10-й рейд на двух зеркалах. Просрать столько дискового рука не поднимается.

Georg🎞️🎥

Georg🎞️🎥

В принципе тест ради этого и затевался, потому что надо под связку прокс+зфс взять в ЦОДе сервера, а там железо максимум на 10 ссд и вот меня жаба просто придушила на 3.8 или 7.6 ТБ ссдхах делать 10-й рейд на двух зеркалах. Просрать столько дискового рука не поднимается.

И зеркало - это же два диска в зеркале унесут все , так что и к надёжности этого вопрос

Autumn

Autumn

И зеркало - это же два диска в зеркале унесут все , так что и к надёжности этого вопрос

ну я для 48 шпинделей использовал трипл миррор, а так да, это дичь 10-20 ссд в зеркале где гарантированно только одна выживет, а получить 30% от 100% - да я себя задушу

Autumn

Autumn

под виртуализацию по моим тестам разницы особой нет с рейд 10, зато профит на емкости ссд фулл флеш пула огромный

ViP

ViP

всем привет!

Немного запутался, если я хочу создать пул zfs raid10 надо предварительно подготовить диски в parted GPT

1 4096MB 1920GB 1920GB primary zfs raid