Shaker

Shaker

Да вот тоже про него … Под кэш тоже ?

Да, у меня нагрузка не такая большая. Под кэш Samsung PM9A3

Georg🎞️🎥

Georg🎞️🎥

Да, у меня нагрузка не такая большая. Под кэш Samsung PM9A3

Надо прям чтобы между рам и l2 был минимальный провал ))

Fedor

Fedor

Надо прям чтобы между рам и l2 был минимальный провал ))

они по-разному работают, провал будет многократный всегда

Georg🎞️🎥

Georg🎞️🎥

как и задержки - у ссд десятки-сотни мкс, а рамы - десятки наносекунд

Это понятно. Но из того , что есть на рынке … optan?

Y

Y

Надо 500-900 )))

там чем больше кеш тем больше РАМы надо, а если много РАМы можно поставить то нафига кеш?

Georg🎞️🎥

Georg🎞️🎥

там чем больше кеш тем больше РАМы надо, а если много РАМы можно поставить то нафига кеш?

Больше нельзя … будем максить но может не хватить

Y

Y

@Georg_post , кстати оно локально или по сетке ? а то по сетке может и не надо такую скорость - упрется в сетку

Georg🎞️🎥

Georg🎞️🎥

@Georg_post , кстати оно локально или по сетке ? а то по сетке может и не надо такую скорость - упрется в сетку

В сетку не упрется , проблема случайного чтения одновременно кучи небольших файлов , из памяти сегодня все огонь

Y

Y

GELI BOOT-FLAG нашед как починить если кому нада....

убирает BOOT и ставит GELIBOOT - тогда и в новых верисях спрашивает, причем еще раньше чем BOOT-flag, прямо на этапе загрузчика....

geli configure -B -g DISK

B - убирает BOOT

g - добавляет GELIBOOT

фига - кстати - не починилось... пароль то он спрашивает при загрузке, но дальше не монтирует диск

то есть проблема что Фряха где то после 12.1 версии кладет болт на то что есть на шифрованном диске отрибут (он же флаг) - BOOT осталась... в старых видит и монтирует - в новых 12.2+ нефига

░▒▓

░▒▓

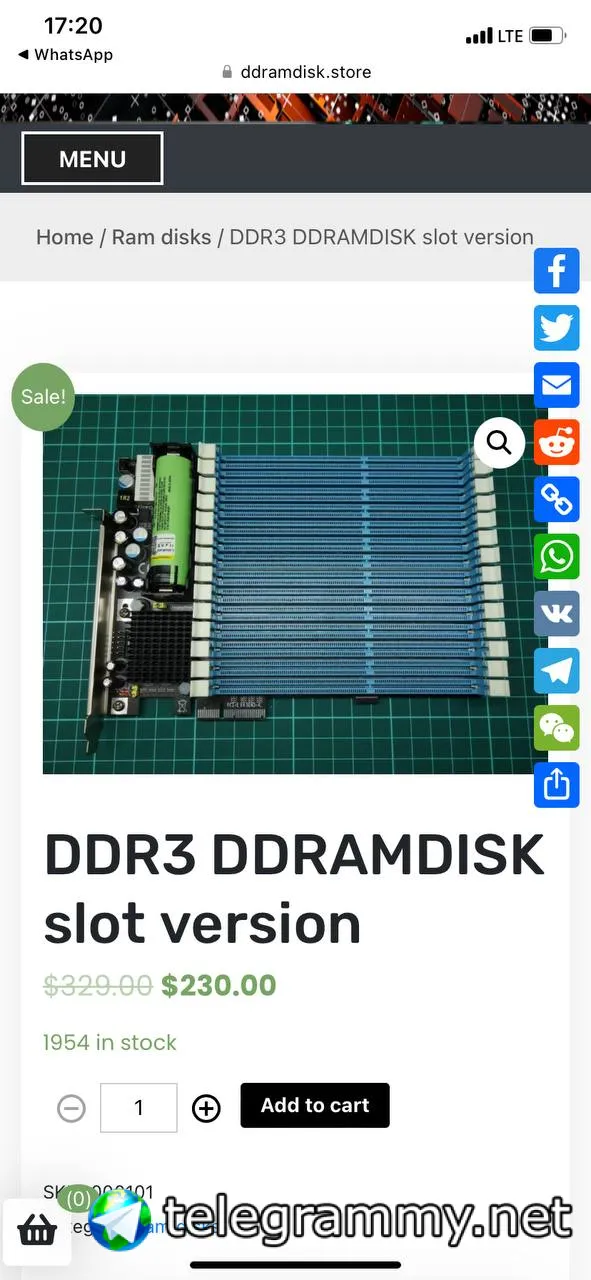

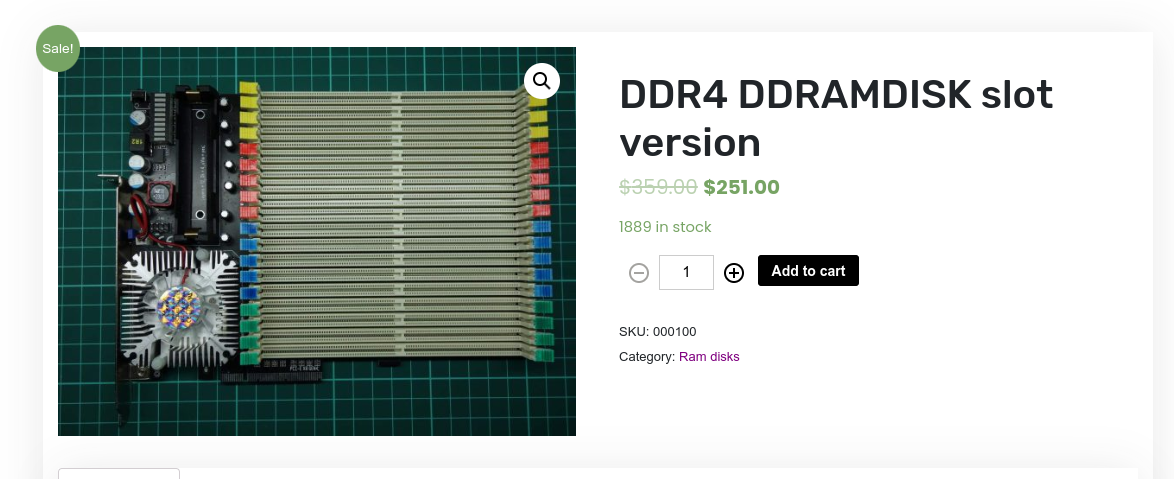

Дорого да и какой профит 🤷🏻♂️

Там сразу готовые от 256 до двух гигов продаются...в смысле есть...

Georg🎞️🎥

Georg🎞️🎥

Там сразу готовые от 256 до двух гигов продаются...в смысле есть...

Ну кстати .. есть опасения … чтоб в моем случае трунас их увидел

Станислав

Станислав

Ну кстати .. есть опасения … чтоб в моем случае трунас их увидел

Так обсуждали ведь уже, что там контроллер как в m2 ssd, чего бы ему не видеть их?

Georg🎞️🎥

Georg🎞️🎥

Так обсуждали ведь уже, что там контроллер как в m2 ssd, чего бы ему не видеть их?

«Обсуждали» и «точно заведется» разные вещи, особенно в железе то уж

Artem

Artem

Всем здравствуйте. Помогите, кто может (да, не по основной теме, но дальше будет о zfs)))). Сидел и ковырялся на домашнем серваке с Ubuntu 22.04 и выстрелил себе в ногу и используя chmod go-rx из домашнего каталога пользователя закрыл себе доступ к "..". Да, то есть сам себе запретил читать и выполнять объекты всей файловой системы выше /home/user . Решил исправить это дело и используя эту статью (https://losst.pro/sbros-parolya-ubuntu) зашёл через grub и загрузился через "init=/bin/bash" ctrl+x в root и оттуда обратно все права доступа поправил. Вышел. И перезагрузил комп. После этого появляется стандартный лог с clean а дальше отрубается видеосигнал и ubuntu не грузится. При этом машина не загружается и не видится в локальной сети. Есть идеи. Логи смотреть пытался, но не знаю, что искать.

И во всей этой ситуации самое страшное. На этом компе в zfs массиве подсоединены 4 диска. Вопрос второй - а смогу ли я, снеся систему и поставив её заново подключиться к этому массиву?

Sergey

Sergey

Всем здравствуйте. Помогите, кто может (да, не по основной теме, но дальше будет о zfs)))). Сидел и ковырялся на домашнем серваке с Ubuntu 22.04 и выстрелил себе в ногу и используя chmod go-rx из домашнего каталога пользователя закрыл себе доступ к "..". Да, то есть сам себе запретил читать и выполнять объекты всей файловой системы выше /home/user . Решил исправить это дело и используя эту статью (https://losst.pro/sbros-parolya-ubuntu) зашёл через grub и загрузился через "init=/bin/bash" ctrl+x в root и оттуда обратно все права доступа поправил. Вышел. И перезагрузил комп. После этого появляется стандартный лог с clean а дальше отрубается видеосигнал и ubuntu не грузится. При этом машина не загружается и не видится в локальной сети. Есть идеи. Логи смотреть пытался, но не знаю, что искать.

И во всей этой ситуации самое страшное. На этом компе в zfs массиве подсоединены 4 диска. Вопрос второй - а смогу ли я, снеся систему и поставив её заново подключиться к этому массиву?

По zpool масиву -

На новой ОС zpool import - покажет все доступные zfs-массивы

zpool import - f "имя_массива" - импортирует этот массив обратно. Проблем быть не должно.

Art

Art

я что-то много читал что hot spare работает не так как сходу ожидается и лучше сразу raidz3 в таком случае

Да нет, почему, оно работает как надо, вот пример с виртуального стенда:

Начальная ситуация:

root@exp2:/hahapool# zpool status

pool: hahapool

state: ONLINE

scan: none requested

config:

NAME STATE READ WRITE CKSUM

hahapool ONLINE 0 0 0

raidz2-0 ONLINE 0 0 0

sde ONLINE 0 0 0

sdf ONLINE 0 0 0

sdg ONLINE 0 0 0

sdh ONLINE 0 0 0

sdi ONLINE 0 0 0

spares

sdj AVAIL

errors: No known data errors

Art

Art

я что-то много читал что hot spare работает не так как сходу ожидается и лучше сразу raidz3 в таком случае

Затем я зачистил диск sdf, и вот что получилось:

root@exp2:/home/art# zpool status

pool: hahapool

state: DEGRADED

status: One or more devices could not be used because the label is missing or

invalid. Sufficient replicas exist for the pool to continue

functioning in a degraded state.

action: Replace the device using 'zpool replace'.

see: http://zfsonlinux.org/msg/ZFS-8000-4J

scan: resilvered 120M in 0 days 00:00:02 with 0 errors on Fri Apr 28 20:02:59 2023

config:

NAME STATE READ WRITE CKSUM

hahapool DEGRADED 0 0 0

raidz2-0 DEGRADED 0 0 0

sde ONLINE 0 0 0

spare-1 DEGRADED 0 0 0

sdf UNAVAIL 0 0 0 corrupted data

sdj ONLINE 0 0 0

sdg ONLINE 0 0 0

sdh ONLINE 0 0 0

sdi ONLINE 0 0 0

spares

sdj INUSE currently in use

Art

Art

я что-то много читал что hot spare работает не так как сходу ожидается и лучше сразу raidz3 в таком случае

ну и остаётся отсоединить убитый диск:

root@exp2:/home/art# zpool detach hahapool sdf

root@exp2:/home/art# zpool status

pool: hahapool

state: ONLINE

scan: resilvered 120M in 0 days 00:00:02 with 0 errors on Fri Apr 28 20:02:59 2023

config:

NAME STATE READ WRITE CKSUM

hahapool ONLINE 0 0 0

raidz2-0 ONLINE 0 0 0

sde ONLINE 0 0 0

sdj ONLINE 0 0 0

sdg ONLINE 0 0 0

sdh ONLINE 0 0 0

sdi ONLINE 0 0 0

errors: No known data errors

Nick

Nick

Затем я зачистил диск sdf, и вот что получилось:

root@exp2:/home/art# zpool status

pool: hahapool

state: DEGRADED

status: One or more devices could not be used because the label is missing or

invalid. Sufficient replicas exist for the pool to continue

functioning in a degraded state.

action: Replace the device using 'zpool replace'.

see: http://zfsonlinux.org/msg/ZFS-8000-4J

scan: resilvered 120M in 0 days 00:00:02 with 0 errors on Fri Apr 28 20:02:59 2023

config:

NAME STATE READ WRITE CKSUM

hahapool DEGRADED 0 0 0

raidz2-0 DEGRADED 0 0 0

sde ONLINE 0 0 0

spare-1 DEGRADED 0 0 0

sdf UNAVAIL 0 0 0 corrupted data

sdj ONLINE 0 0 0

sdg ONLINE 0 0 0

sdh ONLINE 0 0 0

sdi ONLINE 0 0 0

spares

sdj INUSE currently in use

именно. подключается диск сам, но потом происходит ресильверинг, что вечность на больших объмах Поэтому в этой ситуации лучше повышать уровень raidz

Nick

Nick

У кого-нибудь был опыт втыкания сата ссд дисков под кеш l2arc + slog, типа s3700, в сата2 порты без trim? От этого что-то становится принципиально медленее/хуже?

Art

Art

именно. подключается диск сам, но потом происходит ресильверинг, что вечность на больших объмах Поэтому в этой ситуации лучше повышать уровень raidz

Я логику не пойму)

Ок, допустим в пуле raidz3 один диск вылетел, как действовать надо?🤔

Nick

Nick

Я логику не пойму)

Ок, допустим в пуле raidz3 один диск вылетел, как действовать надо?🤔

можно никак, на потере данных и скорости это не скажется. Планово заказать новый диск и планово поставить его вместо мертвого

Art

Art

можно никак, на потере данных и скорости это не скажется. Планово заказать новый диск и планово поставить его вместо мертвого

Значит проблема только в том, что ресилверинг хотспара начинается автоматически?

Nick

Nick

проблема в том, что в этом случае он сначала начинается, а потом происходит не менее двух дисков для отказа без потери данных

Nick

Nick

другое дело, если иметь рейдз3 сразу и к нему еще добавить хотспаре, но это странный сценарий, типа если уверен что диск умрет, но некогда идти к серверу ставить новый и деньги на купить заранее лишние есть

Art

Art

другое дело, если иметь рейдз3 сразу и к нему еще добавить хотспаре, но это странный сценарий, типа если уверен что диск умрет, но некогда идти к серверу ставить новый и деньги на купить заранее лишние есть

Для своего сервера в чужом датацентре нормальный сценарий например)

Что касается нежелательной нагрузки от ресилвера, то у пула есть параметр autoreplace, он собственно задаёт встаёт ли хотспар на замену сам, или нет.

Art

Art

другое дело, если иметь рейдз3 сразу и к нему еще добавить хотспаре, но это странный сценарий, типа если уверен что диск умрет, но некогда идти к серверу ставить новый и деньги на купить заранее лишние есть

Но я в общем наконец понял ход твоих мыслей.

Ты считаешь, что raidz2+HS хуже, чем raidz3

Склонен согласиться с этим. И думаю, что мы оба так же сойдёмся на том, что круче всего raidz3+HS, ведь хорошо быть здоровым и богатым)

Georg🎞️🎥

Georg🎞️🎥

Georg🎞️🎥

Georg🎞️🎥

Вот думаю что лучший l2 - это оптан, пока нет подходящего недорогого попробовать , скорость случайного чтения у него что надо 👍🤔но еще не пробовал , это теория ..

central

central

Georg🎞️🎥

Georg🎞️🎥

С его обьемом лучше уж ОЗУ докинуть

Озу ограничено платой и процом.. к тому же есть полутеровые варианты … ну это когда ОЗУ уже некуда пихать

Fedor

Fedor

Озу ограничено платой и процом.. к тому же есть полутеровые варианты … ну это когда ОЗУ уже некуда пихать

Я написал про ОЗУ выше - много где можно увеличить обьем

Georg🎞️🎥

Georg🎞️🎥

Я написал про ОЗУ выше - много где можно увеличить обьем

Еще же исхожу из того, что можно достать прямо сейчас , и чтобы не стоило чугунным мостом

Nick

Nick

Вот думаю что лучший l2 - это оптан, пока нет подходящего недорогого попробовать , скорость случайного чтения у него что надо 👍🤔но еще не пробовал , это теория ..

я пробовал оптан как только они появились и мне не удалось его никакими синтетическими тестами прогрузить по иопсам даже на половину от заявленных. Из чего я сделал вывод, что для реальной жизни можно и попроще ставить, разницы нет

Georg🎞️🎥

Georg🎞️🎥

Nick

Nick

Наверно это от области применения все же

наверное, но я взял топовый на тот момент сервер и не смог прогрузить нагрузкой диск. Диск давали на тест на ограниченное время, во что я уперся (шину или проц или что) я понять не успел.

Nick

Nick

нужен совет, raidz2 на 6 дисков по 8 или 12 терабайт под бекапы - чтение редкое и очень произвольное (сжатие и дедупликация, чанки от бекапного софта стоит ожидать разбросанными по дискам). Какие диски и какого объема взять под slog и l2arc?

Пока думаю взять что-то с около 1-1.3 dwpd гигабайт на 800 и слог и л2арк положить на него. Ну и если умрет - просто выкинуть и поставить следующий.

слог сделать гигабайт 16, л2арк сделать гигабайт 400, остальное оставить под оверпровизионинг.

Сервер в сеть воткнут двумя гигабитными портами с бондингом, теоретический предел входного литья бекапов - 200 мегабайт в секунду.

Y

Y

нужен совет, raidz2 на 6 дисков по 8 или 12 терабайт под бекапы - чтение редкое и очень произвольное (сжатие и дедупликация, чанки от бекапного софта стоит ожидать разбросанными по дискам). Какие диски и какого объема взять под slog и l2arc?

Пока думаю взять что-то с около 1-1.3 dwpd гигабайт на 800 и слог и л2арк положить на него. Ну и если умрет - просто выкинуть и поставить следующий.

слог сделать гигабайт 16, л2арк сделать гигабайт 400, остальное оставить под оверпровизионинг.

Сервер в сеть воткнут двумя гигабитными портами с бондингом, теоретический предел входного литья бекапов - 200 мегабайт в секунду.

если там чтение ОЧЕНЬ произвольное и размер масива 40 +/- тера, то нафига там нужен l2arc ? ведь чем больше l2arc тем больше памяти он сожрет и даже при кеше в 1 терабайт шанс попасть в него будет 1 к 40 (при 40 теровом масиве и очень произвольном чтении)

slog по умолчанию сбрасывается раз в 5 секунд, при сетке 10 гига его не имеет смысл делать больше 6 гига (он никогда не заполнится)

с 2 гигабитами это не больше 1 гига

Nick

Nick

о, спасибо за посчитанные цифры. 2 порта по 10гиг в сервере тоже есть, но свитча на 10г пока нет. с размером слога понятно

с л2арк - а что можно улучшить в этой ситуации (кроме special devices)?

в ситуации 1 к 40 - может быть тогда лучше сделать secondarycache=metadata ?

Igor

Igor

или наоборот primarycache=metadata ?

памяти на сервере 32 гига и проц больше не умеет (

А я хотел 1тб озу, но купили только 512гиг, расстроен

Nick

Nick

но не уверен что второй раз взял бы такое, похоже возможность поставить очень много памяти перевешивает экономию на юнитах

Art

Art

но не уверен что второй раз взял бы такое, похоже возможность поставить очень много памяти перевешивает экономию на юнитах

LRDIMM-модули бывают даже по 256 гб вроде

Georg🎞️🎥

Georg🎞️🎥

Art

Art

Я и так их юзаю ecc reg

Art

Art

если там чтение ОЧЕНЬ произвольное и размер масива 40 +/- тера, то нафига там нужен l2arc ? ведь чем больше l2arc тем больше памяти он сожрет и даже при кеше в 1 терабайт шанс попасть в него будет 1 к 40 (при 40 теровом масиве и очень произвольном чтении)

slog по умолчанию сбрасывается раз в 5 секунд, при сетке 10 гига его не имеет смысл делать больше 6 гига (он никогда не заполнится)

с 2 гигабитами это не больше 1 гига

хм, а ведь получается общее правило можно сформулировать:

практический максимальный размер для слог-девайса = (скорость_записи_в_пул)*5

Vladislav

Vladislav

Georg🎞️🎥

Georg🎞️🎥

У LRDIMM просто есть буфер памяти, который позволяет ей притворяться не 8 ранговой, а 4 ранговой

https://servomarket.ru/blog/polezno-znat/lrdimm-i-rdimm-/

Короче , больше чем 700 с копьем памяти я не поставлю, и тут либо оптан или плата pci под dimm, и все это l2

Y

Y

хм, а ведь получается общее правило можно сформулировать:

практический максимальный размер для слог-девайса = (скорость_записи_в_пул)*5

скорее скорость источника... если это РАМ - то да много, если сетка то не быстрее сетки * 5

Andrey

Andrey