Artem

Artem

спасибо

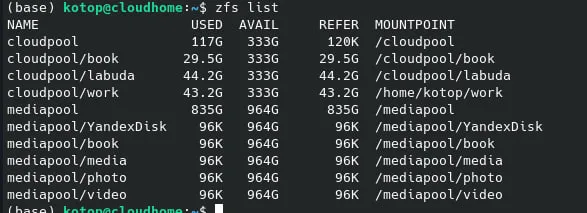

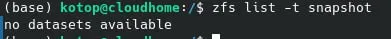

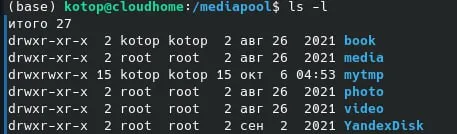

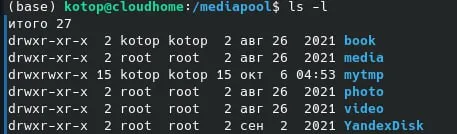

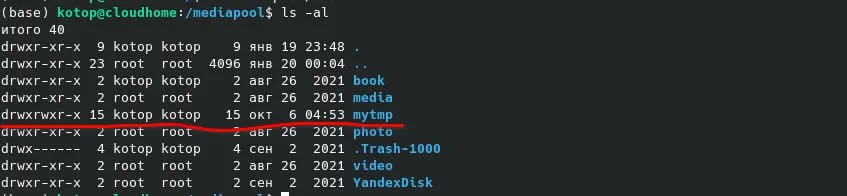

так, и что же, скажем каталоги /mediapool и /cloudpool - пустые?

Art

Art

Artem

Artem

George

George

Artem

Artem

Art

Art

Art

Art

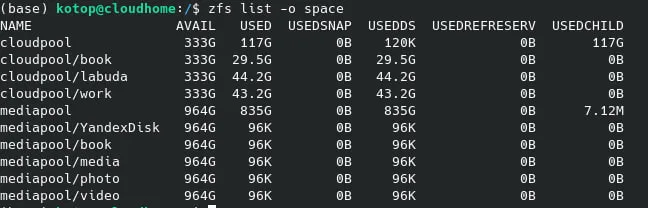

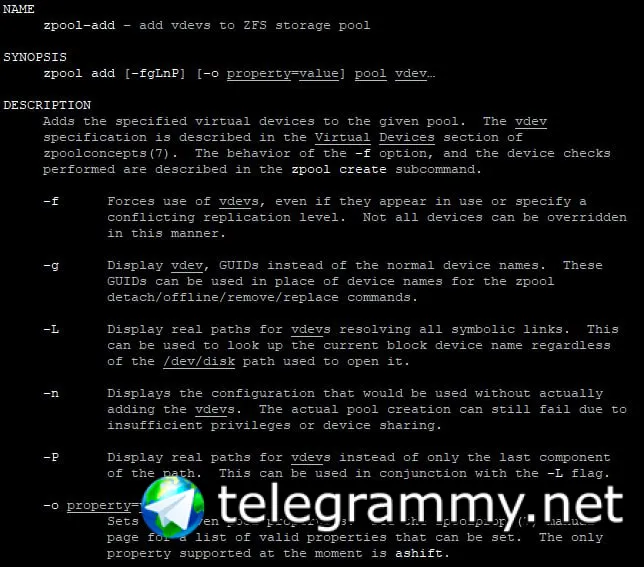

вангую что данные лежат в корневом датасете, а дочерние датасеты пустые и до этого не монтировались, а сейчас смонтировались

согласен, просто в корне лежат 800 гигов файлов, дело думаю раскрыто)

George

George

Artem

Artem

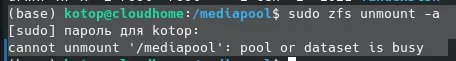

можно то можно, только он всё отмонтирует, указывайте просто конкретные датасеты

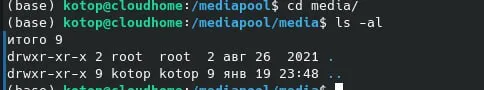

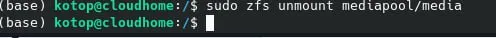

отмонтировал все внутренние датасеты

Artem

Artem

ну так теперь содержимое смотрите

так, а теперь можно объяснить...??? Я то замену провёл правильно?

George

George

так, а теперь можно объяснить...??? Я то замену провёл правильно?

ну без конкретных команд подтвердить нельзя)) но замена диска без пересоздания пула на содержимое пула (если он цел) не влияет

George

George

вы когда то создали датасетов вложенных, но не примонтировали их, и данные на рутовый по факту попадали

George

George

так все датасеты были примонтированы....

ну это вы так считаете, а данные почему-то лежат на рутовом в итоге

Artem

Artem

так, тогда есть ли методичка или просто мануальчик, а то документация с гугл переводчиком у меня плохо читается?

George

George

так, тогда есть ли методичка или просто мануальчик, а то документация с гугл переводчиком у меня плохо читается?

на русском инфы мало, в закрепах можете полистать

George

George

Ок, пойду самообразовываться.

если что - пул можно на файликах вместо диска создавать и тренироваться

Artem

Artem

если что - пул можно на файликах вместо диска создавать и тренироваться

Да я тренировался, года 3 назад, а потом всё успешно заросло пылью и забылось, прям как сервак). Спасибо)

Arseniy

Arseniy

А у меня вопрос чисто теоретический: учитывая структуру работы с девайсами, я искренне не понимаю, почему при страйпе из двух девайсов скорость чтения практически такая же, как и при мирроре? Почему она не удваивается?)

Хотя скорость записи увеличивается, да

Инфа отсюда

https://calomel.org/zfs_raid_speed_capacity.html

George

George

А у меня вопрос чисто теоретический: учитывая структуру работы с девайсами, я искренне не понимаю, почему при страйпе из двух девайсов скорость чтения практически такая же, как и при мирроре? Почему она не удваивается?)

Хотя скорость записи увеличивается, да

Инфа отсюда

https://calomel.org/zfs_raid_speed_capacity.html

Потому что (вангую) выбранная методика тестирования читает в 1 поток, а чтение синхронное (следующий блок запросится только после предыдущего), а на страйпе 1 блок хранится только на 1 диске. А вот запись скорее всего асинхронно тестится, и может утилизировать оба диска

nikolay

nikolay

Потому что (вангую) выбранная методика тестирования читает в 1 поток, а чтение синхронное (следующий блок запросится только после предыдущего), а на страйпе 1 блок хранится только на 1 диске. А вот запись скорее всего асинхронно тестится, и может утилизировать оба диска

префетч все еще по умолчанию отключен?

George

George

префетч все еще по умолчанию отключен?

Всё ещё? Он по дефолту всегда включен был, но он не на всех кейсах поможет, и требует primarycache=all пока (а вот в мастер уже влили патч, где и на primarycache=metadata будет нормально работать)

Aba

Aba

А у меня вопрос чисто теоретический: учитывая структуру работы с девайсами, я искренне не понимаю, почему при страйпе из двух девайсов скорость чтения практически такая же, как и при мирроре? Почему она не удваивается?)

Хотя скорость записи увеличивается, да

Инфа отсюда

https://calomel.org/zfs_raid_speed_capacity.html

Тесты странные у него, да и старые. Тоже задался подобными вопросами по результатам этих тестов, ща поставил свои тесты делаться, правда только на 6 дисках, да и методику тестирования чуть подкорректировать нужно будет.

Arseniy

Arseniy

Я тут просто выбираю как мне быть, у меня 2 ссд 1Тб сата, скорость 530. Сервер для дома. С одной стороны, зеркало - это надёжность. Но ссд достаточно долговечны сами по себе (хотя все бывает). Планирую размещать на этом пуле все приложения трунаса и ВМ. И тут встаёт выбор:

Сделать миррор и не знать проблем, или страйп и (теоретически) повысить скорость работы ВМ, заодно подрубить оставшееся место по iscsi на локальный ПК в сети и юзать как файлопомойку, периодически выполняя бэкап. Если прироста скорости нет, как у мужика в тесте, то оно мне и не надо, миррор надёжнее. А если есть, то я б выбрал страйп+частые бэкапы нужных областей

George

George

George

George

если не знаете ещё нужных размеров каждого - оставьте просто неразмеченное пространство на дисках, чтобы их можно было потом подцепить к нужному пулу

Arseniy

Arseniy

часть - в миррор, часть - страйпов, в 2 пула. Я так дома делаю

Я как то не подумал про такой вариант... То есть, я бью каждый ссд на партиции и две делаю в миррор, две в страйп?

George

George

nikolay

nikolay

George

George

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html?highlight=prefetch#zfs-prefetch-disable

Владимир

Владимир

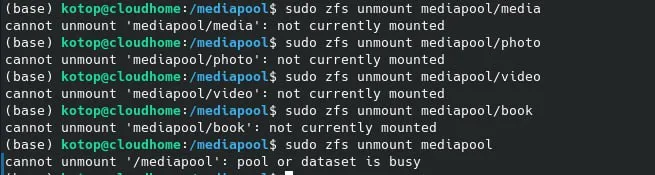

в общем я понял где я накосячил, я создал вдев с другим ашифт и теперь я не могу его удалить....

Art

Art

если vdev удалить, то данные на пуле будут повреждены

Если из вдевов построен зеркальный пул, то он должен пережить потерю одного)

Art

Art

в общем я понял где я накосячил, я создал вдев с другим ашифт и теперь я не могу его удалить....

Я даже не знал, что в принципе возможно добавить в пул вдев с другим ашифтом)

Как ты это провернул?)

Art

Art

а какая команда удаления vdev из zfs пула?

zpool remove poolname vdevname

Я так на стенде в виртуалке удалял

Aba

Aba

Владимир

Владимир

zpool remove poolname vdevname

Я так на стенде в виртуалке удалял

да, я тоже, но не удаляет из-за другого ашифта

Владимир

Владимир

Я даже не знал, что в принципе возможно добавить в пул вдев с другим ашифтом)

Как ты это провернул?)

ну как обычно через аргумент

nikolay

nikolay

Я даже не знал, что в принципе возможно добавить в пул вдев с другим ашифтом)

Как ты это провернул?)

скорее там не ashift, а sector size другой, если конечно автор не задавал ashift явно