Autumn

Autumn

инерция, потихоньку переберутся

ну на новых инсталляциях уже будем "переобуваться", а то что работает никто уже трогать не будет =)

riv

riv

Игорь

Игорь

riv

riv

Архив есть? Самое быстрое решение лежит в наличии архива, полагаю.

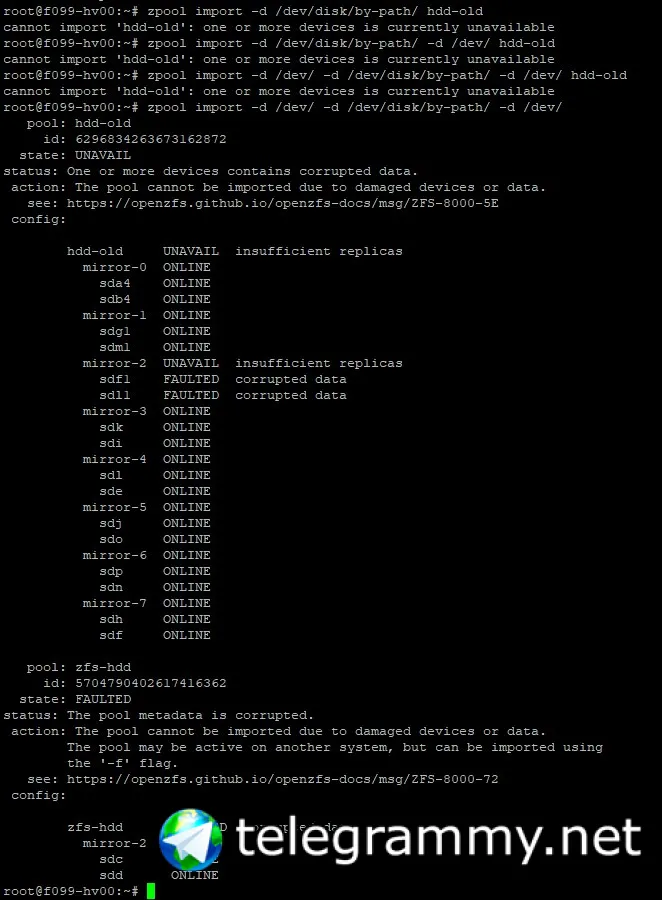

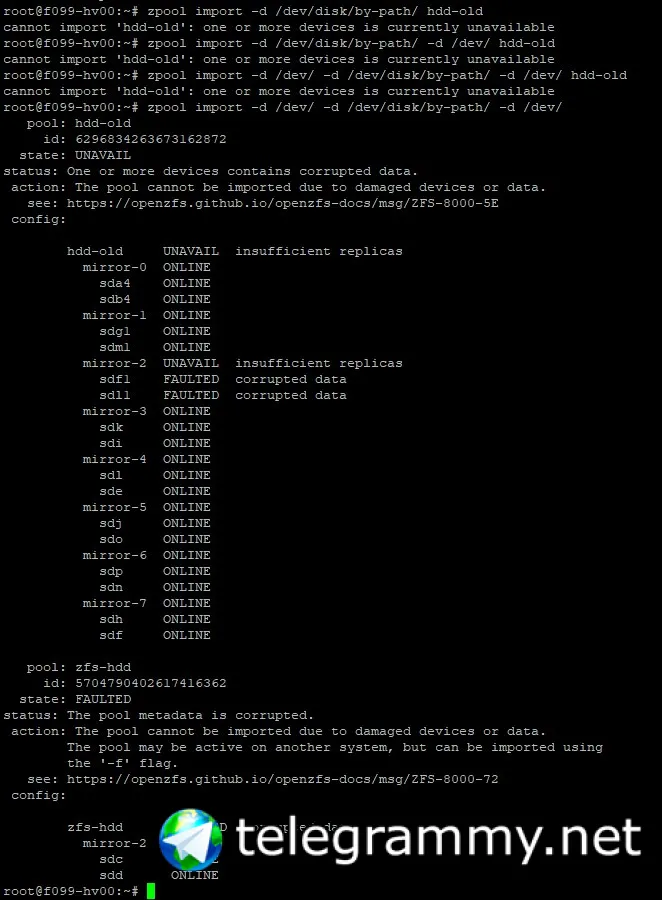

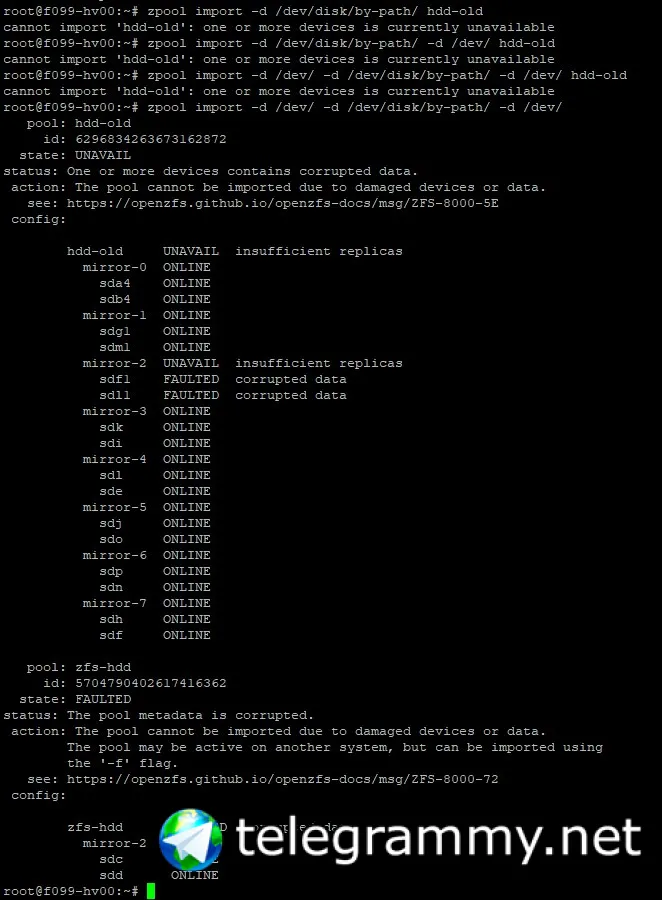

Там сложный вопрос, дело не в архиве. Это старый массив, который не планировалось импортировать, но сейчас потребовалось, чтобы разобраться в том какие точки монтирования использовались до экспорта.... в общем, тот случай, когда архив бесполезен ) Но дело не в этом. Я знал что, может быть потребуется взглянуть на эти данные и диски далеко не убирал. Произошедшее для меня полнейшая неожиданность. Как такая ситуация вообще могла возникнуть?

Игорь

Игорь

Там сложный вопрос, дело не в архиве. Это старый массив, который не планировалось импортировать, но сейчас потребовалось, чтобы разобраться в том какие точки монтирования использовались до экспорта.... в общем, тот случай, когда архив бесполезен ) Но дело не в этом. Я знал что, может быть потребуется взглянуть на эти данные и диски далеко не убирал. Произошедшее для меня полнейшая неожиданность. Как такая ситуация вообще могла возникнуть?

Возможно, с массивом в историческом прошлом выполнялись какие-то подобные же действия и где-то остались старые метаданные, которые при импорте подхватились первыми. Я такое встречал однажды с массивом значительно меньше, на одно зеркало. В моём случае админ что-то переименовывал, разделы отключал и подключал, и получилось именно так - два пула и диски между ними в перехлёст. Совсем всё плохо не было, как тут, когда пул развалился, так понимаю. Вроде бы тогда сделал экспорт обоих пулов и вручную импортировал нужный пул, указывая GUID, а не имя пула. Потом вообще подчистил диски (нулями dd-шнул) по-очереди и заново завёл в пул.

George

George

George

George

riv

riv

а насколько быстро после экспорта диски обесточили? Не припомню тикетов с такой проблемой, похоже что железо в чём то соврало (либо оч редкий баг, но без репродьюсера дебажить нереально)

Посыпаю голову пеплом! ZFS не виновата. В корзину на самом деле были вставлены левые диски. Меня ввело в заблуждение что у обоих пулов совпадает номер vdev: в одном есть только второй vdev, а в другом есть все, кроме второго. Но при ближайшем рассмотрении, выяснилось, что это вообще были две SSD другого объема и вообще там были метаданные. Недостающие диски нашли, вставили в корзану и все завелось.

George

George

Fedor

Fedor

Aba

Aba

Может кто подскажет по следующей ситуации:

NAME AVAIL USED USEDSNAP USEDDS USEDREFRESERV USEDCHILD

zroot 6.74G 147G 0B 88K 0B 147G

zroot/ROOT 6.74G 41.6G 0B 88K 0B 41.6G

zroot/ROOT/default 6.74G 41.6G 0B 41.6G 0B 0B

zroot/tmp 6.74G 39.8M 0B 39.8M 0B 0B

zroot/usr 6.74G 13.2G 0B 88K 0B 13.2G

zroot/usr/home 6.74G 13.2G 0B 13.2G 0B 0B

zroot/var 6.74G 92.4G 0B 88K 0B 92.4G

zroot/var/audit 6.74G 88K 0B 88K 0B 0B

zroot/var/crash 6.74G 88K 0B 88K 0B 0B

zroot/var/log 6.74G 92.4G 0B 92.4G 0B 0B

zroot/var/mail 6.74G 7.61M 0B 7.61M 0B 0B

zroot/var/tmp 6.74G 88K 0B 88K 0B 0B

root@serv:log du -d 1 -m /var/log | sort -n

1 /var/log/3proxy

1 /var/log/atop

1 /var/log/cups

1 /var/log/letsencrypt

1 /var/log/netdata

1 /var/log/nut

1 /var/log/samba4

6 /var/log/tor

48 /var/log/smartd

78 /var/log

zfs говорит, что /var/log юзает 92 гига, при этом du, считает, что в /var/log лишь 78 метров.

Пул - зеркало, снапшотов нет.

root@serv:log zfs version

zfs-2.0.0-FreeBSD_gf11b09dec

zfs-kmod-2.0.0-FreeBSD_gf11b09dec

Ivan

Ivan

Aba

Aba

ну так поди зфс вместе с метой показывает а ду - по сумме длин файлов

т.е. там 92Гб метаданных из 78мб реальных файлов?)

Aba

Aba

И место продолжает сокращаться... уже из доступного пространства 4.44Гб осталось (выше было 6.74)

Aba

Aba

Нашел виновника торжества. _pflogd pflogd 96153 4 - 38 -rw------- 384181785202 rw

Забыл логи отключить в pf когда отлаживал фаер :) Хотя логирование в файл у меня выключено, за какимто болтом pflog создавал дескриптор в /var/log

Александр

Александр

подскажите ктонибудь

1. Не суетиться

2. Сделать копию диска

3. Рассказать подробно, как дошел до жизни такой

Anonymous

Anonymous

# zpool import -f

pool: OVER

id: 7316868942039014810

state: ONLINE

status: Some supported features are not enabled on the pool.

(Note that they may be intentionally disabled if the

'compatibility' property is set.)

action: The pool can be imported using its name or numeric identifier, though

some features will not be available without an explicit 'zpool upgrade'.

config:

OVER ONLINE

ata-WDC_WUH721414ALE6L4_QBKVBRUT ONLINE

пытаюсь смонтировать - и после выдает ошибку

# zpool import -f OVER

cannot import 'OVER': I/O error

Destroy and re-create the pool from

a backup source.

если попробовать так - выдает следующее

# zpool import -FfmX OVER

cannot import 'OVER': one or more devices is currently unavailable

удалить его не получается - так понимаю потомучто он не импортирован...

# zpool destroy OVER

cannot open 'OVER': no such pool

Anonymous

Anonymous

единственное что я не сделал - на битые сектора пока не проверил т.к диск на 12тб это долго - на ночь позже поставлю

Anonymous

Anonymous

# zpool import -f OVER

cannot import 'OVER': I/O error

Destroy and re-create the pool from

a backup source.

Anonymous

Anonymous

причем у меня было 2 пула с zfs - создавал одинаково

причем второй рабочий пул с несколькими ФС и 2мя дисками

а этот сломанный самый простой был - там 1 диск и 1ФС на весь диск

Anonymous

Anonymous

создавались просто

zpool create ИМЯ

zfs create ИМЯ/ФС

и потом задал точку монтирования - на этом всё - больше нечего не настраивал

Александр

Александр

Anonymous

Anonymous

да в том то и дело - вроде нечего не делал

как выше писал - у меня 2 пула было - и сломанный почти не использовался - там просто куча фильмов складировалось и всё

в идеале восстановить полностью конечно... там занято 6тб - сейчас проблематично будет их переместить кудато

Anonymous

Anonymous

> I/O error

с диском точно всё ок?

пока на 100% не уверен - не проверял сектора - но смарт нормальный и кабель 100% целый

Александр

Александр

Anonymous

Anonymous

ну я примерно это уже сделал - только наоборот накатил

2.0.7 это в другом дистрибутиве - накотором сломался 1 из пулов + на немже и 2й находится - который как работал так и работает

сейчас я поставил ubuntu 22.04

root@u-pc:~# zfs --version

zfs-2.1.2-1ubuntu3

zfs-kmod-2.1.2-1ubuntu3

root@u-pc:~# zpool --version

zfs-2.1.2-1ubuntu3

zfs-kmod-2.1.2-1ubuntu3

не на что не повлияло - ошибки теже

+ на версии 2.0.7 - создавались эти 2 пула и довольно долго проработали...

точно есть смысл в откате? это не проблема откачусь

Egor

Egor

Δαρθ

Δαρθ

A.

A.