Δαρθ

Δαρθ

Но если на принимающей стороне есть zfs - то все же zfs send | zfs recv - предпочтительней

почему? нет ну то есть если не складывать стрим zfs send в файл то да. а если складывать без цели дальнейших инкрементальных сендов -- то не вижу смысла

Δαρθ

Δαρθ

Миллион файлов копировать не сказать что быстро

я кстати как-то раз проверял. время чтения десятков тыщ мелких файлов с холодными кешами (типичный рут раздел)

победила btrfs, zfs оказалась самой медленной )

mikhail

mikhail

почему? нет ну то есть если не складывать стрим zfs send в файл то да. а если складывать без цели дальнейших инкрементальных сендов -- то не вижу смысла

Не, ну если стрим складировать в виде файла - то тогда это конечно попахивает поиском проблем на свои ягодницы, согласен. Просто насколько я помню - первоначальный вопрос был - как перенести диск с компа в виртуалку...

Andrey

Andrey

я кстати как-то раз проверял. время чтения десятков тыщ мелких файлов с холодными кешами (типичный рут раздел)

победила btrfs, zfs оказалась самой медленной )

Ну если данные не нужны - то выбирайте btrfs. В ней с надежностью не ахти, разваливается при большой нагрузке

Δαρθ

Δαρθ

Ну если данные не нужны - то выбирайте btrfs. В ней с надежностью не ахти, разваливается при большой нагрузке

для рутфс или хомяка вполне ок -- работает годами

Δαρθ

Δαρθ

еще есть ништяки: например дефрагментация файлов И свободного места, переезд между конфигурациями дисков, поддержка cp --reflink=always, в тч между субвольюмами (=аналог датасетов)

Алексей

Алексей

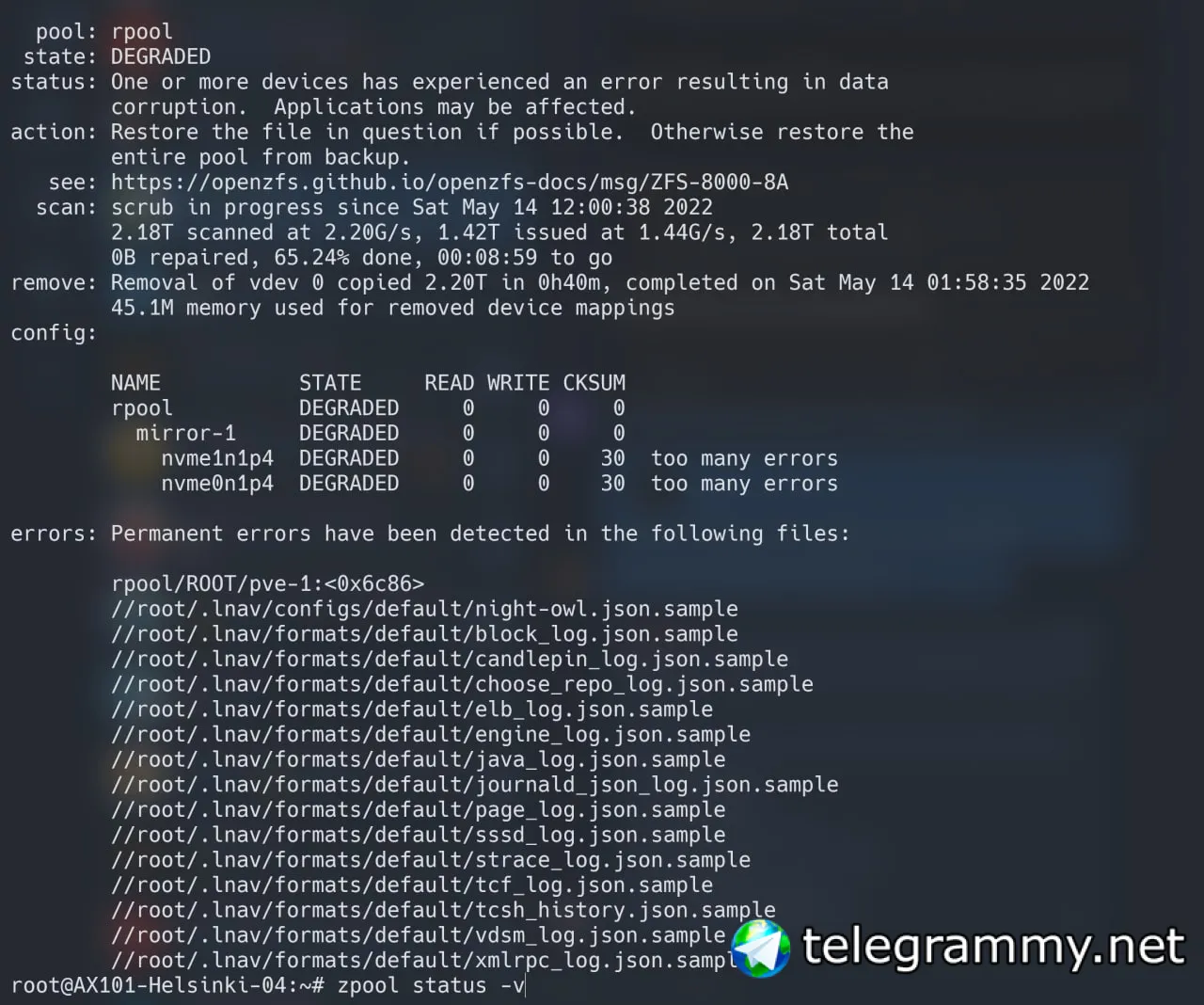

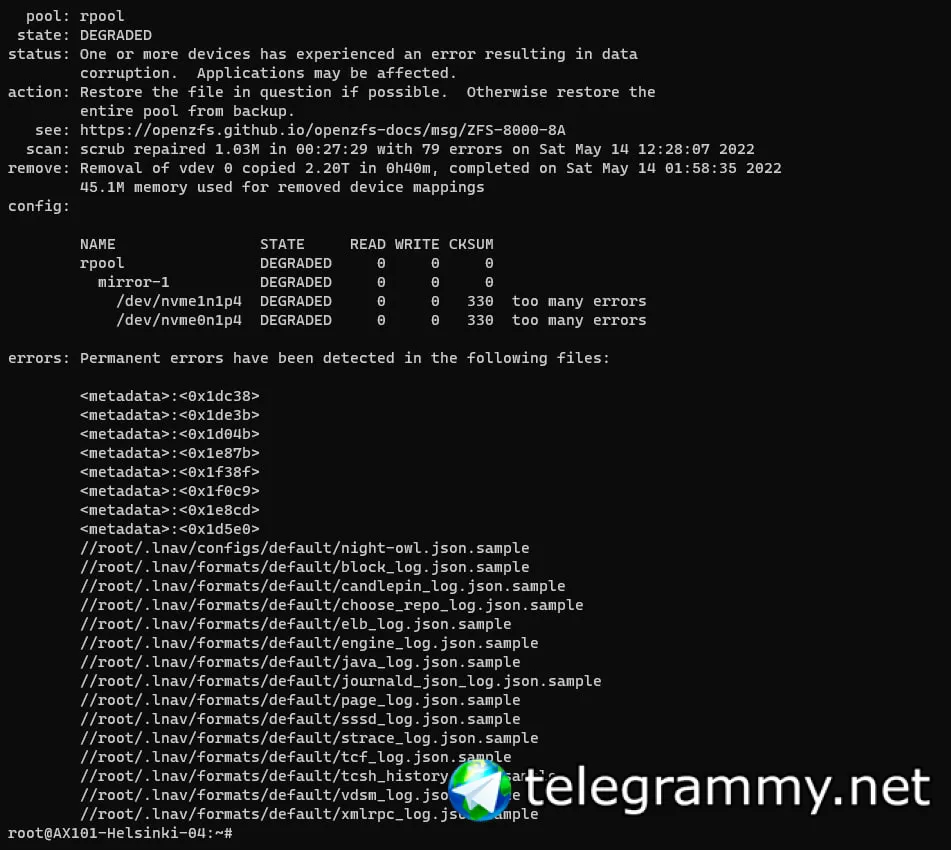

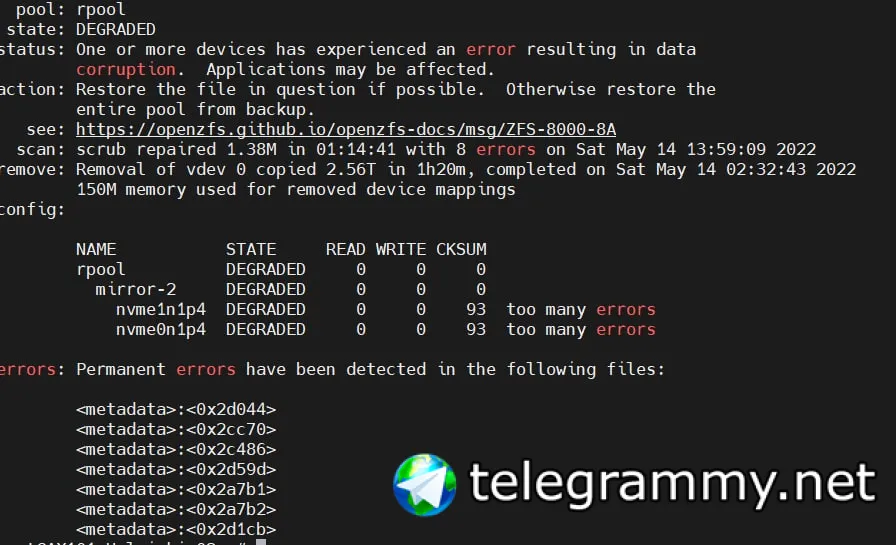

Добрый выходной день всем. У меня некоторая проблема =) Попробую описать максимально подробно. Имею кластер Proxmox на zfs. Возникла необходимость освободить место под swap раздел. Нужно было уменьшить зеркало zfs. На серверах установлено 2 SSD диска. Они в mirror-0 . для того что бы выкроить место для swap, уменьшил разделы zfs, действовал так: https://docs.google.com/document/d/16UvqRHTbEEJ_QUkFxA5oS73su2xiicZnvYuL-2W9i3k/edit?usp=sharing

После проведения указанных в документе процедур на серверах начали вылазить ошибки чексум:

Алексей

Алексей

Если файлы, например, я могу восстановить с соседних нод или пересоздать файлы логов, то что делать с метаданными?

Алексей

Алексей

я не знаю, как решать проблему, кроме переустановки нод, чего крайне хотелось бы избежать. Если кто то может дать подсказку, как решить проблему, буду крайне благодарен.

Denis

Denis

Не понимаю зачем свап на zfs на проксе всегда старался чтоб его небыло, раз сервера возьмите на каждый по 120 ссд и кэшем их - куда догичнее как по мне

Алексей

Алексей

Не понимаю зачем свап на zfs на проксе всегда старался чтоб его небыло, раз сервера возьмите на каждый по 120 ссд и кэшем их - куда догичнее как по мне

сейчас вопрос не о swap (к тому же он не на zfs а отдельным swap разделом)... swap, в данной ситуации, уже последнее, что меня волнует...

Denis

Denis

У меня не было необходимости уменьшать только увеличивать про свап просто не первый раз спрашивают

Δαρθ

Δαρθ

а своп зачем нужен? если хлам и утечки складывать -- то можно любой винт поставить дополнительно

A.

A.

Там не про уменьшение было. А про добавление в linear меньшего раздела на диске, оторванном от зеркала

Алексей

Алексей

Пулу конец, скорее всего

переустанавливаем ноды потихоньку, данные пока целы... есть опасение, что только пока, поэтому спешим =)

Игорь

Игорь

Владимир

Владимир

Всем привет. Юзает кто-нибудь cassandra на блочном устройстве zfs? Есть какие-то рекомендации к размеру волблока? и вообще рекомендации на эту тему?

Grigory

Grigory

Всем привет. Юзает кто-нибудь cassandra на блочном устройстве zfs? Есть какие-то рекомендации к размеру волблока? и вообще рекомендации на эту тему?

Доброго времени.

Тут нет про касандру, но есть про БД

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Workload%20Tuning.html#database-workloads

Владимир

Владимир

George

George

# ioping -D /dev/sdb9

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=1 time=696.5 ms (warmup)

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=2 time=66.5 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=3 time=427.2 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=4 time=270.9 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=5 time=3.16 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=6 time=257.3 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=7 time=389.8 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=8 time=567.4 ms (slow)

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=9 time=109.9 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=10 time=780.6 ms (slow)

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=11 time=160.9 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=12 time=500.2 ms

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=13 time=848.0 ms (slow)

4 KiB <<< /dev/sdb9 (block device 8 MiB): request=14 time=107.4 ms

норм qlc ссдшка, да

George

George

Это где такое чудо?)

это один товарищ в далёкой стране поставил бытовые самсунги за raid контроллер без поддержки trim под бекапы

George

George

Чел хотя бы догадался поставить raid controller перед zfs, уже радует.

вообще это вредный совет, hba нужен

The

The

вообще это вредный совет, hba нужен

Кто же в здравом уме parity на откуп zfs отдаёт? Тем более на ssd. Там перфоманс будет никакущий.

George

George

The

The

То, что zfs на raidz2 показывает результаты вдвое хуже даже опенсорсного mdadm, уже доказанный тестами факт. Не говоря уже про рейд с батарейкой, который, допустим, может онлайн сделать из raid10 луна raid6 и назад, при определённых обстоятельствах.

George

George

То, что zfs на raidz2 показывает результаты вдвое хуже даже опенсорсного mdadm, уже доказанный тестами факт. Не говоря уже про рейд с батарейкой, который, допустим, может онлайн сделать из raid10 луна raid6 и назад, при определённых обстоятельствах.

слишком жирно для полуночных баталий, начиная с того, что mdadm и zfs на разных кейсах делают друг друга

George

George

вот хорошее сравнение https://arstechnica.com/gadgets/2020/05/zfs-versus-raid-eight-ironwolf-disks-two-filesystems-one-winner/

George

George

ну и классический вопрос про "как железный рейд определит какой из блоков на мирроре валидный а какой мусорный"

The

The

The

The

ну и классический вопрос про "как железный рейд определит какой из блоков на мирроре валидный а какой мусорный"

Что значит "мусорный"?

Ivan

Ivan

Что значит "мусорный"?

классические контроллеры не ведут чексумм на зеркалах и 10 рейде. не могут знать какие данные испорчены, а какие нет.

The

The

вот хорошее сравнение https://arstechnica.com/gadgets/2020/05/zfs-versus-raid-eight-ironwolf-disks-two-filesystems-one-winner/

Вот тут про SSD, например.

https://habr.com/ru/company/raidix/blog/420837/

Я понимаю, что mdadm то ещё багованное поделие, но даже с ним...

Fedor

Fedor

Vladislav

Vladislav