Ivan

Ivan

https://openzfs.github.io/openzfs-docs/Getting%20Started/Debian/Debian%20Bullseye%20Root%20on%20ZFS.html

Aleksandr

Aleksandr

В любом случае должен быть FAT32 раздел, чтобы UEFI мог загрузить загрузчик или ядро.

UEFI всегда и везде имеет FAT32 раздел

Maverick

Maverick

Коллеги подскажите а какой лучше массив zfs сделать приоритет на скорость для виртуалок. Совместно с проксмокс будет. Hdd 7200 4tb количество до 12, количество, ОЗУ 32gb.

nikolay

nikolay

Коллеги подскажите а какой лучше массив zfs сделать приоритет на скорость для виртуалок. Совместно с проксмокс будет. Hdd 7200 4tb количество до 12, количество, ОЗУ 32gb.

скорость для виртуалок на 12 дисках 7200к рпм? что вы подразумеваете под скоростью?

Marina

Marina

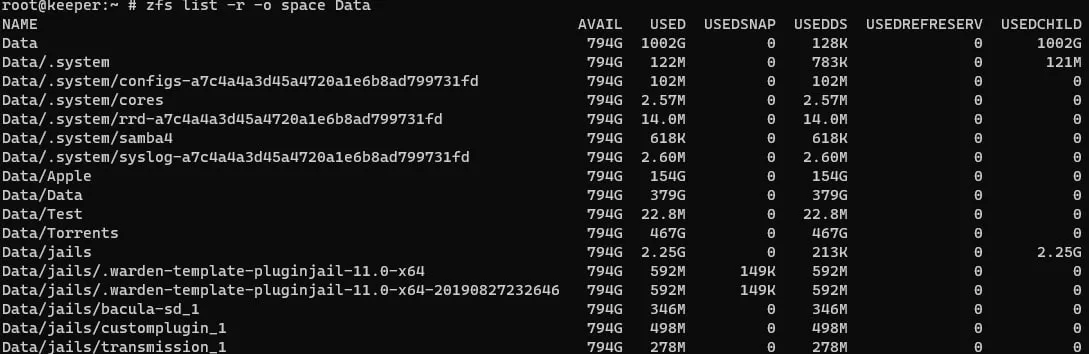

Всем привет. Может кто подсказать по поводу размеров разделов zfs? Есть пул Data и я так понимаю что в нем есть еще отдельный volume с названием Data.

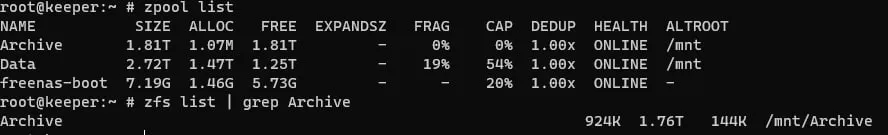

Там три диска по 1ТБ, и судя по выводу команды zpool list - размер 2.72T (и свободно 1.27T)

А команда zfs list показывает что свободно 808G. Можно как-то расширить volume чтобы было доступно все свободное место?

Подскажите пожалуйста в какую сторону копать. Спасибо.

Maverick

Maverick

скорость для виртуалок на 12 дисках 7200к рпм? что вы подразумеваете под скоростью?

Чем больше скорость чтения записи тем лучше. Как лучше собрать

Ilya

Ilya

Всем привет. Может кто подсказать по поводу размеров разделов zfs? Есть пул Data и я так понимаю что в нем есть еще отдельный volume с названием Data.

Там три диска по 1ТБ, и судя по выводу команды zpool list - размер 2.72T (и свободно 1.27T)

А команда zfs list показывает что свободно 808G. Можно как-то расширить volume чтобы было доступно все свободное место?

Подскажите пожалуйста в какую сторону копать. Спасибо.

вывод zpool list && zpool status && zfs list покажи

Marina

Marina

вывод zpool list && zpool status && zfs list покажи

Ilya

Ilya

Marina

Marina

Vladislav

Vladislav

Ilya

Ilya

Marina

Marina

по-видимому, снапшоты

zfs list -r -o space Data

Vladislav

Vladislav

11.1

Окей, не ожидал. Так или иначе рекомендую обновить до 12.0, там интерфейс поприятней

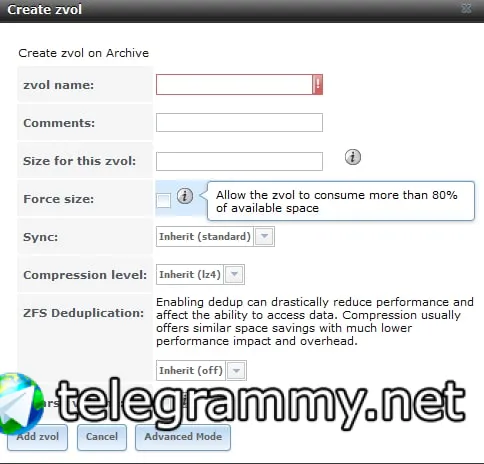

И 80% это рекомендация скорее логическая, нежели физическая.

Marina

Marina

Обновите до truenas...

Стремно как-то на текущей инсталляции обновлять) Но я пробовала поставить на отдельную флешку - но не вышло, в полуживом виде установилось и половина сервисов не стартануло, хз почему. Решила остаться на старом фринасе, он хотябы работает. А трунас еще больше ресурсов хочет.

Marina

Marina

Окей, не ожидал. Так или иначе рекомендую обновить до 12.0, там интерфейс поприятней

И 80% это рекомендация скорее логическая, нежели физическая.

До 12 попробую. Но разве это как-то повлияет на размеры разделов?

Vladislav

Vladislav

Стремно как-то на текущей инсталляции обновлять) Но я пробовала поставить на отдельную флешку - но не вышло, в полуживом виде установилось и половина сервисов не стартануло, хз почему. Решила остаться на старом фринасе, он хотябы работает. А трунас еще больше ресурсов хочет.

Там ресурсы из разряда на 5 гигов места больше

George

George

Marina

Marina

Raidz, zpool показывает сырое место, а zfs - полезное

Roman

Roman

Marina

Marina

У тебя raidz1 т.е по факту, из 3 дисков на 1 Тб полезного места 2/3, т.е меньше 2 ТБ

Понятно, то есть это не у меня криво создался раздел, а так и задумано

Ivan

Ivan

в дебиане проприетарщина ставится при подключении non-free репы. так что нет, не проприетарный. и в 11 дебиане докер актуальной версии. композ только чуть старее последней версии.

Marina

Marina

Roman

Roman

Marina

Marina

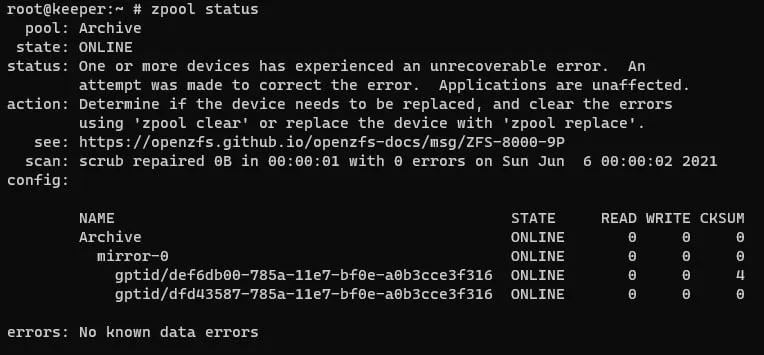

мб scrub

zpool scrub команда не дала результата - scan: scrub repaired 0B in 00:00:00 with 0 errors

George

George

George

George

не стоит так делать, если хочется разделить миррор на 2 пула - zpool split, если хочется временно - то zpool offline и импорт с ридонли, а потом ресильвер

Marina

Marina

WAT, на запись чтоли импортировали?

после команды zpool import -f у меня все автоматом смонтировалось. Я еще там попробовала файл создать (было интересно засинхронится ли он потом после возвращения в пул). Потом отключила его через zpool export и он отмонтировался. Ну и после этого вернулся в старый комп

Marina

Marina

не стоит так делать, если хочется разделить миррор на 2 пула - zpool split, если хочется временно - то zpool offline и импорт с ридонли, а потом ресильвер

да понимаю что странный кейс, но мне просто было интересно проверить сохранность данных

George

George

после команды zpool import -f у меня все автоматом смонтировалось. Я еще там попробовала файл создать (было интересно засинхронится ли он потом после возвращения в пул). Потом отключила его через zpool export и он отмонтировался. Ну и после этого вернулся в старый комп

как обратно в пул его возвращали?

George

George

вообще это не ожидаемый кейс, я удивлён что без действий диск обратно в пул принялся, видимо спасло что состояние пула было в памяти и как основной считался первый диск. В самом простом случае есть смысл передобавить второй диск, вплоть до split и потом его attach

Marina

Marina

Ну вообще наверное ожидаемо, что фринас сам об этом заботится, как только видит диск. Мне помогло zpool detach & add - ошибки пропали, данные на месте

Marina

Marina

Ну вообще наверное ожидаемо, что фринас сам об этом заботится, как только видит диск. Мне помогло zpool detach & add - ошибки пропали, данные на месте

ой, нет, не помогло, mirror пропал из статуса)

nikolay

nikolay

Чем больше скорость чтения записи тем лучше. Как лучше собрать

На 12 дисках в режиме sync вы получите минимальную производительность даже в raid10. Поэтому вы для начала определитесь сколько вешать в граммах, другими словами сколько у вас будет виртуалок, какая нагрузка будет на них и какие показатели производительности (скорости) вам необходимы

George

George

Ну вообще наверное ожидаемо, что фринас сам об этом заботится, как только видит диск. Мне помогло zpool detach & add - ошибки пропали, данные на месте

именно add сделали? Ну тогда теперь это не миррор, а страйп)

Marina

Marina

именно add сделали? Ну тогда теперь это не миррор, а страйп)

ага) а теперь безопасно можно сделать его миррором, или пересоздать все с нуля проще?)

George

George

Marina

Marina

проще пересоздать

ну в общем да, на stackoverflow пост нашла там тоже пишут что только пересоздание)

Roman

Roman

ага) а теперь безопасно можно сделать его миррором, или пересоздать все с нуля проще?)

Если свежий zfs то remove+attach

Marina

Marina

Быстро Вы

ну там из вебморды обновление прошло быстро и успешно, в отличие от моей попытки установить новый трунас на флешку - там установка шла больше часа почему-то (и неудачно)

Marina

Marina

Пересозданный пул на TrueNas уже создался с новой версией, старый пул предлагает сделать upgrade но предупреждает что из-за новых фич могут быть проблемы на старых версиях. Это значит что этот пул вообще уже никогда не подключится ни на одной из старых freenas версий?

Maverick

Maverick

На 12 дисках в режиме sync вы получите минимальную производительность даже в raid10. Поэтому вы для начала определитесь сколько вешать в граммах, другими словами сколько у вас будет виртуалок, какая нагрузка будет на них и какие показатели производительности (скорости) вам необходимы

К сожалению это особо не определить так как в виртуалку будет бд и она будет переноситься со Спарк... Aix. На х86 конвентится и сколько ей тут понадобиться вопрос.... И чё померить тоже. А так хотелось бы наибольшую производительрость

Roman

Roman

Пересозданный пул на TrueNas уже создался с новой версией, старый пул предлагает сделать upgrade но предупреждает что из-за новых фич могут быть проблемы на старых версиях. Это значит что этот пул вообще уже никогда не подключится ни на одной из старых freenas версий?

Делай upgrade и не используй старьё

nikolay

nikolay

К сожалению это особо не определить так как в виртуалку будет бд и она будет переноситься со Спарк... Aix. На х86 конвентится и сколько ей тут понадобиться вопрос.... И чё померить тоже. А так хотелось бы наибольшую производительрость

даже минимальная рандомная нагрузка порядка 1000 iops введет вашу базу в ступор и время отклика будет очень большим. переносите откуда? спарк - это солярка, aix - это aix, и там и там есть утилиты для замера текущей дисковой активности.

Ilya

Ilya

Пересозданный пул на TrueNas уже создался с новой версией, старый пул предлагает сделать upgrade но предупреждает что из-за новых фич могут быть проблемы на старых версиях. Это значит что этот пул вообще уже никогда не подключится ни на одной из старых freenas версий?

Новый трунас использует openzfs, которую старый не поддерживает, естественно

Maverick

Maverick

даже минимальная рандомная нагрузка порядка 1000 iops введет вашу базу в ступор и время отклика будет очень большим. переносите откуда? спарк - это солярка, aix - это aix, и там и там есть утилиты для замера текущей дисковой активности.

Ну я не нашел как замерить в aix 4 дисковую нагрузку. Подскажите пожалуйста или пните где почитать

Andrey

Andrey

Ну я не нашел как замерить в aix 4 дисковую нагрузку. Подскажите пожалуйста или пните где почитать

А БД какая, видимо Oracle?

Andrey

Andrey

если Oracle - нужно будет подтюнить БД и ARC.

опять же 1000 iops каких? - если по чтению - то вот например

time read miss miss% dmis dm% pmis pm% mmis mm% arcsz c

11:14:43 2 0 0 0 0 0 0 0 0 23G 24G

11:14:44 1.5K 0 0 0 0 0 0 0 0 23G 24G

11:14:45 1.7K 0 0 0 0 0 0 0 0 23G 24G

11:14:46 1.4K 0 0 0 0 0 0 0 0 23G 24G

11:14:47 383 0 0 0 0 0 0 0 0 23G 24G

11:14:48 504 0 0 0 0 0 0 0 0 23G 24G

11:14:49 443 0 0 0 0 0 0 0 0 23G 24G

11:14:50 22K 4 0 4 0 0 0 0 0 23G 24G

11:14:51 32K 2 0 2 0 0 0 0 0 23G 24G

11:14:52 28K 3 0 3 0 0 0 0 0 23G 24G

11:14:53 27K 0 0 0 0 0 0 0 0 23G 24G

11:14:54 3.0K 1 0 1 0 0 0 1 0 23G 24G

11:14:55 5.3K 0 0 0 0 0 0 0 0 23G 24G

Sergey

Sergey

The

The