Кстати, более-менее в тему вопрос.

Кто-то делал тесты/замеры/наблюдения, есть ли разница, отдан под zfs весь диск в сыром виде или сделан отдельный раздел и отдан только он?

Разница не большая в районе 5%

Георгий

Георгий

Nikita

Nikita

Разница не большая в районе 5%

Мол, падает производительность, если условно, отдать ему из 10000Гб раздел размером 9500Гб против передачи всего диска на откуп zfs?

Art

Art

а если jbod или hba тоже плохо?

не... ну hba это ж прямой доступ и есть по сути, так ведь, с ним всё огонь!

Ярослав

Ярослав

Мол, падает производительность, если условно, отдать ему из 10000Гб раздел размером 9500Гб против передачи всего диска на откуп zfs?

Да, но все зависит от конкретного железа и конфигурации пула. Цифра может быть меньше или больше. Всегда когда строю пул на барметал, стараюсь отдавать весь диск сразу. Но к примеру проксмокс инсталлятор при установке корня и загрузки на zfs делает отдельные gpt партици

Δαρθ

Δαρθ

Мол, падает производительность, если условно, отдать ему из 10000Гб раздел размером 9500Гб против передачи всего диска на откуп zfs?

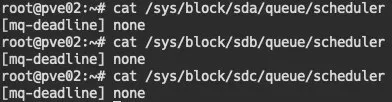

говорят если дать весь диск оно работает мимо линухового io шедулера юзая свой.

Nikita

Nikita

говорят если дать весь диск оно работает мимо линухового io шедулера юзая свой.

А вот это надо проверить

Ivan

Ivan

говорят если дать весь диск оно работает мимо линухового io шедулера юзая свой.

а как дать весь диск, если zfs сама создает партиции ?

Nikita

Nikita

Andrey

Andrey

Если посмотреть linux io diagram

https://www.thomas-krenn.com/de/wikiDE/images/e/e0/Linux-storage-stack-diagram_v4.10.png

то можно предположить, что если zfs отдан, например, /dev/sdb -то

путь взаимодействия м б LIO->optional->BIO->hooked in device drivers->/dev/sd*

Если же отдан раздел /dev/sdb2(например) - то путь взаимодействия через scheduler

Косвенно можно понять, например, если расширить блочное устройство /dev/sdb (в среде виртуализации к примеру) - то при расширении zfs - проблем не наблюдается, а при расширении /dev/sdb2(а /dev/sdb1 замонтирован наппример как ext4) требуется перечитать партиции с помощью partprobe или partx - но не получится, т к /dev/sdb управляется ядром,таблица закэширована и для ее обновления необходимо размонтировать разделы

но это все предположения - нужно копать исходники, чтобы посмотреть как все это устроено

Eugen

Eugen

Народ, подскажите сколько метадату на Zol сделать? И главное сколько пользуюсь не пойму зачем она вообще нужна))

central

central

Eugen

Eugen

а чем вызвана необходимость выставлять, по дефолту там вообще нету ограничения

Я просто значения Арк выставляю не дефолтные. На Арк выделяю 100гб из 128

George

George

Народ, подскажите сколько метадату на Zol сделать? И главное сколько пользуюсь не пойму зачем она вообще нужна))

Rtfm, без чтения меты получить доступ к блоку с данными нельзя (метаданные, в частности, и говорят где для файла лежит конкретный блок на диске), так что если пытаетесь что крутить без углубления в устройство - мету зарезать нельзя в arc.

Eugen

Eugen

Rtfm, без чтения меты получить доступ к блоку с данными нельзя (метаданные, в частности, и говорят где для файла лежит конкретный блок на диске), так что если пытаетесь что крутить без углубления в устройство - мету зарезать нельзя в arc.

Но тут закономерный вопрос, если арк где то 85% от общего обьема,зфс сам настроит количество меты адекватно или надо его править, и если да то сколько ему задать?

George

George

Но тут закономерный вопрос, если арк где то 85% от общего обьема,зфс сам настроит количество меты адекватно или надо его править, и если да то сколько ему задать?

Если вы только общий размер arc меняли то больше ничего не требуется менять, да

Eugen

Eugen

Sergey

Sergey

Станислав

Станислав

Nikita

Nikita

Коллеги, если ли возможность средствами zfs передать файловую систему с пула с включенным feature@large_dnode на пул с выключенным?

Vladislav

Vladislav

Стопнуть самбу. Примонтировать на запись пул и сменить на нужные права, смена пула в RO. Потом старт самбы

DOK ꧁꧂

DOK ꧁꧂

Подскажите плиз срочно. Второй ждиск с zfs был примонтирован в /mnt/sdb7

Сегодня его вытаскивали для осмотра. Поставили его обратно а его нет. В disks его видно как sdb2 но zfs его не примонтировала куда надо)

Как его примонтировать?

Art

Art

Import или add?

если у вас был пул из одного диска, и вы его вытаскивали, то теперь раз он не виден, то надо импорт пула сделать

Δαρθ

Δαρθ

а вот интересно, есть ли вариант забутить ядро линукса с zfs без initramfs. аргумент ядру может какой?

Станислав

Станислав

а вот интересно, есть ли вариант забутить ядро линукса с zfs без initramfs. аргумент ядру может какой?

А где ядро будет располагаться?

Sergey

Sergey

я имел в виду чтобы /root на openzfs монтировался без юзерспейсного инитрамфса

Можно, если сможете обеспечить возможность загрузки модуля zfs

Vladislav

Vladislav

я имел в виду чтобы /root на openzfs монтировался без юзерспейсного инитрамфса

https://openzfs.github.io/openzfs-docs/Getting%20Started/Ubuntu/Ubuntu%2020.04%20Root%20on%20ZFS.html

Δαρθ

Δαρθ

Можно, если сможете обеспечить возможность загрузки модуля zfs

оказалось что вкомпилировать зфс в ядро не так уж и сложно (что и сделал), то есть без модуля а прям сразу :)

Sergey

Sergey

Δαρθ

Δαρθ

очень круто поддерживается кстати. конфигуру надо сказать где лежат сорцы ядра (2 раза). после чего в menuconfige появляется галочка 'openzfs'. и собсно на этом всё )

Δαρθ

Δαρθ

https://openzfs.github.io/openzfs-docs/Getting%20Started/Ubuntu/Ubuntu%2020.04%20Root%20on%20ZFS.html

я ваще сторонник без initramfs жить. пока что единственное место где я его держу это там где mdraidы. во всех остальных случаях (правда без рута на openzfs) получается без него (в случае если я ядро свое собираю ессно, иначе -- не парюсь)

Δαρθ

Δαρθ

и в убунте вообще трындец с ним -- даже дрова satы в инитрамфс лежат (модулями), без него оно даже сата-винт не увидит

Alex

Alex

оффтоп сразу же после вступления, последнее предупреждение и в бан

Можно не ждать.

Они сегодня по всем чатикам, с женскими никами, и вопросами "а правда что всё плохо, и будет ещё хуже"?

И у всех сегодняшние фотки на аватарах.

George

George

The

The

Здравствуй, чатик. Есть тут задача: реплицировать полный инкрементальный список снапшотов из пула A в пул B.

Я правильно понимаю, что мне придётся городить портянки? Потому что

zfs send -cP -R -I | zfs receive

такого, по-видимому, не может.

Vladislav

Vladislav

Nikita

Nikita

Egor

Egor

Aba

Aba