Ну я не нашел как замерить в aix 4 дисковую нагрузку. Подскажите пожалуйста или пните где почитать

В гугле, я не специалист по aix

nikolay

nikolay

если Oracle - нужно будет подтюнить БД и ARC.

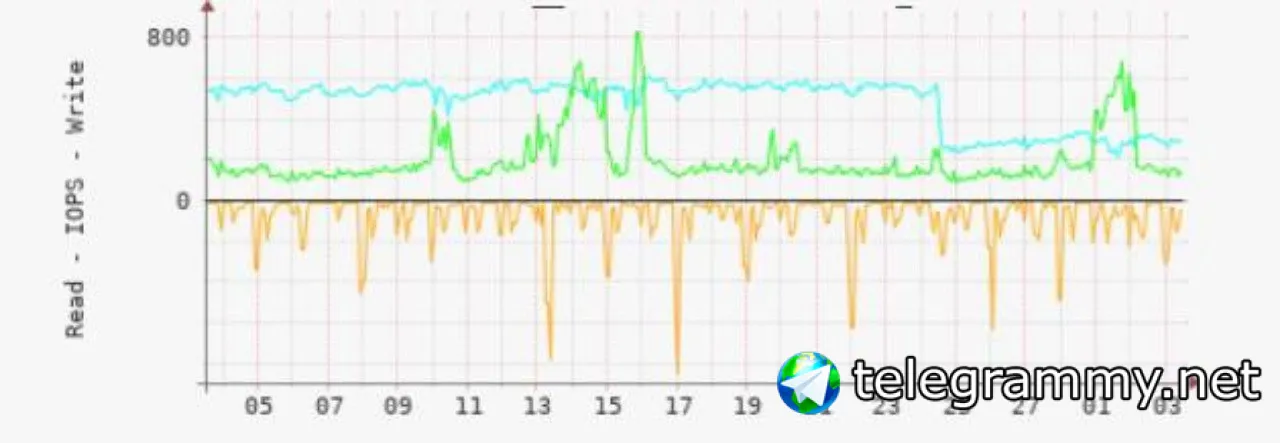

опять же 1000 iops каких? - если по чтению - то вот например

time read miss miss% dmis dm% pmis pm% mmis mm% arcsz c

11:14:43 2 0 0 0 0 0 0 0 0 23G 24G

11:14:44 1.5K 0 0 0 0 0 0 0 0 23G 24G

11:14:45 1.7K 0 0 0 0 0 0 0 0 23G 24G

11:14:46 1.4K 0 0 0 0 0 0 0 0 23G 24G

11:14:47 383 0 0 0 0 0 0 0 0 23G 24G

11:14:48 504 0 0 0 0 0 0 0 0 23G 24G

11:14:49 443 0 0 0 0 0 0 0 0 23G 24G

11:14:50 22K 4 0 4 0 0 0 0 0 23G 24G

11:14:51 32K 2 0 2 0 0 0 0 0 23G 24G

11:14:52 28K 3 0 3 0 0 0 0 0 23G 24G

11:14:53 27K 0 0 0 0 0 0 0 0 23G 24G

11:14:54 3.0K 1 0 1 0 0 0 1 0 23G 24G

11:14:55 5.3K 0 0 0 0 0 0 0 0 23G 24G

Нагрузка может быть рандомная и последовательная, плюс важен размер блока. Плюс для базы также важен latency, которого на вашем листинге нет.

Andrey

Andrey

Maverick

Maverick

George

George

со следующего релиза openzfs сжатие будет включено по умолчанию https://github.com/openzfs/zfs/commit/56fa4aa96eb3875f254e93eaef646ea20ba187f9

George

George

а volblocksize дефолтный поменяется на 16K https://github.com/openzfs/zfs/commit/72f0521abadd77ef06fb1d10c4f4f80af50ec279

The

The

со следующего релиза openzfs сжатие будет включено по умолчанию https://github.com/openzfs/zfs/commit/56fa4aa96eb3875f254e93eaef646ea20ba187f9

Уже давно с zfs на пк просто архивирую tar-ом без компрессора.

Maverick

Maverick

Уже давно с zfs на пк просто архивирую tar-ом без компрессора.

А сколько ОЗУ и в чем прелесть на ПК? Ssd?

The

The

Выделил лимит 4ГиБ.

Прелесть в снапшотах и интеграции с docker, libvirtd. А также удобный бэкап.

Да, SSD. ZFS на хардах — это что-то прям очень холодное.

Maverick

Maverick

Выделил лимит 4ГиБ.

Прелесть в снапшотах и интеграции с docker, libvirtd. А также удобный бэкап.

Да, SSD. ZFS на хардах — это что-то прям очень холодное.

А в lvm такого нет? Просто про интеграцию с докер и либвирт не слышал. А всего сколько ОЗУ?

The

The

LVM COW-снапшоты убоги.

Интеграция есть, но только с thin pool, который ещё более убог.

Плюс ещё ФС слоем ниже. А с zfs каталоги легко делаются датасетами, со своими или унаследованными параметрами. И так же легко монтируются клоны снапшотов, например.

Всего 16. Впаяны.

Andrey

Andrey

А чем это вы сделали. Мне на работе сказали лишь одно что на aix стоит на raid10. Просто прямого доступа то к нему тоже нет. Вот я и думаю mirrors делать или raidz(2)(3)

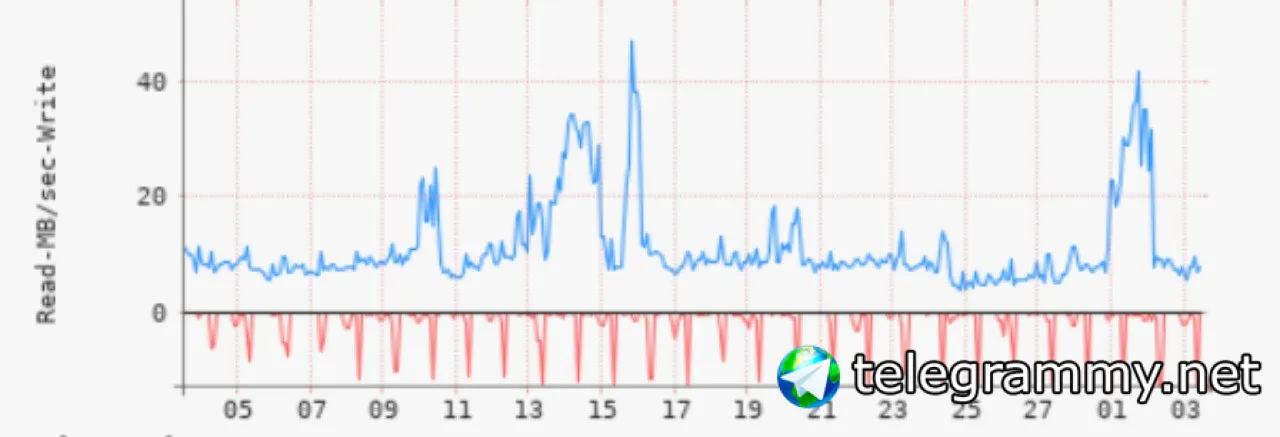

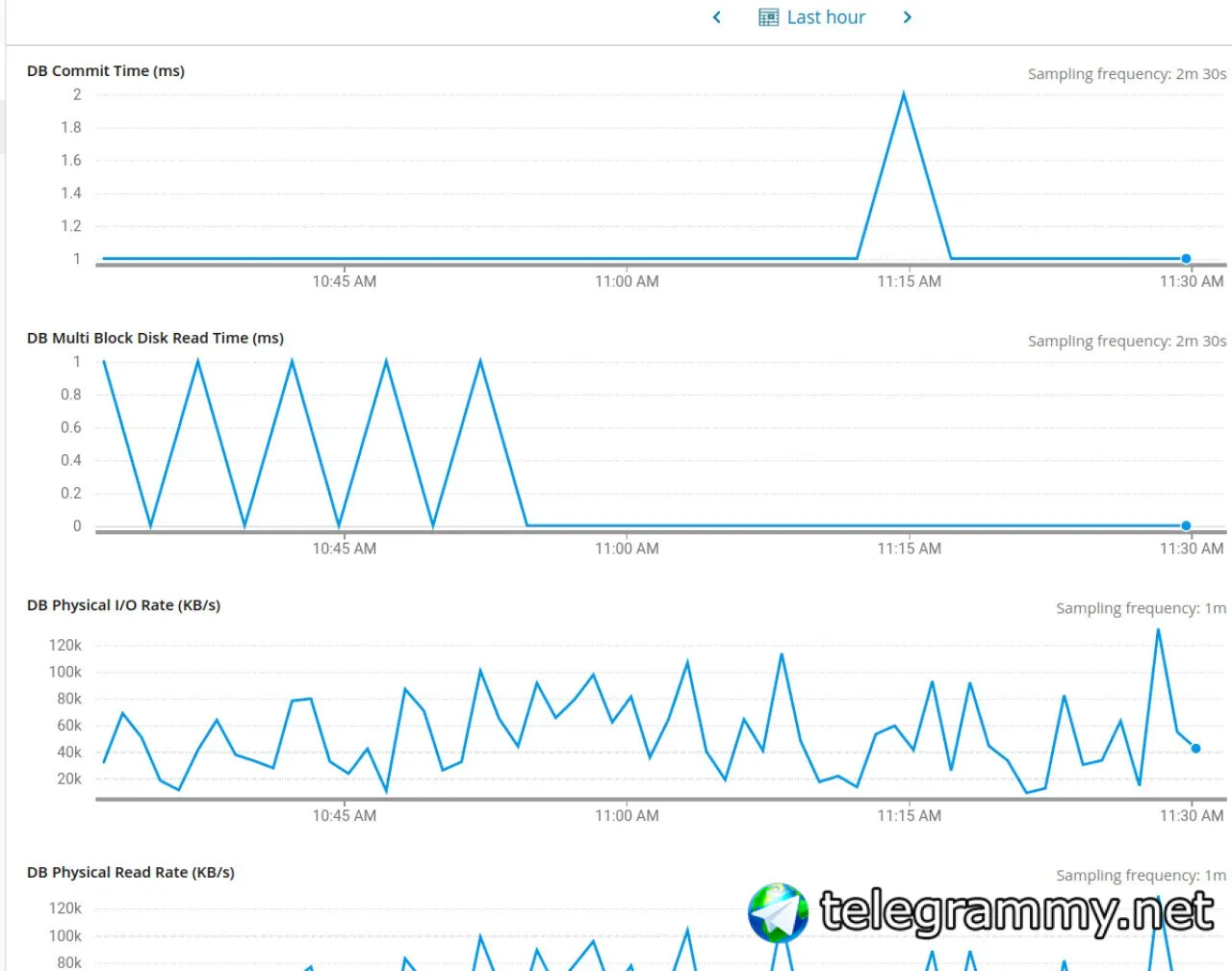

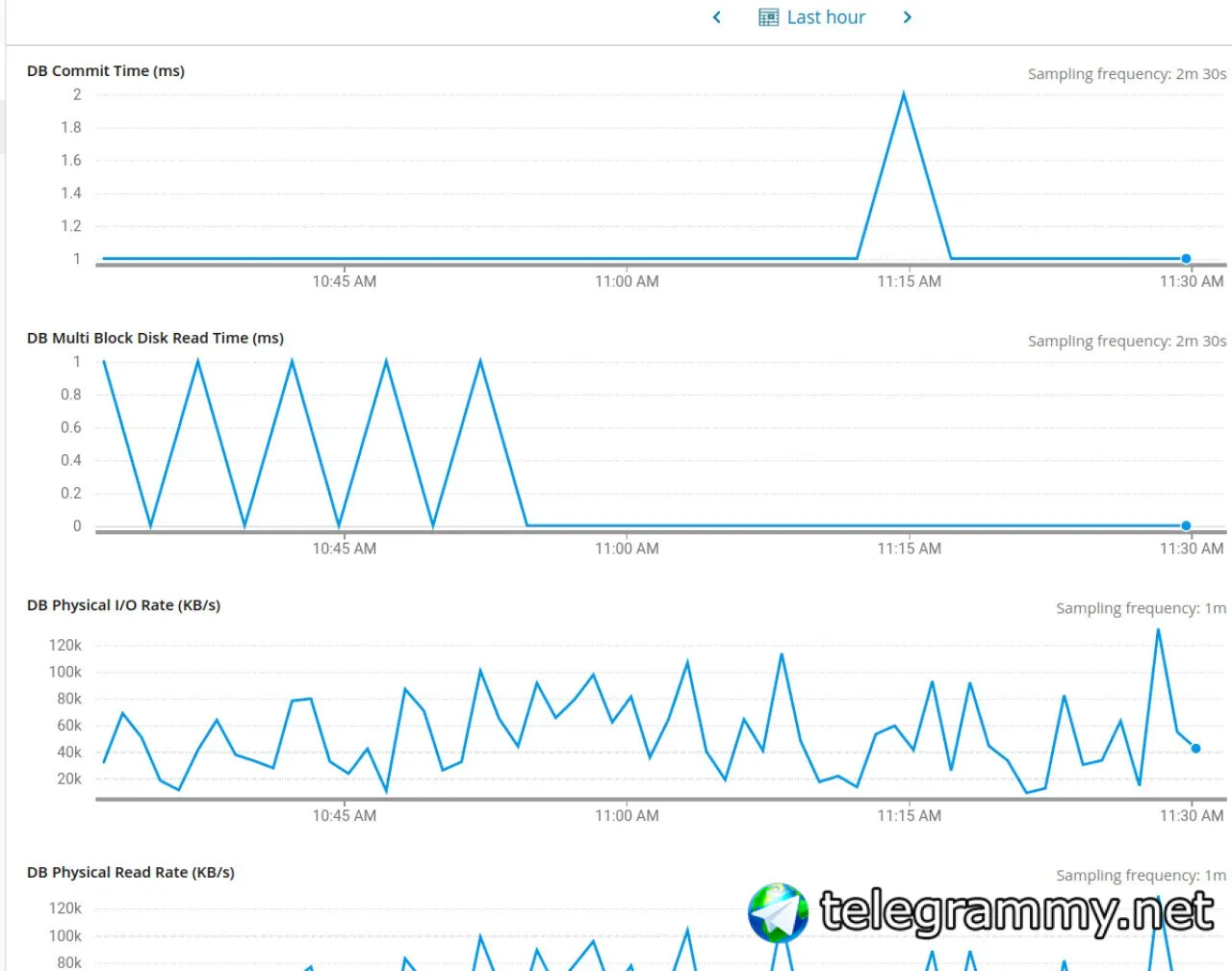

Это DPA и lpar2rrd, но в чем это вам поможет - я не понимаю. Обратитесь к своим DBA - может у них другие инструменты. И да для БД наилучшее решение - это raid10, все другое можно конечно использовать, но не нужно. По поводу ZFS быстрая/не быстрая - это все зависит от задач. Да - вжик тут не работает, но есть старая задача: Кто быстрее перевезет 10 тонн сидюков из, скажем, Питера в Москву - феррари/порш и т п или камаз? Я думаю ответ очевиден. Так вот - ZFS это своего рода камаз.

Станислав

Станислав

Всем привет!

Есть KVM хост машина.

Создан mirror pool на 2х nvme (zfs 2.1.2).

Задача расположить vm bitrix (cent os 7), в которой есть:

1) Веб часть в папке www

2) Раздел root

3) База данных MySQL InnoDB

Папку www нужно регулярно снепшотить (перед обновлением веб приложения Битрикс)

Раздел root, по идее, только при обновлении пакетов.

Как лучше это всё пробросить в ВМ?

Владимир

Владимир

Станислав

Станислав

Так сделай на lxc

Посещали такие мысли, но опыта с lxc ноль, потому не представляю, как Битрикс туда засунуть

Станислав

Станислав

дамми сеть и нфс в вм-ку

Папку www так и хочу, через NFS, а вот файлы БД таким образом пробрасывать вызывает сомнения в надёжности решения

Andrii

Andrii

главное чтобьі на бридже не бьіло реальньіх интерфейсов, иначе скорость бриджа будет равна самому медленному интерфейсу

Владимир

Владимир

Посещали такие мысли, но опыта с lxc ноль, потому не представляю, как Битрикс туда засунуть

вполне удачно получается

Владимир

Владимир

Посещали такие мысли, но опыта с lxc ноль, потому не представляю, как Битрикс туда засунуть

у тебя не проксмокс случаем?

Владимир

Владимир

Станислав

Станислав

Владимир

Владимир

Станислав

Станислав

Целиком

Спасибо за совет.

У Вас датасеты БД, сайта, рута отдельные?

Можете показать zfs get all для всех?

Владимир

Владимир

Спасибо за совет.

У Вас датасеты БД, сайта, рута отдельные?

Можете показать zfs get all для всех?

Чаще один, но иногда базу отделяют чтобы лучше затюнить

Fedor

Fedor

привет

не подскажете корректно ли создавать пул из 2х vdev по 5 дисков, но разных размеров

потеряю ли я в производительности, может ещё на чём то скажется?

Станислав

Станислав

привет

не подскажете корректно ли создавать пул из 2х vdev по 5 дисков, но разных размеров

потеряю ли я в производительности, может ещё на чём то скажется?

На сколько я помню, ZFS будет распределять данные с учётом объёма vdev. Т.е. будет чаще писать туда, где диски по 6Тб. Но! Также должен анализировать занятость того или иного vdev и писать на менее загруженный.

Так что ответ - нет, потери производительности не должно быть

Fedor

Fedor

в данном примере может вылететь только по одному диску в каждом vdev

имеет смысл рассматривать в качестве компромиса в плане отказоусточивости и несильной потери прозводительности

вариант с пулом из 2х vdev raidz2? правда тут дисков лучше 6+6

George

George

привет

не подскажете корректно ли создавать пул из 2х vdev по 5 дисков, но разных размеров

потеряю ли я в производительности, может ещё на чём то скажется?

2 raidz? работать будет, вдев с бОльшим размером будет получать итого больше запросов (т.к. на нём больше блоков)

Fedor

Fedor

2 raidz? работать будет, вдев с бОльшим размером будет получать итого больше запросов (т.к. на нём больше блоков)

те он всё же делает приоритет не на загрузку, а на количество блоков?

Fedor

Fedor

по поводу 2х vdev raidz2 ориентировался помимо прочего и на результаты с тестов

сам по себе raidz2 получился медленней конечно

George

George

те он всё же делает приоритет не на загрузку, а на количество блоков?

на процент занятого места. Если его не соблюдать, то один vdev просто переполнится и будет полный дисбаланс

Vladimir

Vladimir

Kоллеги купили девайс: "QNAP QuTS 16-bay NAS (TVS-h1688X) , ZFS file system, inline deduplication, compression " и воткнули туда дисков: 12xQNAP 16Tb + 4xQnap IronWold SSD 960Gb.

Теперь просят его им удалённо настроить как файл сервер для NFS

Вопрос - что это такое , и не стоит-ли им посоветовать deduplication сразу отключить?

Олег

Олег

Kоллеги купили девайс: "QNAP QuTS 16-bay NAS (TVS-h1688X) , ZFS file system, inline deduplication, compression " и воткнули туда дисков: 12xQNAP 16Tb + 4xQnap IronWold SSD 960Gb.

Теперь просят его им удалённо настроить как файл сервер для NFS

Вопрос - что это такое , и не стоит-ли им посоветовать deduplication сразу отключить?

знать ZFS и не знать NFS))) deduplication тут вообще не причем

Ilya

Ilya

Vladimir

Vladimir

знать ZFS и не знать NFS))) deduplication тут вообще не причем

Они вообще мало чего знают, им это какой-то местный умелец конфигурировал.

Владимир

Владимир

echo 3 > /proc/sys/vm/drop_caches

только перед этой командой наверное на всякий надо синх сделать

Олег

Олег

только перед этой командой наверное на всякий надо синх сделать

sync на сколько помню просто тщательнее очистит

Олег

Олег

он совсем не чистит

https://www.kernel.org/doc/Documentation/sysctl/vm.txt

This is a non-destructive operation and will not free any dirty objects.

To increase the number of objects freed by this operation, the user may run

`sync' prior to writing to /proc/sys/vm/drop_caches. This will minimize the

number of dirty objects on the system and create more candidates to be

dropped.

Egor

Egor

вообще ни разу проблем не встречал что zfs всё заняла и какому-то приложению из-за этого не хватило

ivdok

ivdok

так zfs сама умеет освобождать память

Да, но KVM не умеет реклеймить память, занятую ARC'ом. Поэтому на PVE я понижал MAX_ARC_CACHE до 2-4гб вместо 50%

George

George

Да, но KVM не умеет реклеймить память, занятую ARC'ом. Поэтому на PVE я понижал MAX_ARC_CACHE до 2-4гб вместо 50%

Qemu просто хочет всю память и сразу, даже с pagecache он может не с первого раза её получить

ivdok

ivdok

Den

Den

Владимир

Владимир

вообще ни разу проблем не встречал что zfs всё заняла и какому-то приложению из-за этого не хватило

В дефолтный настройках только в путь. Сплошь и рядом такое

Vladislav

Vladislav

У вас zfs внутри qemu? Или qemu который по соседству с zfs не может забрать свободную память, которая появилась после освобождения?

Владимир

Владимир

Да, но KVM не умеет реклеймить память, занятую ARC'ом. Поэтому на PVE я понижал MAX_ARC_CACHE до 2-4гб вместо 50%

Не лучше указывать ему сколько свободной надо держать?

Egor

Egor

В дефолтный настройках только в путь. Сплошь и рядом такое

я на FreeBSD сижу, то что в линухах такое сплошь и рядом, так это не удивительно )

Владимир

Владимир

я на FreeBSD сижу, то что в линухах такое сплошь и рядом, так это не удивительно )

Думаю что у тебя просто ОЗУ много, там где приложухи не создают скачки и у меня норм