Evgenii

Evgenii

нет, у них ниже есть описание асинхронных реплик, которые не так чувствительны к каналу.

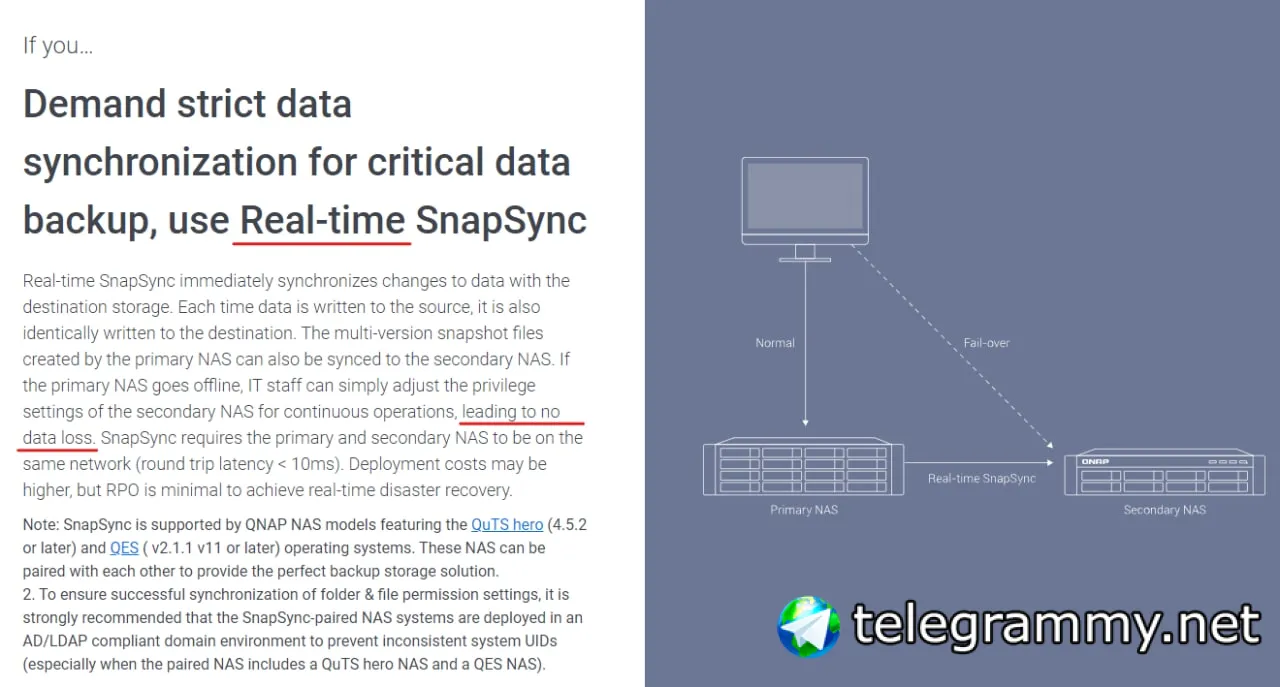

То что я прислал именно то, что написано. Данные сохраняются СИНХРОННО в обе полки

LordMerlin

LordMerlin

нет, у них ниже есть описание асинхронных реплик, которые не так чувствительны к каналу.

То что я прислал именно то, что написано. Данные сохраняются СИНХРОННО в обе полки

Вот и нет. Не синхронно. Данные пишутся в первую, и зеркалятся с неё на вторую.

Vladislav

Vladislav

нет, у них ниже есть описание асинхронных реплик, которые не так чувствительны к каналу.

То что я прислал именно то, что написано. Данные сохраняются СИНХРОННО в обе полки

тема split-brain не раскрыта.

нужно читать технические инструкции

Evgenii

Evgenii

Вот и нет. Не синхронно. Данные пишутся в первую, и зеркалятся с неё на вторую.

тогда у них будет либо latency = 1 секунда в полке за миллион, либо асинхронные реплики с потерей данных, а не реалтайм

Написано же NO DATA LOSS во время фэйл овера

George

George

https://docs.qnap.com/esnas-outdated/2.1.0/en/GUID-CCD02B33-0927-4C18-9D97-1C41415A0370.html

Тут оно не как синхронный процесс без потерь описано) в опенсорсных zfs синхронной реплики с share-nothing подходом штатной нет

Evgenii

Evgenii

https://docs.qnap.com/esnas-outdated/2.1.0/en/GUID-CCD02B33-0927-4C18-9D97-1C41415A0370.html

Тут оно не как синхронный процесс без потерь описано) в опенсорсных zfs синхронной реплики с share-nothing подходом штатной нет

Офигеть.. то есть на сайте реклама нагло врет.. выходит

Art

Art

Офигеть.. то есть на сайте реклама нагло врет.. выходит

Ну фишку крутую ты нашёл, пусть даже это не настоящий прям реал-тайм, а с с каким-то лагом. Для файлохранилки отлично.

Было б интересно поиграться. Опенсорсный Саноид такое не умеет, по моему.

Vladislav

Vladislav

Vladislav

Vladislav

Офигеть.. то есть на сайте реклама нагло врет.. выходит

Никогда такого не было и вот опять

Ivan

Ivan

Art

Art

че там tldr ?

Там в общем самосборный сервер, Центось и зфс.

Скрубы были полностью выключены, и последний был в 2017 )) И никакого мониторинга от слова совсем, даже уведомлений от смарта

Art

Art

че там tldr ?

И когда они начали траблшутить, то выполняли не replace, а просто проблемные диски вытаскивали

Ivan

Ivan

https://www.45drives.com/products/storinator-xl60-configurations.php

интересные полки. не знал про них.

Ivan

Ivan

мне кажется что нельзя столько данных хранить без распределения с репликой 3. и ещё бы это всё бэкапить куда-то на случай админской ошибки.

Art

Art

мне кажется что нельзя столько данных хранить без распределения с репликой 3. и ещё бы это всё бэкапить куда-то на случай админской ошибки.

у них поверлосс случился, возможно ибп накрылся, с этим неясно

Art

Art

мне кажется что нельзя столько данных хранить без распределения с репликой 3. и ещё бы это всё бэкапить куда-то на случай админской ошибки.

А, к них ещё пул собран был из vdev Raidz-2 по 15 дисков

Ivan

Ivan

только время ребилда на порядок выше чем у рэйд 10

я думал что в любом случае скорость не будет выше, чем скорость записи на один диск.

Evgenii

Evgenii

я думал что в любом случае скорость не будет выше, чем скорость записи на один диск.

не, у raid-z как раз скорость зависит от количества дисков по моему

Ivan

Ivan

не, у raid-z как раз скорость зависит от количества дисков по моему

у меня еще до d-raid скорость ребилда raidz2 упиралась в скорость записи одного диска.

George

George

Линус похерил почти петабайт своих данных в ZFS, шок-контент:

https://youtu.be/Npu7jkJk5nM

да, он явно говорит что они ССЗБ по своей же вине

George

George

но ребята уже возбудились некоторые, хотят куда-то в доку написать ещё разок как не надо делать)

Ivan

Ivan

да, он явно говорит что они ССЗБ по своей же вине

в любом случае юзать 18 теровые диски очень страшно

Василий

Василий

10 и скраб раз в месяц (правда он небось больше суток будет идти)

В дефолтной настройке, скраб и пару дней идти может. Особенно если нагрузка есть

George

George

Так и не понял чем он лучше чем рецдз +1

в draid внутри можно заранее размазать по дискам spare, в случае вылета диска избыточность можно быстро восстановить на этот виртуальный spare (со скоростью количества дисков, на которые он размазан, например 10), и уже потом в спокойном режиме не важно сколько 1 диск ресильверить новый

George

George

это основное отличие, т.е. грубо говоря в 10 (например) раз быстрее восстановление избыточности

George

George

в draid внутри можно заранее размазать по дискам spare, в случае вылета диска избыточность можно быстро восстановить на этот виртуальный spare (со скоростью количества дисков, на которые он размазан, например 10), и уже потом в спокойном режиме не важно сколько 1 диск ресильверить новый

ну и за этот счёт spare диск не простаивает, а используется и увеличивает производительность

Василий

Василий

в draid внутри можно заранее размазать по дискам spare, в случае вылета диска избыточность можно быстро восстановить на этот виртуальный spare (со скоростью количества дисков, на которые он размазан, например 10), и уже потом в спокойном режиме не важно сколько 1 диск ресильверить новый

Так я потому и написал +1

Грубо говоря допустим у тебя 5ка с размазыванием и 6 без. Дисков одинаковое количество, ёмкость одинаковая. В случае, диск умер, 6 уже на уровне надёжности 5, а рейд д ещё надо быстро восстановить

Василий

Василий

у меня еще до d-raid скорость ребилда raidz2 упиралась в скорость записи одного диска.

Там немного не так. Максимальная скорость восстановления таки да, равна диску. Но нагрузка на массив сильно больше у рейдЗ

Если других операций нет, то получаешь макс скорость. Если есть - тормоза и не макс скорость

Art

Art

в любом случае юзать 18 теровые диски очень страшно

А куды деваться, когда нужны объёмы. Хоть ССД вон есть и по 30ТБ, но цены...

Василий

Василий

я что-то пропустил, и пацанам с цефом ССД дешевле отпускают?)

Они после майнеров скупают)

Зы. Я думал это в продолжение беседы, что делать если надо много.

Кстати, если надо быстро это очень редко зфс

Art

Art

Они после майнеров скупают)

Зы. Я думал это в продолжение беседы, что делать если надо много.

Кстати, если надо быстро это очень редко зфс

Как тебе цеф сделает много?)

Расклад нынче один для всех: хочешь много и быстро - флэш, а если надо много и дешёво - хдд

Василий

Василий

Как тебе цеф сделает много?)

Расклад нынче один для всех: хочешь много и быстро - флэш, а если надо много и дешёво - хдд

цеф чутко размазанее получается. хотелось бы верить что надежнее)

George

George

кстати, в следующем мажорном релизе openzfs дефолтный volblocksize поменяется на 16K, к вопросу об оптимальных дефолтах https://github.com/openzfs/zfs/commit/72f0521abadd77ef06fb1d10c4f4f80af50ec279

George

George

Ох. Один из авторов коммита из Lawrence Livermore National Laboratory

ревьюверов, Brian Behlendorf это автор порта ZoL оригинального и основной мейнтейнер сейчас. Они в LLNL zfs притащили на linux для Lustre взамен патченного ext4

George

George

а сама Lustre стабильна поверх ZFS ?

или нужно патчи накладывать? :)

да, более того на поверх zfs для люстры не нужно патчить ядро)

George

George

а поверх ldiskfs (прокачанный ext3, из которого потом появился ext4) патчить ядро нужно (2 года назад по крайней мере)

George

George

а Proxmox умеют Lustre использовать?

у Lustre немного другой профиль всё же, её любят для числодробилок

Vladislav

Vladislav

мне нужно общее хранилище для proxmox с более-менее работоспособностью и без потери данных на всем кластере

George

George

> и без потери данных на всем кластере

что это значит

в общем lustre пока что лучше ложится на архитектуру с железом где есть общая файловая полка на 2 сервера, 2 года назад автоматическое дублирование данных в кластере они только пилили

George

George

и где выход 1 узла это норма и можно подождать когда он вернётся чтобы за его данными сходить (привет, научные вычисления)

central

central

Egor

Egor