мне нужно общее хранилище для proxmox с более-менее работоспособностью и без потери данных на всем кластере

ceph же

max

max

народ, хелп

как удалить pool без его импорта ?

суть пробелмы :

zpool import -f

pool: Raid1

id: 9215054098601767770

state: UNAVAIL

status: One or more devices are missing from the system.

action: The pool cannot be imported. Attach the missing

devices and try again.

see: https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-3C

config:

Raid1 UNAVAIL insufficient replicas

da0 UNAVAIL cannot open

George

George

народ, хелп

как удалить pool без его импорта ?

суть пробелмы :

zpool import -f

pool: Raid1

id: 9215054098601767770

state: UNAVAIL

status: One or more devices are missing from the system.

action: The pool cannot be imported. Attach the missing

devices and try again.

see: https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-3C

config:

Raid1 UNAVAIL insufficient replicas

da0 UNAVAIL cannot open

затереть его поверх к примеру, либо создав новый пул либо wipefs

Nikita

Nikita

Ivan

Ivan

Nikita

Nikita

slog хорошо бы дублировать

Бесспорно, но в данной инсталляции нет такой возможности к сожалению.

Ярослав

Ярослав

Nikita

Nikita

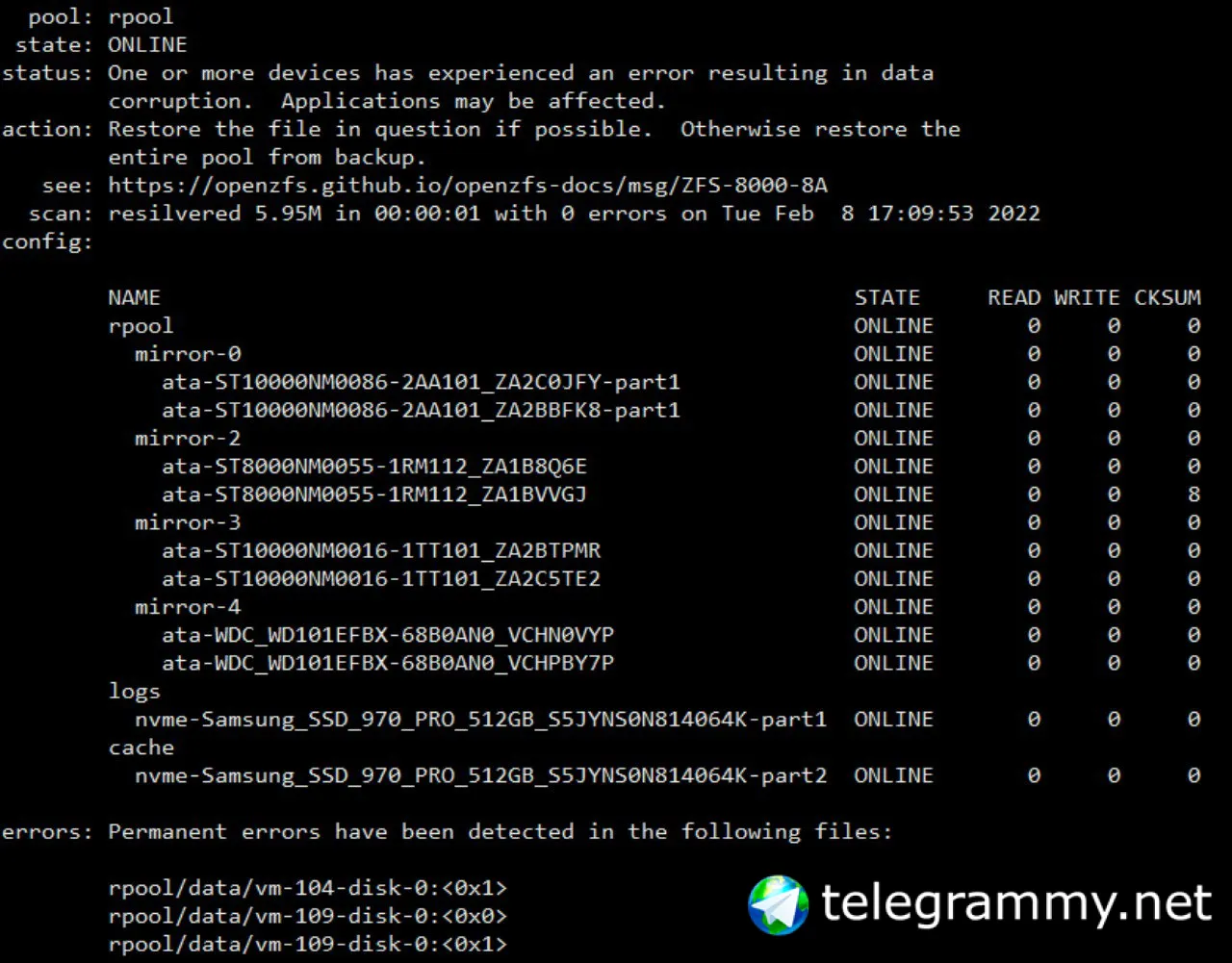

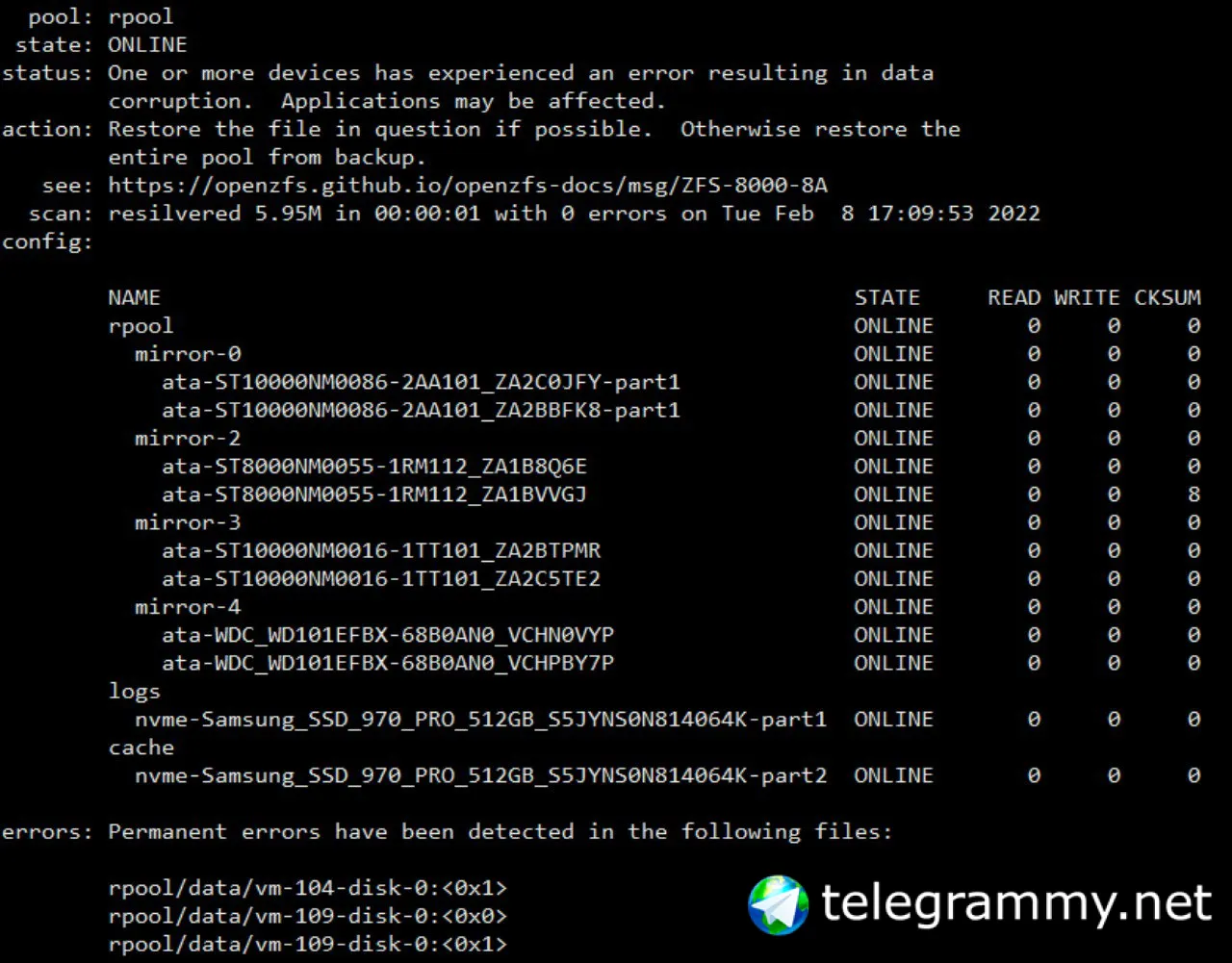

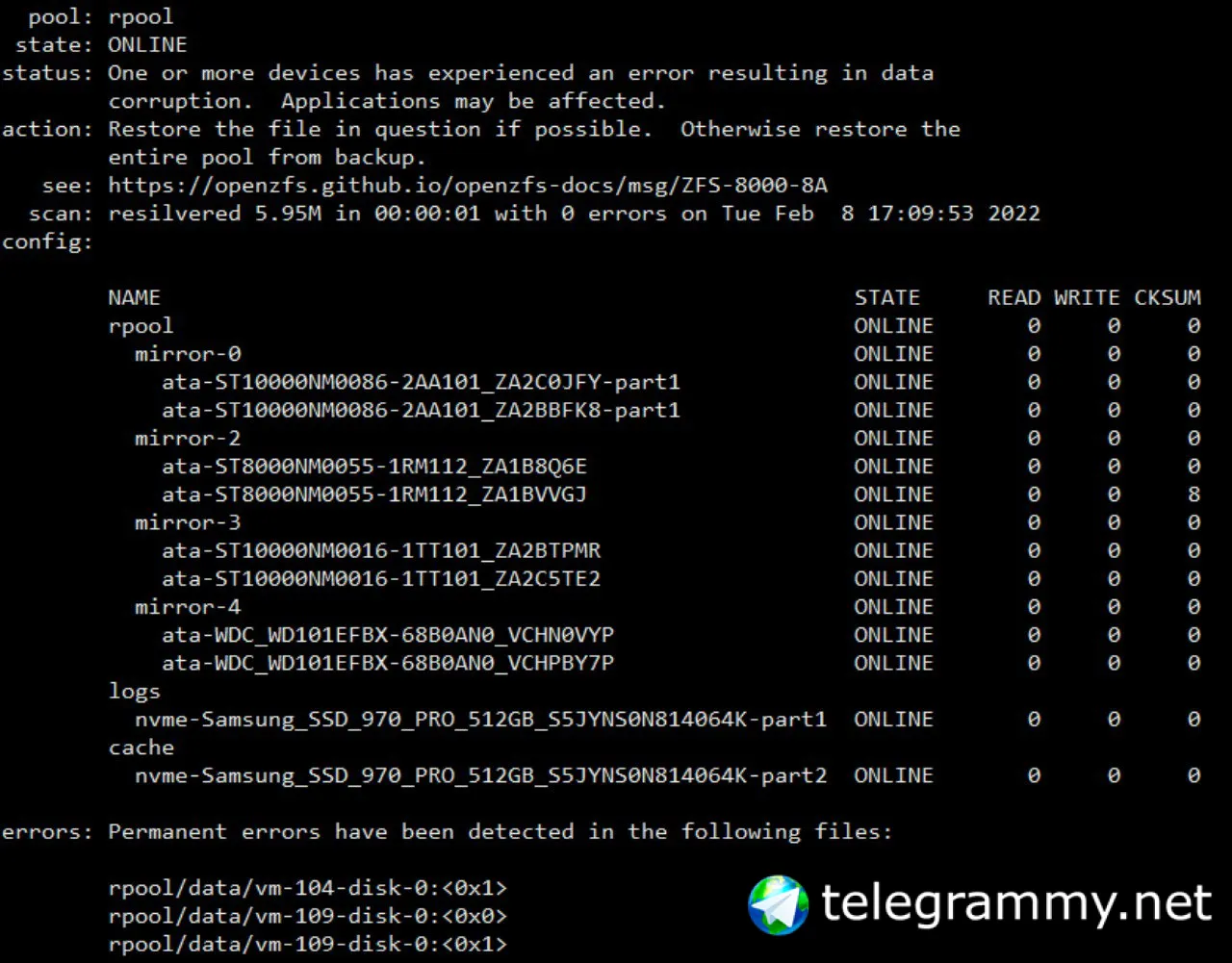

Зеркало тут ни при чем. Проблема в конкретных зволах под виртуалки. Вот какая, надо разбираться

Т.е. ненулевой CKSUM на одном из дисков не имеет отношения к ошибкам zvol-а?

Ivan

Ivan

Т.е. ненулевой CKSUM на одном из дисков не имеет отношения к ошибкам zvol-а?

если на момент возникновения ошибки не было избыточности, то да

Art

Art

Nikita

Nikita

если на момент возникновения ошибки не было избыточности, то да

Избыточность была

По поводу ecc - это разве так бы проявилось? В виде чексуммы на одном из дисков пула?

Память не ECC.

Ярослав

Ярослав

Довольно часто хостинги ставят старые диски в серверы. Желательно всегда их проверять перед началом настройки всей системы

Vladislav

Vladislav

Довольно часто хостинги ставят старые диски в серверы. Желательно всегда их проверять перед началом настройки всей системы

если есть время.

кстати, в линуксе есть какой-то аналог mhdd или victoria ?

Ivan

Ivan

если есть время.

кстати, в линуксе есть какой-то аналог mhdd или victoria ?

отдаленный аналог mhdd - whdd

Nikita

Nikita

Довольно часто хостинги ставят старые диски в серверы. Желательно всегда их проверять перед началом настройки всей системы

Со смартами всё ок, это было проверено первым делом.

Ярослав

Ярослав

В любом случае, если такая ошибка, значит данные были повреждены на двух дисках в массиве, возможно одновременно

Ярослав

Ярослав

Почему так случилось, та причин может быть тысяча, надо изучать все логи, смотреть что не так с дисками и тд, тут никто ответ прямой не даст

Ivan

Ivan

Nikita

Nikita

Уже запустил, ровно с такой целью.

Но там 13 часов на всё потребуется.

Кто-либо посторонний очистить ошибки на дисках не мог, доступ имеется только у меня.

По поводу бэкапа - это конечно всё правильно, но подобное хранилище строилось на замену майкрософтовскому storage spaces с ReFS, который втихую так же убил почти все данные. Об этом было замечено лишь спустя немалый срок, когда участились проблемы ошибок чтения файлов большого размера. Хотя пул был healthy, смарт дисков в порядке и т.п.. Словив такую проблему - приобрели новое железо и развернули на сей раз ZFS-хранилище.

И ловим в итоге те же яйца, только в профиль.

Странно это немного.

Nikita

Nikita

Всё, кроме дисков.

Диски были проверены викторией и растасованы в других комбинациях по нодам.

Василий

Василий

Версию того что сбойнул HBA или кабель отбрасываете по какой причине? Это как раз дало бы сбой на всех дисках одновременно. И никаких следов в смарте.

Nikita

Nikita

Версию того что сбойнул HBA или кабель отбрасываете по какой причине? Это как раз дало бы сбой на всех дисках одновременно. И никаких следов в смарте.

Версию про кабель я не отбрасываю.

Меня смущает именно комбинация ситуации с ненулевой чексуммой на только одном диске в зеркале и результат этого - битые файлы на этом пуле. При том ,что все vdev, составляющие данный пул в статусе онлайн.

Δαρθ

Δαρθ

Версию того что сбойнул HBA или кабель отбрасываете по какой причине? Это как раз дало бы сбой на всех дисках одновременно. И никаких следов в смарте.

прежде чем кабель допустит запись кривых данных, на него 100500 раз выругаются по несличению црц какбэ

Александр

Александр

zfs list -H -o name -t snapshot -r your_dataset | grep your_cool_grep_expr | xargs -n 1 zfs destroy

Ilya

Ilya

так они там однотипного имени же, zfs destroy -rvn rpool@snapname, убедиться, что попадают какие надо, и потом без -n

DOK ꧁꧂

DOK ꧁꧂

zfs list -H -o name -t snapshot -r your_dataset | grep your_cool_grep_expr | xargs -n 1 zfs destroy

Это я знаю. Снапшоты же не связаны между собой и их можно удалять в любом порядке

Александр

Александр

Это я знаю. Снапшоты же не связаны между собой и их можно удалять в любом порядке

тогда я не понял вопроса

Δαρθ

Δαρθ

подниму еще раз вопрос. насколько я знаю aes-ni в сабж впилили, а sha-ni (для sha256) еще нет. ведутся ли работы в эту сторону?

George

George

подниму еще раз вопрос. насколько я знаю aes-ni в сабж впилили, а sha-ni (для sha256) еще нет. ведутся ли работы в эту сторону?

https://github.com/openzfs/zfs/pulls?q=sha-ni

Eugen

Eugen

Вопрос не в тему, но кто пользовался scst, как вывести список таргетов и какими инициаторами зацеплены?

Vladislav

Vladislav

Вопрос не в тему, но кто пользовался scst, как вывести список таргетов и какими инициаторами зацеплены?

http://rpm.pbone.net/manpage_idpl_35995495_numer_1_nazwa_scstadmin.html

nikolay

nikolay

LordMerlin

LordMerlin