подскажите как изменить ashift у готового пула

никак

f1gar0

f1gar0

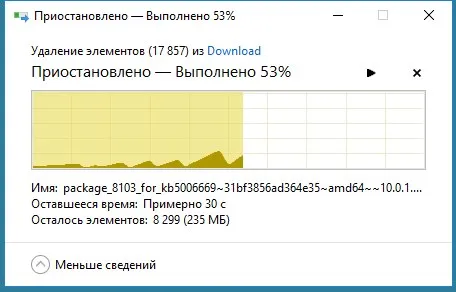

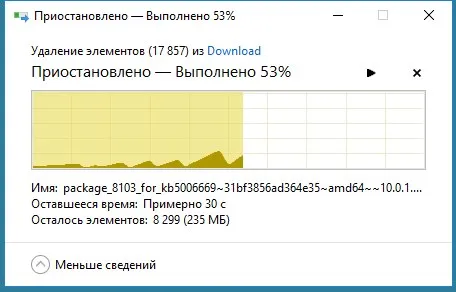

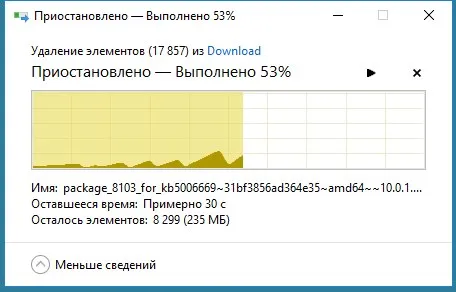

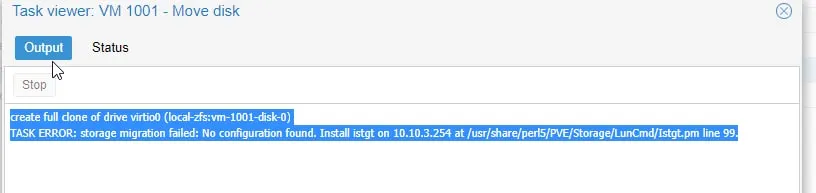

есть сервер на 120+ Tb могу iscsi зацепиться к proxmox сделать movedisk всех вм убить rpool и собрать заново

George

George

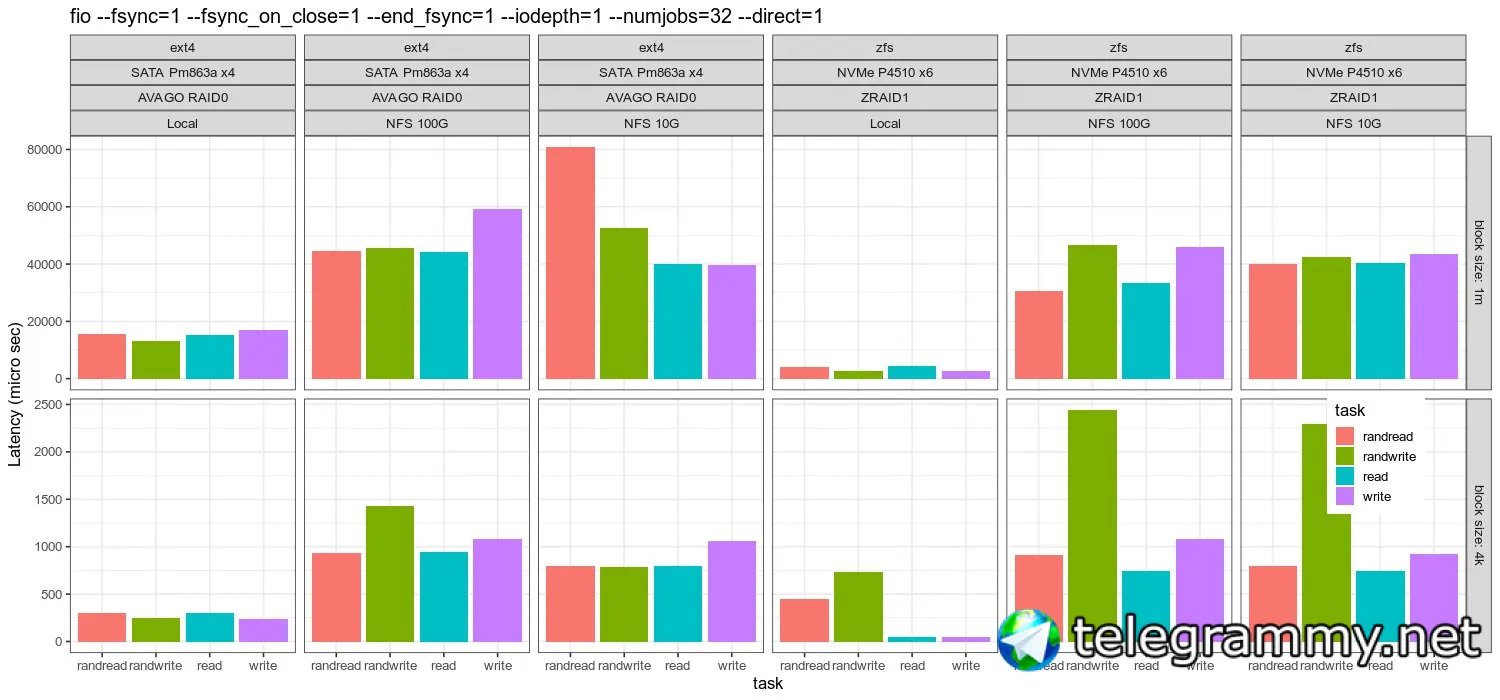

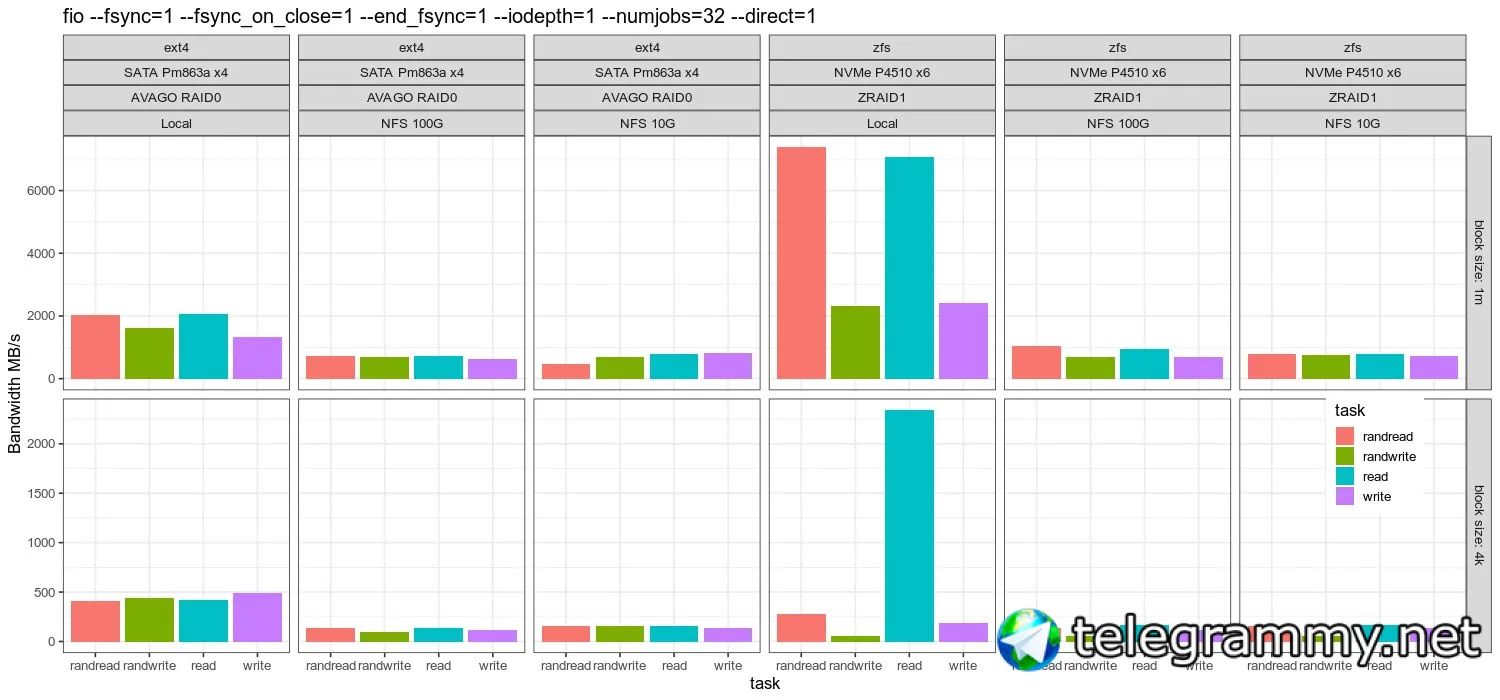

скриптик для fio:

for j in randread randwrite read write;do

for bs in 4k 1m;do

fio \

--name ${name}_${j}_${bs} \

--directory $loc \

--eta-newline=5s --rw=${j} --size=5g --io_size=10g --blocksize=${bs} --ioengine=libaio \

--fsync=1 --iodepth=1 --direct=1 --numjobs=32 \

--runtime=${t} --group_reporting --stonewall \

--fallocate=native \

--output=${name}_${j}_${bs}.json \

--output-format=json+

done

done

Если что - на нвме скорость аллокации не существовавшего до этого блока обычно выше чем уже существующего, тесты без первого предзаполнения будут подвирать на запись

Fedor

Fedor

George

George

особенно забавно на дешёвых nvme видеть 3ГБ\с поточной записи в первый раз пока ftl пуст, а сразу после этого - реальные 900МБ\с, даже весь объём заполнять не нужно. Ну и стоит учитывать есть ли у диска кеш на быстром slc и его объём

Олег

Олег

George

George

а как полечить что образ VM весит 1тер а жрет 1.85 в zfs

Raidz? На нем это нормально, либо пересбор пула с другим ashift, либо пересоздать zvol с бОльшим volblocksize, либо использовать mirrors вместо raidz. У каждого пути свои нюансы

f1gar0

f1gar0

bishop

bishop

я вот что подумал,можна зделать кэш на рам диске или безсмысленно?

И следущие помимо кэша и логов есть еще доп диски для пула(truenas) что это за диски?

central

central

я вот что подумал,можна зделать кэш на рам диске или безсмысленно?

И следущие помимо кэша и логов есть еще доп диски для пула(truenas) что это за диски?

а на кой, если zfs и так в ram хранит arc

Fedor

Fedor

Ilya

Ilya

я вот что подумал,можна зделать кэш на рам диске или безсмысленно?

И следущие помимо кэша и логов есть еще доп диски для пула(truenas) что это за диски?

В Трунасе рамдиск штатно не сделаешь. А все кастомизации откатятся при обновлении

bishop

bishop

И какие ещё там у тебя диски? Может, просто, не все в пул добавлены были?

Я немогу найти для чего диски metadata и dedup.

Anatoly

Anatoly

под metadata disk наверное это имеется ввиду https://forum.level1techs.com/t/zfs-metadata-special-device-z/159954

bishop

bishop

Vladimir

Vladimir

https://openzfs.topicbox.com/groups/developer/T950b02acdf392290 - это не имплементировали в той версии ещё ?

Vladimir

Vladimir

https://github.com/openzfs/zfs/discussions/11677 - тут человек жалуется что в версии 0.8 он стал работать и замедлять что-то там

Vladimir

Vladimir

riv

riv

я сравнивал на 10 Gbe на нетапах перформанс внутри гостевых ос на датасторе выданной по iscsi и по nfs - на nfs показатели по iops выше, а latency ниже или сравнимое..

Именно по этому он и оказывается больше! Там явно или косвенно возникает writeback. Большинство "тормозов" связано именно с отсутствием writeback-кэширования.

riv

riv

riv

riv

zfs get sharenfs rpool

Я этим не пользовался, но уверен почему-то, что в linux он производится средствами ядра, которые просто настраиваются утилитами zfs, как и с samba-шарами (тоже не пользовлся ни разу)

George

George

Art

Art

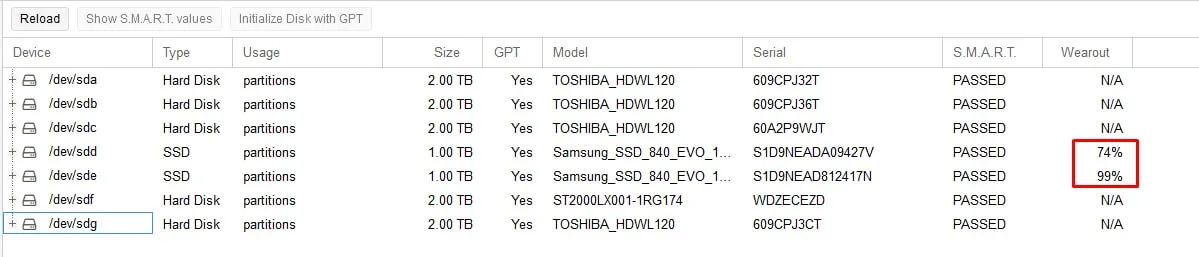

тут два варианта: или добавить еще два зеркала или заменить диски на более емкие

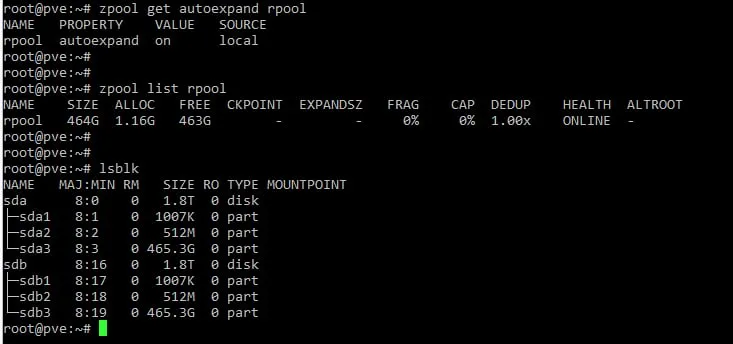

Обрати внимание, у него диски и так по 2ТБ, но зфс отданы разделы по 500 гб

@ivandeg а как так получилось вообще?

Василий

Василий

Обрати внимание, у него диски и так по 2ТБ, но зфс отданы разделы по 500 гб

@ivandeg а как так получилось вообще?

тогда бить зеркало и добавять по очереди. вроде линуховый зфс умеет так

Иван

Иван

Мне на одном из серверов нужно заменить диски на новые и большего объема. Я сделал тестовую лабу, создал пул на двух дисках, затем убрал один, поставил диск большего объёма, скопировал загрузчик, сделал attach нового диска большего объема. Провернул операцию со вторым диском меньшего объема. На этом этапе всё получилось, а вот расширить не могу.

Иван

Иван

Может быть я не тем путём иду и есть другой способ, кроме забэкапить и развернуть на новой инсталляции, на новых дисках.

George

George

Мне на одном из серверов нужно заменить диски на новые и большего объема. Я сделал тестовую лабу, создал пул на двух дисках, затем убрал один, поставил диск большего объёма, скопировал загрузчик, сделал attach нового диска большего объема. Провернул операцию со вторым диском меньшего объема. На этом этапе всё получилось, а вот расширить не могу.

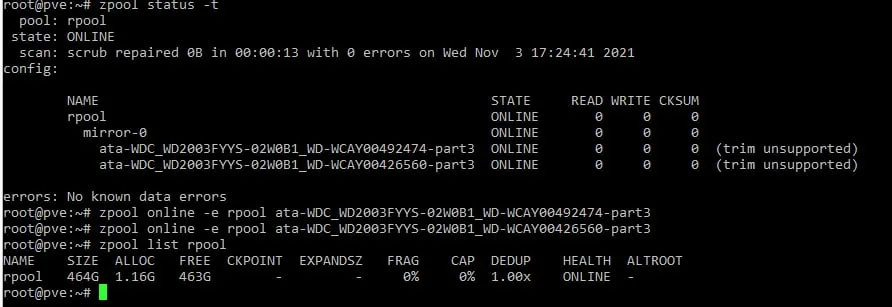

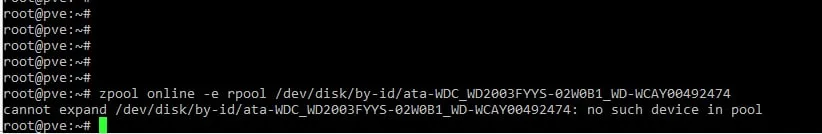

для расширения - убедиться, что раздел увеличен, если да - можно вручную пнуть zpool online -e

Art

Art

Иван

Иван

для расширения - убедиться, что раздел увеличен, если да - можно вручную пнуть zpool online -e

Как убедиться? zpool online -e rpool ata-WDC_WD2003FYYS-02W0B1_WD-WCAY00426560-part3 - правильно пинаю?

George

George

Как убедиться? zpool online -e rpool ata-WDC_WD2003FYYS-02W0B1_WD-WCAY00426560-part3 - правильно пинаю?

доку можно глянуть, на память не помню

Art

Art

Как убедиться? zpool online -e rpool ata-WDC_WD2003FYYS-02W0B1_WD-WCAY00426560-part3 - правильно пинаю?

Вот мне кажется корень проблемы, что ты указываешь конкретную партицию, то есть part3

А надо весь диск в команде указать

Art

Art

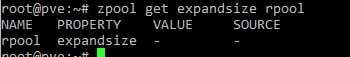

Как убедиться? zpool online -e rpool ata-WDC_WD2003FYYS-02W0B1_WD-WCAY00426560-part3 - правильно пинаю?

Но сначала проверь командой:

zpool get expandsize rpool

local

local

nikolay

nikolay

nikolay

nikolay

nikolay

nikolay

можете также поглядеть в гугле рекомендации по сжатию и dataset recordsize для виртуализации на проксе

local

local

Иван

Иван

local

local

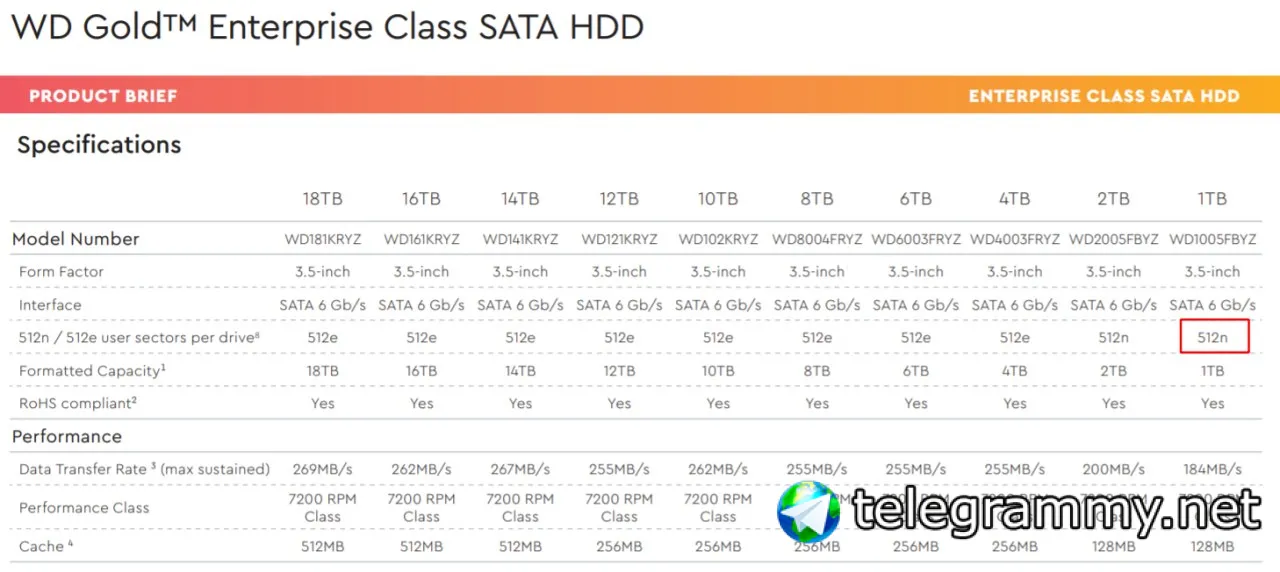

да, у wd gold нормальные вроде. 1 Тб это старые сата?

Ну видимо не совсем новый модельный ряд )

Art

Art

512e или 512n?

512n давно уже в истории же? 4Kn можно найти, в серверном сегменте

Да и в любом случае ашифт 12 нужен, все равно в реале 4к блоками все HDD ворочают

nikolay

nikolay

Nick

Nick

Sergey

Sergey