всё, я понял что я дурак))

не, просто ошибся, у нас же ламповый чат)

nikolay

nikolay

Владимир

Владимир

а разве нативный нфс не только у солярки?

на сколько я знаю нет, но пользоваться им так и не довелось

Pavel

Pavel

нашел "Например, предположим, что настроена VMFS5, что означает размер блока (файла) 1 МБ, сопровождаемого субблоками 8 КБ. Теперь, когда системе необходимо сохранить файл размером 64 КБ, что намного меньше размера блока (файла) по умолчанию, она НЕ БУДЕТ сохранять файл, используя 8 субблоков по 8 КБ, нет, она просто сохранит файл в нормальный блок размером 1 МБ (файл). Только если размер файла на самом деле составляет 8 КБ или меньше, для его хранения будет использоваться субблок"

Тоже пытался найти подбную инфу под kvm, везде все по разному пишут. толком пока не нашел влияние размера блоков vm,fs, zfs на IOPS

George

George

? можно задать размер блока при создании slog или l2arc? или я что то не так понял

размер сектора (ashift)

Andrey

Andrey

Тоже пытался найти подбную инфу под kvm, везде все по разному пишут. толком пока не нашел влияние размера блоков vm,fs, zfs на IOPS

судя по тому, что удалось накопать slog/arc/l2arc сильно лучше помогают, чем все эти пляски с размерами блоков

nikolay

nikolay

судя по тому, что удалось накопать slog/arc/l2arc сильно лучше помогают, чем все эти пляски с размерами блоков

slog поможет если много синхронной записи. l2arc тоже не все будет кэшировать, так что в очередной раз напишу - все зависит от характера вашей нагрузки

Василий

Василий

ты про солярку конкретно?

Ну да. Он же про солярку спрашивал. В линухе да, там два варианта походу

Ilya

Ilya

я сравнивал на 10 Gbe на нетапах перформанс внутри гостевых ос на датасторе выданной по iscsi и по nfs - на nfs показатели по iops выше, а latency ниже или сравнимое..

Возможно это ещё и потому, что в нетаппе ЛУН - это файл, то есть, ещё один уровень абстракции поверх WAFL

bishop

bishop

Здраствуйте однако,планирую собрать nas.

З кэшем и лог дисками для масива,так как вопрос по кэшу я розабрал,но не по логах.

Если не ошибаюсь то это для записи кэш,вопрос втом какие ссд ставить для него?

bishop

bishop

Да, для записи.

Тоже собираюсь.

Та обычный SSD буду ставить.

логи убьют диск быстро,я так понял нужно серверные

Владимир

Владимир

логи убьют диск быстро,я так понял нужно серверные

Мускул с темп директорий на диске и кучей запросов с тем таблицами, огромными сортировка и и тп

bishop

bishop

Мускул с темп директорий на диске и кучей запросов с тем таблицами, огромными сортировка и и тп

я так понял спокойно тянет это всё?

Vladimir

Vladimir

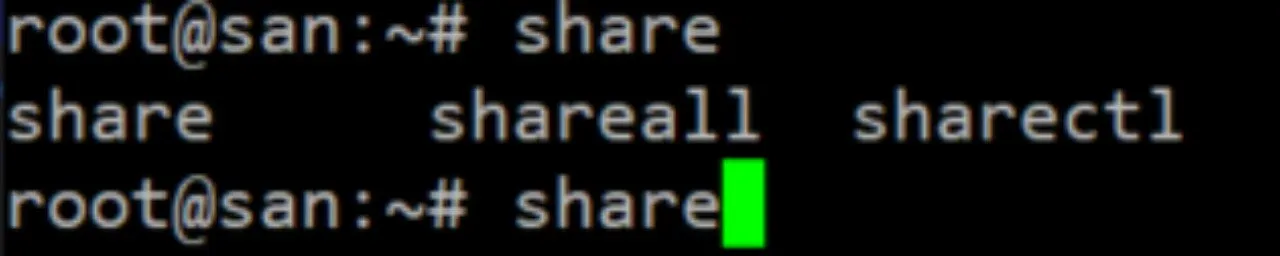

как просто протестировать производительность ZFS ?

Аналог такой комманды:

fio --rw=randread --size=5g --io_size=10g --blocksize=4k --fsync=1 --iodepth=1 --direct=1 --numjobs=32 --group_reporting --stonewall ...

А то оно direct игнорирует и из кэша читает

Alexander

Alexander

как просто протестировать производительность ZFS ?

Аналог такой комманды:

fio --rw=randread --size=5g --io_size=10g --blocksize=4k --fsync=1 --iodepth=1 --direct=1 --numjobs=32 --group_reporting --stonewall ...

А то оно direct игнорирует и из кэша читает

"Производительность ZFS без кэша" бывает со включенным кэшем? :)

Владимир

Владимир

Vladimir

Vladimir

поигрался с /sys/module/zfs/parameters/zfs_arc_max , /sys/module/zfs/parameters/zfs_arc_min

что-то не получилось размер уменьшить, arc_summary всё-равно показыват 64gb

и скорость чтения ~ 2Gb/sec

Владимир

Владимир

Ivan

Ivan

Vladimir

Vladimir

Arahnale

Arahnale

поигрался с /sys/module/zfs/parameters/zfs_arc_max , /sys/module/zfs/parameters/zfs_arc_min

что-то не получилось размер уменьшить, arc_summary всё-равно показыват 64gb

и скорость чтения ~ 2Gb/sec

нельзя уменьшить arc, меньше чем current arc_meta + arc_dnode

Arahnale

Arahnale

Vladimir

Vladimir

Vladimir

Vladimir

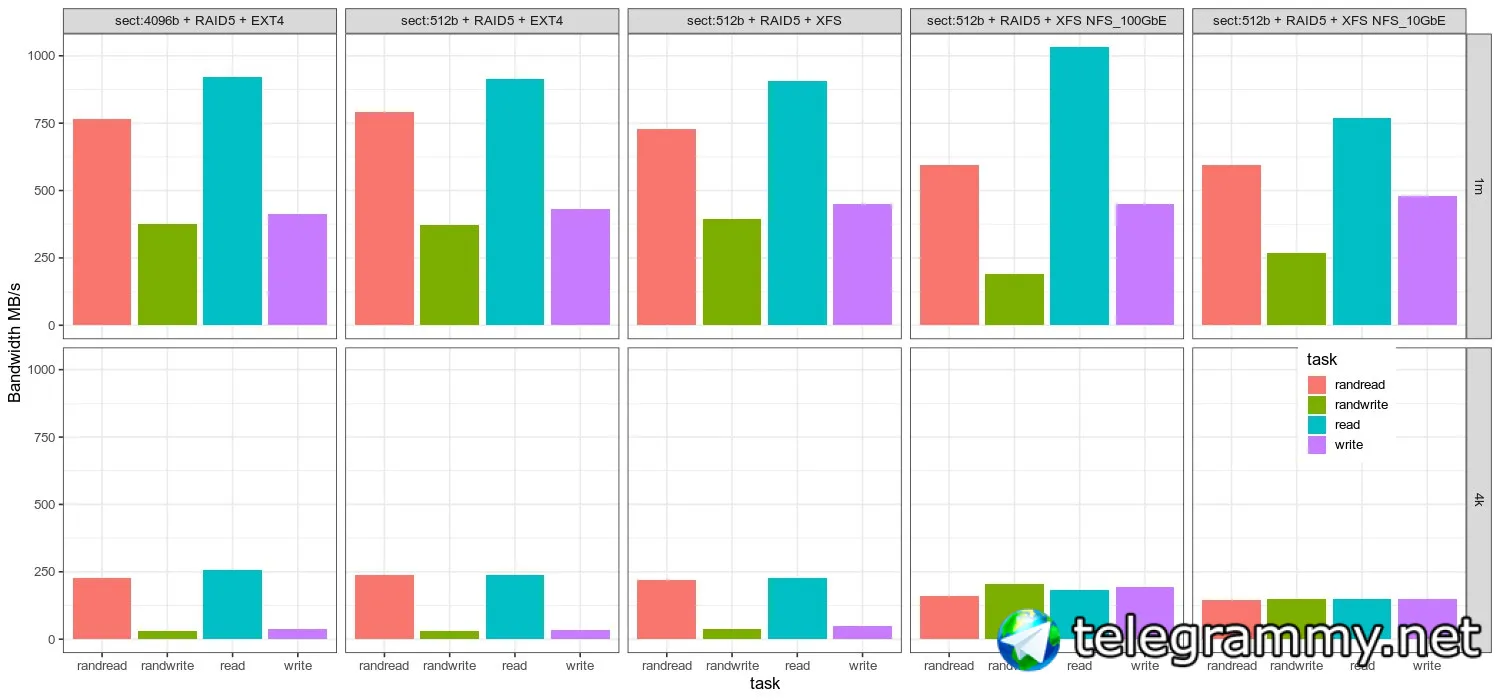

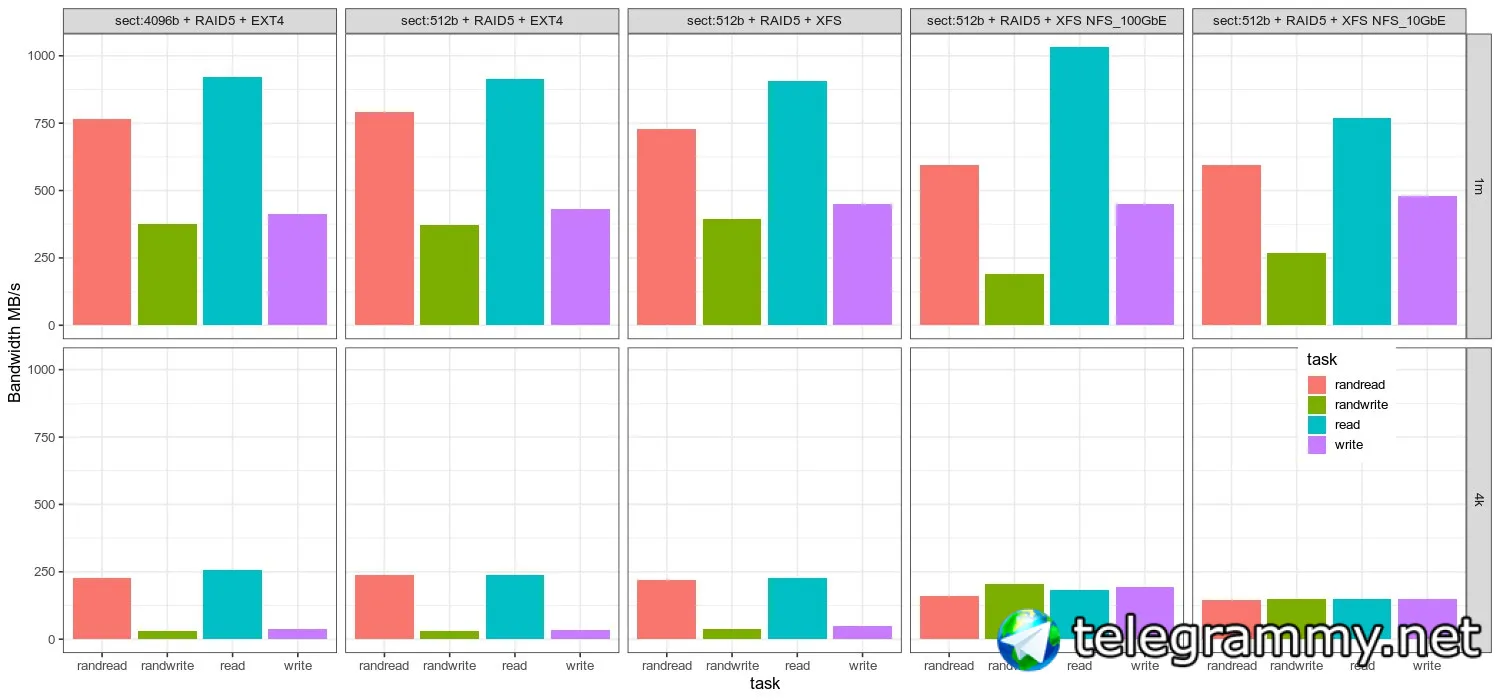

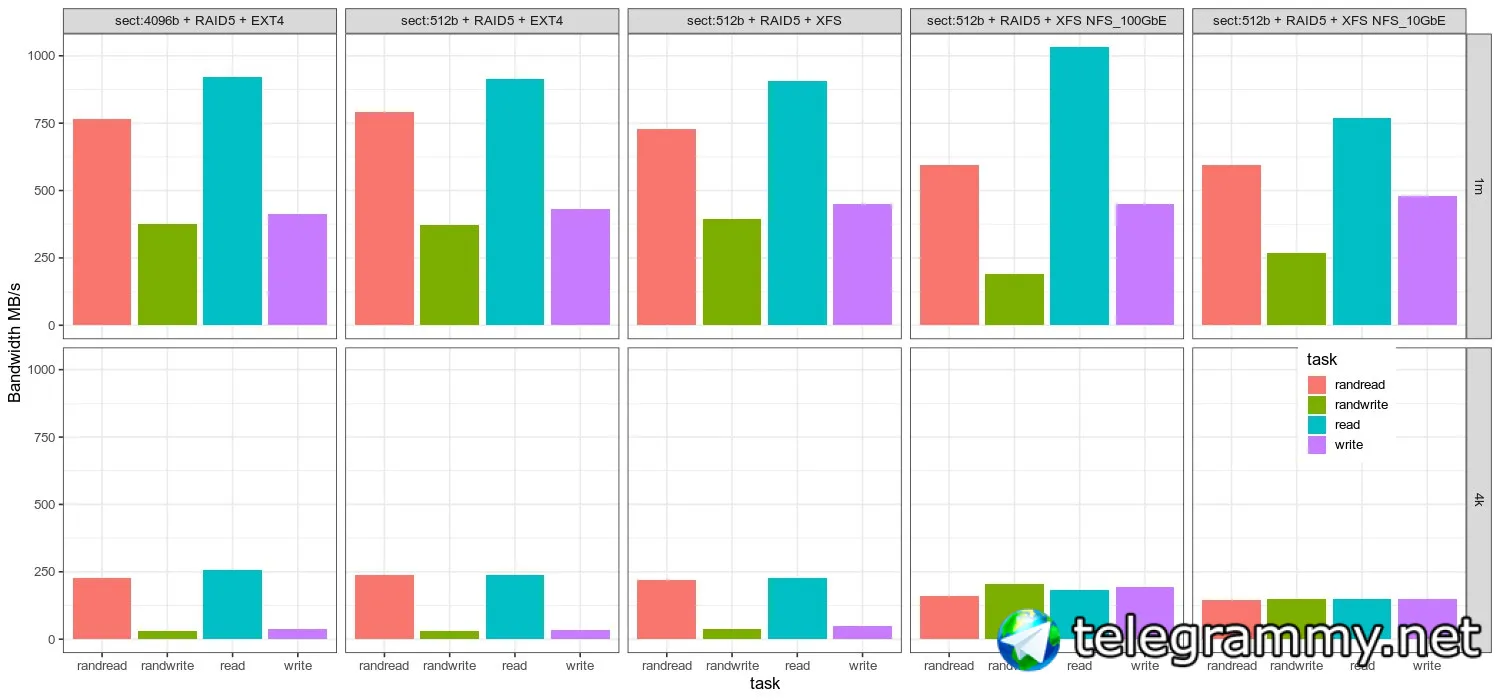

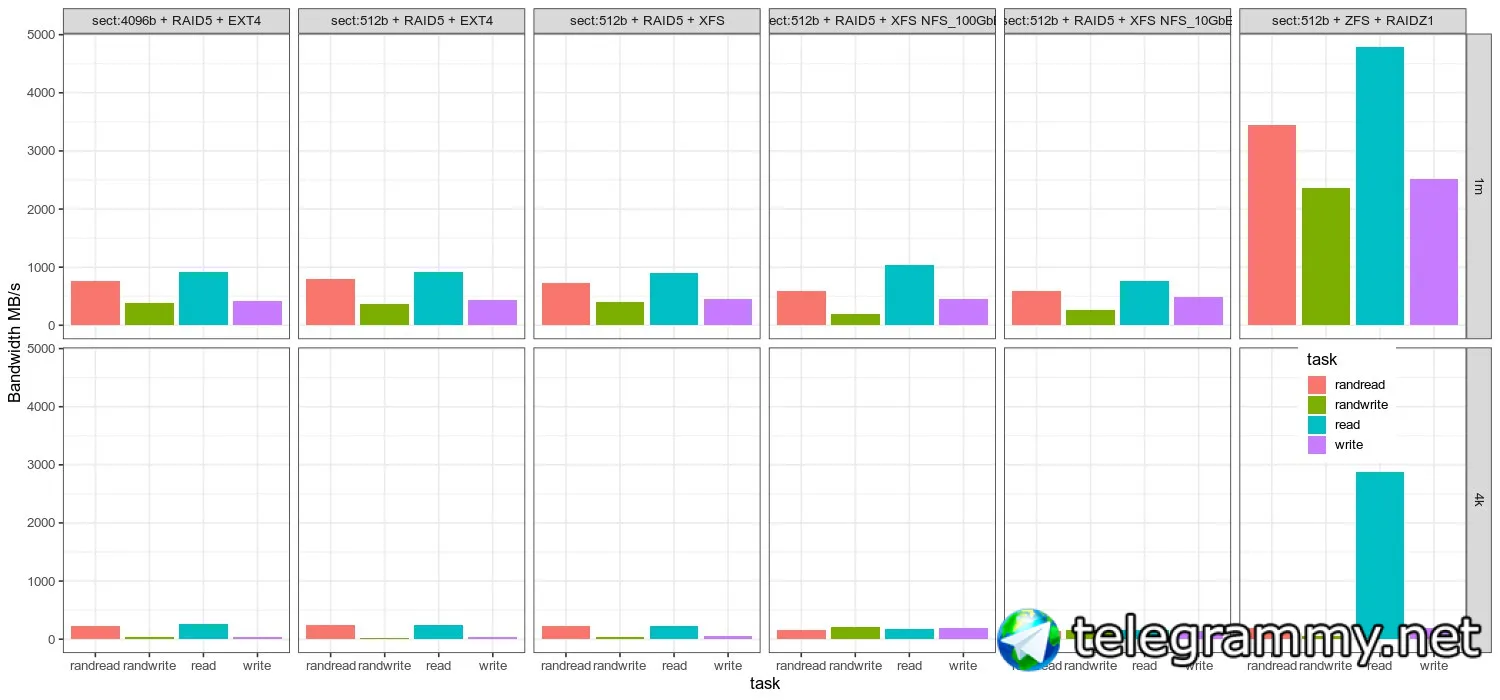

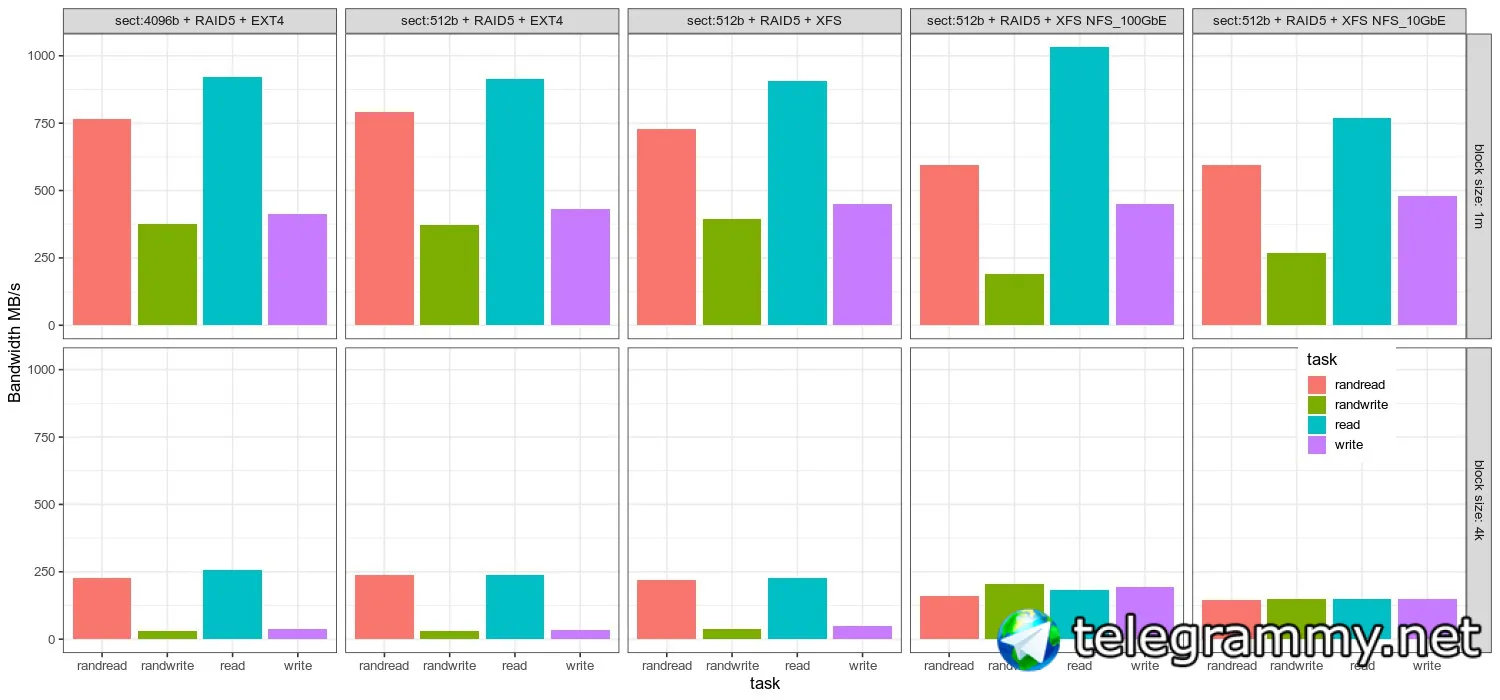

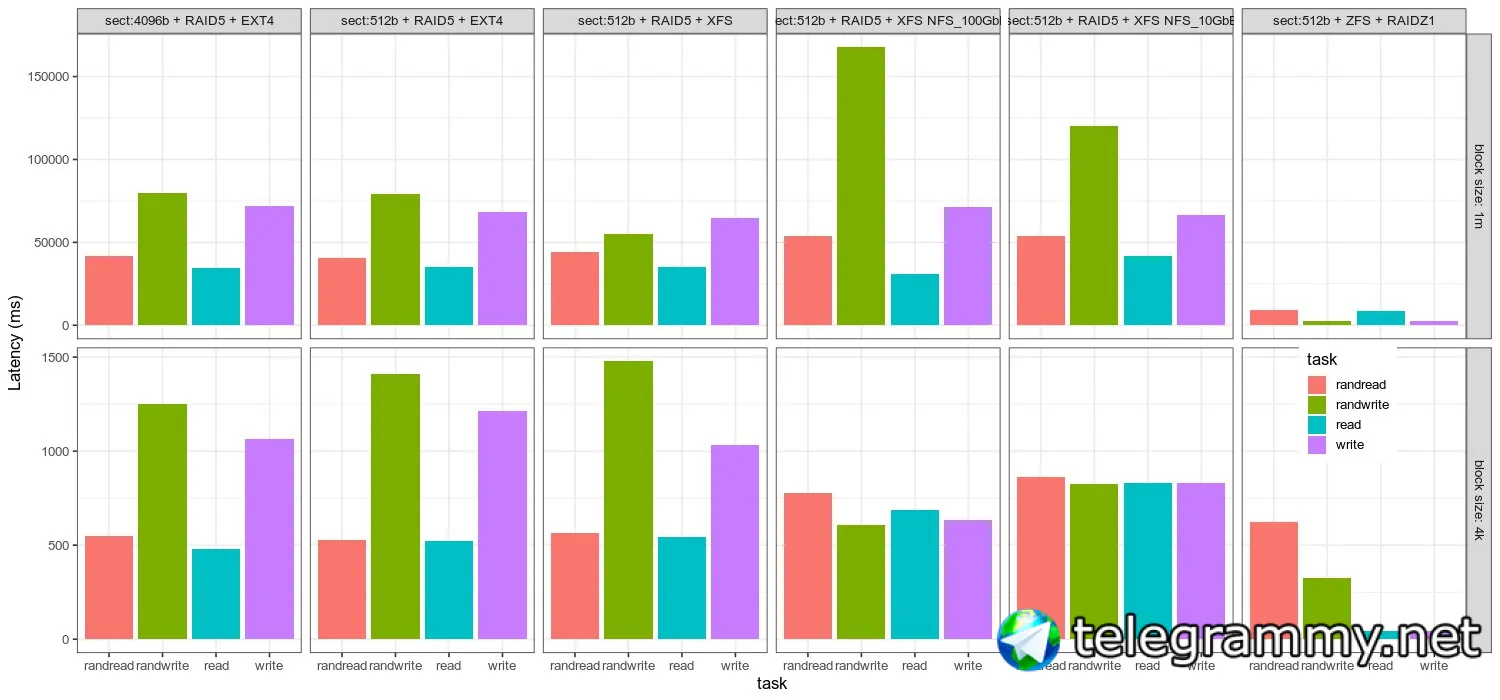

скриптик для fio:

for j in randread randwrite read write;do

for bs in 4k 1m;do

fio \

--name ${name}_${j}_${bs} \

--directory $loc \

--eta-newline=5s --rw=${j} --size=5g --io_size=10g --blocksize=${bs} --ioengine=libaio \

--fsync=1 --iodepth=1 --direct=1 --numjobs=32 \

--runtime=${t} --group_reporting --stonewall \

--fallocate=native \

--output=${name}_${j}_${bs}.json \

--output-format=json+

done

done

Arahnale

Arahnale

что-то мне подсказывает, что есть корреляция между заполненностью диска и его производительностью. NVME показывает высокую производительность на первых 50-100Гб.

Arahnale

Arahnale

скриптик для fio:

for j in randread randwrite read write;do

for bs in 4k 1m;do

fio \

--name ${name}_${j}_${bs} \

--directory $loc \

--eta-newline=5s --rw=${j} --size=5g --io_size=10g --blocksize=${bs} --ioengine=libaio \

--fsync=1 --iodepth=1 --direct=1 --numjobs=32 \

--runtime=${t} --group_reporting --stonewall \

--fallocate=native \

--output=${name}_${j}_${bs}.json \

--output-format=json+

done

done

мм.. то есть верхний график - это 4Кб, а нижний - это 1Мб?

Василий

Василий

Vladimir

Vladimir

заполни полностью и скин скрины тесту

времени нету больше тестировать - надо обратно всё в рабочее состояние приводить

f1gar0

f1gar0