Сергей

Сергей

если atime не важен для приложений, то думаю что нет смысла включать обратно. Вряд ли кэширование зависит от этого аттрибута

nikolay

nikolay

special это не кэш (не аналог slog). и как я выше писал под вашу нагрузку он тоже не подходит. но попробовать можно. главное проверьте что его можно безболезненно удалять из пула, я не помню как в openzfs реализовано

nikolay

nikolay

в снапшот пишутся только новые данные или измененные данные, причем старые блоки при этом никуда не перемещаются, просто сдвигаются указатели.

Δαρθ

Δαρθ

Кстати я таки нарыл как 'чётности' считаются в raidz3. Линк и аттач.

https://www.opensfs.org/wp-content/uploads/2016/04/LUG2016D1_Vectorized-ZFS-RAIDZ_Gvozden-Neskovic.pdf

max

max

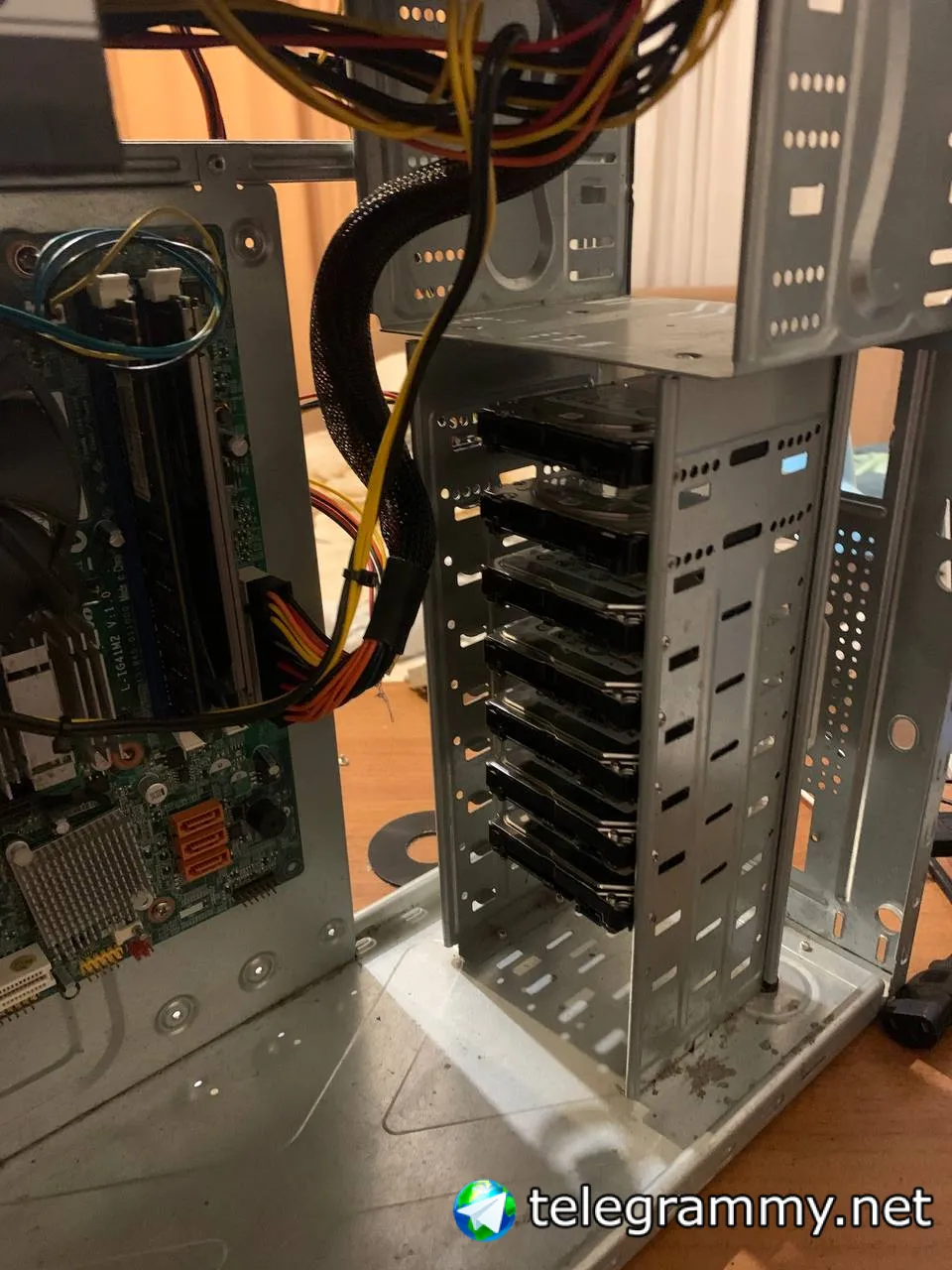

Ей народ, ко мне приехали винты, кто подскажет с организацией всего этого

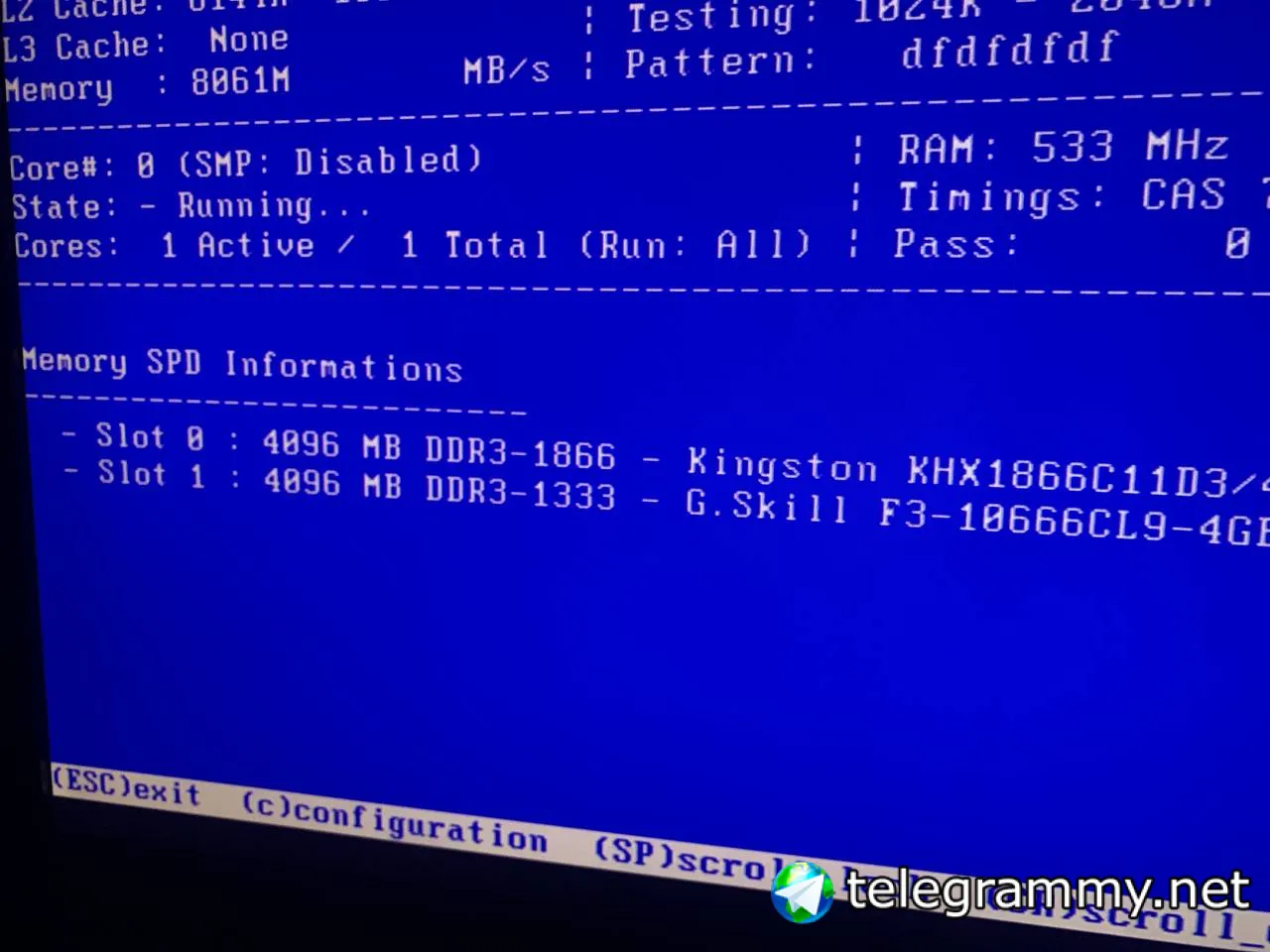

Итого мы имеем сервер : Xeon , 8 ram

3 sata выхода на материнке

Lsi SAS контроллер на 8 дисков

10 x SAS 1 tb 7k

2 x 600 gb SAS 10k

1 ssd sata 256 gb

1 SAS 2 tb 7k

2 sata 500gb 6gb/s

Предполагаю что на уровне ZFS будет организовано 2 рейда :

1 рейд 5 из 5 1 тб винтов

2 рейд 1 из 2 600 гб

И 1 2 тб винт для бекаров

Система будет на ссд

Рейд 5 будет отдаваться по iscsi

На рейде 1 будут собственно база данных и прочее, где нельзя потерять инфу

Хотелось бы услышать ваше мнение и дополнения

central

central

Dima

Dima

В этом и смысл. А в предлагаемом варианте рейд5 нельзя. Ну в смысле можно, но с потерей данных. Это аргумент в пользу рейдз2

riv

riv

солярка по NFS раздает диски для двух нод ESX. это домашняя игрушка, поэтому синк дисейлед. при пропадании света в двух случаях вцентр не стартанул. один раз помогло fsk, во втором пришлось откатиться на старый снапшот

Я думаю, что может быть виновато промежуточное кэширование на уровне nfs. Если не сложно, попробуйте провести такой же тест с zvol и iscsi связкой. Это более правильная парадигма.

Василий

Василий

Я думаю, что может быть виновато промежуточное кэширование на уровне nfs. Если не сложно, попробуйте провести такой же тест с zvol и iscsi связкой. Это более правильная парадигма.

У соляриса вроде нфс без кеширования. Хотя не уверен. Не хочу искази) он не особо удобен

Василий

Василий

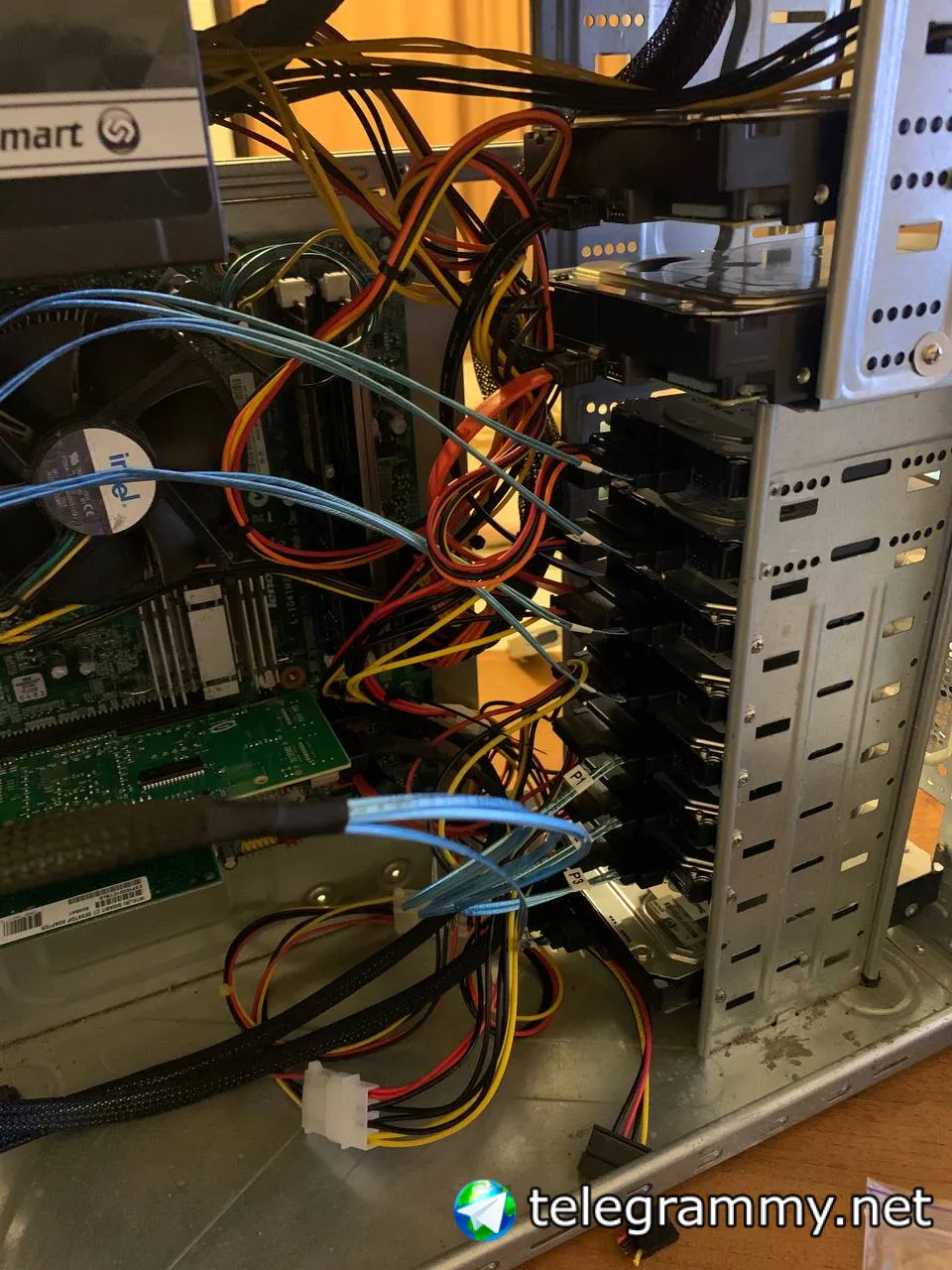

Пипец, я все винты не запущу сегодня, блин , питания нахватает

Хм это что за бп такой слабый?

Ivan

Ivan

Доброго дня. как можно попробовать восстановить файл на zfs?

тут была история успеха с восстановлением удаленных файлов zfs. платные утилиты вполне умеют в zfs.

Δαρθ

Δαρθ

Доброго дня. как можно попробовать восстановить файл на zfs?

монтирование предыдущих уберблоков? хз правда возможно ли это

Олег

Олег

Ох как это все будет греться...

да, адово греться, нужно штук 5 кулеров с бешеным потоком воздуха

Andrey

Andrey

тут больше задача по переносу данных elastic

подключаете диск(и), размечаете в zfs и в elastic смотрите технологию hot-warm-cold

т е если входной поток достаточно большой - без ssd для записи индексов elastic не обойдетесь

шпиндельный диск - как долговременный архив

Andrey

Andrey

если у вас суть - хранение логов с редким разбором инцидентов, то на мой взгляд в zfs+ssd cache никаких преимуществ не даст

данные все равно будут подниматься со шпинделей при запросах.

ssd лучше отдать под грячие данные, а шпиндельный диск - как архив холодных данных

Andrey

Andrey

Горячие - в смысле это те, которые сейчас пишутся и возможно текущий день

Т е сегменты данных индексов лежат на SSD

Но если у вас интенсивно пишется на ssd, то чтение соответственно тупить будет

Поэтому перенос старых данных на другой диск(благо в elastic для этого сейчас функционал из коробки) в какой то мере позволит решить проблему доступа к холодным данным

Но тут еще нужно учитвать загрузку сетевого интерфейса

Если у вас скажем гигабитная сетевуха, то грубо это 100 Мб/сек

И если вы такой поток пишете, то читать через эту же дудку данные из elastic достаточно проблематично

Ilya

Ilya

Aliaksei

Aliaksei

Владимир

Владимир

Sergey

Sergey