тут нужно найти аля msk-ix присутсвующий в вашем дц ну или сменить дц на адекватный

так на местном IX и трафик будет только местный. В чём польза? Ценность всех эксенджей именно когда там много провайдеров собирается. А два провайдера между собой пиринг могут сделать без IX

riv

riv

Могу подтвердить слова Сергея - даже гарантированный аплинк 300Мб/c более чем на порядок дороже, чем абонентский

hetzner-у это не мешает продавать честный гигабит и работае он действительно на гигабит. У них люди другие?

ivdok

ivdok

Сергей

Сергей

hetzner-у это не мешает продавать честный гигабит и работае он действительно на гигабит. У них люди другие?

у них тоже не совсем честный. Возьмите порт на 10Г и получите ограничение с оплатой превышения

Олег

Олег

hetzner-у это не мешает продавать честный гигабит и работае он действительно на гигабит. У них люди другие?

у них обьемы другие и на них равняются при построении сети связей

Сергей

Сергей

hetzner-у это не мешает продавать честный гигабит и работае он действительно на гигабит. У них люди другие?

хетнцер - продавец (генератор) трафика. С его объёмами он может ОЧЕНЬ ХОРОШО договариваться по ценам на входящий трафик

Сергей

Сергей

Это имеет значение, если они не Tier 1?

имеет. У крупных игроков на рынке генерации трафика (MRG, Yandex) - другие правила взаимодействия с магистральными операторами.

p.s. заканчиваем, сорри)

Олег

Олег

Это имеет значение, если они не Tier 1?

тиеры еще имеют значение? кто больше дает траффика на того и равняются. Тиеры это спекуляция

Sergey

Sergey

Да никто из крупных на аплинках не шейпит, это маразм, шейпинг если и есть, то на клиентских портах именно что б соблюсти купленную скорость

Dmitry

Dmitry

Да никто из крупных на аплинках не шейпит, это маразм, шейпинг если и есть, то на клиентских портах именно что б соблюсти купленную скорость

Я не знаю на 100% кто там и что, но проблема есть и даже удалось достучаться до милека, сидят сейчас до меня иперфы гоняют, разбираются

Matrix Operator

Matrix Operator

Да никто из крупных на аплинках не шейпит, это маразм, шейпинг если и есть, то на клиентских портах именно что б соблюсти купленную скорость

шейпят, как лично видевший говорю.

На аплинке от TIER2 к TIER1 точно шейпят, не буду называть прова, но он в тройке по РФ. А вот по магистральным - вопрос, там на оборудке не был.

Dmitry

Dmitry

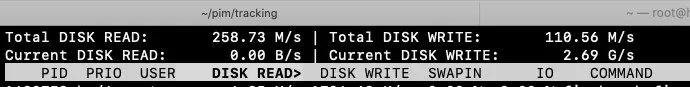

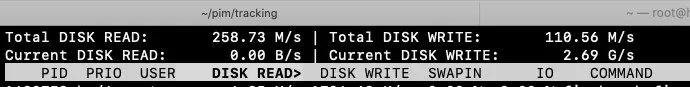

Пока наразбирались, что уронили скорость до 100мбит. В один поток натестили 50мбит, в 40 потоков 400 мбит. Вот и думай после этого

Sergey

Sergey

Проблема далеко не всегда связана с тем, что кто-то пакостит, это может быть просто проблема) например дропы где-то на стыках

Сергей

Сергей

Да никто из крупных на аплинках не шейпит, это маразм, шейпинг если и есть, то на клиентских портах именно что б соблюсти купленную скорость

всё верно, и клиентским портом вполне может оказаться и ДЦ, который купил не гарантированные 10G, а какой-нибудь burst с портом 40G. И в таком случае его (ДЦ) и будут резать

Sergey

Sergey

шейпят, как лично видевший говорю.

На аплинке от TIER2 к TIER1 точно шейпят, не буду называть прова, но он в тройке по РФ. А вот по магистральным - вопрос, там на оборудке не был.

Шепер как именно был настроен? И на каком оборудовпнии? Обычно на бордере не стейтфул фаерволлы стоят и залимитить весь порт могут, а вот per ip или по флоу нет, у них иные задачи

Сергей

Сергей

Я не знаю на 100% кто там и что, но проблема есть и даже удалось достучаться до милека, сидят сейчас до меня иперфы гоняют, разбираются

даже интересно стало чем вся эпопея завершится)))

Matrix Operator

Matrix Operator

Шепер как именно был настроен? И на каком оборудовпнии? Обычно на бордере не стейтфул фаерволлы стоят и залимитить весь порт могут, а вот per ip или по флоу нет, у них иные задачи

на BRASS по одному из хорайзн, в сторону магистральных линков, по полосе

Dmitry

Dmitry

даже интересно стало чем вся эпопея завершится)))

я надеюсь, что она завершится до того, как у меня все скачается )) бо уже 50% слилось

Sergey

Sergey

на BRASS по одному из хорайзн, в сторону магистральных линков, по полосе

Так причем тут тогда операторы меж дц? Брасс это клиентская штуковина и там это норма

Сергей

Сергей

на BRASS по одному из хорайзн, в сторону магистральных линков, по полосе

брасс в сторону клиентов же смотрит

Сергей

Сергей

а мы разве не про это? Тогда сорри, я контекст потерял

нее)), речь потом пошла что магистралы друг друга шейпят)

Alexandr

Alexandr

Alexandr

Alexandr

ну тот же qos на случай перегрузок могут настроить, но порты ж тоже в полку никто не держит

есть пиковые моменты, они практически у всех окдинаковые

Sergey

Sergey

и обычно не допускают даже упирания в полку, потому что при выпадении одного линка из портченела потом будет ад и израиль)

Сергей

Сергей

я лично видел эти настройки у магистрала, не буду говорить у какого

здесь все свои, так что можно не скрывать имя этого чудесного представителя операторов связи)))

Dmitry

Dmitry

есть пиковые моменты, они практически у всех окдинаковые

у меня пиковый момент уже неделю, судя по всему ))

Sergey

Sergey

Щас, чую, админ опять придет и нас гонять будет

это ж в прямую относится к функционалу zfs send/recv ) да и всегда приятно в чатах что-то новое узнать)

Alexandr

Alexandr

здесь все свои, так что можно не скрывать имя этого чудесного представителя операторов связи)))

нене, я не могу разглашать имена свои клиентов)

Alexandr

Alexandr

у меня пиковый момент уже неделю, судя по всему ))

да, такое тоже бывает, если провадер нечет расширять канал, то оно постоянно в планке и подрезает всех, это я тоже наблюдал

Dmitry

Dmitry

это ж в прямую относится к функционалу zfs send/recv ) да и всегда приятно в чатах что-то новое узнать)

мне это напомнило древний анекдот про китов и блох ))

Fedor

Fedor

это ж в прямую относится к функционалу zfs send/recv ) да и всегда приятно в чатах что-то новое узнать)

Не относится, так как среду передачи данных рассматривать не имеет смысла

Ivan

Ivan

https://github.com/openzfs/zfs/releases/tag/zfs-0.8.5

фактически под ядро 5.9 должно теперь собираться ?

Nikolay

Nikolay

Если я создал снапшот, выглядит это так:

NAME USED AVAIL REFER MOUNTPOINT

mega/subvol-104-disk-0@october_08_2020 2,03M - 53,0G -

Т.к. снапшот хранит только ссылки на данные, то получается что 53Гб это те данные, которые уже не будут перезаписаны внутри сабвола, т.к. на них снапшот ссылается ?

И соответственно чем больше снапшотов, тем больше это "неприкасаемое" пространство ?

George

George

Если я создал снапшот, выглядит это так:

NAME USED AVAIL REFER MOUNTPOINT

mega/subvol-104-disk-0@october_08_2020 2,03M - 53,0G -

Т.к. снапшот хранит только ссылки на данные, то получается что 53Гб это те данные, которые уже не будут перезаписаны внутри сабвола, т.к. на них снапшот ссылается ?

И соответственно чем больше снапшотов, тем больше это "неприкасаемое" пространство ?

Это copy on write, там не перезапись а сохранение версии блока, которая была на момент снапшота. Чем больше изменений произошло с момента снапшота, тем больше старых блоков не удалилось и размер снапшота вырос. Разные снапы могут ссылаться на одну версию блока.

Nikolay

Nikolay

Это copy on write, там не перезапись а сохранение версии блока, которая была на момент снапшота. Чем больше изменений произошло с момента снапшота, тем больше старых блоков не удалилось и размер снапшота вырос. Разные снапы могут ссылаться на одну версию блока.

NAME USED AVAIL REFER MOUNTPOINT

mega/subvol-104-disk-0@october_08_2020 335M - 53,0G -

1) Сейчас used - 335М (было 2,03М) , так понимаю это и есть изменения с момента снапшота и по факту занимаемое снапшотом место?

2) Только не понимаю почему именно размер снапшота растёт.. это же просто сохранённые версии блоков.. вот это вроде понятно "Чем больше изменений произошло с момента снапшота, тем больше старых блоков не удалилось", выходит что снапшот хранит историю изменения блоков (было - стало) из первоначальных 53Гб ? а потом если надо откатывается к "было" игнорирую всё из "стало" ?

George

George

NAME USED AVAIL REFER MOUNTPOINT

mega/subvol-104-disk-0@october_08_2020 335M - 53,0G -

1) Сейчас used - 335М (было 2,03М) , так понимаю это и есть изменения с момента снапшота и по факту занимаемое снапшотом место?

2) Только не понимаю почему именно размер снапшота растёт.. это же просто сохранённые версии блоков.. вот это вроде понятно "Чем больше изменений произошло с момента снапшота, тем больше старых блоков не удалилось", выходит что снапшот хранит историю изменения блоков (было - стало) из первоначальных 53Гб ? а потом если надо откатывается к "было" игнорирую всё из "стало" ?

Примерно так. Для zvol максимальный размер снапа = размер занятого zvolом на момент создания снапа. Т.е. Не удалять старые блоки, а оставить в рамках снапшота.

riv

riv

Это copy on write, там не перезапись а сохранение версии блока, которая была на момент снапшота. Чем больше изменений произошло с момента снапшота, тем больше старых блоков не удалилось и размер снапшота вырос. Разные снапы могут ссылаться на одну версию блока.

Это правильно называется redirect on write

Даже если логически подумать, по другому-то как? Если вы сохраняете состояние, а zvol можно полностью перезаписать, где должны размещаться две или больше разные версии данных?

Кстати, у снимков есть ещё параметр резервирование, который позволяет загодя зарезеравировать место под redirect on write (или CoW как тут привыкли тут писать)

Nikolay

Nikolay

Ну кстати вот цитата: "При создании снимка его пространство первоначально используется совместно с файловой системой и, возможно, с предшествующими снимками. При изменении файловой системы пространство, которое ранее использовалось совместно, полностью передается снимку и учитывается в свойстве used этого снимка."

riv

riv

Ну кстати вот цитата: "При создании снимка его пространство первоначально используется совместно с файловой системой и, возможно, с предшествующими снимками. При изменении файловой системы пространство, которое ранее использовалось совместно, полностью передается снимку и учитывается в свойстве used этого снимка."

Ну это всё нюансы учета. А вот интересно то, что при удалении снимков, никогда нельзя заранее точно сказать сколько места высвободится. И решить эту проблему можно только используя параметры -npv или -nv для человекочитаемого вывода, которые предотвращают удаление, но позволяет вывести информацию о высвобождаемом пространстве в команде zfs destroy -npv

Ситуация ещё сложнее если нужно удалить сколько-то снимков чтобы освододить Х гигабайт.

Лично я делаю это перебором, благо, можно сделать так:

zfs destroy -npv <filesystem|volume>@<snap>[%<snap>][,...]

George

George

riv

riv

не понял о чём это)

Это было про тормоза в венде из-за "Dynamic Fair Share Scheduling" и я думал скриптец нужен, который это безобразие отключает

Чатом ошибся

riv

riv

небольшой офтоп. В некоторых каналах можно каментить в отдельной ленте, прикрепленной к этому посту. Возможно было бы прекрасно, если бы так же можно было бы каментить посты типа #вопрос и #проблема

Igor

Igor

Извините за тупой вопрос. А в страйпе 2+2+3 можно сменить 2тб на 4тб? Пул станет 9тб без потери инфы?

George

George

Извините за тупой вопрос. А в страйпе 2+2+3 можно сменить 2тб на 4тб? Пул станет 9тб без потери инфы?

два диска на один? или один из 2тб дисков на 4тб?

George

George

второе

можно через zpool attach сделать из 2ТБ vdev миррор, добавив диск на 4ТБ в него, а потом исключить через zpool detach

по идее должно сработать, рекомендую проверить предварительно, создав тестовый пул на файликах

Сергей

Сергей

Alexander

Alexander

Evgenii

Evgenii