👍у меня что- то не вышло профита

по сравнению с чем?

Alexander

Alexander

Сергей

Сергей

Можно потом еще конфиг zfs

pool: zpool

state: ONLINE

scan: scrub repaired 0B in 0 days 00:14:58 with 0 errors on Sun Sep 13 00:38:59 2020

config:

NAME STATE READ WRITE CKSUM

zpool ONLINE 0 0 0

mirror-0 ONLINE 0 0 0

nvme-KXD51RUE960G_TOSHIBA_10CS102IT7PM ONLINE 0 0 0

nvme-SAMSUNG_MZQLB960HAJR-00007_S437NA0N507772 ONLINE 0 0 0

mirror-1 ONLINE 0 0 0

nvme-KXD51RUE960G_TOSHIBA_60DS10CLT7PM ONLINE 0 0 0

nvme-KXD51RUE960G_TOSHIBA_60DS10CQT7PM ONLINE 0 0 0

logs

mirror-2 ONLINE 0 0 0

nvme-INTEL_SSDPED1D480GA_PHMB746200U0480DGN-part5 ONLINE 0 0 0

nvme-INTEL_SSDPE21D480GA_PHM2809000EU480BGN-part5 ONLINE 0 0 0

Сергей

Сергей

NAME USED RATIO LUSED AVAIL LOGBIAS SYNC ATIME PRIMARYCACHE COMPRESS RECSIZE VOLBLOCK MOUNTPOINT

zpool/pg-rep-gcp 457G 1.72x 786G 1.23T latency standard off all on 128K - none

zpool/pg-rep-gcp/main 457G 1.72x 786G 1.23T latency standard off all on 16K - /var/lib/postgresql/12/main

Сергей

Сергей

это я сейчас тестирую на zpool/pg-rep-gcp/main, где RECSIZE=16K. Все остальные параметры по умолчанию

Evgenii

Evgenii

Почему?

Из за особенностей записи на ssd, trim, внутренний cow постраничный и тд

А если qlc память внутри то скорость жестких дисков покажется супербыстрой, стоит дать длительную нагрузку, чтобы ячейки начали уплотняться из однобитового в трехбитовый режим

Evgenii

Evgenii

Zfs дает двойную нагрузку на запись, если нет отдельного slog насколько я понимаю

И настройки по умолчанию sync - требовательнее к диску чем обычные файловые системы

George

George

George

George

ещё интересно померять redundant_metadata=most , копеечку может ещё дать сверху. На дешёвых nvme и асинхронной записи у меня разницы не давало

Alexander

Alexander

Сергей

Сергей

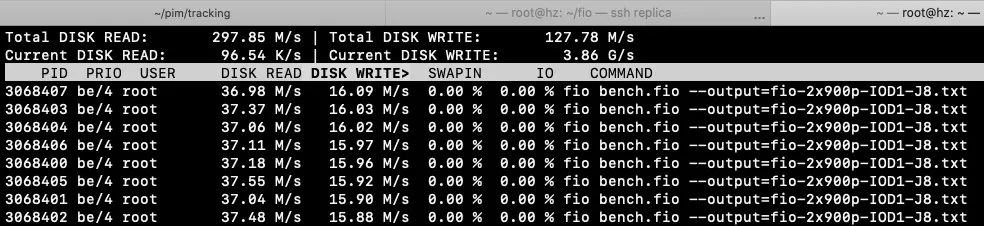

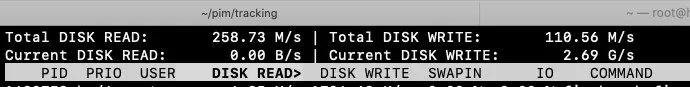

@gmelikov, как мне лучше нагрузить на чтение? Может размер файла сделать побольше? сейчас 32G. Но мне кажется что можно больше выжать

Сергей

Сергей

А можно обнаглеть и попросить прямо строку всю для запуска теста?

можно даже не всю строку, а набор файлов который я использую. минуту

Alexander

Alexander

можно даже не всю строку, а набор файлов который я использую. минуту

Но как было правильно замеченно у меня их всего 2 , поэтому было без logs

Сергей

Сергей

в bench.sh поправить путь к месту где будет проходить тест

я тестировал пока скорость filesystem. Сейчас сделаю zvol на 100-200Гб и прогоню скорость zvol

George

George

@gmelikov, как мне лучше нагрузить на чтение? Может размер файла сделать побольше? сейчас 32G. Но мне кажется что можно больше выжать

если хочется тестить worst case, то отключить кеширование data в arc, после этого размер файла не сильно важен, я бы хотя бы 50ГБ сделал бы, nvme как никак

George

George

для nvme ещё можно крутить zfs_vdev_sync_read_max_active и аналогичные, в зависимости от конкретного диска

George

George

сжатие на nvme я бы отключил. Увы, на оптанах zfs сейчас имеет узкие места, а сжатие латенси только ухудшит

Alexander

Alexander

сжатие на nvme я бы отключил. Увы, на оптанах zfs сейчас имеет узкие места, а сжатие латенси только ухудшит

Ух... а какие предпочтительней будут?

Alexander

Alexander

сжатие на nvme я бы отключил. Увы, на оптанах zfs сейчас имеет узкие места, а сжатие латенси только ухудшит

Или это ко всем nvme относится?

Сергей

Сергей

сжатие на nvme я бы отключил. Увы, на оптанах zfs сейчас имеет узкие места, а сжатие латенси только ухудшит

я думаю что на том сервере вкл/выкл сжатие не играет роли, там 64 ядра на amd epyc. Вряд ли это даст какой-то существенный прирост. Но прогоню ещё раз.

George

George

если у кого убунта кстати, init_on_alloc=0 ставьте в параметры ядра (https://github.com/openzfs/zfs/issues/10141)

George

George

Сергей

Сергей

эм, buffer_compress_percentage закомменчен? пока выглядит так, что со сжатием такое нормальные результаты не покажет, оно же нули пишет

я возможно конфиг взял старый. сейчас перепроверю.

George

George

я сжатие обычно с таким тестю

buffer_compress_percentage=15

refill_buffers

buffer_pattern=0xdeadbeef

процент по вкусу, не менее 13, 12.5 и меньше zfs сейчас отбросит и запишет не сжатое

Alexander

Alexander

refill_buffers наверное даже убрать можно

Я так понимаю , если оптан использовать под logs тоже профита особого не будет?

Сергей

Сергей

Я так понимаю , если оптан использовать под logs тоже профита особого не будет?

как раз оптан под slog лучше всего и использовать

Alexander

Alexander

даже с nvme. (если конечно весь пул из оптанов не собран)

Вернее не так)) пул на ssd а оптаны в logs

Сергей

Сергей

Вернее не так)) пул на ssd а оптаны в logs

вот как раз я у себя и делал оптан под slog для пула из nvme. Пока что ни один из обычных nvme/ssd не имеет latency как у оптанов. А для slog важна именно latency

Alexander

Alexander

George

George

Alexander

Alexander

u2 - это разъем по моему, а не протокол

Да, у интел просто они все оптаны и u2 и pci то про что Сергей говорит

Сергей

Сергей

я думаю что низкая скорость чтения у меня из-за recsize=16k, это я для PG затачивал датасет. На 128К всё должно быть по-другому

Evgenii

Evgenii

Да, у интел просто они все оптаны и u2 и pci то про что Сергей говорит

Alexander

Alexander

Evgenii

Evgenii

Да не скажите, если использовать оптан nvdimm))как и сказал Сергей латенси будет явно думаю меньше

Ну это понятно, там шина не PCI-E, напрямую в контроллер памяти в процессоре подключается

Сергей

Сергей

Alexander

Alexander

Сергей

Сергей

Да мелким блоком и посмотреть iops на запись

разве такой мелкий блок имеет смысл? дефолтный размер для zvol=8k, для filesystem=128k. Для СУБД рекомендуют 8к. А почему именно 4к?

Alexander

Alexander

Alexander

Alexander

Сергей

Сергей

Zvol

ок. это у меня как раз скоро начнёт тестироваться. будет с отключенной компрессией и с включенной (тестовые данные могут быть сжаты на 30%, хотя на реальных данных сжимается выше)

Alexander

Alexander

Sergey

Sergey