как посмотреть?)) я не нашел)

можно через sysfs, но надо помнить что есть таблица исключений

George

George

фух, перевёз доку по оптимизациям и железу на гитхаб

- https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Workload%20Tuning.html

- https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Hardware.html

Welcome фиксы по оптимизациям :)

Qwerty

Qwerty

Так-с. Коллеги, я установил zfs 2.0 rc1

Ubuntu 18.04.5 LTS 5.4-kernel

Пакеты

libzfs2

zfs

zfs-dkms

zfs-initramfsПосле перезагрузки пул не вижу,

zpool status

no pools availableКто, что подскажет, какой пакет нужно поставить?

update-initramfs делал)

George

George

Qwerty

Qwerty

zpool import не делали видимо?)

не-а. А что мне так нужно делать каждый раз при перезагрузке О_о

George

George

если что - пакет из апстрима и пакет в дистрибутиве могут отличаться, в части как раз автоимпорта между ребутами, точно не скажу

Qwerty

Qwerty

Но таки работает, спасибо. И самое прикольное, что если не сделать импорт, а снова пул пересоздать, то он даже не ругнется, что там есть метка zfs. а создаст с нуля.

Nikolay

Nikolay

Я на боевом серваке поменял арк-сайз в конфиге и сделал "update-initramfs -u" какие-то ворнинги получил, "не могу найти / что-то, нашёл /porc" как-то так. Теперь боюсь ребутать его )

Vladislav

Vladislav

Такой SSD умер ровно после 3 лет эксплуатации

Disk /dev/sdb: 223.6 GiB, 240057409536 bytes, 468862128 sectors

Disk model: INTEL SSDSC2CW24

Units: sectors of 1 * 512 = 512 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

#негатив

#запланированное_устаревание

Nikolay

Nikolay

#Вопрос

Если я поделю диск на разделы для special и slog. А потом special станет не хватать. Slog я могу удалить из пула а потом и раздел.

А как поступить со спешиал ? Измененить раздел через fdisk надо удалить раздел и создать большего размера и zfs сам подхватит автоматом ? Что в это время будет с пулом ? Какая последовательность действий ?

Сергей

Сергей

#Вопрос

Если я поделю диск на разделы для special и slog. А потом special станет не хватать. Slog я могу удалить из пула а потом и раздел.

А как поступить со спешиал ? Измененить раздел через fdisk надо удалить раздел и создать большего размера и zfs сам подхватит автоматом ? Что в это время будет с пулом ? Какая последовательность действий ?

При удалении спешл из пула zfs перенесёт данные на пул. После этого создать новый раздел и добавить ещё раз в пул. Но на него будут попадать только вновь записываемые данные

Сергей

Сергей

емкость 447 Гб: 350 под спешиал и 50 на слог. И пусть живёт себе.

спешл нужно в mirror, помните?

riv

riv

#Вопрос

Если я поделю диск на разделы для special и slog. А потом special станет не хватать. Slog я могу удалить из пула а потом и раздел.

А как поступить со спешиал ? Измененить раздел через fdisk надо удалить раздел и создать большего размера и zfs сам подхватит автоматом ? Что в это время будет с пулом ? Какая последовательность действий ?

Лучше, конечно оставить пространство для манёвра. А какая ёмкость пула?

Емкость special ~ 1% от суммарной ёмкости данных в пуле или около 10Гб на 1Тб

Емкость slog зависит от нагрузки, но как правило, не большая 10-20Гб.

Кэшь тоже может быть полезен.

Nikolay

Nikolay

Лучше, конечно оставить пространство для манёвра. А какая ёмкость пула?

Емкость special ~ 1% от суммарной ёмкости данных в пуле или около 10Гб на 1Тб

Емкость slog зависит от нагрузки, но как правило, не большая 10-20Гб.

Кэшь тоже может быть полезен.

18 Тб полезного пространства. 1% - около 200Гб, если округлить.

riv

riv

18 Тб полезного пространства. 1% - около 200Гб, если округлить.

Он просто не станет занимать больше.

riv

riv

Вопрос на сколько? Он не вымывается, например, интенсивным чтением. В кэшь попадают только действительно часто читающиеся данные. Например, у меня на у5ТБ пуле он вообще почему то занят на 10-20Гб всего (т.к пул работает в основном на запись, а читаются всегда разные данные)

riv

riv

Вооще я видел формулу для spec vdev: size/block size*(blocksize+checksum)

Я по опыту. У меня на больших пулах почему то везде около 1% занято. Где выдал с запасом, часть свободная осталась.

Оказалось точнее 1.23%

riv

riv

Обязательно не забудте включить autotrim=on или периодически запускать trim на пуле - это продлит жизнь ssd и сильно увеличит её быстродействие.

riv

riv

Делалось давно, его тогда ещё не существовало. Задача была защитить данные на случай "кражи" сервера.

Vladimir

Vladimir

riv

riv

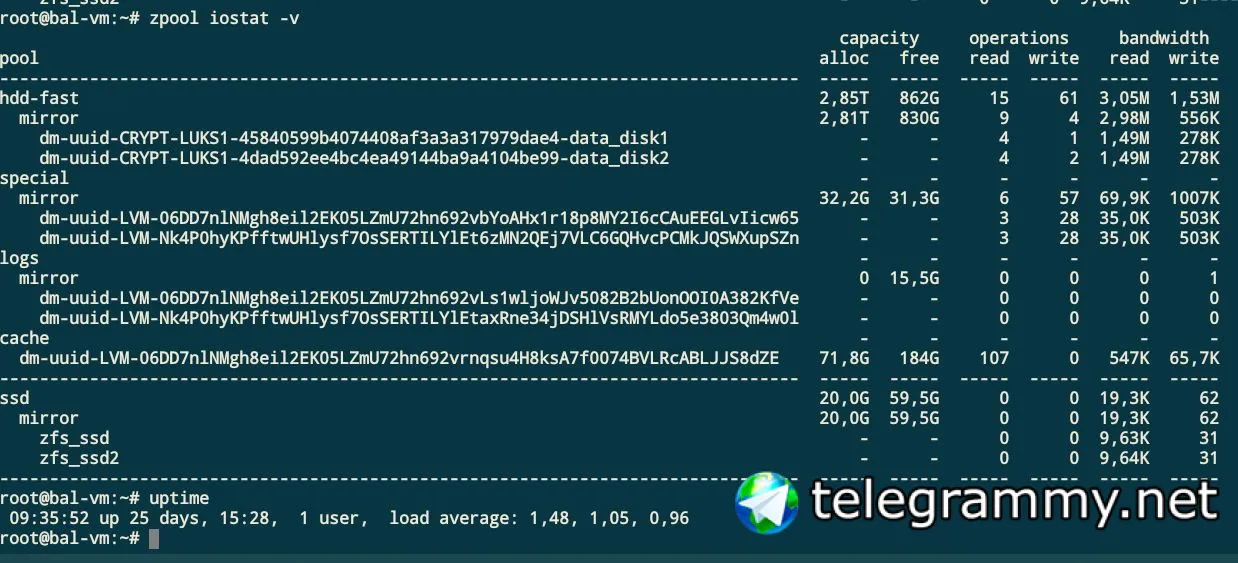

Обратите внимание, насколько полезен кэш и что он, в отличие от special, работает, в основном, на чтение и не заполнен полностью. По этому, кэшь точно не приведёт к сильному усилению износа.

А вот special работает исключительно на запись. Но он драматически улучшает производительность пула.

Это файловый сервер с профилями windows-пользователей

Nikolay

Nikolay

Обратите внимание, насколько полезен кэш и что он, в отличие от special, работает, в основном, на чтение и не заполнен полностью. По этому, кэшь точно не приведёт к сильному усилению износа.

А вот special работает исключительно на запись. Но он драматически улучшает производительность пула.

Это файловый сервер с профилями windows-пользователей

кэш на отдельный ссд рекомендуюется выносить ?

riv

riv

Сделаю в районе 1,3% - 220Гб. Золотая середина )

Я не вижу ничего плохого в использовании lvm. Оверхед только в тестах заметен. Но если уж очень против, можно, в случае чего, двигать разделы утилитой gparted. Она работает через x11 и ssh.

riv

riv

кэш на отдельный ссд рекомендуюется выносить ?

Рекомендуется, но не обязательно. Смотрите средняя производительность пула всё равно свящана со скорость обычных дисков. На фоне их низкой производительности, ssd работает так быстпо, что не важно, на отдельном устройстве кэшь или вместе slig и special.

Другими словами, если приобрести для cache отдельный ssd, производительность сильно не улучшится.

Владимир

Владимир

Я не вижу ничего плохого в использовании lvm. Оверхед только в тестах заметен. Но если уж очень против, можно, в случае чего, двигать разделы утилитой gparted. Она работает через x11 и ssh.

так сейчас в ext4 можон без рестарта увеличивать раздел

riv

riv

Речь про то, что делать если special и slog и возможно cache выделить по минимому и придётся их увеличивать. Придется их двигать или использовать lvm. Я за lvm.

Ivan

Ivan

Речь про то, что делать если special и slog и возможно cache выделить по минимому и придётся их увеличивать. Придется их двигать или использовать lvm. Я за lvm.

попробую увеличить special сегодня увеличением партиции

riv

riv

попробую увеличить special сегодня увеличением партиции

Нужно будет включить autoexpsnd в пуле, а после увеличения special, по моему, zpool status -vn

Получить июцифровой id устройства и потом

zpool online $id

Ivan

Ivan

а трим для special реально работает ?

я правильно понимаю, что автотрим нужно включать для пула hdd в котором есть special или это как-то отдельно включается ?

riv

riv

а трим для special реально работает ?

я правильно понимаю, что автотрим нужно включать для пула hdd в котором есть special или это как-то отдельно включается ?

Честно говоря, специально не проверял, но почему то уверен, что да. Посмотрите нагрузку от трим на iotop после удаления большого датасета. Там название процесса говорящее.

Но если трим не включить, при люьом % занятого места, на ssd будет рано или поздно алоцировпно 100% - это с точки зрения контроллера ssd.

riv

riv

а трим для special реально работает ?

я правильно понимаю, что автотрим нужно включать для пула hdd в котором есть special или это как-то отдельно включается ?

Да верно, включить для hdd-пула, несмотря на всю странность такой операции.

Ivan

Ivan

кстати видел рекомендации вообще не включать трим на промышленных ссд, т.к. они делают нагрузку непрогнозируемой. и без трима эти ссд живут нормально.

Владимир

Владимир

кстати видел рекомендации вообще не включать трим на промышленных ссд, т.к. они делают нагрузку непрогнозируемой. и без трима эти ссд живут нормально.

на них ещё рекомендуют не размечать часть пространства

Nikolay

Nikolay

Речь про то, что делать если special и slog и возможно cache выделить по минимому и придётся их увеличивать. Придется их двигать или использовать lvm. Я за lvm.

Так понимаю что простого lvextend достаточно без дополнительных плясок ?

riv

riv

на них ещё рекомендуют не размечать часть пространства

У вас и так вынуждено должен быть резерв по свободному месту в пуле в ~30%. Я просто оставляю соопоставимый резерв на всех vdev и думаю, что это так же полезно. Но зачем нам два резерва? Пусть лучше будет трим.

Отдельно стоит упомянуть недавно обсуждавшееся отключение writeback кэша для промышленных ssd, которое, как ни стрснно, должно улучшать производительность синхронной записи. Это должно быть актуал но доя special и slog, но я ещё не проверял как на самом деле.

riv

riv

Так понимаю что простого lvextend достаточно без дополнительных плясок ?

Ну да и zpool autoexpand=on + zpool online $devid

Совсем само вроде не екстендится без пинка :-) надо проверить.

riv

riv

writeback - речь про настройку на самом SSD или про кеш на пуле?

Типа когда прилетает cach flush ssd очищает вась кэш: и что надо и что не надо, а если от отключен, в sata всё срабатывает как надо, а в sas такой проблемы быть не долдно

Но я бы проверил эти утверждения. Кто ссылку на статью кинет? У меня пк не под рукой.

Igor

Igor

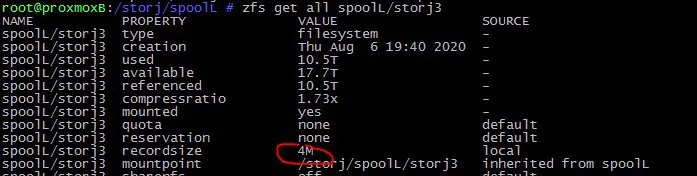

zfs create -o recordsize=4M -o atime=off -o xattr=off -o exec=off -o compression=on spoolL/storj5

Vladimir

Vladimir

А в каких случаях нужны такие огромные рекордсайзы и что они дают?

где-то никогда, но народ любит тыкать :)

George

George

При удалении спешл из пула zfs перенесёт данные на пул. После этого создать новый раздел и добавить ещё раз в пул. Но на него будут попадать только вновь записываемые данные

не стоит этим механизмом пользоваться просто так.

Можно просто special раздел делать в начале диска, потом при надобности сносится slog l2arc, раздел увеличивается руками, делается autoexpand на vdev, профит

Алексей

Алексей

Fedor

Fedor