George

George

гугл даёт для такой конфигурации Errorless rebuild success chance: 15%, не знаю как сюда добавить ещё черепашесть smr при ресильвере

George

George

Согласен, но у меня только

1 - 4 диска 3.5 можно впихнуть.

2 - там чисто бекап и медиафайлы, если потеряется, то не сильно огорчусь.

Плюс я планирую либо расширить его либо оттащить на работу, и хранить бекапы там.

если потеря не страшна, то эксперимент интересный! Если не соберётся когда-то, поделись плиз опытом

George

George

Плюс если по записи, то планирую еще добавить SSD диск как slog & special vdev

ну в openzfs 2.0 приедет rebuild, там сильно безопаснее станет, т.к. будет чисто поточная нагрузка при ребилде

George

George

Плюс если по записи, то планирую еще добавить SSD диск как slog & special vdev

на сколько smr дешевле обошлись, кстати?

Qwerty

Qwerty

на сколько smr дешевле обошлись, кстати?

Ну у меня 1 был уже. Докупил с Авито, б/у за 7к за штуку ( Но с гарантией )

Qwerty

Qwerty

root@storage:/test# fio --filename=test --sync=1 --rw=randwrite --bs=1m --numjobs=10 --iodepth=4 --group_reporting --name=test --filesize=10G --runtime=300 && rm test

test: (g=0): rw=randwrite, bs=(R) 1024KiB-1024KiB, (W) 1024KiB-1024KiB, (T) 1024KiB-1024KiB, ioengine=psync, iodepth=4

...

fio-3.1

Starting 10 processes

test: Laying out IO file (1 file / 10240MiB)

Jobs: 10 (f=10): [w(10)][100.0%][r=0KiB/s,w=40.0MiB/s][r=0,w=40 IOPS][eta 00m:00s]

test: (groupid=0, jobs=10): err= 0: pid=6590: Mon Sep 21 10:27:40 2020

write: IOPS=129, BW=130MiB/s (136MB/s)(38.1GiB/300022msec)

clat (msec): min=28, max=1205, avg=76.67, stdev=70.06

lat (msec): min=29, max=1206, avg=76.93, stdev=70.06

clat percentiles (msec):

| 1.00th=[ 53], 5.00th=[ 58], 10.00th=[ 59], 20.00th=[ 62],

| 30.00th=[ 62], 40.00th=[ 63], 50.00th=[ 64], 60.00th=[ 65],

| 70.00th=[ 66], 80.00th=[ 68], 90.00th=[ 77], 95.00th=[ 104],

| 99.00th=[ 468], 99.50th=[ 472], 99.90th=[ 802], 99.95th=[ 1133],

| 99.99th=[ 1200]

bw ( KiB/s): min= 2043, max=18769, per=10.14%, avg=13497.88, stdev=4635.09, samples=5934

iops : min= 1, max= 18, avg=13.11, stdev= 4.51, samples=5934

lat (msec) : 50=0.29%, 100=94.44%, 250=2.70%, 500=2.32%, 750=0.13%

lat (msec) : 1000=0.07%, 2000=0.05%

cpu : usr=0.35%, sys=3.50%, ctx=245944, majf=0, minf=75

IO depths : 1=100.0%, 2=0.0%, 4=0.0%, 8=0.0%, 16=0.0%, 32=0.0%, >=64=0.0%

submit : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

complete : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

issued rwt: total=0,38992,0, short=0,0,0, dropped=0,0,0

latency : target=0, window=0, percentile=100.00%, depth=4

Run status group 0 (all jobs):

WRITE: bw=130MiB/s (136MB/s), 130MiB/s-130MiB/s (136MB/s-136MB/s), io=38.1GiB (40.9GB), run=300022-300022msec

George

George

Qwerty

Qwerty

root@storage:/test# fio --filename=test --sync=1 --rw=randwrite --bs=4k --numjobs=20 --iodepth=4 --group_reporting --name=test --filesize=1G --runtime=300 && rm test

test: (g=0): rw=randwrite, bs=(R) 4096B-4096B, (W) 4096B-4096B, (T) 4096B-4096B, ioengine=psync, iodepth=4

...

fio-3.1

Starting 20 processes

Jobs: 20 (f=20): [w(20)][98.3%][r=0KiB/s,w=80KiB/s][r=0,w=20 IOPS][eta 00m:05s]

Jobs: 20 (f=20): [w(20)][100.0%][r=0KiB/s,w=160KiB/s][r=0,w=40 IOPS][eta 00m:00s]

test: (groupid=0, jobs=20): err= 0: pid=17550: Mon Sep 21 10:38:16 2020

write: IOPS=265, BW=1062KiB/s (1088kB/s)(311MiB/300080msec)

clat (msec): min=12, max=1981, avg=75.30, stdev=205.76

lat (msec): min=12, max=1981, avg=75.30, stdev=205.76

clat percentiles (msec):

| 1.00th=[ 14], 5.00th=[ 15], 10.00th=[ 15], 20.00th=[ 15],

| 30.00th=[ 15], 40.00th=[ 16], 50.00th=[ 23], 60.00th=[ 29],

| 70.00th=[ 31], 80.00th=[ 42], 90.00th=[ 65], 95.00th=[ 435],

| 99.00th=[ 1083], 99.50th=[ 1250], 99.90th=[ 1687], 99.95th=[ 1737],

| 99.99th=[ 1989]

bw ( KiB/s): min= 7, max= 281, per=6.83%, avg=72.53, stdev=78.85, samples=8785

iops : min= 1, max= 70, avg=18.11, stdev=19.71, samples=8785

lat (msec) : 20=49.09%, 50=35.15%, 100=9.09%, 250=0.20%, 500=2.36%

lat (msec) : 750=0.50%, 1000=2.06%, 2000=1.56%

cpu : usr=0.03%, sys=0.28%, ctx=166562, majf=0, minf=187

IO depths : 1=100.0%, 2=0.0%, 4=0.0%, 8=0.0%, 16=0.0%, 32=0.0%, >=64=0.0%

submit : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

complete : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

issued rwt: total=0,79687,0, short=0,0,0, dropped=0,0,0

latency : target=0, window=0, percentile=100.00%, depth=4

Run status group 0 (all jobs):

WRITE: bw=1062KiB/s (1088kB/s), 1062KiB/s-1062KiB/s (1088kB/s-1088kB/s), io=311MiB (326MB), run=300080-300080msec

Alexander

Alexander

Алексей

Алексей

На каждый блок нужно записатт 320байт (кажется) метаданных, из-за этого идёт большой оверхед

Alexander

Alexander

Вот и смотри, сколько у тебя ушло на метаданные

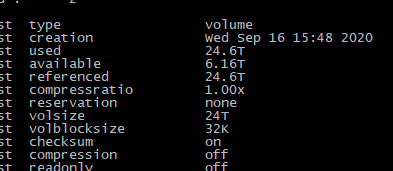

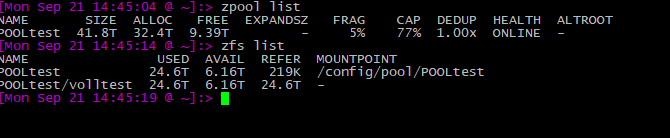

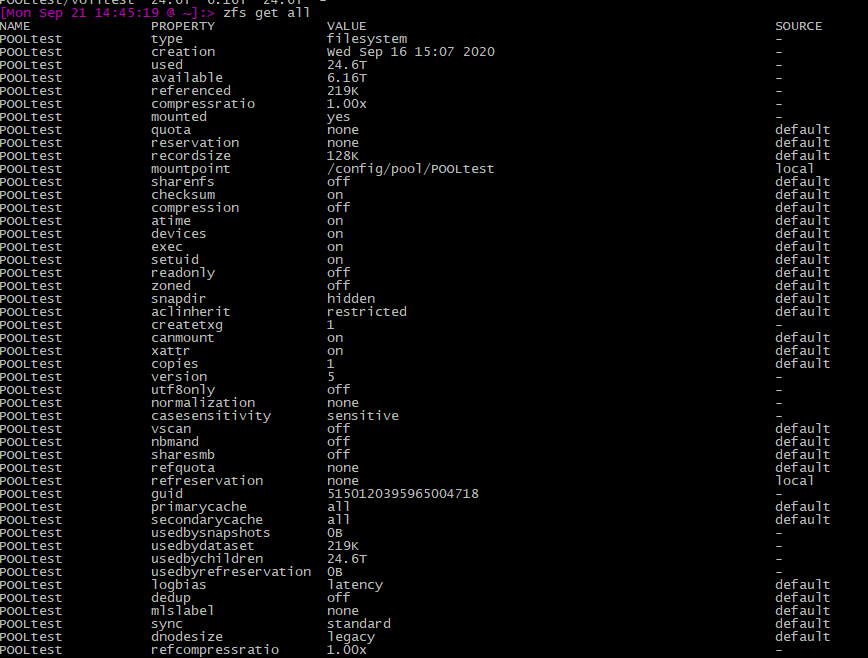

а метаданные не на пуле? они хранятся на примантированном томе

Алексей

Алексей

Метаданные пишутся вместе с данными на пул, если у тебя не настроен отдельный special девайс для этого

Алексей

Алексей

Я не помню сколько точно составляет размер меты, но оверхед из-за этого большой, особенно с учётом того что меньше чем минимальный размер recordsize оно записать не может

Alexander

Alexander

Метаданные пишутся вместе с данными на пул, если у тебя не настроен отдельный special девайс для этого

я может что-то путаю)) но..я создал пул - с него взял область не всю под zfs файловую систему...он метаданные разьве в нее же пишет а не на весь пул?

Алексей

Алексей

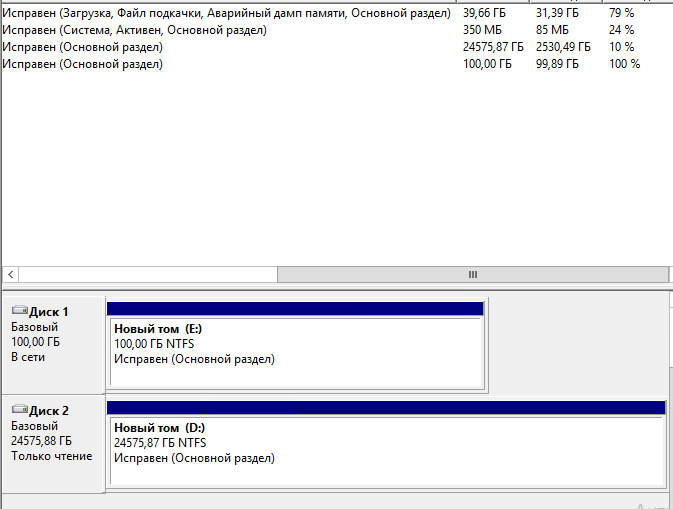

А ты случайно не делал так что сначала в винде диск был маленький, а потом ты его растянул до 24 тб?

Alexander

Alexander

А ты случайно не делал так что сначала в винде диск был маленький, а потом ты его растянул до 24 тб?

нет,сразу целиком толстый

Sergei

Sergei

Метаданные пишутся рядом с данными, но как бы вдобавок, а не вместе с ними

отдельным блоком, а с учётом что это ссд, то может быть выделена целая страница под это? и копий метаданных тоже несколько вроде как, емнип?

Alexander

Alexander

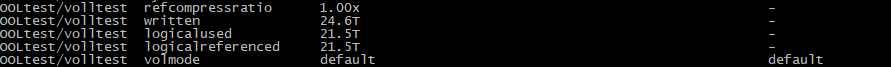

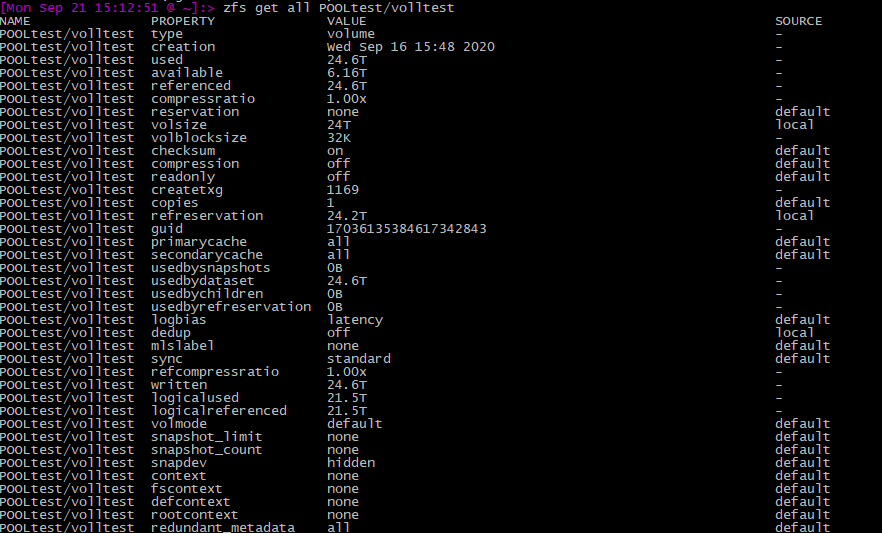

refreservation осознанно выставили? В него видать упёрлись

а записал ,якобы на 10 процентов меньше(

George

George

а записал ,якобы на 10 процентов меньше(

refreservation емнип работает на основе фактически занятого размера, для zvol это != volsize, а обычно больше, мета + raidz может давать аффект. У вас не raidz?

Alexander

Alexander

Alexander

Alexander

в общем если его увеличить, должно заработать

это я понял))то что я его расширю и он заработает)) вопрос как не наступить на эти грабли в будующем)

George

George

он

если raidz, то стоит прочитать https://www.delphix.com/blog/delphix-engineering/zfs-raidz-stripe-width-or-how-i-learned-stop-worrying-and-love-raidz

George

George

эту табличку я помню)) так все таки мета пишется на zvol?

не в мете дело в случае raidz, там на каждый блок пишется ещё 2*ashift

Sergei

Sergei

Alexander

Alexander

не в мете дело в случае raidz, там на каждый блок пишется ещё 2*ashift

тогда получается чтобы выдать клиенту,нужно рассчитать самому вручную "утрирую"))?

George

George

тогда получается чтобы выдать клиенту,нужно рассчитать самому вручную "утрирую"))?

на raidz - да, надо понимать сколько может быть занято по факту