Nick

Nick

почему нет? если у вас тяжелая операция, на которую не хочется тратить серверное время и дешевле отдать данные и загрузить проц у пользователя, то почему бы и нет7

Nick

Nick

но это уже исключительно какие даныне у вас и насколько нежелательно их попадание в руки недоброжелательного пользователя

Alexander

Alexander

почему нет? если у вас тяжелая операция, на которую не хочется тратить серверное время и дешевле отдать данные и загрузить проц у пользователя, то почему бы и нет7

а гонять тонны данных между фронтом и бэком?

Alexander

Alexander

Oleg

Oleg

почему нет? если у вас тяжелая операция, на которую не хочется тратить серверное время и дешевле отдать данные и загрузить проц у пользователя, то почему бы и нет7

и у пользователей со слабым железом будет грузить полчаса.

Nick

Nick

смотря какие задачи, может всеравно пользователю нужны все эти данные, но то накаждый чих сервис дергаьб а другое выдать ему данные и пусть он их ворочит как хочет не грузя сервак

Nick

Nick

я же в качестве предложения, нельзя всегда быть однобоким, иногда есть смысл чтото делать не так как принято

Nick

Nick

вот те же 10к строк - это же детские размеры данных по современным меркам и единственно гед будет актуально какието телодвижения - мобильный интернет

Іван 🤙

Іван 🤙

Ребят, подскажите как лучше:

работать с датой монги Date()

или просто стрингой писать дату , которая будет генерится внутри проги (python) ?

я так понимаю, что если поле будет одинаково у нескольких документов, (выборка по дате), то впринципи без разницы(всм. делать так как удобней)

или есть разница(в скорости например)?

yopp

yopp

ну хотите в монге, хотите в приложении. главное не в виде строки, а ввиде объекта который сериализуется в BSON тип UTC datetime.

Val

Val

тут выше писали что $group $unwind крайне дорого, а что юзать если есть тонна данных с сенсоров и нужно получить выборку средних значений?

Val

Val

$project еще не юзал, а как в нем сгруппировать данные по значениям? еще и посчитать среднее по вложенным значениям без $unwind

Val

Val

вообще насколько хорошая идея юзать монгу для timeseries данных? они вроде как сами форсят использование на эту тему, но где то видел весьма критичную статью

yopp

yopp

монгу для timeseries можно использовать, но для этого надо очень аккуратно проектировать документы, под чтение

Val

Val

{

sensor: { type: SchemaTypes.ObjectId, ref: "Sensor", required: true },

timestampMinute: Date,

name: { type: String, required: true },

values: [{ date: Date, value: Number }]

}

Serj

Serj

Ребят, подскажите как лучше:

работать с датой монги Date()

или просто стрингой писать дату , которая будет генерится внутри проги (python) ?

я так понимаю, что если поле будет одинаково у нескольких документов, (выборка по дате), то впринципи без разницы(всм. делать так как удобней)

или есть разница(в скорости например)?

Храни дату всегда в ISO формате. Для обработки используй moment.js

Val

Val

$unwind values по ним считаю среднее для минуты, дальше группирую данные уже по нужным промежуткам и считаю среднее для него

rdcm

rdcm

всем привет, сейчас пишу нагрузочные тесты для приложения с mongodb (net core)

С# mongo driver - 2.5.0

mongodb - 4.0.4 (single instance / mongodb atlas repl set)

под нагрузкой часть http запросов падает по таймауту монги (crud на БД)

эксепшон:

https://pastebin.com/g5gHf61U

кофигурация инстанса не имеет значения, реплика сет или сингл инстанс

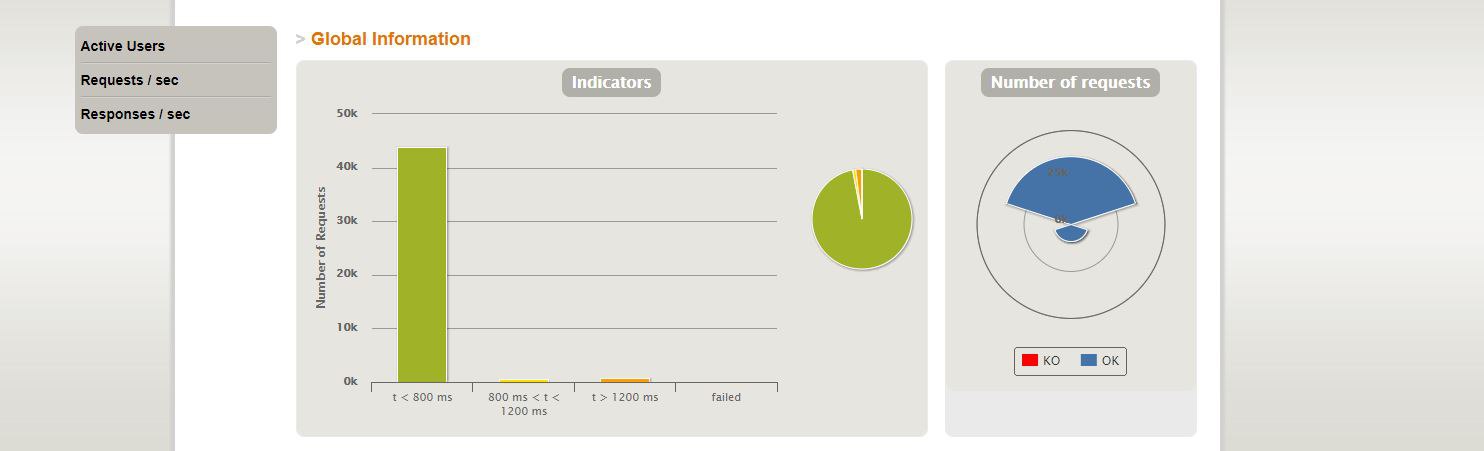

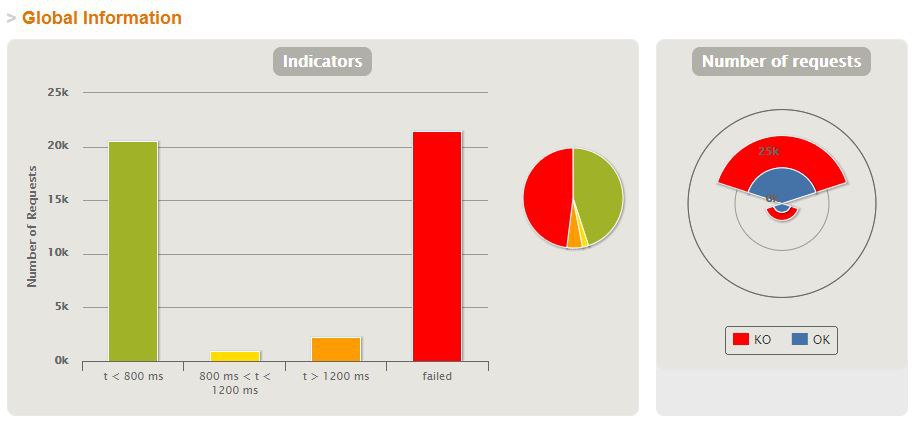

Viktor

Viktor

Viktor

Viktor

всем привет, сейчас пишу нагрузочные тесты для приложения с mongodb (net core)

С# mongo driver - 2.5.0

mongodb - 4.0.4 (single instance / mongodb atlas repl set)

под нагрузкой часть http запросов падает по таймауту монги (crud на БД)

эксепшон:

https://pastebin.com/g5gHf61U

кофигурация инстанса не имеет значения, реплика сет или сингл инстанс

Еще такой эксепшен вылетает, когда коннект до базы обрывается

rdcm

rdcm

на счет пула не уверен, проблема была и в mongodb atlas, при 50 коннектах

на счет драйвера согласен, постепенно рефакторю легаси код

rdcm

rdcm

Еще такой эксепшен вылетает, когда коннект до базы обрывается

знаю, но это только под нагрузкой такое поведение, базу данных приложенме видит

Viktor

Viktor

тогда отлетали бы http запросы а не crud в бд

>Сеть тогда?

Есть простой вариант проверить?)

Побомбить монгу напрямую разве что

rdcm

rdcm

нет, обычный коннекшн, даже без basic authentication, для тестирования

прод через TLS от mongodb atlas

rdcm

rdcm

docker образ с монгой

CPU 3.38%

RAM USAGE/LIMIT 294.1MiB / 992.2MiB

NET I/O 545MB / 4.84MB

BLOCK I/O 785MB / 702

логи самой монги

end connection host:port (312 connections now open)

end connection host:port (311 connections now open)

end connection host:port (310 connections now open)

end connection host:port (309 connections now open)

end connection host:port (308 connections now open)после прогона тестов, количество коннектов уменьшается,

на сколько я помню, лимит пула примерно в 300 соединений

yopp

yopp

что просиходит с ресурсами нод в k8s мне пока сложно сказать )

судя по вашему описанию, проблема у вас только с gce. ваше исключение о том, что драйвер не смог выбрать из топологии ни одного сервера за 30с, а это значит что все обнаруженные клиентом сервера недоступы.

вероятнее всего вы упёрлись в какие-то ресурсы или как выше сказали, к вашим контейнерам применили какие-то ограничения

Anonymous

Anonymous

привет. Нужен совет. Некоторое время назад понадобилось добавить в документ поле, рассчитываемое при запросах. Благополучно заткнул костылём на бэкенде. Но теперь понадобилось осуществлять поиск и фильтрацию по этому полю. Поле меняется раз в сутки. Есть какие-нибудь возможности адекватно реализовать такой функционал?

Daniil

Daniil

Сделать его хранимым, а когда обновляется - обновлять? В вычисляемых полях нет ничего костыльного

Anonymous

Anonymous

Сделать его хранимым, а когда обновляется - обновлять? В вычисляемых полях нет ничего костыльного

обновление раз в сутки будет для всех записей. Их пока около 900, планируется рост, но не космический. Я бы мог написать скрипт для перебора и апдейта раз в сутки, но правильно ли это?

V

V

ребят а кто-то сравнивал, mongo и firestore(Google cloud)?

Вообще можно ли как-то объективно сказать что надо брать mongo, чем какое-то cloud решение

Nick

Nick

привет. Нужен совет. Некоторое время назад понадобилось добавить в документ поле, рассчитываемое при запросах. Благополучно заткнул костылём на бэкенде. Но теперь понадобилось осуществлять поиск и фильтрацию по этому полю. Поле меняется раз в сутки. Есть какие-нибудь возможности адекватно реализовать такой функционал?

а почему оно меняется раз в сутки? оно строится на данных в документе или тянет доп данные еще откудато?

Anonymous

Anonymous

а почему оно меняется раз в сутки? оно строится на данных в документе или тянет доп данные еще откудато?

Поле считается по текущей дате и датам в полях документа.

Anonymous

Anonymous

и что туда записывается?

Строка, статус события. Нужно для отображения клиенту, прошло оно или нет, или происходит. А теперь по нему надо еще и запрос строить.

Nick

Nick

Строка, статус события. Нужно для отображения клиенту, прошло оно или нет, или происходит. А теперь по нему надо еще и запрос строить.

так почему оно вычислялось? это самое обыкновенное поел со статусом, просто кхарните ег ои изменяйте тогда когда начинается обработка

yopp

yopp

ребят а кто-то сравнивал, mongo и firestore(Google cloud)?

Вообще можно ли как-то объективно сказать что надо брать mongo, чем какое-то cloud решение

для сравнения сначала необходимо определитсья с параметрами :)

Nick

Nick

информация то должна актуальной быть. "Начинается обработка" - какая обработка?

ну вот вы говорите "Нужно для отображения клиенту, прошло оно или нет, или происходит. " вот это ваше "проиходит" в чем заключается?

V

V

для сравнения сначала необходимо определитсья с параметрами :)

параметры чего? что ты имеешь ввиду?

Anonymous

Anonymous

ну вот вы говорите "Нужно для отображения клиенту, прошло оно или нет, или происходит. " вот это ваше "проиходит" в чем заключается?

Диапазон дат. если сегодняшнее число внутри диапазона, то статус "происходит"

Nick

Nick

Диапазон дат. если сегодняшнее число внутри диапазона, то статус "происходит"

и в чем проблема сделать запрос покрывающий ваши задачи? диапазоны дат вполне себе обычный критерий для фильтраций

yopp

yopp

все эти тесты производительности обычно натягивают котов на глобус, потому что не учитывают специфику или паттерны конкретного хранилища

Vadim

Vadim

Bro

Bro