Arseniy

Arseniy

или даже - озу

Ну, ОЗУ с ЕСС, а проблема только с одним пулом. Есть ещё 3 пула, но справедливости ради, они действительно подключены к другим контроллерам....

Alexey

Alexey

Ну, ОЗУ с ЕСС, а проблема только с одним пулом. Есть ещё 3 пула, но справедливости ради, они действительно подключены к другим контроллерам....

поменяйте диски между контроллерами. Только к подозрительному не подключайте диски с другого пула. Вдруг он действительно вышел из строя...

George

George

Ну, ОЗУ с ЕСС, а проблема только с одним пулом. Есть ещё 3 пула, но справедливости ради, они действительно подключены к другим контроллерам....

Dmesg то пустой? 99% контроллер тогда, если других действий с пулом параллельно не было (снапы)

Arseniy

Arseniy

Dmesg то пустой? 99% контроллер тогда, если других действий с пулом параллельно не было (снапы)

Не пустой, но там ошибки по битому ssd. По указанному выше пулу ничего. Да, похоже на контроллер!

Попробую диски подкинуть в другой контроллер и сделать scrub. По результатам отпишусь. Всем спасибо за помощь!)

Arseniy

Arseniy

Предварительно, виноват контроллер. К сожалению, пока возможности проверить контроллер нет. Остаюсь так. Заказываю новый, ставлю. С этим буду разбираться в опытной сборке для экспериментов.

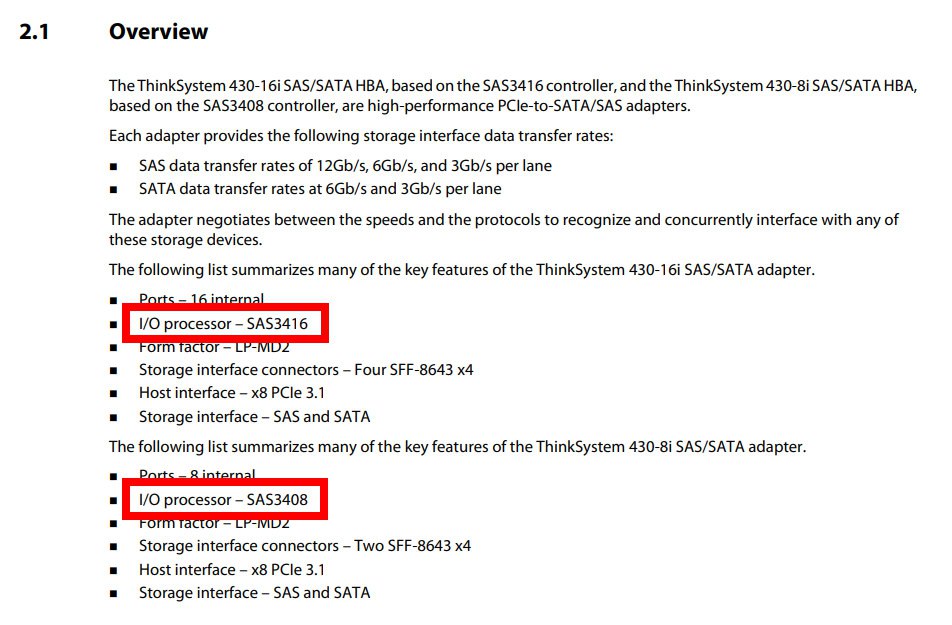

Кстати, вопрос не совсем по теме, но вдруг: какой HBA-контроллер порекомендуете сейчас для подключения 16 sata? LSI-9300, LSI-9400, LSI-9500?

И не смог понять разницу между LSI-430 и LSI-9300

https://aliexpress.ru/item/1005007448936708.html?sku_id=12000040796998412&spm=a2g2w.productlist.search_results.3.6d6369a43dg9Vz

https://aliexpress.ru/item/1005008943477032.html?sku_id=12000047297724556&srcSns=sns_More&businessType=ProductDetail&spreadType=socialShare&tt=MG&utm_medium=sharing

Чтоб не флудить по железу, можно ответить в ЛС или в SDS_Flood. Спасибо

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

░▒▓

░▒▓

Предварительно, виноват контроллер. К сожалению, пока возможности проверить контроллер нет. Остаюсь так. Заказываю новый, ставлю. С этим буду разбираться в опытной сборке для экспериментов.

Кстати, вопрос не совсем по теме, но вдруг: какой HBA-контроллер порекомендуете сейчас для подключения 16 sata? LSI-9300, LSI-9400, LSI-9500?

И не смог понять разницу между LSI-430 и LSI-9300

https://aliexpress.ru/item/1005007448936708.html?sku_id=12000040796998412&spm=a2g2w.productlist.search_results.3.6d6369a43dg9Vz

https://aliexpress.ru/item/1005008943477032.html?sku_id=12000047297724556&srcSns=sns_More&businessType=ProductDetail&spreadType=socialShare&tt=MG&utm_medium=sharing

Чтоб не флудить по железу, можно ответить в ЛС или в SDS_Flood. Спасибо

Nikita

Nikita

А у вас как прогресс?)

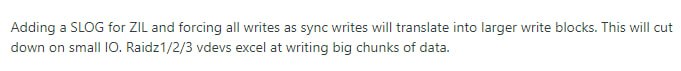

увеличил время синка и уменьшил recordsize, немного помогает

пытаюсь оптимизировать нагрузку, чтобы не писало кучу мелких файлов.

пока не очень понятно, что можно затюнить в syslog-ng, для оптимизации записи в zfs

Alexander

Alexander

Добрый день, не подскажите лучшие настройки для Intel Optane 1600x, 118Gb, я его буду использовать под базу данных медиа серверов Plex, Emby, Jellyfin, а proxmox, в инернете удалось найти такой список параметров, они подойдут или можно что-нибудь изменить?

zpool create -o ashift=12 -O compression=lz4 -O atime=off -O xattr=sa -O recordsize=8k tank /dev/nvme0n1

Vladislav

Vladislav

Arseniy

Arseniy

Господа, какие, на ваш взгляд, могут быть предпосылки, чтобы raidz1 внезапно сразу по всем 3 дискам оказался с ошибками?

Проблема решена. Причина - перегрев контроллера. Сервер домашний, переехал в более холодное помещение, из-за чего вентиляторы передней панели стали работать максимум на 30% оборотов, хотя раньше в среднем работали на 70%.

Есть 5 пулов, и только этот единственный пул был подключен всеми дисками к этому контроллеру. Т.к. у остальных пулов (зеркала) было подключено только по 1 диску, во время scrub ошибки устранялись.

Поставил дополнительный обдув контроллера и проблема ушла.

Free

Free

Да, интересно было бы еще посмотреть размеры после удаления одного из снапов.

Но суммарно два снапа должны были бы как раз все изменения учесть?

Вот за пару месяцев повторил подобное.

Состояние с двумя снапшотами:

root@S08 ~# zfs list; date

NAME USED AVAIL REFER MOUNTPOINT

t4.6s 3.14T 385G 96K /t4.6s

t4.6s/331 3.09T 385G 1.98T /t4.6s/331

t4.6s/331@000 64.5G - 2.11T -

t4.6s/331@001 68.1G - 2.12T -

t4.6s/empty 96K 435G 96K /t4.6s/empty

Удаляю второй:

root@S08 ~# zfs destroy t4.6s/331@001

root@S08 ~# zfs list; date 130

NAME USED AVAIL REFER MOUNTPOINT

t4.6s 3.13T 387G 96K /t4.6s

t4.6s/331 3.02T 387G 1.98T /t4.6s/331

t4.6s/331@000 1.04T - 2.11T -

t4.6s/empty 96K 437G 96K /t4.6s/empty

Затем первый

root@S08 ~# zfs destroy t4.6s/331@000

root@S08 ~# zfs list; date

t4.6s 3.01T 516G 96K /t4.6s

t4.6s/331 1.98T 516G 1.98T /t4.6s/331

t4.6s/empty 96K 566G 96K /t4.6s/empty

После того, как прочистились все метаданные - окончательное свободное место увеличилось на 1ТБ+

root@S08 ~# zfs list; date

NAME USED AVAIL REFER MOUNTPOINT

t4.6s 2.04T 1.47T 96K /t4.6s

t4.6s/331 1.99T 1.47T 1.99T /t4.6s/331

t4.6s/empty 96K 1.52T 96K /t4.6s/empty

Из интересного: REFER при этом и каждого из снапшотов, и одного из них (после удаления второго) - 2.11T

Okhsunrog

Okhsunrog

Есть тут пользователи Arch Linux? Хочу поделиться установщиком, который сейчас активно разрабатываю, может, кому пригодится

https://github.com/okhsunrog/archinstall_zfs

Denis

Denis

Denis

Denis

Есть тут пользователи Arch Linux? Хочу поделиться установщиком, который сейчас активно разрабатываю, может, кому пригодится

https://github.com/okhsunrog/archinstall_zfs

ZFSBootMenu и ядро на zfs разделе? Красота :)

Okhsunrog

Okhsunrog

ZFSBootMenu и ядро на zfs разделе? Красота :)

Ага)

ещё поддержка нескольких Boot Environments.

Можно ставить несколько операционных систем в один пул, и они не будут мешать друг другу

добавил для этого такую вещь

https://github.com/okhsunrog/archinstall_zfs/blob/main/archinstall_zfs/assets/zed/history_event-zfs-list-cacher.sh

Okhsunrog

Okhsunrog

т.е. у меня сейчас на компе:

❯ zfs list

NAME USED AVAIL REFER MOUNTPOINT

novafs 964G 505G 192K none

novafs/arch0 519G 505G 192K none

novafs/arch0/data 367G 505G 192K none

novafs/arch0/data/home 367G 505G 278G /home

novafs/arch0/data/root 40.3M 505G 36.3M /root

novafs/arch0/root 134G 505G 121G /

novafs/arch0/vm 18.8G 505G 18.8G /vm

novafs/archold 227G 505G 192K none

novafs/archold/data 143G 505G 192K none

novafs/archold/data/home 141G 505G 119G /home

novafs/archold/data/root 1.81G 505G 1.81G /root

novafs/archold/root 83.7G 505G 83.7G /

novafs/temp_home 123G 505G 62.0G /mnt/temp_home

novafs/tmp_zfs 7.08G 505G 7.08G /tmp_zfs

novafs/tmp_zfs_home 87.3G 505G 87.3G /home/okhsunrog/tmp_zfs

когда загружаюсь в arch0 - он монтирует свои датасеты, когда загружаюсь в archold - он тоже, только свои монтирует

Okhsunrog

Okhsunrog

У меня там много интересных решений. Есть сборщик образов, как тестовых минимальных, так и полных, с нужным ядром, dkms либо с готовыми модулями из archzfs. Сборка образов как вручную, так и автоматическая при релизе.

Есть валидация совместимости версии zfs и linux, защита от дурака. Чтобы пользователь не смог поставить Linux 6.16 и zfs-dkms вместе

Sergei

Sergei

У меня там много интересных решений. Есть сборщик образов, как тестовых минимальных, так и полных, с нужным ядром, dkms либо с готовыми модулями из archzfs. Сборка образов как вручную, так и автоматическая при релизе.

Есть валидация совместимости версии zfs и linux, защита от дурака. Чтобы пользователь не смог поставить Linux 6.16 и zfs-dkms вместе

что только люди не придумают, лишь бы не пользоваться готовым в NixOS )

Ubsefor

Ubsefor

что только люди не придумают, лишь бы не пользоваться готовым в NixOS )

Вот кому-то делать нечего

Андрей🧛

Андрей🧛

Alexander

Alexander

Коллеженьки, привет, ST20000NM007D подойдет для zfs? характеристики смотрел, там вроде CMR

Я здесь смотрю https://nascompares.com/answer/list-of-wd-cmr-and-smr-hard-drives-hdd/

Eugen

Eugen

Привет, вопрос может показаться странным, но прошу отнестись с пониманием)

Если создать пул stripe с ramdisk-а и ssd. В теории это повысит производительность на запись? (О том что пулл сгинет после ребута сервера не писать, это не важно в этом случаи).

Fedor

Fedor

Либо сразу рамдиск, если места хватит. Зфс работает как правило со скоростью самого медленного диска (ребят, поправьте, пожалуйста, если ошибаюсь)

Vladislav

Vladislav

Либо сразу рамдиск, если места хватит. Зфс работает как правило со скоростью самого медленного диска (ребят, поправьте, пожалуйста, если ошибаюсь)

А вот тут вопрос интересный. Я знаю что отдельные реализации (аппаратные насколько я помню так делают) просто отправляют команды туда где нет сейчас активной записи, а вот как в ZFS это реализовано вопрос хороший

жюн

жюн

В страйпе скорость, вродь как - ~сумма скоростей, но самый медленный диск будет, конечно, тянуть вниз

жюн

жюн

https://www.openoid.net/demonstrating-zfs-pool-write-distribution/?utm_source=chatgpt.com

Вот древность какая-то от 2017

Мужик пишет, что на распределение записей влияет только свободное место на vdev'ах

Vladislav

Vladislav

У меня почему-то ощущение, что ZFS всё равно пишет страйпом и ждёт пока весь страйп закончит писаться

жюн

жюн

Это можно в теории проверить на ВМ-ах ограничив одному из дисков количество IOPS

Да ну излишне, бахнуть файлами - один на диски, один в tmp

Eugen

Eugen

Либо сразу рамдиск, если места хватит. Зфс работает как правило со скоростью самого медленного диска (ребят, поправьте, пожалуйста, если ошибаюсь)

Та в том и дело что нужно место под временные файлы (iscsi диски) много. Сейчас я использую ramdisk, но места не хватает, вот думаю как быть)

Eugen

Eugen

До этого использовал просто zfs тюненый, и в принципе было ок. Но если можно максимально ускорить то было бы отлично)

жюн

жюн

Чтож такое за временные файлы, что их так много и вот обязательно надо записать, но можно и потерять...

sexst

sexst

sexst

sexst

Если без шуток - я такую задачу для виде кэша метрик кучи миллионов портов коммутаторов делал. В итоге плюнул и жахнул zram диск

George

George

Привет, вопрос может показаться странным, но прошу отнестись с пониманием)

Если создать пул stripe с ramdisk-а и ssd. В теории это повысит производительность на запись? (О том что пулл сгинет после ребута сервера не писать, это не важно в этом случаи).

Sync=disabled и txg_timeout=300 к примеру. Если хочется "ускорить" запись

Eugen

Eugen

Чтож такое за временные файлы, что их так много и вот обязательно надо записать, но можно и потерять...

Клоны дисков iscsi с виндой, на них клиенты сидят, всякое делают. Но сохранность данных при этом не нужна при перезагрке клиента или сервера. При этом оригинал диска лежит на ssd без таких эстримов

Станислав

Станислав

Либо сразу рамдиск, если места хватит. Зфс работает как правило со скоростью самого медленного диска (ребят, поправьте, пожалуйста, если ошибаюсь)

Это в случае зеркала, а для страйпа действуют те же правила, как в любой другой реализации RAID0. Только в нашем случае есть просадка на вычисление и запись меты.

Станислав

Станислав

А вот тут вопрос интересный. Я знаю что отдельные реализации (аппаратные насколько я помню так делают) просто отправляют команды туда где нет сейчас активной записи, а вот как в ZFS это реализовано вопрос хороший

Георгий Меликов писал уже тут в чате, что есть хитрый алгоритм на запись. Если верно помню, алгоритм за основу берёт свободное место на диске и его отклик

Станислав

Станислав

В принципе хватает, но всегда хочется большего)

Зачем тогда ZFS, если сохранность вообще не нужна?

Eugen

Eugen

Зачем тогда ZFS, если сохранность вообще не нужна?

Arc очень хорошо помогает, снапшоты и синхронизация.

Eugen

Eugen

Зачем тогда ZFS, если сохранность вообще не нужна?

При чем я же описал, данные есть где сохранность нужна, а есть где не нужна. И там и там zfs по своему помогает.

Fedor

Fedor

В 2.4 rc1

Uncached IO: Direct IO fallback to a light-weight uncached IO when unaligned (#17218)

Это сильно аффектило?

Okhsunrog

Okhsunrog

Denis

Denis

https://habr.com/ru/articles/942396/

Хорошая статья получилось, спасибо. Почитал и тоже перешел с zfs-mount.service на zfs-mount-generator.

Δαρθ

Δαρθ

https://habr.com/ru/articles/942396/

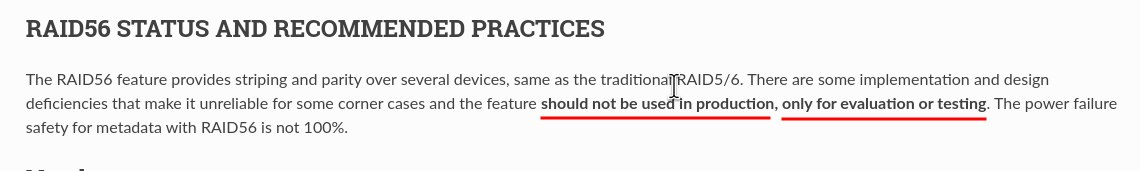

в частях касающихся zfs -- все то же самое и с меньшим гемором может btrfs

ну конечно кроме шифрования на уровне файлов-датасетов

Denis

Denis

в частях касающихся zfs -- все то же самое и с меньшим гемором может btrfs

ну конечно кроме шифрования на уровне файлов-датасетов

c zfs никакого гемороя нет а с btrfs его полно. например рейд бтрфс с шифрованием и ядром на зашифрованном разделе... тут гемороя будет много.

Δαρθ

Δαρθ

c zfs никакого гемороя нет а с btrfs его полно. например рейд бтрфс с шифрованием и ядром на зашифрованном разделе... тут гемороя будет много.

ага ну да. необходимость неестественным способом через левые скрипты в initramfs монтировать zfs это ок и не геморой

George

George

ага ну да. необходимость неестественным способом через левые скрипты в initramfs монтировать zfs это ок и не геморой

Не холивара ради, но уже давно есть соответствующие systemd сервисы которые этим занимаются. Ленивый вариант - zfs-mount-generator

Roman

Roman

Roman

Roman

Denis

Denis

Amix

Amix