mdadm или lvm?

lvm

Dexex

Dexex

lvm

В чем преимущество lvm перед mdadm? Я вот юзал долго mdadm + xfs, очень быстро было. Быстрее ничего нет

Vladislav

Vladislav

В чем преимущество lvm перед mdadm? Я вот юзал долго mdadm + xfs, очень быстро было. Быстрее ничего нет

mdadm ебашит один и тот же блок в метаданных. До момента пока не вольётся патч, которые решает это - lvm быстрее

Vladislav

Vladislav

https://lore.kernel.org/linux-raid/SJ0PR10MB5741D624033B16510F56A525D8C72@SJ0PR10MB5741.namprd10.prod.outlook.com/

Sergey

Sergey

А сделайка Raid0 из одного диска за компанию

Из одного lvm делать не хочет, минимум два

WRITE: bw=125MiB/s (131MB/s), 125MiB/s-125MiB/s (131MB/s-131MB/s), io=7568MiB (7936MB), run=60487-60487msec

raid0 из 24

WRITE: bw=141MiB/s (148MB/s), 141MiB/s-141MiB/s (148MB/s-148MB/s), io=8564MiB (8980MB), run=60773-60773msec

lvdisplay -m

https://pastebin.com/PFX1R1VX

Roman

Roman

Из одного lvm делать не хочет, минимум два

WRITE: bw=125MiB/s (131MB/s), 125MiB/s-125MiB/s (131MB/s-131MB/s), io=7568MiB (7936MB), run=60487-60487msec

raid0 из 24

WRITE: bw=141MiB/s (148MB/s), 141MiB/s-141MiB/s (148MB/s-148MB/s), io=8564MiB (8980MB), run=60773-60773msec

lvdisplay -m

https://pastebin.com/PFX1R1VX

Raid0 из 24 дисков - бессмысленное занятие, если не пишешь большими блоками.

Sergey

Sergey

Raid0 из 24 дисков - бессмысленное занятие, если не пишешь большими блоками.

Я склоняюсь к мысли. что тут что-то с железом и, соответственно, вообще всё - бессмысленное занятие

Vladislav

Vladislav

Из одного lvm делать не хочет, минимум два

WRITE: bw=125MiB/s (131MB/s), 125MiB/s-125MiB/s (131MB/s-131MB/s), io=7568MiB (7936MB), run=60487-60487msec

raid0 из 24

WRITE: bw=141MiB/s (148MB/s), 141MiB/s-141MiB/s (148MB/s-148MB/s), io=8564MiB (8980MB), run=60773-60773msec

lvdisplay -m

https://pastebin.com/PFX1R1VX

Не помню таких ограничений, но ладно.

Так, а какая версия ядра и что за ОС?

Sergey

Sergey

Эрм, я немного потерялся сейчас

Будь проклят тот день, когда я сел за баранку этого пылесоса!

Sergey

Sergey

я б сначала глянул cat /proc/cmdline

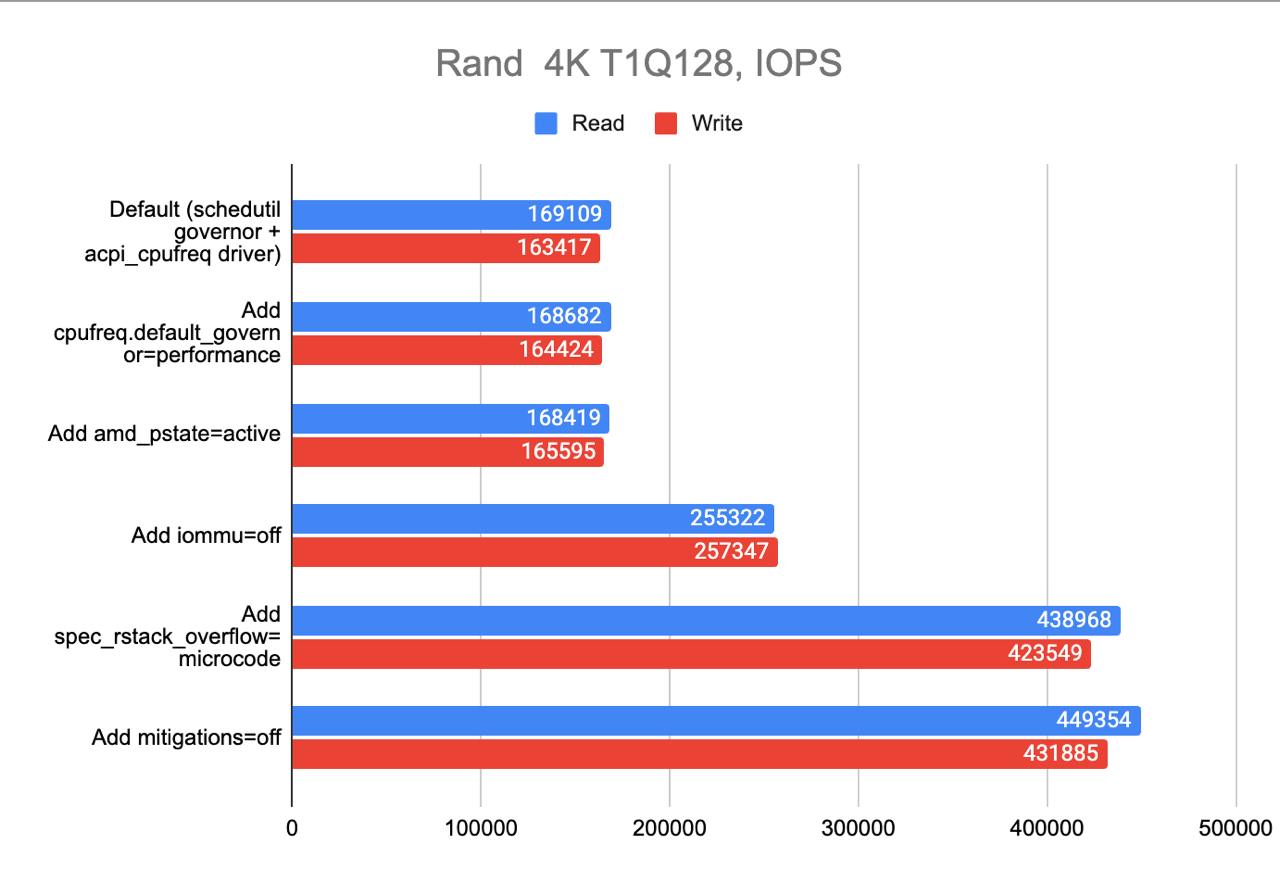

BOOT_IMAGE=/boot/vmlinuz-6.1.0-25-amd64 root=UUID=381d5b7f-9f16-478b-a13b-21f3065f448f ro quiet iommu=off spec_rstack_overflow=microcode mitigations=off

Ivan

Ivan

BOOT_IMAGE=/boot/vmlinuz-6.1.0-25-amd64 root=UUID=381d5b7f-9f16-478b-a13b-21f3065f448f ro quiet iommu=off spec_rstack_overflow=microcode mitigations=off

два параметра сразу указывать нет смысла.

Andrey

Andrey

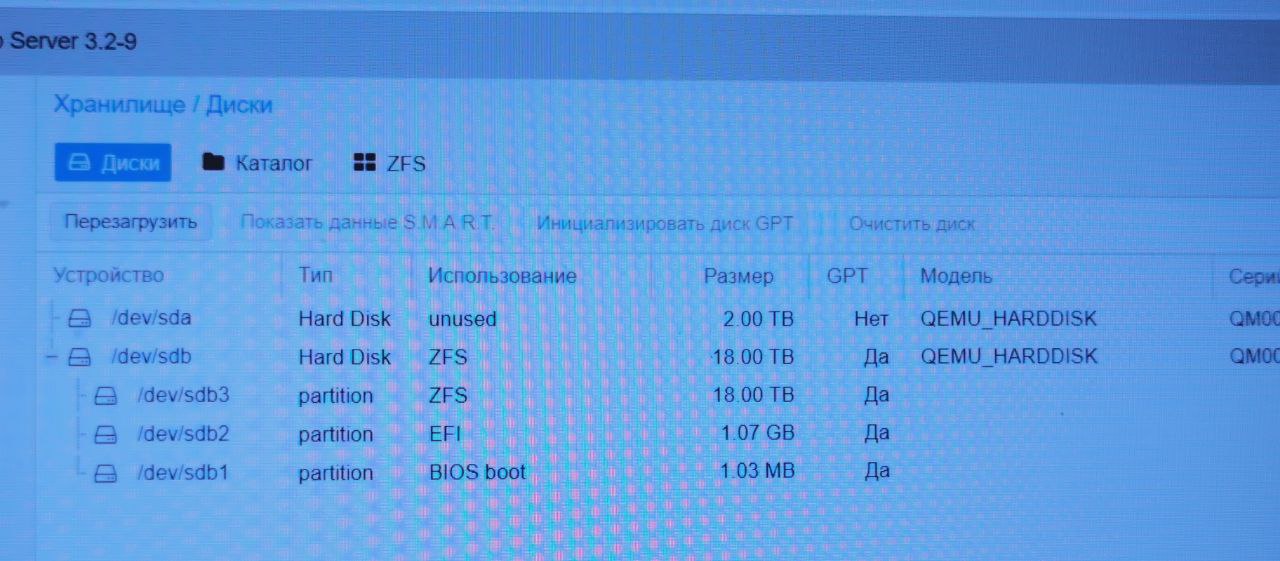

Народ подскажите есть pbs установлен на диск 18 ТБ, на него же делались бэкапы, общий объем 1 ТБ бэкапов есть один rpool, как уменьшить rpool и перенести на другой диск все с диска 18 ТБ и переехать надо на 2ТБ

Vladislav

Vladislav

6.10.11+bpo-amd64

Песня та же, поют те же.

У меня есть только идея смотреть на чём именно такой отклик

Ivan

Ivan

Andrey

Andrey

Был бы благодарен за подробную инструкцию как из большего в меньшие переехать. Когда весь диск из трех разделов boot, boot_esp, rpool и места больше на диске нет.

Andrey

Andrey

Ну сначала я ввёл на pbs в терминале zpool status, получил сообщение No known data errors, увидел название пула и номер раздела где лежит. Потом проверил свободное место dh - f где посмотрел что куда подключено, и попытался выполнить команду zpool replace - f /dev/sdb /dev/sda

Andrey

Andrey

Ну сначала я ввёл на pbs в терминале zpool status, получил сообщение No known data errors, увидел название пула и номер раздела где лежит. Потом проверил свободное место dh - f где посмотрел что куда подключено, и попытался выполнить команду zpool replace - f /dev/sdb /dev/sda

Получил ответ current replece/sdb with /devsda: no such device in pool

Ivan

Ivan

Andrey

Andrey

Короче шутка втом что тут был аппаратный рейд на внешнем устройстве и подключено к usb, я его разобрал и вставил диск в систему чтобы перенести данные. Диск подцепил к виртуалке он подхватился системой и все загрузилось. Колхоз конечно вторая копия лежит отдельно прозвпас.

Vladislav

Vladislav

Короче шутка втом что тут был аппаратный рейд на внешнем устройстве и подключено к usb, я его разобрал и вставил диск в систему чтобы перенести данные. Диск подцепил к виртуалке он подхватился системой и все загрузилось. Колхоз конечно вторая копия лежит отдельно прозвпас.

Ты про USB hdd считыватели, которые имеют опции по построению рейда?

Andrey

Andrey

У меня был внешний бокс с 2мя дисками зеркальный аппаратный рейд подключены по usb 3.2 к виртуальной машине pbs в pve, через проброс usb. Апартаный рейд убрал так как это не правельно, поставил один диск в систему пробросил диск к pbs второй диск пробросил меньшего размера тот на который надо переехать т.е. С 18 ТБ в 2ТБ.

Andrey

Andrey

Вот теперь вопрос мне все операции по переезду делать в pve или в pbs. Так как в pve zfc не подключён.

Andrey

Andrey

Андрей, пожалуйста, сформулируй этот поток сознания в структурированный текст

Что надо сделать необходимо pbs перевезти на диск меньшего размера, если бы это был бы просто отдельный пул не завязаны на прямую с системой pbs я бы переехал такую инструкцию я имею. А вот когда весь диск отдан под ZFS тут проблема, так как увеличить pool можно, а вот уменьшить видимо нет.

Andrey

Andrey

Или мне клонировать загрузочные области добавить ZFS меньшего размера на диске 2TB и просто тупо примонтировать его и все скопировать 🙈

Станислав

Станислав

Печально конечно.

А есть ещё устройство, на которое можно временно скопировать все важные файлы с пула?

По идее можно изворотиться без переустановки, но лучше иметь бэкап

Andrey

Andrey

А есть ещё устройство, на которое можно временно скопировать все важные файлы с пула?

По идее можно изворотиться без переустановки, но лучше иметь бэкап

Так вот я и хочу этот бэкап переместить, странные конечно дела почему в pve можно переносить образы с диска на диск, а в Pbs надо все рушить..Вот нахвпливают ZFS, а с штатными операциям затычки. Ведь всякое может быть, а инструкций толком и нет. Клоны снапшоты, составные устройства, файлы, расширить пожалуйста, а отрезать фиг вам.

Sergey

Sergey

Итак, создай LVM из одного диска

lvcreate -L 2T -n lv01 volgrp01

lvs -o+segtype LV VG Attr LSize Pool Origin Data% Meta% Move Log Cpy%Sync Convert Type data vg_data -wi-a----- 1,00t

WRITE: bw=179MiB/s (188MB/s), 179MiB/s-179MiB/s (188MB/s-188MB/s), io=10.6GiB (11.4GB), run=60670-60670msec

Sergey

Sergey

Итак, создай LVM из одного диска

lvcreate -L 2T -n lv01 volgrp01

Для сравнения - без lvm

WRITE: bw=173MiB/s (181MB/s), 173MiB/s-173MiB/s (181MB/s-181MB/s), io=10.2GiB (11.0GB), run=60654-60654msec

Nikita

Nikita

Так вот я и хочу этот бэкап переместить, странные конечно дела почему в pve можно переносить образы с диска на диск, а в Pbs надо все рушить..Вот нахвпливают ZFS, а с штатными операциям затычки. Ведь всякое может быть, а инструкций толком и нет. Клоны снапшоты, составные устройства, файлы, расширить пожалуйста, а отрезать фиг вам.

ну так размечаете новый диск аналогично старому, создаёте новый zpool делаете снапшот на старом zpool и send/recv его на новый. в чем проблема то?

Сергей

Сергей

Помогите, пожалуйста, решить задачку. Имеется ссд диск с файловой системой zfs и установленным proxmox. Хочу к этому диску теперь добавить еще два и чтобы они были в raidz1. Такое реально провернуть или нужно создавать пул заново?

Ivan

Ivan

Vladislav

Vladislav

Помогите, пожалуйста, решить задачку. Имеется ссд диск с файловой системой zfs и установленным proxmox. Хочу к этому диску теперь добавить еще два и чтобы они были в raidz1. Такое реально провернуть или нужно создавать пул заново?

Пересоздавать учитывая что ты не гуглил.

Гугл бы выдал, что-то в духе

- Создать degraded пул из 2 дисков

- скопировать на него данные

- добавить этот 1 диск вместо missing

Сергей

Сергей

Пересоздавать учитывая что ты не гуглил.

Гугл бы выдал, что-то в духе

- Создать degraded пул из 2 дисков

- скопировать на него данные

- добавить этот 1 диск вместо missing

Да, это я и нагуглил в итоге, но была надежда, что есть варианты попроще 😊. Меня просто маленько смущает, что на этом пуле система находится. Если я правильно понимаю, то после переноса мне нужно будет указывать, что система должна грузиться с нового пула?

Vladislav

Vladislav

Да, это я и нагуглил в итоге, но была надежда, что есть варианты попроще 😊. Меня просто маленько смущает, что на этом пуле система находится. Если я правильно понимаю, то после переноса мне нужно будет указывать, что система должна грузиться с нового пула?

Уф, это ты сильно конечно с рутом на zfs

Да, тебе придется повозиться с fstab + grub

+ воссоздать сперва целиком на zfs разметку как на текущем загрузочном диске

Nikita

Nikita

Да, это я и нагуглил в итоге, но была надежда, что есть варианты попроще 😊. Меня просто маленько смущает, что на этом пуле система находится. Если я правильно понимаю, то после переноса мне нужно будет указывать, что система должна грузиться с нового пула?

Вы точно уверены, что вам нужен рут на raidz?

Сергей

Сергей

Вы точно уверены, что вам нужен рут на raidz?

Если честно, я даже не знаю. Просто имеется три сдд диска вот и решил в raidz их собрать. А что под систему лучше не использовать raidz?

Nikita

Nikita

Если честно, я даже не знаю. Просто имеется три сдд диска вот и решил в raidz их собрать. А что под систему лучше не использовать raidz?

mirror + диск в hot-spare. и в этом случае не нужно ничего переносить.

Сергей

Сергей

mirror + диск в hot-spare. и в этом случае не нужно ничего переносить.

Да, но для меня в данном случае важнее, чтобы объем пула был поболее, поэтому и решил в raidz собрать

Сергей

Сергей

Уф, это ты сильно конечно с рутом на zfs

Да, тебе придется повозиться с fstab + grub

+ воссоздать сперва целиком на zfs разметку как на текущем загрузочном диске

В итоге, все получилось. Конечно, времени я затратил в итоге больше, чем бы я просто переустановил систему. Но было интересно попробовать именно перенос сделать. С самим переносом файловой системы, в принципе, ни чего сложного, относительно быстро разобрался, а вот с загрузкой проксмокса с нового зпула пришлось повозить. При чем у них есть мануалы, как перенести загрузочные области, но нет инфы как заставить подхватывать новый зпул. В итоге вспомнил, что убунту из коробки умеет работать с zfs, загрузился в нее и переименовал пулы. В итоге загрузка пошла с новых дисков.