Fedor

Fedor

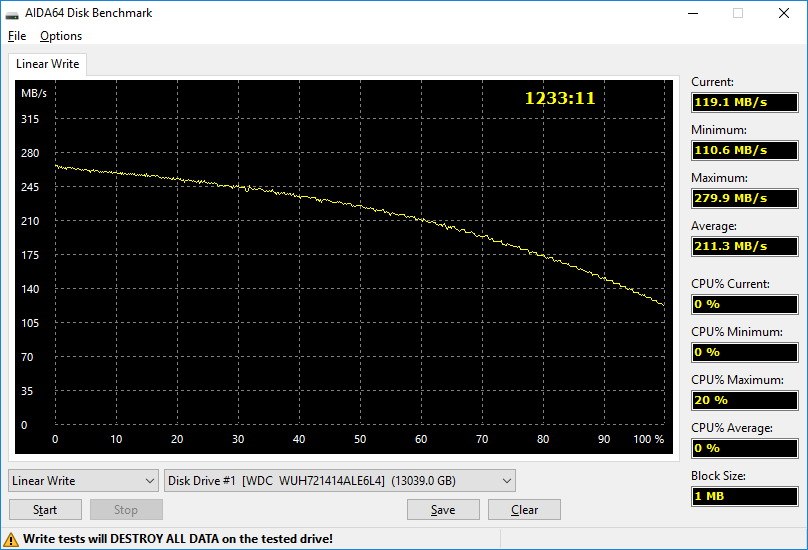

может, по пути где-то узкое место. попробуй локально бенчмарк на запись провести. если это бекапы - то это большие куски данных (линейная запись блоками например по 256-512к)

Fedor

Fedor

теоретически, райд0, линейный, в идеальных условиях - помножить то, что указано в их спецификации, на 24.

в случае с зфс - будет чуть медленнее из-за накладных расходов.

в реальных условиях скорость будет ниже этого числа.

Илья

Илья

Но всё-таки, какую полосу на запись можно выжать из 24 дисков? И в какой конфигурации?

Все зависит от количества vdev

Sergey

Sergey

Sergey

Sergey

в два раза меньше

То есть, в теории должно быть 200*12 = 2400 . А у меня 120. Где-то что-то сильно не так

George

George

а нужен ли в таком кейсе зфс?

на запись zfs как раз может даже делать другие решения, если учесть фрагментацию и рандомную запись

Sergey

Sergey

на запись zfs как раз может даже делать другие решения, если учесть фрагментацию и рандомную запись

Там последовательная запись

George

George

Иопсы не очень интересно, понятно, что из этих дисков много не выжать. Там бэкап будет лежать, мне гораздо интереснее полоса при последовательной записи. Один диск выдает где-то 180МБ\с, а в zfs 12 mirror vdev почему-то 122

один поток на синхронном доступе только 1 vdev может юзать, т.е. 1 mirror

Если убедиться что запись асинхронная, тогда можно выжать хорошо (если озу на dirty write есть)

Sergey

Sergey

один поток на синхронном доступе только 1 vdev может юзать, т.е. 1 mirror

Если убедиться что запись асинхронная, тогда можно выжать хорошо (если озу на dirty write есть)

Даже на один mirror должно быть порядка 200МБ/с

George

George

Даже на один mirror должно быть порядка 200МБ/с

стоит учитывать неравномерность скорости в зависимости от положения сектора на блине, средняя меньше у всех хдд

Sergey

Sergey

George

George

На 40%?

может и больше быть разница https://serverfault.com/questions/193698/which-part-of-of-a-hard-drive-has-the-highest-throughput-beginning-or-end-of-dr

Sergey

Sergey

nlsas это обычный хдд только с другим интерфейсом.

Так я вроде никаких рекордов от них и не требую

Ivan

Ivan

Так я вроде никаких рекордов от них и не требую

значит никаких 200мб/с получиться не может даже в теории

Sergey

Sergey

значит никаких 200мб/с получиться не может даже в теории

Одиночный диск вполне себе может, а в пуле - нет?

Ivan

Ivan

Одиночный диск вполне себе может, а в пуле - нет?

это какой одиночный диск может ? пробовали хотяб гигов 20 записать ?

Sergey

Sergey

WRITE: bw=225MiB/s (236MB/s), 225MiB/s-225MiB/s (236MB/s-236MB/s), io=13.3GiB (14.2GB), run=60274-60274msec

George

George

WRITE: bw=225MiB/s (236MB/s), 225MiB/s-225MiB/s (236MB/s-236MB/s), io=13.3GiB (14.2GB), run=60274-60274msec

попробуйте сделать партицию в конце диска и там потестить, получите быстро результат. Это уже немного сбоку вашего вопроса, но всё же

Sergey

Sergey

один поток на синхронном доступе только 1 vdev может юзать, т.е. 1 mirror

Если убедиться что запись асинхронная, тогда можно выжать хорошо (если озу на dirty write есть)

Один поток

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --size=100G --rw=write

WRITE: bw=126MiB/s (132MB/s), 126MiB/s-126MiB/s (132MB/s-132MB/s), io=7824MiB (8204MB), run=62222-62222msec

4 потока

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --numjobs=4 --size=100G --rw=write

WRITE: bw=239MiB/s (251MB/s), 58.5MiB/s-62.1MiB/s (61.3MB/s-65.1MB/s), io=15.1GiB (16.2GB), run=64390-64503msec

8 потоков

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --numjobs=8 --size=100G --rw=write

WRITE: bw=297MiB/s (311MB/s), 31.2MiB/s-56.1MiB/s (32.7MB/s-58.8MB/s), io=22.6GiB (24.3GB), run=68795-78022msec

Sergey

Sergey

Ivan

Ivan

George

George

Один поток

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --size=100G --rw=write

WRITE: bw=126MiB/s (132MB/s), 126MiB/s-126MiB/s (132MB/s-132MB/s), io=7824MiB (8204MB), run=62222-62222msec

4 потока

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --numjobs=4 --size=100G --rw=write

WRITE: bw=239MiB/s (251MB/s), 58.5MiB/s-62.1MiB/s (61.3MB/s-65.1MB/s), io=15.1GiB (16.2GB), run=64390-64503msec

8 потоков

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --numjobs=8 --size=100G --rw=write

WRITE: bw=297MiB/s (311MB/s), 31.2MiB/s-56.1MiB/s (32.7MB/s-58.8MB/s), io=22.6GiB (24.3GB), run=68795-78022msec

кстати рекомендовал бы с меньшим блоком тестить, в реальности запись всегда меньшим блоком будет, 1M достаточно чтобы имитировать поточку, а бОльшее уже будет доп задержки давать в самом тесте и быстро съедает буферы

Sergey

Sergey

Sergey

Sergey

директ бессмысленен кстати, zfs сейчас его игнорит, иногда с потерей перфа

Ну да, я и с direct=0 тестил, результаты одинаковые

Александр

Александр

Всем привет, прошу подсказать как правильно сделать, есть пул raidz5 . На пуле есть файловая система и том. когда я делаю снапшот файловой системы то я могу его увидеть по пути .zfs/snapshot/, с томом так не получается и даже если я на томе создам файловую систему и примонтирую его там не окажется скрытого каталога .zfs. Не подскажете есть ли какойто способ посмотреть на снапшот не создавая клона.

Станислав

Станислав

Всем привет, прошу подсказать как правильно сделать, есть пул raidz5 . На пуле есть файловая система и том. когда я делаю снапшот файловой системы то я могу его увидеть по пути .zfs/snapshot/, с томом так не получается и даже если я на томе создам файловую систему и примонтирую его там не окажется скрытого каталога .zfs. Не подскажете есть ли какойто способ посмотреть на снапшот не создавая клона.

Конечно не будет там каталога .zfs, это же блочное устройство, а не ФС. И зачем Вам такой каталог? Сравните содержимое данных между клоном и исходным zvol, примонтировав оба. Получите тот же результат, просто немного больше телодвижений

sexst

sexst

Я бы начал с одного несущественного нюанса. А чем вообще эти 24 диска подключены. И что ха диски то?

Vladislav

Vladislav

Один поток

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --size=100G --rw=write

WRITE: bw=126MiB/s (132MB/s), 126MiB/s-126MiB/s (132MB/s-132MB/s), io=7824MiB (8204MB), run=62222-62222msec

4 потока

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --numjobs=4 --size=100G --rw=write

WRITE: bw=239MiB/s (251MB/s), 58.5MiB/s-62.1MiB/s (61.3MB/s-65.1MB/s), io=15.1GiB (16.2GB), run=64390-64503msec

8 потоков

fio --ioengine=libaio --direct=1 --invalidate=1 --name=test --bs=4M --iodepth=32 --numjobs=8 --size=100G --rw=write

WRITE: bw=297MiB/s (311MB/s), 31.2MiB/s-56.1MiB/s (32.7MB/s-58.8MB/s), io=22.6GiB (24.3GB), run=68795-78022msec

Блок на 4МБ? Это какой такой СРК пишет таким блоком? Что ты тестируешь? Сферического коня в вакууме?

Если хочешь красивых циферок

bs=4MB, iodepth=128 numjobs=64

Vladislav

Vladislav

Так я вроде никаких рекордов от них и не требую

Про 1 диск быстрее чем рейд (5/6) из дисков - no shit, Sherlock.

Рейд без динамического страйпа так устроен, что все диски будут ждать самого медленного.

Собирай либо 10-й из 24 дисков, либо 50/60

Ну и да, zfs не про скорость, а про сохранность данных и фичи (снапшоты, zfs send|recv, arc кэш, сжатие)

Vladislav

Vladislav

Да и не вижу я на нем нагрузки

А я не вижу выводов iotop, в частности disk latency и disk busy

Sergey

Sergey

Плюс, вот сейчас про скорость записи, а восстановление из инкремента не важно да?

Важно, ещё как. Но для начала надо бы в окно бэкапа попасть, а с такой скоростью записи не получится

Sergey

Sergey

Блок на 4МБ? Это какой такой СРК пишет таким блоком? Что ты тестируешь? Сферического коня в вакууме?

Если хочешь красивых циферок

bs=4MB, iodepth=128 numjobs=64

Я не тестирую, я сравниваю. Размеры блока я менял, разницы никакой

Sergey

Sergey

Про 1 диск быстрее чем рейд (5/6) из дисков - no shit, Sherlock.

Рейд без динамического страйпа так устроен, что все диски будут ждать самого медленного.

Собирай либо 10-й из 24 дисков, либо 50/60

Ну и да, zfs не про скорость, а про сохранность данных и фичи (снапшоты, zfs send|recv, arc кэш, сжатие)

Смотри внимательно, у меня 10 и собран.

Впрочем, raidz2 4x6 по скорости от него не отличается.

Vladislav

Vladislav

Я не тестирую, я сравниваю. Размеры блока я менял, разницы никакой

Сравнивать в сферическом вакууме затея ахуенная

Vladislav

Vladislav

Важно, ещё как. Но для начала надо бы в окно бэкапа попасть, а с такой скоростью записи не получится

Для начала надо бы данные все предоставить

Sergey

Sergey

Сравнивать в сферическом вакууме затея ахуенная

Начинать с чего-то надо. А если у меня локальное последовательное чтение херню выдает, какой смысл что-то ещё гонять?

Vladislav

Vladislav

Vladislav

Vladislav

Начинать с чего-то надо. А если у меня локальное последовательное чтение херню выдает, какой смысл что-то ещё гонять?

Смысл в том, что делать numjobs выше чем будет конечная как минимум нецелесообразно

У тебя будет 8 одновременных потоков?

Sergey

Sergey

Смысл в том, что делать numjobs выше чем будет конечная как минимум нецелесообразно

У тебя будет 8 одновременных потоков?

Скорее всего, нет. Ну так я и гонял сначала один поток, 4 и 8 потом сделал для полноты картины

Vladislav

Vladislav

Скорее всего, нет. Ну так я и гонял сначала один поток, 4 и 8 потом сделал для полноты картины

Тогда 8 тебе бессмысленны для полноты картины

Sergey

Sergey

Прошивку hba обновил, не изменилось ничего.

Кому интересно было:

Те же диски в mdadm raid10

WRITE: bw=68.9MiB/s (72.3MB/s), 68.9MiB/s-68.9MiB/s (72.3MB/s-72.3MB/s), io=40.4GiB (43.4GB), run=600305-600305msec

lvm

lvcreate --type raid10 -m 1 --nosync -i 12 -L 5T -n data vg_data

lvs -o+segtype

LV VG Attr LSize Pool Origin Data% Meta% Move Log Cpy%Sync Convert Type

data vg_data Rwi-aor--- 5,00t 100,00 raid10

WRITE: bw=42.4MiB/s (44.5MB/s), 42.4MiB/s-42.4MiB/s (44.5MB/s-44.5MB/s), io=24.9GiB (26.7GB), run=600148-600148msec