Vladislav

Vladislav

да, сжатие будет

рекордсайз под разные данные разный

будут бэкапы (куски по 8-128Метров), и образы виртуалок, и просто разные наборы данных

Бэкапы и образы ВМ на одном пуле....

Vladislav

Vladislav

привет

есть 18 дисков 8Tb

понятно, что raidz2 не производительность)

планирую сделать 3 raidz-2 по 6 + SLOG

нагрузка разная - и последовательные чтение, запись и рандомные чтение/запись

есть ли альтернативные варианты, чтобы в производительности особо не терять?

Slog тебе поможет только если у тебя много синхронной записи

Станислав

Станислав

Недавно вопросом задавался, хотел узнать сколько из арк может выдать Epyc 7F52 в 8-канальном режиме. Если не использовать сжатие, то результат был следующим и всё упиралось в производительность ЦП:

root@pc:~# fio fio.ini

write: (g=0): rw=read, bs=(R) 1024KiB-1024KiB, (W) 1024KiB-1024KiB, (T) 1024KiB-1024KiB, ioengine=libaio, iodepth=1

...

fio-3.25

Starting 47 processes

Jobs: 47 (f=47): [R(47)][100.0%][r=82.6GiB/s][r=84.6k IOPS][eta 00m:00s]

write: (groupid=0, jobs=47): err= 0: pid=2380076: Mon Dec 11 00:01:52 2023

read: IOPS=87.3k, BW=85.3GiB/s (91.6GB/s)(853GiB/10003msec)

slat (usec): min=73, max=48881, avg=534.59, stdev=953.43

clat (nsec): min=641, max=16384k, avg=1594.93, stdev=36037.08

lat (usec): min=74, max=48887, avg=536.56, stdev=954.81

clat percentiles (nsec):

|  1.00th=[   764],  5.00th=[   844], 10.00th=[   884], 20.00th=[   932],

| 30.00th=[   980], 40.00th=[  1048], 50.00th=[  1128], 60.00th=[  1240],

| 70.00th=[  1400], 80.00th=[  1656], 90.00th=[  2192], 95.00th=[  2960],

| 99.00th=[  5344], 99.50th=[  6688], 99.90th=[ 11712], 99.95th=[ 15040],

| 99.99th=[136192]

bw (  MiB/s): min=76800, max=95299, per=4.31%, avg=87646.99, stdev=91.81, samples=893

iops        : min=76790, max=95287, avg=87642.89, stdev=91.84, samples=893

lat (nsec)   : 750=0.62%, 1000=31.41%

lat (usec)   : 2=55.57%, 4=10.09%, 10=2.17%, 20=0.13%, 50=0.01%

lat (usec)   : 100=0.01%, 250=0.01%, 500=0.01%, 750=0.01%, 1000=0.01%

lat (msec)   : 2=0.01%, 4=0.01%, 10=0.01%, 20=0.01%

cpu          : usr=0.52%, sys=59.95%, ctx=257025, majf=0, minf=39045

IO depths    : 1=100.0%, 2=0.0%, 4=0.0%, 8=0.0%, 16=0.0%, 32=0.0%, >=64=0.0%

submit    : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

complete  : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

issued rwts: total=873364,0,0,0 short=0,0,0,0 dropped=0,0,0,0

latency   : target=0, window=0, percentile=100.00%, depth=1

Run status group 0 (all jobs):

READ: bw=85.3GiB/s (91.6GB/s), 85.3GiB/s-85.3GiB/s (91.6GB/s-91.6GB/s), io=853GiB (916GB), run=10003-10003msec

Немного улучшил результат))

root@pc:~# fio fio.ini

read: (g=0): rw=read, bs=(R) 1024KiB-1024KiB, (W) 1024KiB-1024KiB, (T) 1024KiB-1024KiB, ioengine=libaio, iodepth=1

...

fio-3.33

Starting 47 processes

Jobs: 47 (f=47): [R(47)][100.0%][r=114GiB/s][r=117k IOPS][eta 00m:00s]

read: (groupid=0, jobs=47): err= 0: pid=697790: Sun Oct 27 18:18:21 2024

read: IOPS=118k, BW=115GiB/s (123GB/s)(1150GiB/10003msec)

slat (usec): min=73, max=18246, avg=396.84, stdev=132.93

clat (nsec): min=701, max=872763, avg=1239.62, stdev=2386.86

lat (usec): min=74, max=18250, avg=398.08, stdev=133.20

clat percentiles (nsec):

| 1.00th=[ 804], 5.00th=[ 900], 10.00th=[ 940], 20.00th=[ 980],

| 30.00th=[ 1012], 40.00th=[ 1048], 50.00th=[ 1096], 60.00th=[ 1128],

| 70.00th=[ 1176], 80.00th=[ 1240], 90.00th=[ 1416], 95.00th=[ 1848],

| 99.00th=[ 4576], 99.50th=[ 5344], 99.90th=[ 6752], 99.95th=[11072],

| 99.99th=[55040]

bw ( MiB/s): min=116280, max=120621, per=100.00%, avg=117818.08, stdev=22.16, samples=893

iops : min=116278, max=120618, avg=117817.89, stdev=22.15, samples=893

lat (nsec) : 750=0.04%, 1000=23.78%

lat (usec) : 2=71.94%, 4=2.79%, 10=1.40%, 20=0.03%, 50=0.01%

lat (usec) : 100=0.01%, 250=0.01%, 500=0.01%, 750=0.01%, 1000=0.01%

cpu : usr=0.58%, sys=50.43%, ctx=1017304, majf=0, minf=12514

IO depths : 1=100.0%, 2=0.0%, 4=0.0%, 8=0.0%, 16=0.0%, 32=0.0%, >=64=0.0%

submit : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

complete : 0=0.0%, 4=100.0%, 8=0.0%, 16=0.0%, 32=0.0%, 64=0.0%, >=64=0.0%

issued rwts: total=1177162,0,0,0 short=0,0,0,0 dropped=0,0,0,0

latency : target=0, window=0, percentile=100.00%, depth=1

Run status group 0 (all jobs):

READ: bw=115GiB/s (123GB/s), 115GiB/s-115GiB/s (123GB/s-123GB/s), io=1150GiB (1234GB), run=10003-10003msec

Станислав

Станислав

@DanteAvalon sysbench тоже результат стал лучше показывать. Раньше был чуть больше 20Gib/s, а сейчас 70. Но это всё равно меньше положенного (180Gib/s). Не ясно что у него не так с замером, если даже ARC быстрее

Vladislav

Vladislav

😊Ɛѵցҽղìվ

😊Ɛѵցҽղìվ

Ребят, нужна помощь.

Я убил систему, теперь с неё загрузиться не могу. Удалил папки boot, dev и root.

В общем теперь единственный рабочий Proxmox на zraid2, но он не видит мои виртуальные машины, которые расположены на других 4х SSD дисках в таком же zraid2.

Помогите примотировать

Dmitry

Dmitry

Привет!

В пуле tank было 2 датасета - tank/data и tank/data/own

tank/data - зашифрован паролем.

Ранее я расшифровывал tank/data и получал доступ, получается и к tank/data/own.

После zfs send -R | zfs receive -F теперь и использования уже копии - требуется вводить пароль для обоих датасетов.

Может ли кто-нибудь объяснить - почему это так?

Как вернуть расшифровку, чтобы было как ранее - вводить пароль только для одного (внешнего) датасета?

Ivan

Ivan

Коллеги, добрый день. Скажите, может у кого-то был опыт работы с ZFS на SSD дисках? Меня интересует просто общее впечатление. Понятно что производительность там хорошая по IOPs, а вот по выживанию самих дисков, как дело обстоит?

Ivan

Ivan

Я просто подумываю о сборке основного сервера на SSD для нужд студии, но некоторые отдельные люди меня отговаривают, мол быстро диски сыпятся в случае ZFS на SSD.

Станислав

Станислав

Коллеги, добрый день. Скажите, может у кого-то был опыт работы с ZFS на SSD дисках? Меня интересует просто общее впечатление. Понятно что производительность там хорошая по IOPs, а вот по выживанию самих дисков, как дело обстоит?

Если диски энтерпрайз, то, как по мне, без разницы что там за ФС.

Georg🎞️🎥

Georg🎞️🎥

Станислав

Станислав

Я просто подумываю о сборке основного сервера на SSD для нужд студии, но некоторые отдельные люди меня отговаривают, мол быстро диски сыпятся в случае ZFS на SSD.

Домыслы и только. Сколько ТБ в год писать нужно?

Ivan

Ivan

Я просто подумываю о сборке основного сервера на SSD для нужд студии, но некоторые отдельные люди меня отговаривают, мол быстро диски сыпятся в случае ZFS на SSD.

у zfs конечно write amplification выше ext4, но на енетрпрайзных ссд лет 5 под бд у людей диски не сыпятся. под файлопомойку может лет 15 будут жить.

Илья

Илья

Я просто подумываю о сборке основного сервера на SSD для нужд студии, но некоторые отдельные люди меня отговаривают, мол быстро диски сыпятся в случае ZFS на SSD.

Ссд только Энтерпрайз, обычные ссд сата, быстро деградируют, процент жизни под нагрузкой падает на глазах

Станислав

Станислав

Честно говоря количество записи перезаписи в год сложно прикинуть. Думаю речь о петабайтах

Вот пример, это за 2 года. Диски самсумги с 1 DTBW на объемом 3.84Тб

SMART/Health Information (NVMe Log 0x02)

Critical Warning: 0x00

Temperature: 30 Celsius

Available Spare: 100%

Available Spare Threshold: 10%

Percentage Used: 4%

Data Units Read: 135,856,990 [69.5 TB]

Data Units Written: 1,865,021,902 [954 TB]

Host Read Commands: 5,546,973,421

Host Write Commands: 117,527,711,538

Controller Busy Time: 53,482

Power Cycles: 2

Power On Hours: 19,103

Unsafe Shutdowns: 0

Media and Data Integrity Errors: 0

Error Information Log Entries: 0

Warning Comp. Temperature Time: 0

Critical Comp. Temperature Time: 0

Temperature Sensor 1: 30 Celsius

Temperature Sensor 2: 39 Celsius

Nikita

Nikita

В общем я понял, что в целом это домыслы. Главное брать нормальное Энтерпрайз железо

с такими объёмами вам бы в сторону Optane смотреть...

Vladislav

Vladislav

Я просто подумываю о сборке основного сервера на SSD для нужд студии, но некоторые отдельные люди меня отговаривают, мол быстро диски сыпятся в случае ZFS на SSD.

Конечно. Если брать SSD Netac 4к рублей за 4ТБ, то можно потом долго удивляться

Vladislav

Vladislav

Честно говоря количество записи перезаписи в год сложно прикинуть. Думаю речь о петабайтах

Ну посмотрите сколько сейчас было записано за год, у вас же сейчас куда-то это всё пишется

Ivan

Ivan

Ну посмотрите сколько сейчас было записано за год, у вас же сейчас куда-то это всё пишется

А как это можно посмотреть? Если честно, никогда данную статистику не поднимал, а соответственно не знаю как это делается

Vladislav

Vladislav

Vladislav

Vladislav

Шарик, а ты кто )) ? Давай каждый будет решать сам, когда и кто будет включаться. Это дело сугубо добровольное, и уж точно не тебе распределять роли тут.

И вообще @ialebedev, ты же читал умную книжку

Ivan

Ivan

И говорил, что выше нас смертных для помощи коммьюнити

Думаю, что буду не далёк от истины, если скажу, что никогда подобного не говорил, поэтому не нужно наговаривать. И уж точно никогда не был замечен тут и обвинен в высокомерии. Чего нельзя сказать про вас.

Dexex

Dexex

Единственная претензия к zfs осталась это скорость. По прежнему mdadm+xfs самое быстрое что есть.

Станислав

Станислав

Конечно. Если брать SSD Netac 4к рублей за 4ТБ, то можно потом долго удивляться

Мне недавно доказывали, что Seagate FireCuda 520 лучшее решение на m.2 и надежнее чем samsung 983. Т.к. ресурс заявлен у сигейта 1800TBW на 1Тб, а у самсунга поганого, который заявлен как DC накопитель, ресурс меньше заявлен, всего 1366TBW на 960Гб. Самосунг плохой потому, что обманывает, позиционируя себя как DC, но ресурс низкий.

В процессе обсуждения выяснилось несколько деталей про сигейт:

1) В даташите на сигейт указано, что, при исчерпании ресурса на 95%, накопитель перейдет в режим только для чтения. То есть уже тут соврали про ресурс;

2) Он установлен на "высоконагруженный проект" и ресурс уже исчерпан на 80%. А 80% это как бы уже больше, чем гарантированный ресурс у самсунга. Вот только если внимательно посмотреть на параметр записанных данных, то там цифра гораздо скромнее - 583Тб, что составляет ~32%, но никак не 80%;

3) Накопитель заявлен как игровой, а не серверный, потому, почти как у всех, есть SLC кэш. Но реализован он интересно! Треть от свободной емкости накопителя используется под кэш. Если накопитель заполнить, то кэша будет совсем мало, а за его пределами скорость составляет менее 600мб/с. Про падение IOPS даже думать страшно)) Если что, у упомянутого самсунга 2000мб/с на всём объеме накопителя.

Самый важный вопрос по второго пункту. А всё дело в WAF - коэффициенте записи на SSD, определение которого в сигейт дали в своём даташите и написали, что идеально, когда он равен единице:

WAF: Write Amplification Factor (WAF) is a numerical value representing the ratio between the amount of data that a

SSD controller needs to write and the amount of data that the host’s flash controller writes. A better WAF, which is near

1, guarantees better endurance and lower frequency of data written to flash memory

Т.е., если посчитать:

80% / 32%=~2.5 - вот такой получается WAF

А если судить из смарта самунга, который я выложить чуть выше (правда это не 983 модель), то WAF вообще меньше единицы)))

К тому же у корпоративных накопителей, как правило, есть PLP и другие преимущества.

Так что я бы сказал, что не только NETAC не стоит брать в прод, но вообще домашние накопители.

Fedor

Fedor

@neurox может и сюда антиспам бота добавить?

пока посмотрю, как он работает, а то вдруг будет удалять каждое второе :)

Animal

Animal

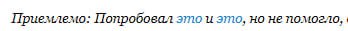

Всем привет. Можете меня послать )) но вдруг кто знает дело в настройках ZFS или что... коросе есть макОС Сонома хочу подключить с другой машины расшаренный по самбе ZFS датасет к Time Machine но получаю ошибку "The selected network backup disk does not support the required capability". Просто как папка все подключается видется пишется/читается с макОС но именно чето ей не хватает каких-то фишек. Прочитал что возможно надо поиграться с некоторыми опциями ZFS но чот пока результата нет. С Самбой уже игрался...но это другая уже песня, хотя если кто настраивал недавно или знает рабочий вариант/гайд/манул я бы подсмотрел )) Т.к. тоже пробовал разные варианты, но безрезультатно. Прочитал можно прям zvol замутить и в нейтивную для МасОС ФС отдать но чот меня такой варик не устраивает пока....

Vladislav

Vladislav

Vladislav

Vladislav

Fedor

Fedor

Можно почитать, что за капабилити нужны, и плясать уже от этого. zfs полностью позиксовая, насколько мне известно. Может, выбранный способ экспорта не совсем подходит.

Animal

Animal

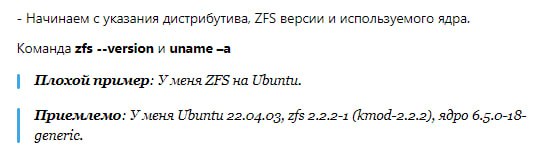

zfs --version

zfs-2.2.2-0ubuntu9.1

zfs-kmod-2.2.2-0ubuntu9

uname -a

Linux 6.8.0-47-generic #47-Ubuntu SMP PREEMPT_DYNAMIC Fri Sep 27 21:40:26 UTC 2024 x86_64 x86_64 x86_64 GNU/Linux

Vladislav

Vladislav

Animal

Animal

Можно почитать, что за капабилити нужны, и плясать уже от этого. zfs полностью позиксовая, насколько мне известно. Может, выбранный способ экспорта не совсем подходит.

Не эксперт )) потому и спрашиваю. Даже не могу понять куда копать в ZFS или в самбу. Ес что самба 4.19

Animal

Animal

Ivan

Ivan

Animal

Animal

Мы не телепаты, чтобы понимать что ты пробовал

я понимаю. потому и спросил мб кто недано настраивал по какому гайду и получилось.

Vladislav

Vladislav

я понимаю. потому и спросил мб кто недано настраивал по какому гайду и получилось.

Экспортни через самбу не ZFS

Animal

Animal

думаю дело в самбе

Вот тут чел пишет что как раз сонома у него и куда бэкапить на ЗФС, сделал 1 в 1 но увы...

https://blog.al4.co.nz/2024/04/samba-config-for-apple-time-machine/

Vladislav

Vladislav

поищу...мб что на ext4 найдется

В смысле? Просто пошарь рандомную папку и проверь начинается процесс или нет

Fedor

Fedor

Fedor

Fedor

хорошо помнить, что не защищенные шифрованием данные могут быть побиты по пути - чексумма у crc32 довольно небольшого размера, и это повреждение может оказаться незамеченным

Animal

Animal

скажу так, всё отлично работает

тут скорее всего дело в настройках самбы

В принципе очень вероятно. Просто вычитал что если не самба то мб ЗФС. потому и решил тут воду помутить ))

Fedor

Fedor

смотри капабилити, требующиеся для тайм машины. проблема, скорее всего, не связана с зфс. она может быть связана только, если и в тайммашине и в самбе включен весь набор нужных капабилити и это проверено на другой файловой системе. тогда надо смотреть, почему в зцс этой капабилити нет

Fedor

Fedor

по настройке линуксовых сервисов и по интеграциям этих линуксовых сервисов с программными продуктами мы тут помочь не сможем, слишком сильный оффтоп.

Animal

Animal

по настройке линуксовых сервисов и по интеграциям этих линуксовых сервисов с программными продуктами мы тут помочь не сможем, слишком сильный оффтоп.

яя зер гуд. спасибо. пойду дальше искать ))

Δαρθ

Δαρθ

хорошо помнить, что не защищенные шифрованием данные могут быть побиты по пути - чексумма у crc32 довольно небольшого размера, и это повреждение может оказаться незамеченным

Ну смотря как побиты. Если 1 бит флипнется, то црц (любое) гарантирует детект. Если 2 и более бита -- до какого-то макс размера защищённого црц блока (зависит от конкретного алго ЦРЦ). если массивные повреждения/etc -- 2**(-n) вероятнось false negative

Fedor

Fedor

Ну смотря как побиты. Если 1 бит флипнется, то црц (любое) гарантирует детект. Если 2 и более бита -- до какого-то макс размера защищённого црц блока (зависит от конкретного алго ЦРЦ). если массивные повреждения/etc -- 2**(-n) вероятнось false negative

факт есть факт, наблюдал неоднократно при перекачке очень большого количества данных

central

central