Почему в гугл?

Потому что здесь есть такие товарищи, которые, если не отчитаться о том, что удалось нагуглить и самому это попробовать, вообще разговаривать отказываются 😜

Vladislav

Vladislav

Потому что здесь есть такие товарищи, которые, если не отчитаться о том, что удалось нагуглить и самому это попробовать, вообще разговаривать отказываются 😜

Только в dmesg есть то, что надо гуглить

Free

Free

Ладно, это флуд уже.

Какая разница, в каком порядке что я делал, зачем это обсуждать.

Сам разобрался, сам исправил, здесь на всякий случай сообщил, дальше буду issue оформлять.

Δαρθ

Δαρθ

[глупый вопрос] степень фрагментации пула на который делают zfs recv, зависит от скорости заливки? Типа 100мб/c или 10мб/c или 1мб/c

Алексей

Алексей

[глупый вопрос] степень фрагментации пула на который делают zfs recv, зависит от скорости заливки? Типа 100мб/c или 10мб/c или 1мб/c

мне кажется что не зависит (разве что в этот же пул параллельно идет файловый ввод-вывод)

Δαρθ

Δαρθ

мне кажется что не зависит (разве что в этот же пул параллельно идет файловый ввод-вывод)

нет, запись идёт только с заливки

Никита

Никита

Народ, есть сервер маленький на 2 HDD с ZFS, там прокс крутится и ещё по мелочи, я купил и поставил в него ssd, могу я как то штатно склонить всё добро с hdd на ssd?

Айтуар

Айтуар

Народ, есть сервер маленький на 2 HDD с ZFS, там прокс крутится и ещё по мелочи, я купил и поставил в него ssd, могу я как то штатно склонить всё добро с hdd на ssd?

Вы хотите заменить hdd на ssd? Тогда просто сделаете штатный replace для дисков по одному. Если просто скопировать на ssd информацию, то rsync или что-то похожее в помощь.

Никита

Никита

Вы хотите заменить hdd на ssd? Тогда просто сделаете штатный replace для дисков по одному. Если просто скопировать на ssd информацию, то rsync или что-то похожее в помощь.

Не совсем, я хочу оставить старый пул, но сделать так что бы ось запускалась с ssd

Айтуар

Айтуар

Не совсем, я хочу оставить старый пул, но сделать так что бы ось запускалась с ssd

Тогда если размеры позволяют, возможно dd .

Roman

Roman

Никита

Никита

можешь онлайн переехать.

Ну вот я в идеале и хотел онлайн это провернуть с 1 коротким ребутом. zfs clone какой нибудь поможет?

Ivan

Ivan

Не совсем, я хочу оставить старый пул, но сделать так что бы ось запускалась с ssd

от оси на ssd виртуалки быстрее работать не станут

Никита

Никита

от оси на ssd виртуалки быстрее работать не станут

Большинству моих виртуалок индифферентно на ssd они или на hdd. Но вот то что когда i\o delay 50% и выше то начинает тупить хост и вешать некоторые виртуалки меня сильно раздражает

Никита

Никита

Вот я и хочу хостовую ос и пару дисков вм скинуть на ssd, + подрубить ещё одно зеркало из дополнительных ssd для zil и l2arc к текущему пулу

Δαρθ

Δαρθ

Кстати у ZFS ту прогресс обнаружил. Давным-давно когда переливал датасет с одного локального пула на другой, второй датасет после перелива по хардкору маунтился в то же место куда и источник, с поломкой всего в линуксе (невозможно отмаунтить ни один, ребут). Щяс по умолчанию в таком случае приёмник не маунтится.

Алексей

Алексей

Кстати у ZFS ту прогресс обнаружил. Давным-давно когда переливал датасет с одного локального пула на другой, второй датасет после перелива по хардкору маунтился в то же место куда и источник, с поломкой всего в линуксе (невозможно отмаунтить ни один, ребут). Щяс по умолчанию в таком случае приёмник не маунтится.

Это в какой это версии не монтируется

Roman

Roman

Ну вот я в идеале и хотел онлайн это провернуть с 1 коротким ребутом. zfs clone какой нибудь поможет?

Если тебе просто перенести часть дисков, то новый пул и встроенные средства для миграции вм у прокса.

Никита

Никита

Если тебе просто перенести часть дисков, то новый пул и встроенные средства для миграции вм у прокса.

Это да, у меня гвоздь в том, что ОС прокса стоит на этому пуле, а так как этот прокс ещё является первым сервером в кластере я пока ищу варианты как сделать так, чтоб его не переустанавливать

Vladislav

Vladislav

Если тебе просто перенести часть дисков, то новый пул и встроенные средства для миграции вм у прокса.

Как я понял он хочет перенести сам прокс

Никита

Никита

И у прокса нет понятия "первый сервер". Ему пофигу с какого управление идёт.

хз, я как то одну ноду переустанавливал и потом 3 часа пытался разобраться что за фигня творится с corosync и сертификатами ssh. Опыт полезный и интересный конечно, но малость травматичный

Δαρθ

Δαρθ

Выглядит как брехня

Как баг выглядело когда монтировалось в то же место где уже источник замонтирован

Алексей

Алексей

Как баг выглядело когда монтировалось в то же место где уже источник замонтирован

Внутри одного хоста?

Алексей

Алексей

Надо посмотреть какая у меня версия но я обычно между пулами внутри хоста лью поэтому коллизий не замечал

Δαρθ

Δαρθ

Есть подозрение что у тебя маунтпоинт указан вручную на датасете

Ессно указан вручную, как ещё-то?

Никита

Никита

А вот такой вопрос возник, Если я психану и просто переустановлю прокс на ssd, у меня /ROOT продолжит монтироваться старый ? Ну тот который в zfs сейчас

Δαρθ

Δαρθ

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2023.08.21 | pv >/dev/null

^C04MiB 0:00:02 [ 201MiB/s] [ <=> ]

^[[A

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2023.10.11 | pv >/dev/null

^C11MiB 0:00:02 [ 122MiB/s] [ <=> ]

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2023.12.23 | pv >/dev/null

^C,9MiB 0:00:01 [14,8MiB/s] [ <=> ]

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2024.02.24 | pv >/dev/null

^C32MiB 0:00:02 [ 134MiB/s] [ <=> ]

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2024.05.04 | pv >/dev/null

^C60MiB 0:00:02 [ 155MiB/s] [ <=> ]

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2024.08.25 | pv >/dev/null

^C04MiB 0:00:02 [ 173MiB/s] [ <=> ]

nedoserver:~$ zfs send -L -I @2023.08.21 home_pool/qemu_zvol@2024.08.25 | pv >/dev/null

cannot hold: permission denied

cannot send 'home_pool/qemu_zvol': permission denied

не бага ли это случайно?

Maxim

Maxim

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2023.08.21 | pv >/dev/null

^C04MiB 0:00:02 [ 201MiB/s] [ <=> ]

^[[A

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2023.10.11 | pv >/dev/null

^C11MiB 0:00:02 [ 122MiB/s] [ <=> ]

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2023.12.23 | pv >/dev/null

^C,9MiB 0:00:01 [14,8MiB/s] [ <=> ]

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2024.02.24 | pv >/dev/null

^C32MiB 0:00:02 [ 134MiB/s] [ <=> ]

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2024.05.04 | pv >/dev/null

^C60MiB 0:00:02 [ 155MiB/s] [ <=> ]

nedoserver:~$ zfs send -L home_pool/qemu_zvol@2024.08.25 | pv >/dev/null

^C04MiB 0:00:02 [ 173MiB/s] [ <=> ]

nedoserver:~$ zfs send -L -I @2023.08.21 home_pool/qemu_zvol@2024.08.25 | pv >/dev/null

cannot hold: permission denied

cannot send 'home_pool/qemu_zvol': permission denied

не бага ли это случайно?

а не должно быть

zfs send -L -I home_pool/qemu_zvol@2023.08.21 @2024.08.25

или вообще

zfs send -L -I home_pool/qemu_zvol@2023.08.21 home_pool/qemu_zvol@2024.08.25

?

Δαρθ

Δαρθ

а не должно быть

zfs send -L -I home_pool/qemu_zvol@2023.08.21 @2024.08.25

или вообще

zfs send -L -I home_pool/qemu_zvol@2023.08.21 home_pool/qemu_zvol@2024.08.25

?

-I @a fs@d

is similar to -i @a

fs@b;

-i

@b

fs@c;

-i

@c

fs@d. The incremental source may be specified as

with the -i option.

из доки

Vladislav

Vladislav

https://www.youtube.com/watch?v=wpHAk-y9wMs

и второе видео

https://www.youtube.com/watch?v=kriWtQAfDIQ

Oleg

Oleg

Всем привет, прошу подсказать как правильно сделать, есть массив raidz2 и и массив mirror(точнее будет созданан это  массив). Маасив з2 примонтирован с определенным именем точки монтирования ( на это  путь опирается часть програм при доступе к своим данным и конфигам). Так же на з2 домашн е каталоги части пользователей. Мне нужно перенести данные с з2 на зеркало, желательно так что бы для ПО, пользователей и сетевых доступов все прошло прозрачно. Подсказали использовать zfs send | zfs receive для копирования. Я не сильно силен в zfs.

Nikita

Nikita

Всем привет, прошу подсказать как правильно сделать, есть массив raidz2 и и массив mirror(точнее будет созданан это  массив). Маасив з2 примонтирован с определенным именем точки монтирования ( на это  путь опирается часть програм при доступе к своим данным и конфигам). Так же на з2 домашн е каталоги части пользователей. Мне нужно перенести данные с з2 на зеркало, желательно так что бы для ПО, пользователей и сетевых доступов все прошло прозрачно. Подсказали использовать zfs send | zfs receive для копирования. Я не сильно силен в zfs.

Правильно подсказали. На этапе перемонтирования всё равно останавливать сервисы придется. Но за счет инкрементных снапшотов время простоя можно свести к минимуму, необходимому на отправку последних изменений, когда сервисы уже остановлены будут. Потом отмонтируете старые фс, новым задаёте соответствующие пути и стартуете. Почитайте ман про снапшоты и их отправку. Этот процесс можно автоматизировать, я использую zxfer, тут часто рекомендуют sanoid.

Oleg

Oleg

Правильно подсказали. На этапе перемонтирования всё равно останавливать сервисы придется. Но за счет инкрементных снапшотов время простоя можно свести к минимуму, необходимому на отправку последних изменений, когда сервисы уже остановлены будут. Потом отмонтируете старые фс, новым задаёте соответствующие пути и стартуете. Почитайте ман про снапшоты и их отправку. Этот процесс можно автоматизировать, я использую zxfer, тут часто рекомендуют sanoid.

В моем случае простой не критичен. Спсибо почитаю почитаю, в целом принцип их действия понятен (пртменяю потрасписанию на случай если данные повредятся). Првильно я понимаю что я сначало создаю зеркало и не монтируя его указываю как цель для востанлвления снпшета?

Maxim

Maxim

Всем привет, прошу подсказать как правильно сделать, есть массив raidz2 и и массив mirror(точнее будет созданан это  массив). Маасив з2 примонтирован с определенным именем точки монтирования ( на это  путь опирается часть програм при доступе к своим данным и конфигам). Так же на з2 домашн е каталоги части пользователей. Мне нужно перенести данные с з2 на зеркало, желательно так что бы для ПО, пользователей и сетевых доступов все прошло прозрачно. Подсказали использовать zfs send | zfs receive для копирования. Я не сильно силен в zfs.

обкатай на стенде

есть пара нюансов: send/receive работают с субволюмами (если я термины не перепутал)

в целевой субволюм между ресивами не должно происходить НИКАКОЙ записи, иначе очередной receive тебя пошлёт

Nikita

Nikita

обкатай на стенде

есть пара нюансов: send/receive работают с субволюмами (если я термины не перепутал)

в целевой субволюм между ресивами не должно происходить НИКАКОЙ записи, иначе очередной receive тебя пошлёт

в zfs, насколько я помню, то что вы называете субвольюмами может быть ФС или блочным устройством(zvol). При этом ФС - всё, что не zvol - и вложенные ФС для создания структуры(например с zvol внутри), и ФС с данными. Но в сути вы правы, изменение на целевой для реплицирования ФС или zvol приведёт к ошибке инкрементной отправки следующего снимка.

Maxim

Maxim

в zfs, насколько я помню, то что вы называете субвольюмами может быть ФС или блочным устройством(zvol). При этом ФС - всё, что не zvol - и вложенные ФС для создания структуры(например с zvol внутри), и ФС с данными. Но в сути вы правы, изменение на целевой для реплицирования ФС или zvol приведёт к ошибке инкрементной отправки следующего снимка.

нет, я не про zvol

а, ну да, всё верно

я про те штуки, у которых у каждой отдельная точка монтирования

Станислав

Станислав

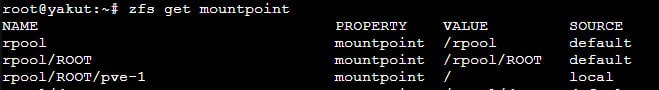

При операции receive можно изменить параметры датасета или zvol. В подобных случаях, когда нужно сохранить точку монтирования, я делаю:

zfs recv -o canmount=no new-pool/new-dataset

После этого отмонтирую предыдущее место хранения и монтирую новое:

zfs unmount old-pool/old-dataset

zfs set canmount=yes new-pool/new-dataset

Станислав

Станислав

Можно проверить, что датасет примонтировался:

zfs get mounted,mountpoint new-pool/new-dataset

Δαρθ

Δαρθ

обкатай на стенде

есть пара нюансов: send/receive работают с субволюмами (если я термины не перепутал)

в целевой субволюм между ресивами не должно происходить НИКАКОЙ записи, иначе очередной receive тебя пошлёт

Там просто прошёлся вычитав все файлы -- приёмник уже от снапшота разъехался

Δαρθ

Δαρθ

Maxim

Maxim

Там просто прошёлся вычитав все файлы -- приёмник уже от снапшота разъехался

я про это и говорил

кажется, даже cd туда делать нельзя, хотя, возможно, это зависит от настроек (типа noatime)

https://t.me/ru_zfs/78327

Δαρθ

Δαρθ

я про это и говорил

кажется, даже cd туда делать нельзя, хотя, возможно, это зависит от настроек (типа noatime)

https://t.me/ru_zfs/78327

noatime ессно стоит всегда и везде. не помогает.

Andrey

Andrey

zfs recv -F pool/dataset

Со снапшота делаешь клон и читаешь или пишешь в него(я так бд клоны поднимаю уже лет 10)-ничего не разъезжается

Δαρθ

Δαρθ

zfs recv -F pool/dataset

Со снапшота делаешь клон и читаешь или пишешь в него(я так бд клоны поднимаю уже лет 10)-ничего не разъезжается

Ну как бы лично у меня возмущение, почему когда ТОЛЬКО читаешь причём только снапшот -- разъезжается. И у меня не БД, у меня просто файлопомойка, которая только читается (на стороне recv)

Δαρθ

Δαρθ

А клон если читать-разъезжается?

Клон ясное дело что нет, хотя я не проверял. Это лишняя операция для меня, сделать клон, потом ещё удалять его )

Станислав

Станислав

на бекапных винтах постоянно приходится из-за этого ролбеки делать

Так же ерунда. Изначально забыл отключить на вышестоящий датасете atime, теперь голову морочит каждый раз. Что интересно, если изначально на вышестоящем было отклонено, то уже бы нормально работает

Δαρθ

Δαρθ

Так же ерунда. Изначально забыл отключить на вышестоящий датасете atime, теперь голову морочит каждый раз. Что интересно, если изначально на вышестоящем было отклонено, то уже бы нормально работает

ну не та же. у меня атайм отключен всегда и везде )

Oleg

Oleg

Правильно подсказали. На этапе перемонтирования всё равно останавливать сервисы придется. Но за счет инкрементных снапшотов время простоя можно свести к минимуму, необходимому на отправку последних изменений, когда сервисы уже остановлены будут. Потом отмонтируете старые фс, новым задаёте соответствующие пути и стартуете. Почитайте ман про снапшоты и их отправку. Этот процесс можно автоматизировать, я использую zxfer, тут часто рекомендуют sanoid.

Запустилось только с ключем -F, запускал на тестовой виртуалке, единственно что смущает что 11гб данных переносилось несколько часов с ссд на ссд, это нормально по скорости?