Всем привет! версия зфс 2.1.12, ядро 6,1,44. Скорее всего этот вопрос больше на гитхаб, но может быть тут быстрее ответят если я что то упустил, создаю пул и добавляю к нему диск l2cache, делаю экспорт этого пула, создаю второй пул и пытаюсь добавить тот же диск в l2cache, он успешно добавляется и если после этого импортировать первый пул, то он импортируется и у l2cache диска будет статус FAULTED.

я пробовал использовать апи зфс и вызвал функцию zpool_in_use() на этот диск в тот момент когда он привязан к первому пулу и пул экспортирован, и он пишет что диск не занят, хотя в это же время если вызвать zpool_read_label(), то он вернёт 4 метки, то есть видит их. судя по коду, зфс не может достать из l2cache свойство vdev_tree и считает что диск свободен. такая же история и с запасными. это баг или так и задумано? разве не должно быть безусловного возврата занятости диска если zpool_read_label() вернул какие то метки зфс?

@gmelikov может быть вы знаете

Vasily

Vasily

Александр

Александр

Приветствую, с чего вы решили что L2ARC можно использовать в двух пулах?

в этом и вопрос, почему зфс позволяет это сделать

Илья

Илья

в этом и вопрос, почему зфс позволяет это сделать

Потому что вы первый пул отключили, и из тех дисков можно снова новый собирать

Александр

Александр

Потому что вы первый пул отключили, и из тех дисков можно снова новый собирать

но зфс не позволяет брать диски например из состава основных или же из slog

Илья

Илья

но зфс не позволяет брать диски например из состава основных или же из slog

Что значит не позволяет?

Александр

Александр

Что значит не позволяет?

ну то есть если взять мой пример, создаю пул, экспортирую этот пул, и хочу создать пул из дисков первого пула, то он напишет что они заняты

George

George

Всем привет! версия зфс 2.1.12, ядро 6,1,44. Скорее всего этот вопрос больше на гитхаб, но может быть тут быстрее ответят если я что то упустил, создаю пул и добавляю к нему диск l2cache, делаю экспорт этого пула, создаю второй пул и пытаюсь добавить тот же диск в l2cache, он успешно добавляется и если после этого импортировать первый пул, то он импортируется и у l2cache диска будет статус FAULTED.

я пробовал использовать апи зфс и вызвал функцию zpool_in_use() на этот диск в тот момент когда он привязан к первому пулу и пул экспортирован, и он пишет что диск не занят, хотя в это же время если вызвать zpool_read_label(), то он вернёт 4 метки, то есть видит их. судя по коду, зфс не может достать из l2cache свойство vdev_tree и считает что диск свободен. такая же история и с запасными. это баг или так и задумано? разве не должно быть безусловного возврата занятости диска если zpool_read_label() вернул какие то метки зфс?

L2arc сейчас между пулами шарить нельзя, но вроде были мысли такое позволить. Что не ругается - скорее баг

Александр

Александр

Илья

Илья

Илья

Илья

Может в курсе, не знаете , ведутся ли работы по оптимизации работы с 4к блоком , уж слишком мало iops

George

George

Может в курсе, не знаете , ведутся ли работы по оптимизации работы с 4к блоком , уж слишком мало iops

Вопрос слишком широкий, из перформанса есть патч для поддержки directio, меньше копирований памяти на nvme жизнь могут улучшить, но это уже кейс когда диски сильно быстрые

Станислав

Станислав

Вопрос слишком широкий, из перформанса есть патч для поддержки directio, меньше копирований памяти на nvme жизнь могут улучшить, но это уже кейс когда диски сильно быстрые

Подскажите, пожалуйста, что значит "меньше копий памяти"?

Uncel

Uncel

Может в курсе, не знаете , ведутся ли работы по оптимизации работы с 4к блоком , уж слишком мало iops

Люди пытались и забили, основные грабли это тусовочка из ixsystems

George

George

Люди пытались и забили, основные грабли это тусовочка из ixsystems

Ты прям негативишь)

вообще кстати со времён 2.0 было оч много патчей на перформанс, особенно Александр Мотин много этим занимался

Еvgeniy

Еvgeniy

приветы

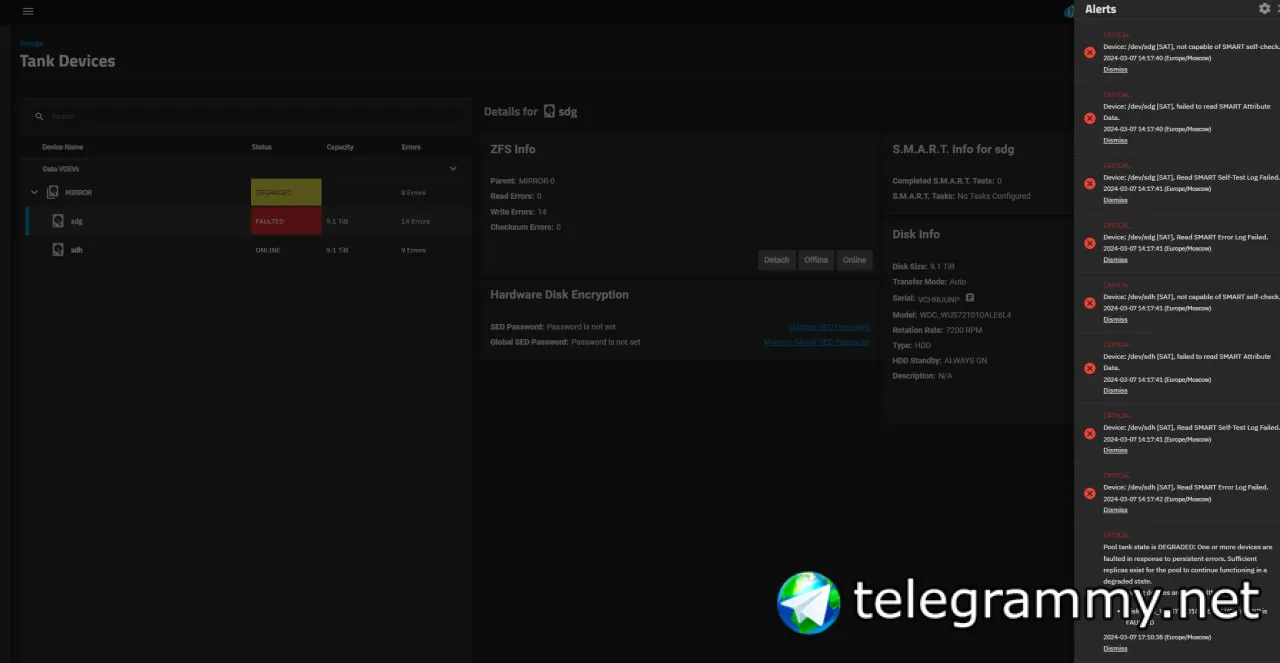

не встречалось ли такое

на массиве zfs сыпет ошибками чтения/записи/контрольных сумм

взял пару дисков неновых, сыпало ошибки на один диск, поменял, стало сыпать ошибки на тот диск, который вчера был без ошибок совсем

Fedor

Fedor

В виртуализации вообще опасно зфс запускать, есть много мест по пути от вм до физического диска, где что-то может начать ломаться.

Fedor

Fedor

И можно рулесы почитать, там есть несколько полезных команд, которые могут пригодиться - так же в пастебин

Еvgeniy

Еvgeniy

Поделитесь что ли знаниями с коммьюнити

повреждены были снапшоты, виртуалка не стартовала, диск не отмонтировались...

решено через vmdk - вручную внутри поправил кто кому родитель, потом прогнал через vmkfstools -i disk-00001.vmdk disk-new.vmdk

получил результирующий диск. который по содержимому равен тому, что было в последнем снапшоте

этот диск и примонтировал лк новой виртуалке как dedup устройство, массив импортировался

Vladislav

Vladislav

повреждены были снапшоты, виртуалка не стартовала, диск не отмонтировались...

решено через vmdk - вручную внутри поправил кто кому родитель, потом прогнал через vmkfstools -i disk-00001.vmdk disk-new.vmdk

получил результирующий диск. который по содержимому равен тому, что было в последнем снапшоте

этот диск и примонтировал лк новой виртуалке как dedup устройство, массив импортировался

То есть со стороны вари решили проблему, окей

Еvgeniy

Еvgeniy

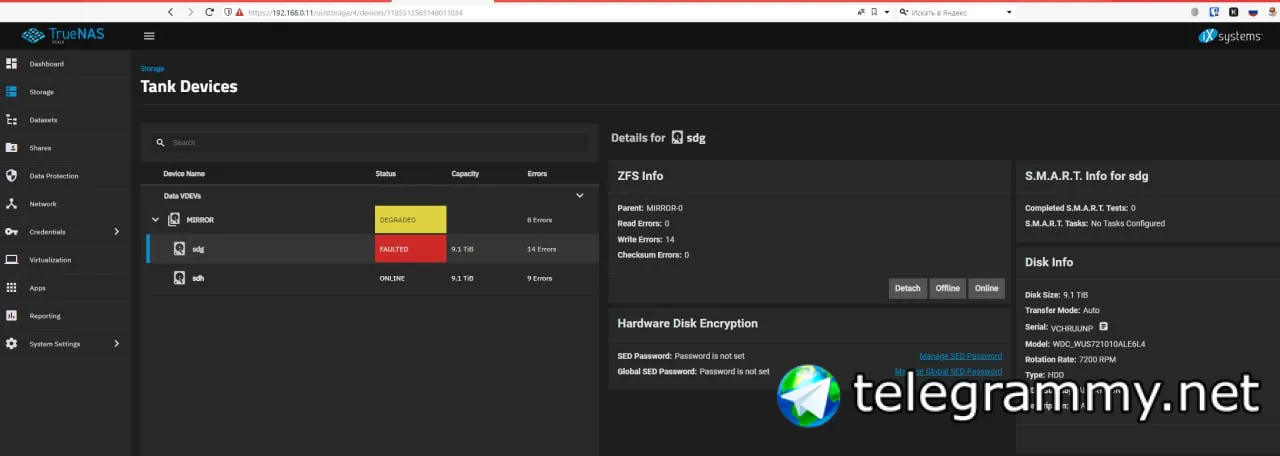

root@truenas-01[/mnt/tank]# zpool status -v tank

pool: tank

state: DEGRADED

status: One or more devices are faulted in response to persistent errors.

Sufficient replicas exist for the pool to continue functioning in a

degraded state.

action: Replace the faulted device, or use 'zpool clear' to mark the device

repaired.

scan: resilvered 1.98M in 00:00:11 with 0 errors on Thu Mar 7 17:10:27 2024

config:

NAME STATE READ WRITE CKSUM

tank DEGRADED 0 0 0

mirror-0 DEGRADED 0 8 0

sdg FAULTED 0 14 0 too many errors

sdh ONLINE 0 9 0

errors: No known data errors

root@truenas-01[/mnt/tank]# zfs --version

zfs-2.2.2-1

zfs-kmod-2.2.2-1

root@truenas-01[/mnt/tank]# uname -a

Linux truenas-01 6.6.10-production+truenas #1 SMP PREEMPT_DYNAMIC Mon Feb 5 22:05:36 UTC 2024 x86_64 GNU/Linux

root@truenas-01[/mnt/tank]#

Еvgeniy

Еvgeniy

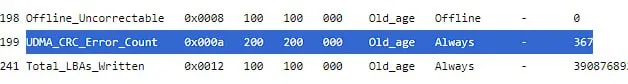

меняю провода местами, сыпет на тот е диск, хотя он уже подключен к другому разъему sata

потом начинает на другой диск ругаться...

Vladislav

Vladislav

UDMA_CRC_Error_Count и WRITE FPDMA QUEUED обычно указывает, что либо проблема с кабелем, либо слотом с любой из сторон

ALEX

ALEX

Manufacturer HUANANZHI

Model X10X99-16D

Контакты попробуй почистить на жестаке и маме, и кабель прям другой возьми

Xash

Xash

UDMA_CRC_Error_Count и WRITE FPDMA QUEUED обычно указывает, что либо проблема с кабелем, либо слотом с любой из сторон

Тоже самое все было отвечаю. Никто ниче не чистил. Диски поменяли и проблема ушла.

Смарт то что показывает это ерунда, zfs походе требует идеальнейших условий.

Xash

Xash

Мне ничего не понятно почему. Но я потом эти диски поющал в десктопе и они сыпаться начали а смарт ок

Vladislav

Vladislav

Тоже самое все было отвечаю. Никто ниче не чистил. Диски поменяли и проблема ушла.

Смарт то что показывает это ерунда, zfs походе требует идеальнейших условий.

Коннектор со стороны диска тоже подлежит чистке

Vladislav

Vladislav

У меня, к примеру, такое было, когда Г образный сата кабель был на 170 градусов погнут, первые полгода было норм, а потом посыпалось

Xash

Xash

ᅠ

ᅠ

подскажите пожалуйста, можно ли как-то в существущее зеркало (raid1) добавить ещё зеркало с 2х дисков (по утогу получив raid10)

или нужно пересобирать массив добавляя сразу все 4 диска?

George

George

подскажите пожалуйста, можно ли как-то в существущее зеркало (raid1) добавить ещё зеркало с 2х дисков (по утогу получив raid10)

или нужно пересобирать массив добавляя сразу все 4 диска?

Да, емнип zpool add mirror disk1 disk2 poolname

лучше прочесть ман и потренироваться на пуле из файлов

ᅠ

ᅠ

Файл для этого можно создать через truncate -s 1G file1.img (к примеру)

Отлично, потренируюсь

спасибо!

Еvgeniy

Еvgeniy

Контакты попробуй почистить на жестаке и маме, и кабель прям другой возьми

проблема решена покупкой LSI HBA и серверных проводов SATA

ни одной ошибки на всех 5ти дисках

а раньше подсыпало ошибки на RAIDZ1 из трех дисков, даже на другой материнке в другом компе

итого - обычные SATA кабели по 150 рублей - зло

Vladislav

Vladislav

ᅠ

ᅠ

а подскажите пожалуйста ещё по поводу такой ситуации:

допустим есть пул zfs raid10 с 4SSDx2Tb, 2 зеркала, он заполнился данными примерно на 60-80%, докупили ещё 2 диска что бы расширить дисковое пространство и добавили в данный пул третье зеркало с 2х аналогичных по размеру дисков.

а что будет проихсодить дальше? после добавления дисков произойдет ли перебалансировка/перераспределение дискового пространства? или данные будут по прежнему писатся в 2 зеркала до заполнения и после чего будет использоваться 3е зеркало?

Δαρθ

Δαρθ

Тоже самое все было отвечаю. Никто ниче не чистил. Диски поменяли и проблема ушла.

Смарт то что показывает это ерунда, zfs походе требует идеальнейших условий.

Ну я видел когда определенные сочетания мамка-кабель-диск начинают срать ошибкам SATы (особенно если она вскакивает на 6гбит/с), замена одного из компонентов (каждый сам по себе исправен, в других наборах) решает проблему

Georg🎞️🎥

Georg🎞️🎥

а подскажите пожалуйста ещё по поводу такой ситуации:

допустим есть пул zfs raid10 с 4SSDx2Tb, 2 зеркала, он заполнился данными примерно на 60-80%, докупили ещё 2 диска что бы расширить дисковое пространство и добавили в данный пул третье зеркало с 2х аналогичных по размеру дисков.

а что будет проихсодить дальше? после добавления дисков произойдет ли перебалансировка/перераспределение дискового пространства? или данные будут по прежнему писатся в 2 зеркала до заполнения и после чего будет использоваться 3е зеркало?

При добавлении, будет писать в наиболее свободную область. Читать будет оттуда, куда записал :))) какой то баланс настанет, когда будете удалять// добавлять новые данные )

Вроде так )

Vladislav

Vladislav

Alexandr

Alexandr

Уважаемые гуру от zfs. Подскажите начинающему:

Имеется домашний сервер с убунту-cli. Файлопомойка организована как raidz2. 5 дисков по 6Тб.

Позавчера начали подтормаживать фильмы. Перезагрузил. отвалился раид.

Сделал импорт с -f. Сервер Написал что 3 диска resilvering. И процент 0.12. через час все те же 0.12 и судя по активности сервер ничего не делал. Подождал еще несколько часов, а воз и ныне там. Перезагрузил - сервер начал виснуть на загрузке кэша.

Проверил порты, смарты hdd. Все в порядке. Перенес кэш в другое место и сервер загрузился. Но при импорте теперь:

Group Butler

Group Butler

central

central