Free

Free

Да, прикидывал.

Мне эти пулы достались уже почти заполненные, recordsize =1M, а на одном вообще дефолтный 128К 🙈. Объемы SSD огромные нужны, с учетом того, что это серверные должны быть и в зеркалах - не потяну сейчас.

Может, новый буду делать, тогда сразу 4M и гигабайтных SSD хватит

Vladislav

Vladislav

смотреть его конечно стоит, но сказать что это лучше))..., ну не)), не лучше)

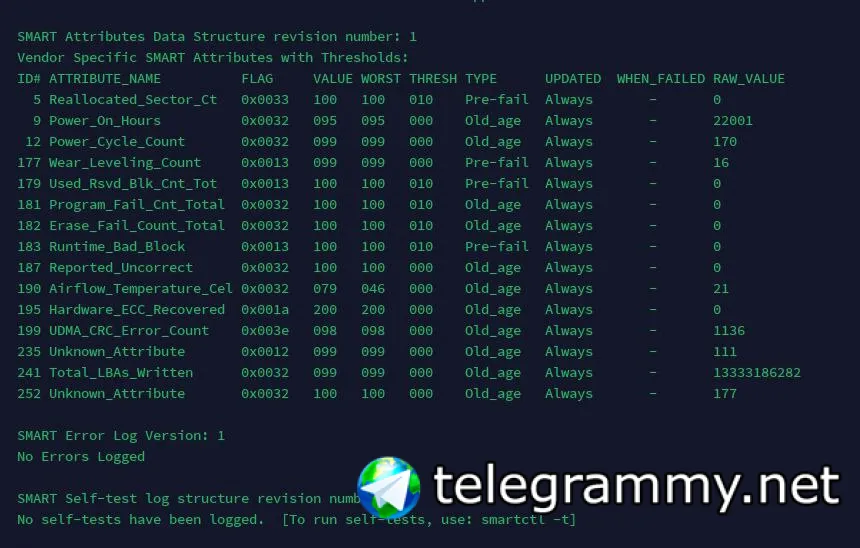

Точно лучше, чем zpool status, ибо все что покажет zpool status - покажет и смарт, но смарт ещё покажет relocated blocks

Владимир

Владимир

Владимир

Владимир

Точно лучше, чем zpool status, ибо все что покажет zpool status - покажет и смарт, но смарт ещё покажет relocated blocks

у меня есть яркий пример когда у меня на sas hdd статус zpool фиксирует переодические проблемы, а на смарте нихера

Vladislav

Vladislav

у меня есть яркий пример когда у меня на sas hdd статус zpool фиксирует переодические проблемы, а на смарте нихера

Ммммм, а short test настроен?

Владимир

Владимир

# smartctl -i /dev/sda

smartctl 7.2 2020-12-30 r5155 [x86_64-linux-5.15.108-1-pve] (local build)

Copyright (C) 2002-20, Bruce Allen, Christian Franke, www.smartmontools.org

=== START OF INFORMATION SECTION ===

Vendor: SEAGATE

Product: ST2000NM0045

Revision: N004

Compliance: SPC-4

User Capacity: 2 000 398 934 016 bytes [2,00 TB]

Logical block size: 512 bytes

LU is fully provisioned

Rotation Rate: 7200 rpm

Form Factor: 3.5 inches

Logical Unit id: 0x5000c500a6d0a643

Serial number: ZC22J1GP0000C906KA5S

Device type: disk

Transport protocol: SAS (SPL-3)

Local Time is: Sat Dec 2 00:10:24 2023 MSK

SMART support is: Available - device has SMART capability.

SMART support is: Enabled

Temperature Warning: Enabled

root@vmland250:~# smartctl -A /dev/sda

smartctl 7.2 2020-12-30 r5155 [x86_64-linux-5.15.108-1-pve] (local build)

Copyright (C) 2002-20, Bruce Allen, Christian Franke, www.smartmontools.org

=== START OF READ SMART DATA SECTION ===

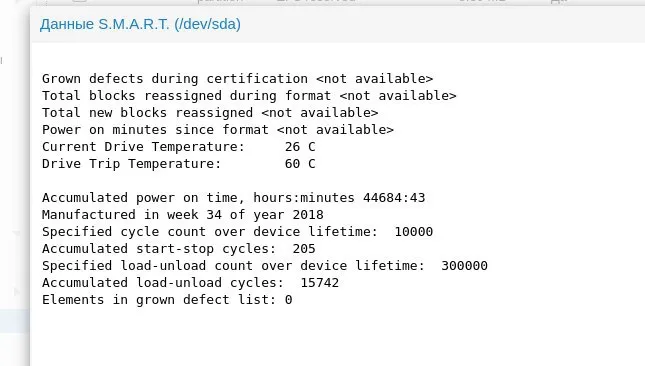

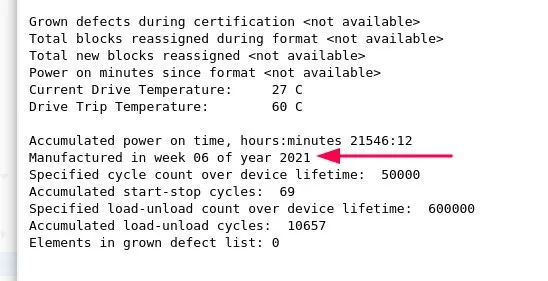

Current Drive Temperature: 26 C

Drive Trip Temperature: 60 C

Accumulated power on time, hours:minutes 44684:46

Manufactured in week 34 of year 2018

Specified cycle count over device lifetime: 10000

Accumulated start-stop cycles: 205

Specified load-unload count over device lifetime: 300000

Accumulated load-unload cycles: 15742

Elements in grown defect list: 0

root@vmland250:~# smartctl -H /dev/sda

smartctl 7.2 2020-12-30 r5155 [x86_64-linux-5.15.108-1-pve] (local build)

Copyright (C) 2002-20, Bruce Allen, Christian Franke, www.smartmontools.org

=== START OF READ SMART DATA SECTION ===

SMART Health Status: OK

Grown defects during certification <not available>

Total blocks reassigned during format <not available>

Total new blocks reassigned <not available>

Power on minutes since format <not available>

Vladislav

Vladislav

Владимир

Владимир

Владимир

Владимир

Владимир

Владимир

Vladislav

Vladislav

Fedor

Fedor

касательно проблемы с core на z_metaslab и

PANIC: zfs: adding existent segment to range tree (offset=a18422c6000 size=4a000)

это реально пофиксить, чтобы без рекавери работало?

Игорь

Игорь

Игорь

Игорь

Ну нет, так нет. Останови контейнер lxc, переименуй текущий набор данных (zfs rename) в какой-нибудь vmpool/old, затем сделай zfs send vmpool/old| zfs recv в прежнее имя vmpool/vm-803-disk-0. Если что не получится, можно будет vmpool/old вернуть обратно в vmpool/vm-803-disk-0.

Станислав

Станислав

У меня один zfs volume - vmpool/vm-803-disk-0 имеет размер много больший, чем volsize 32G.

Снимков у него нету....

https://hastebin.com/share/udiqaceney.bash

Так у Вас volblocksize треш какой-то. На каждый блок мета есть, которая занимается место. Не думаю, конечно, что настолько больше, но нужно посчитать

Ivan

Ivan

Free

Free

Тогда вам ещё часика 2 подождать

Вот уже 15 часов прождал - безрезультатно 😞.

При этом и ресилверинг на те же

18.8G resilvered, 10.73% done, no estimated completion time

показывает. 😳

Как будто замерло все.

Но статус ONLINE при этом, и команды отрабатывает.

Alex

Alex

Можно же арендовать сервер чтобы не покупать так много

арендовать серв с 90тб? :) я сомневаюсь, что это в бюджете товарища. Хотя могу и ошибаться, но там будет уже недалеко до купить новый сервер

Ivan

Ivan

Знатоки, подскажите, пожалуйста, один момент, который мне не совсем ясен. Я вот щас экспериментирую с тестовым пулом на ноуте, который поднят просто на raw файлах. Я пробую экспортить, импортить пул. Но после перезагрузки система пула не видит. Вопрос, а каким образом система в принципе узнает про существующие пулы после перезагрузки? К примеру в mdadm там инфа о пуле писалась в mdadь.conf, а тут? Если я правильно понял, инфа пишется в /etc/zfs/zpool.cache. Сейчас я могу после перезагрузки импортнуть пул по девайсу (в данном случае одному из файлов выступющего в качестве блочного устройства). Когда у меня импортнут пул, то в zpool.cache есть инфа. Если я экспорчу пул то файл обнуляется. Но при перезагрузке же он тоже вроде как обнуляется или нет? Тогда откуда система при загрузке знает какие пулы есть и что импортить? Или он обнуляется потому что у меня пул на файлах поднят? Просто на работе например у меня пулы на физических дисках поднят и там после перезагрузки все поднимается само.

Vladislav

Vladislav

Ivan

Ivan

Гугл открывали? Что пишет по запросу *zfs autoimport pool on file*?

Открывал, но не по такому запросу

Vladislav

Vladislav

Открывал, но не по такому запросу

А по какому если Вас интересует автомаунт пула из файлов?

Ivan

Ivan

Я щас на телефоне, точно запросы не подскажу. Но autoimport упомянуть в запросе мне в голову не пришло

Vladislav

Vladislav

@neurox, так, если Вы знаете как помочь человеку иначе - Вы всегда можете сделать всю работу по поиску информации за него

Ivan

Ivan

В общем-то я посмотрел выдачу по обоим этим запросам и, мягко говоря, это не сильно помогло. Выдача плюс минус та же что была и по моим запросам, а вопрос остался.

Vladislav

Vladislav

я за чтение мануалов, в не гугл. гугл - быстрое решение без оглядки на будущее.

В мануалах я кстати ничего не нашёл про zfs-import-cache.service

Vladislav

Vladislav

Vladislav

Vladislav

Правда. То что там написано, я давно уже сделал и знал и без этого

И почему же я не вижу в Вашем посте вывода логов сервиса на pastebin?

Fedor

Fedor

В мануалах я кстати ничего не нашёл про zfs-import-cache.service

https://openzfs.github.io/openzfs-docs/man/master/8/zpool-import.8.html

man 8 zpool-import

-c cachefile

Reads configuration from the given cachefile that was created with the cachefile pool property. This cachefile is used instead of searching for devices.

Vladislav

Vladislav

не оно?

Не совсем, это упоминание про сам файл, но нужно ещё найти systemd сервис, который отвечает за его чтение

Ivan

Ivan

Я думаю проблема в том, что пул собран на файлах обычных. А не на блочных девайсах реальных. Хотя могу ошибаться

Vladislav

Vladislav

Можно посмотреть чуть внутрь. А так - в документацию приветствуются правки.

Ну и да, обычно я считаю, что документацию по ссылкам из закрепа человек уже изучил

Fedor

Fedor

Fedor

Fedor

Ну и да, обычно я считаю, что документацию по ссылкам из закрепа человек уже изучил

в гугле обычно выводится следствие из документации, а не наоборот

Fedor

Fedor

я не ковырял кешфайлы - не было такой нужды, но, как мне кажется, там все должно быть относительно просто

Ivan

Ivan

так что я за нее, а не за гугл

попрой доку сложно однозначно понять и почитать чужой опыт и мнение полезно

Vladislav

Vladislav

так что я за нее, а не за гугл

Да, я не спорю, но и подразумевается, что человек уже прочитал документацию хотя бы поверхностно

Ivan

Ivan

Нет, я ошибся после перезагрузки zpool.cache после перезагрузки не обнулился. Он есть и инфа в нем есть. Но почему-то zpool status пишет что пулов нет доступных

Vladislav

Vladislav

ExecStart=@sbindir@/zpool import -c @sysconfdir@/zfs/zpool.cache -aN $ZPOOL_IMPORT_OPTS

Посмотрите внимательно сюда

Ivan

Ivan

Для чистоты эксперимента я сделал еще так:

zpool export ztest01

zpool export ztest02

Проверил zpool.cache - пустой

zpool import -d 1.raw ztest01

zpool import -d 5.raw ztest02

проверил zpool.cache - инфа есть

Перегрузился пулов нет ))

Vladislav

Vladislav