Если спасать данные - пробуйте livecd или ждите минут 30

Может диски отвиснут, скорее всего все повисло на zpool import

Vladislav

Vladislav

Он показывает ошибки чексумм и записи, насколько я помню (надо доку внимательно глянуть), но битые сектора не всегда приводят к этому сразу

Это ответ человеку что удалил свое сообщение

Free

Free

Если спасать данные - пробуйте livecd или ждите минут 30

Экспорт жду уже полтора часа.

Прерывать опасаюсь

Vladislav

Vladislav

60 ТБ

Я однажды делал на этом пуле экспорт-импорт (на тот же сервер). Занимало минут 10.

Тогда вам ещё часика 2 подождать

riv

riv

Каким образом?

Даже ls зависает.

Выключаете сервер, ddrescue долго и мучительно сохраняет raw-образы всех дисков, импортируете их как пул, включаете разрешение zfs send при неисправимых ошибках, запускаете zfs send и ждёте

Free

Free

Zpool send recv

Запланировал.

В данный момент дисков нет.

Ко вторнику наберу на пул.

Может, что-то подготовительное пока сделать...

riv

riv

Запланировал.

В данный момент дисков нет.

Ко вторнику наберу на пул.

Может, что-то подготовительное пока сделать...

Если информация важна, лучше диски не трогать лишний раз.

Free

Free

Непонятно технологически, как лучше это делать.

Сейчас пул - это 30 дисков по 3ТБ. Свободных SATA только парочка.

Отсоединить все, кроме одного, сохранить его образ, переходить к следующему?

И потом из образов как-то можно будет пул собрать?

И потом еще в новый пул отправить?

То есть для этого минимум 2*90 ТБ объем нужно подготовить?

Free

Free

Если информация важна, лучше диски не трогать лишний раз.

Отдельные кусочки информации особо не важны Там всё из файлов размером в 1-2 МБ, потеря какой-то части не страшна.

Но весь пул как целое достаточно ценен

riv

riv

riv

riv

Free

Free

А инфы то 60ТБ?

root@docker09:~# zfs list

NAME USED AVAIL REFER MOUNTPOINT

my 59.1T 3.13T 402K /my

Ну образы же всех 30 дисков нужно сделать?

Vladislav

Vladislav

root@docker09:~# zfs list

NAME USED AVAIL REFER MOUNTPOINT

my 59.1T 3.13T 402K /my

Ну образы же всех 30 дисков нужно сделать?

Вы делаете образ и с ним уже эксперименты проводите, как я понял идею

Free

Free

А что роказывает zpol status -v ?

errors: No known data errors

Полным выводом неприлично, наверное, чат захламлять?

Vladislav

Vladislav

errors: No known data errors

Полным выводом неприлично, наверное, чат захламлять?

Pastebin существует по этой причине

riv

riv

errors: No known data errors

Полным выводом неприлично, наверное, чат захламлять?

Ну т.е. по 0 там? Хм... Интересно. SMR диски не используются? HBA контроллер не перегревается, не глючит? Чтобы убедится что с дисками все впорядке, при таких вводных, я бы снял всю нагрузку с пула и сделал zpool scrub, и посмотрел бы на счетчики ошибок по его окончании.

30 дисков в одном vdev? Или что то тира 3 по 10?

Free

Free

Вы делаете образ и с ним уже эксперименты проводите, как я понял идею

Для экспериментов много больше 90 ТБ нужно: диски будут по 20ТБ, т.е. на каждом 6 образов только, итого 5*20 = 100.

И потом ведь куда-то нужно будет результаты эксперимента отправить...

Vladislav

Vladislav

Free

Free

Ну т.е. по 0 там? Хм... Интересно. SMR диски не используются? HBA контроллер не перегревается, не глючит? Чтобы убедится что с дисками все впорядке, при таких вводных, я бы снял всю нагрузку с пула и сделал zpool scrub, и посмотрел бы на счетчики ошибок по его окончании.

30 дисков в одном vdev? Или что то тира 3 по 10?

SMR не должно быть, все в видеонаблюдении ранее были.

Vladislav

Vladislav

Ну т.е. по 0 там? Хм... Интересно. SMR диски не используются? HBA контроллер не перегревается, не глючит? Чтобы убедится что с дисками все впорядке, при таких вводных, я бы снял всю нагрузку с пула и сделал zpool scrub, и посмотрел бы на счетчики ошибок по его окончании.

30 дисков в одном vdev? Или что то тира 3 по 10?

Это нормальное поведение

Надо посмотреть таймер скраба, плюс ошибка zpool выводится только в 3 сценариях

1) read - IO тайм-аут на чтение

2) write - IO тайм-аут на запись

3) checksum - Checksum errors represent events where a disk returned data that was expected to be correct, but was not - это значит, что диск уже полетел или просто поврежден

Vladislav

Vladislav

Replace не думая?

Сейчас ничего не трогайте, ждите resilver, я не могу предсказать поведение системы, если Вы сейчас уберёте один из дисков

Vladislav

Vladislav

Это нормальное поведение

Надо посмотреть таймер скраба, плюс ошибка zpool выводится только в 3 сценариях

1) read - IO тайм-аут на чтение

2) write - IO тайм-аут на запись

3) checksum - Checksum errors represent events where a disk returned data that was expected to be correct, but was not - это значит, что диск уже полетел или просто поврежден

И НИ одно из этих состояний не сообщит о том, что битые сектора появляются, оно покажет, когда они уже умирают, то есть немного поздно

Vladislav

Vladislav

Сейчас ничего не трогайте, ждите resilver, я не могу предсказать поведение системы, если Вы сейчас уберёте один из дисков

Может кто-то опытнее может, но я бы не трогал, ребилд дисковой подсистемы даже в 6-м рейде

Vladislav

Vladislav

Replace не думая?

Но в целом, да, смотрите лучше zpool status -s или настройте мониторинг смарта

Vladislav

Vladislav

Но опять же slow появится только при обращении к массиву, к примеру устроить du .* -sh ему

Vladislav

Vladislav

Vladislav

Vladislav

systemctl status zfs-scrub-weekly@rpool.timer zfs-scrub-monthly@rpool.timer zfs-scrub-weekly@StoragePool.timer zfs-scrub-monthly@StoragePool.timer

riv

riv

Replace не думая?

Если будете менять диски, то replace делается не отключая сбойный диск до конца процедуры! Т.е. не вынул, заменил, а добавил, replace, улалил старый.

Free

Free

Если будете менять диски, то replace делается не отключая сбойный диск до конца процедуры! Т.е. не вынул, заменил, а добавил, replace, улалил старый.

Да, я прошлый раз так делал на этом пуле.

Тогда можно не дожидаясь ресилвенга заменить?

Vladislav

Vladislav

riv

riv

Да, я прошлый раз так делал на этом пуле.

Тогда можно не дожидаясь ресилвенга заменить?

Теоритически да, но практически смысла не имеет. Он всеравно поставит рестлвинг с новым диском в очередь (но это не точно)

Free

Free

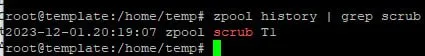

У Вас кажись scrub ни разу не запускался))))

По крайней мере когда replace делал - видел, что скраб в процессе

Free

Free

Сделайте всё же

Запустил, долго отрабатывает.

Но глянул по сохраненной истории (записывал недавно себе) - и в августе, и в октрябре был

Vladislav

Vladislav

Запустил, долго отрабатывает.

Но глянул по сохраненной истории (записывал недавно себе) - и в августе, и в октрябре был

Мммм, это довольно редко, он по хорошему минимум раз в неделю, лучше 2, если нет мониторинга смарта

Free

Free

Мммм, это довольно редко, он по хорошему минимум раз в неделю, лучше 2, если нет мониторинга смарта

Он меньше недели не работает 😊 - нагрузка на пул довольно серьезная, в фоне помнится обещал чуть не за месяц закончить

Владимир

Владимир

Непонятно технологически, как лучше это делать.

Сейчас пул - это 30 дисков по 3ТБ. Свободных SATA только парочка.

Отсоединить все, кроме одного, сохранить его образ, переходить к следующему?

И потом из образов как-то можно будет пул собрать?

И потом еще в новый пул отправить?

То есть для этого минимум 2*90 ТБ объем нужно подготовить?

Можно же арендовать сервер чтобы не покупать так много

Vladislav

Vladislav

Он меньше недели не работает 😊 - нагрузка на пул довольно серьезная, в фоне помнится обещал чуть не за месяц закончить

Ээээээммм

Это не уверен, что должно ТАК работать

Но ладно, мониторинг смарта ваше всё

Free

Free

Можно же арендовать сервер чтобы не покупать так много

Ну надеюсь заменой диска сейчас обойдусь...

Free

Free

Ээээээммм

Это не уверен, что должно ТАК работать

Но ладно, мониторинг смарта ваше всё

Ну вот на соседнем сервере идет с такой скоростью:

scan: scrub in progress since Sun Nov 12 00:24:04 2023

85.1T scanned at 12.1M/s, 84.8T issued at 10.9M/s, 211T total

0B repaired, 40.11% done, 140 days 10:48:28 to go

Он, правда, побольше, но и диски там новые, ошибок сосвсем не замечено (3*тьфу)

Free

Free

Ну теперь буду...

Но это я к регулярности/скорости скраба.

Slow кстати на этом пуле не диагностирует.

Free

Free

Но там кстати тоже что-то не то.

ВОт с 12 ноября уже 40% скраба, а оставшиеся 60 за 140 дней запланировал.

И что-то сервисам последнее время скорость i/o не очень нравится...

Станислав

Станислав

Ну вот на соседнем сервере идет с такой скоростью:

scan: scrub in progress since Sun Nov 12 00:24:04 2023

85.1T scanned at 12.1M/s, 84.8T issued at 10.9M/s, 211T total

0B repaired, 40.11% done, 140 days 10:48:28 to go

Он, правда, побольше, но и диски там новые, ошибок сосвсем не замечено (3*тьфу)

Вам бы мету на SSD вынести, думаю лучше станет