Вы знаете закон Каннингема?))

Сейчас была его наглядная демонстрация, а учитывая Ваше уязвленное мной самолюбие Вы включились активнее всех стараясь дать верный ответ)))

Ничего подобного. Я просто не сразу сообразил про опцию -n, хотя пользуюсь частенько. Просто в чате кто-то отвлекает чушью

Maksym

Maksym

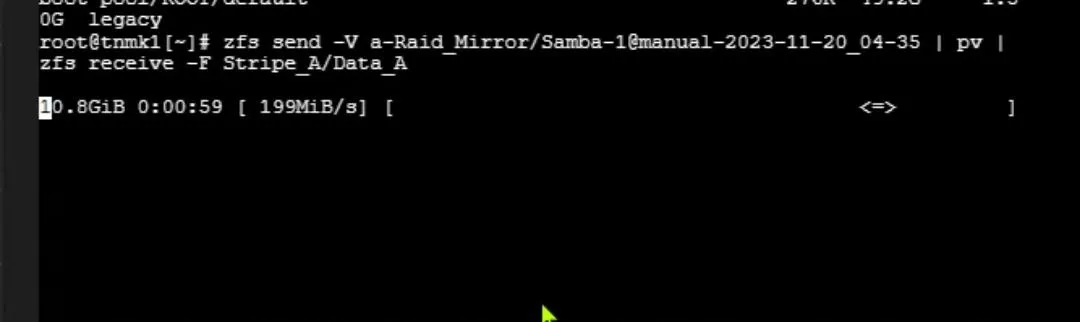

Коллеги, подскажите пожалуйста! Я посылаю датасет с одного пула на другой в пределах 1 системы. Какой командой можно сделать процесс видимым?

Я делал так:

zfs send poola/dataset@snap_1 | zfs receive -F poolb/dataset_b/dataset_c

Klintestwood

Klintestwood

Vladislav

Vladislav

нет

Открываем гугл

Вводим

zfs send receive progress

И видим

https://docs.oracle.com/cd/E36784_01/html/E36835/gnheq.html

Да, оракл zfs не совсем openzfs, но в общих чертах документацию - можно использовать

Δαρθ

Δαρθ

А вот возник глупый вопрос, OpenZFS поддерживает ли парадигму "открыть файл/удалить файл без закрытия"? Ну в смысле если так делать (многие софты так делают) то всё будет как и с другими ФС? А что произойдёт с занятым местом если будет креш?

Vladislav

Vladislav

Δαρθ

Δαρθ

сделать rm -f на файл открытый на zfs?

ну типа да. В линуксе тогда пока не закроют FD с этим FD можно работать (писать-читать), а реально место на ФС должно освободиться только когда FD закрыт

Δαρθ

Δαρθ

Ну в смысле понятно что такое в целом должно работать, вопрос про то что с занятым местом после креша будет )

Vladislav

Vladislav

Ну в смысле понятно что такое в целом должно работать, вопрос про то что с занятым местом после креша будет )

Maksym

Maksym

Уважаемые коллеги!

Если переслал снапш датасета командой zfs send, то его в новом месте надо активировать? Дело в том, что послал, а его нет))). Или я закрытием консоли отменил пересылку?

Ivan

Ivan

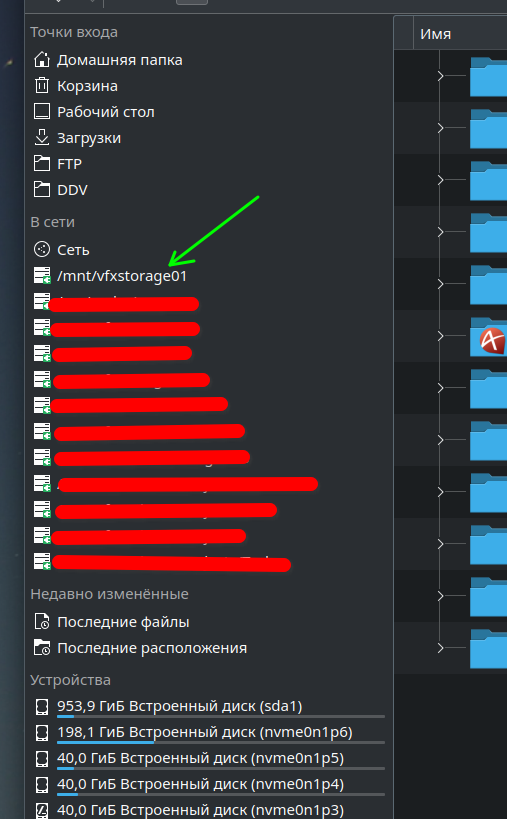

Ребята, подскажите, как правильнее сделать. У меня есть пул он шарится по NFS. А также на нем есть много датасетов и парамметры шаринга забираются с пула. Соотвественно у меня у клиентов в KDE в долфине слева в разделе Сеть все датасеты отображены как отдельные шары. А мне нужно чтобы только корневая была и все. Я могу пробежаться по всем датасетам и отключить там шару, или может crossmnt отрубить (т.к. он по дефолту включен). Как правильнее?

Vladislav

Vladislav

Vladislav

Vladislav

транзакции или всё или ничего?

Там 4тб

Посмотрите активность сети через nmon тот же, если активности нет - процесса нет

Если его переслали - смотрите командой выше

А вообще, Вы бы фулл команду дали

Александр

Александр

Не знаю, я закрыл гуи с консолью. Думаю это отменило всё.

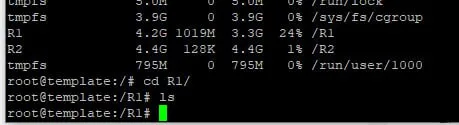

Вот тут процесс прерван, так что велика вероятность отмены

Maksym

Maksym

Посмотрите активность сети через nmon тот же, если активности нет - процесса нет

Если его переслали - смотрите командой выше

А вообще, Вы бы фулл команду дали

как фул команду дать? Пожалуйста ко мне можно на ты, я не в рф. Тут только на ты))

Станислав

Станислав

Не знаю, я закрыл гуи с консолью. Думаю это отменило всё.

Если закрыть терминал, то прерывается сессия и всё, что отрыто в данный момент под неё. Могут даже прерываться процессы, запущенные с '&', смотря как настроена ОС

Vladislav

Vladislav

как фул команду дать? Пожалуйста ко мне можно на ты, я не в рф. Тут только на ты))

Ну, просто то, что вводили в командную строку

Vladislav

Vladislav

Да, закрыв консоль, если нет возможности ввода - Вы прервали выполнение передачи снапшота

ctrl+z можно нажать, если совсем всё плохо (но не проверял)

Maksym

Maksym

Станислав

Станислав

Vladislav

Vladislav

Золотое правило, если Вы не можете вводить в консоль текст, и там идёт какой-то процесс - значит Вы убьёте этот процесс закрыв консоль (исключение screen\tmux\отображение работы демона и т.д.)

Maksym

Maksym

Δαρθ

Δαρθ

Золотое правило, если Вы не можете вводить в консоль текст, и там идёт какой-то процесс - значит Вы убьёте этот процесс закрыв консоль (исключение screen\tmux\отображение работы демона и т.д.)

Если убить screen/tmux то то же самое получится :)

Vladislav

Vladislav

Если убить screen/tmux то то же самое получится :)

Нууу, это сложнее сделать, чем просто нажав на крестик

Станислав

Станислав

Maksym

Maksym

Ещё можно избежать декомпрессии передаваемых блоков, если использовать zfs send -cL .... В передающем и принимающем датасетах должны быть одинаковые настройки сжатия

А если мне надо другое сжатие, то нет смысла в этом флаге?

Станислав

Станислав

А если мне надо другое сжатие, то нет смысла в этом флаге?

Само собой. Хотя я соврал, наверное, по поводу одинаковых настроек сжатия, в мане почитайте, там написано что должно совпадать

Δαρθ

Δαρθ

Ещё можно избежать декомпрессии передаваемых блоков, если использовать zfs send -cL .... В передающем и принимающем датасетах должны быть одинаковые настройки сжатия

ещё можно в пайп пихнуть zstd -zc и zstd -dc

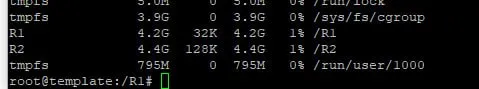

Ivan

Ivan

riv

riv

Alex

Alex

А если смонтировать их в иерархически независимые папки?

а разве локальный mount влияет на сетевые шары? :\

Alex

Alex

Да похоже что никак. Т.к. это не помогло.

честно почти не трогал нфс. Но интересно =) А у вас линух или фря?

Ivan

Ivan

ну на клиентах понятно, да. А что в /etc/exports ?

Ну сам /etc/exports пустой, а в /etc/exports.d/zfs.exports все шары как пула так и всех датасетов

Alex

Alex

Но в долфине, ссылка на шару датасета останется. Чудеса )

о как! а она там остается просто видна или прямо доступ есть и файлы открываются? может он просто кэширует и всё

Ivan

Ivan

о как! а она там остается просто видна или прямо доступ есть и файлы открываются? может он просто кэширует и всё

После того как я сделал sharenfs=off тестовому датасету, перезапустил zfs-share и nfs-server, также перемонтировал пул на клиенте, зашел по ссылке она чуть чуть подумала, как если бы шара отвалилась, и потом файлы отобразились.

Vladislav

Vladislav

Если поставить датасету sharenfs=off, то шара исчезнет из /etc/exports.d/zfs.exports

Причём тут ZFS всё ещё? У Вас буквально вопрос про NFS.

Ручками Вы его настраивали или через автоматизацию не влияет на тематику вопроса.

Ivan

Ivan

о как! а она там остается просто видна или прямо доступ есть и файлы открываются? может он просто кэширует и всё

Я думаю дело в клиенте. Я щас проверил mount | grep nfs на клиенте и там все шары смонтированы.

Юрий

Юрий

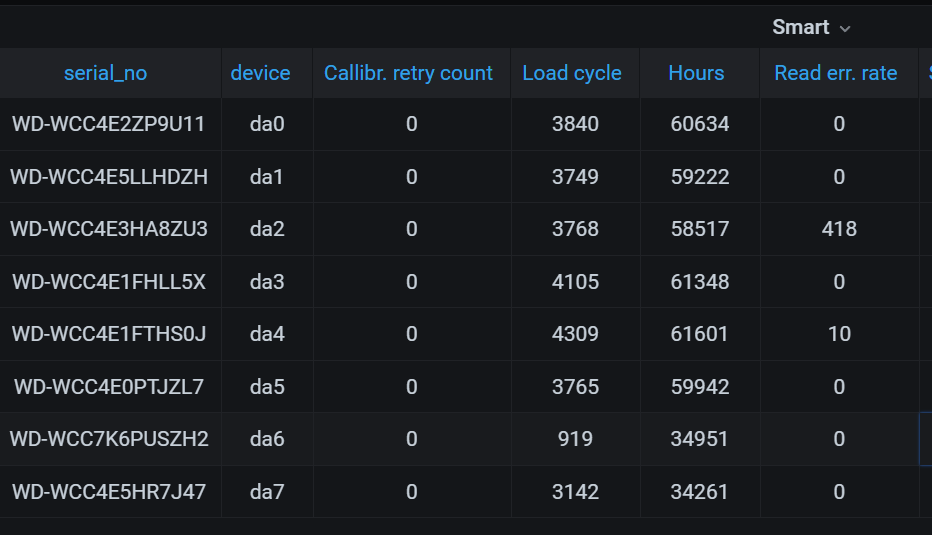

Доброго! Есть владельцы дисков Western Digital Green/Red, которые работают 24/7? Пытаюсь понять почему отключение таймера сна (A)PM через idle3ctl (ну или каким-либо другим способом) является не рекомендованным. Возможно не совсем по профилю залетел, но мало ли

Vladislav

Vladislav

Доброго! Есть владельцы дисков Western Digital Green/Red, которые работают 24/7? Пытаюсь понять почему отключение таймера сна (A)PM через idle3ctl (ну или каким-либо другим способом) является не рекомендованным. Возможно не совсем по профилю залетел, но мало ли

Потому что green не предназначены для работы 24/7

А Red как бэ и так не должны спать

Если Вы для zfs - берите красные

Юрий

Юрий

Потому что green не предназначены для работы 24/7

А Red как бэ и так не должны спать

Если Вы для zfs - берите красные

А, утилиту изначально делали под зелёнку… Ну да, у меня красные. Просто у них выставлено 138 (0x8a) или может это нормально

Model Family: Western Digital Red

Device Model: WDC WD40EFZX-68AWUN0

4 Start_Stop_Count 0x0032 100 100 000 Old_age Always - 12

9 Power_On_Hours 0x0032 088 088 000 Old_age Always - 8948

193 Load_Cycle_Count 0x0032 200 200 000 Old_age Always - 1509

Georg🎞️🎥

Georg🎞️🎥

Владимир

Владимир

Доброго! Есть владельцы дисков Western Digital Green/Red, которые работают 24/7? Пытаюсь понять почему отключение таймера сна (A)PM через idle3ctl (ну или каким-либо другим способом) является не рекомендованным. Возможно не совсем по профилю залетел, но мало ли