Vladislav

Vladislav

да никак, у него иногда бывают озарения (очевидно когда он мету вычитывает) потом опять скорость деградирует

Это лишь значит, что эти промежутки не меняли с точки зрения блоков

Алексей

Алексей

Это лишь значит, что эти промежутки не меняли с точки зрения блоков

Что значит меняли? Перезаписывали данные?

Georg🎞️🎥

Georg🎞️🎥

А кто то смог в итоге выжать что то приличное из arcL2?

Он все еще кажется какой то малоэффективной ерундой

Алексей

Алексей

Алексей

Алексей

А мне нужно prefetch кэшировать , а не мелкие блоки )))

на больших возможно лучше себя ведет, у меня мелкота ты прав

Алексей

Алексей

Товарищ вон хотел 10 терабайт поставить )) на кэш

Он еще заполняется крайне неохотно. Малоэффективная ерунда короче

Georg🎞️🎥

Georg🎞️🎥

Он еще заполняется крайне неохотно. Малоэффективная ерунда короче

Может мы что то недокрутили :))))🤷🏻♂️ вот как бы его охотно и быстро заполнить (((( а то оптан тогда в помойку ((

George

George

raid0 пул на 30+ дисков, феерично https://github.com/openzfs/zfs/discussions/15119#discussioncomment-6582943

Олег

Олег

raid0 пул на 30+ дисков, феерично https://github.com/openzfs/zfs/discussions/15119#discussioncomment-6582943

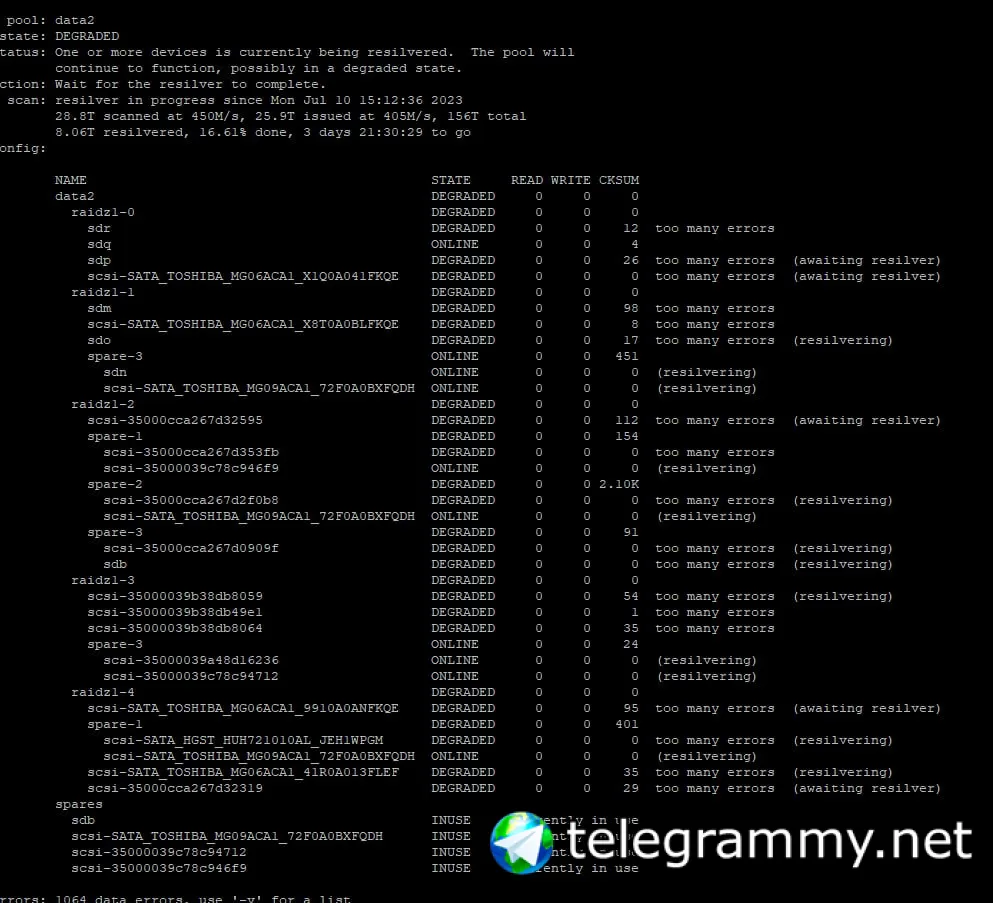

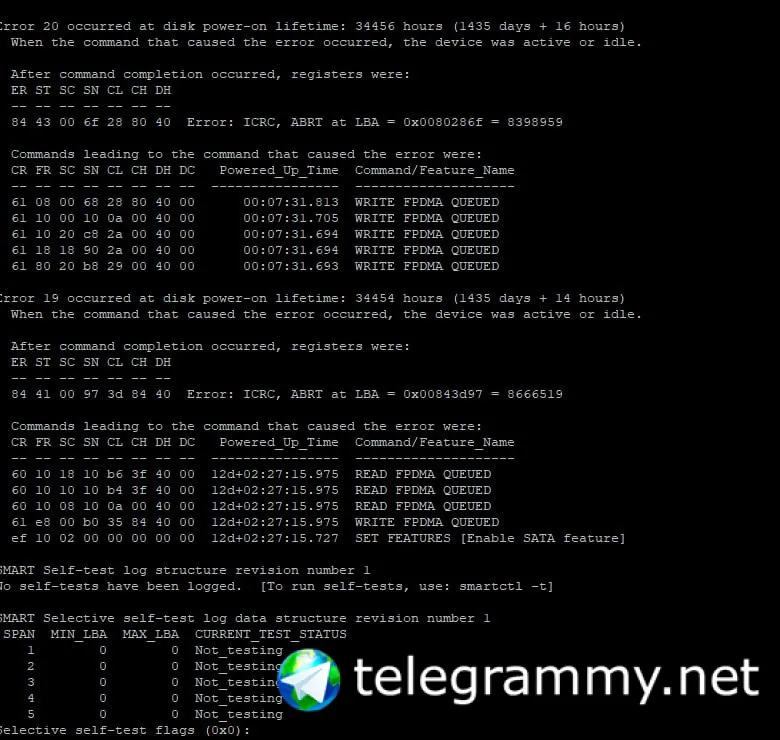

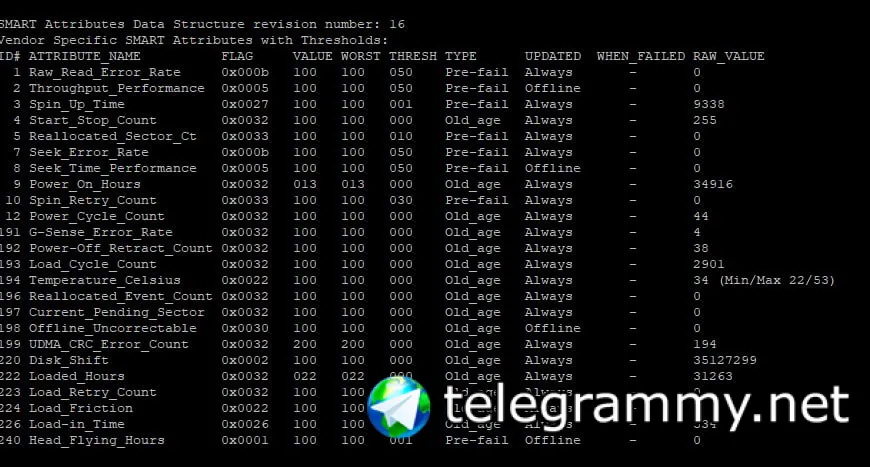

Феерия была у меня 3 недели назад, только разгреб, один диск начал вести себя странно, то терялся то поялвлялся, бедился и все такое, так вот, контроллер LSI 3408 с последней HBA прошивкой стал сыпать хаотично по кучи дисков бедблоки с выводом массива в suspend, в консоль срало немеренно и понять какой итого диск было очень сложно, тупо не успевал читать логи, итого диск вытащен, 4 hotspare диска в ребилде, останавливать не решился, 3 диска qcow2 показали бед блоки, и не dd не badblock не давали результата в качестве меры лечения, пришлось дожидаться недельного ребилда, затем пытаться делать то clear то replace дисков, затем выявленные файлы грохать ибо не лечил scrub их, после разгребания кучи говна массив вылечил, но пару седых волос прибавилось. Подохреваю что любой другой массив в данной ситуации тупо умертвился бы, mdadm и LSI RAID уж точно

Олег

Олег

raid0 пул на 30+ дисков, феерично https://github.com/openzfs/zfs/discussions/15119#discussioncomment-6582943

По этой теме конкретно, сделать из кучи дисков Raid0...... Ну а чего ждали-то?

Олег

Олег

raidz1-2 DEGRADED 0 0 0

spare-0 DEGRADED 0 0 2.55K

replacing-0 DEGRADED 0 0 0

scsi-SATA_TOSHIBA_MG06ACA1_X1Q0A04MFKQE DEGRADED 4 0 720 too many errors

scsi-SATA_HGST_HUH721010AL_JEH5ENAN ONLINE 0 0 0 (resilvering)

scsi-35000039c78c946f9 ONLINE 0 0 0

spare-1 DEGRADED 0 0 2.54K

scsi-35000cca267d353fb DEGRADED 0 0 720 too many errors

scsi-35000039c78c94712 ONLINE 0 0 0

spare-2 DEGRADED 0 0 2.95K

scsi-35000cca267d2f0b8 DEGRADED 0 0 304 too many errors

scsi-SATA_TOSHIBA_MG09ACA1_72F0A0BXFQDH ONLINE 0 0 0

scsi-SATA_HGST_HUH721010AL_JEHB3RLN DEGRADED 0 0 112 too many errors

Олег

Олег

Кстати косяк ZFS не знаю только в моем ли исполнении, менять ID диска в названиях как хочет то аля sda то аля ata- то аля wwn-0x50. Замечено на разных версиях PBS (Proxmox который), но возможно где еще

Станислав

Станислав

Феерия была у меня 3 недели назад, только разгреб, один диск начал вести себя странно, то терялся то поялвлялся, бедился и все такое, так вот, контроллер LSI 3408 с последней HBA прошивкой стал сыпать хаотично по кучи дисков бедблоки с выводом массива в suspend, в консоль срало немеренно и понять какой итого диск было очень сложно, тупо не успевал читать логи, итого диск вытащен, 4 hotspare диска в ребилде, останавливать не решился, 3 диска qcow2 показали бед блоки, и не dd не badblock не давали результата в качестве меры лечения, пришлось дожидаться недельного ребилда, затем пытаться делать то clear то replace дисков, затем выявленные файлы грохать ибо не лечил scrub их, после разгребания кучи говна массив вылечил, но пару седых волос прибавилось. Подохреваю что любой другой массив в данной ситуации тупо умертвился бы, mdadm и LSI RAID уж точно

Что-то я не пойму кто виноват. Несколько дисков посыпались? За ними давно не следили или они по сговору решили?

Олег

Олег

Что-то я не пойму кто виноват. Несколько дисков посыпались? За ними давно не следили или они по сговору решили?

Один единственный диск то появлялся то умирал, как только появились симпотомы контроллер тупо зависать стал

Станислав

Станислав

О жесть. Кстати, кто знает, какие есть меры, чтобы такого поведения избегать?

А то есть у меня Debian on ZFS на зеркале из 3-х!!! дисков. Один чудит ( то ли кабель отходит, то ли диск подвисает), из-за чего вешается вся ОС, помогает только перезапуск севера.

Ivan

Ivan

Олег

Олег

советую начать с проверки БП

мамка и контроллер заменены, диск еще проверю не до него совсем было, бп хз как тут проверять, так-то и бекплане может быть

Станислав

Станислав

советую начать с проверки БП

Крайне сомнительно. Всегда один диск чудит. Питание у них общее, это backplane supermicro

Олег

Олег

Крайне сомнительно. Всегда один диск чудит. Питание у них общее, это backplane supermicro

Кстати да, именно вытаскивание этого диска все нормализовало, ну кроме ребилдов

Vladislav

Vladislav

Крайне сомнительно. Всегда один диск чудит. Питание у них общее, это backplane supermicro

Смарт диска, другой отсек на бэке, логи контроллера

Олег

Олег

контроллер заменил сразу же на зип (не помогло), диск буду смотреть, его в сервак нет желания вставлять.

Станислав

Станислав

Смарт диска, другой отсек на бэке, логи контроллера

Другой отсек то попробую, диски подключены к материнке supermicro, не нашёл в ней никакой инфы.

Вопрос не о том, как выявить виноватого, а о том, как заставить сервер работать дальше в случае сбоя одного диска из зеркала. Тупо чтобы автоматом отключало диск. Есть такое контроллеры или другие удобные решения?

Олег

Олег

Другой отсек то попробую, диски подключены к материнке supermicro, не нашёл в ней никакой инфы.

Вопрос не о том, как выявить виноватого, а о том, как заставить сервер работать дальше в случае сбоя одного диска из зеркала. Тупо чтобы автоматом отключало диск. Есть такое контроллеры или другие удобные решения?

Там даже ПК не грузятся, когда диск отваливается и приваливается, тупо контроллеру плохеет

Vladislav

Vladislav

Ivan

Ivan

в теории если в диске есть поддержка tler, то можно мониторить состояние и как только сработает - сразу отключать питание у диска через hdparm.

Олег

Олег

Олег

Олег

Потому что там ОС решает такие вопросы

не факт, они же програмно-аппарантые, прошивки свои и опыта у них огого

Станислав

Станислав

да

Есть контроллеры для примера? Или как узнать, что конкретный контроллер поддерживает такую функцию?

Олег

Олег

Ivan

Ivan

Есть контроллеры для примера? Или как узнать, что конкретный контроллер поддерживает такую функцию?

адаптеки откидывают. хотя они могут и по другим параметрам откинуть.

Vladislav

Vladislav

Я всегда открыт к предложениям по тестам, я спрашивал, дайте мне тест, где ZFS быстрее mdadm

Я нашёл такой

Блок 4МБ

QD=32

Numjobs=64

Последовательная запись 100%

На 6 NVMe дисках

lz4 компрессия

Vladislav

Vladislav

Я нашёл такой

Блок 4МБ

QD=32

Numjobs=64

Последовательная запись 100%

На 6 NVMe дисках

lz4 компрессия

Тогда он выдаёт производительность выше чем сумма скорости записи всех дисков))))

Autumn

Autumn

Джентльмены, есть пара вопросов по zfs on nvme. Если кто-то гонял/тестил/завел в прод подскажите:

1. какова разница между sata ssd и nvme ssd под zfs, есть ли смысл брать nvme (опыт по зеркалу, рейдз1/2 может есть у кого)?

2. насколько сильный оверхед даёт raidz1/2 на nvme, есть задача сохранить высокую производительность в IOPS+randrw при этом получить объем, т.к. дисков мало в ЦОД-е выдают (можем взять 3-4 нвме по 7 ТБ), и не хочется отдавать 50% под зеркало, слишком дорого.

3. есть ли смысл в special dev + slog на nvme для sata ssd пулов, или просто собрать пул на sata ssd и не париться ибо бонусов ноль?

Увы но у самого опыта с обычными сата и сас ссд имеется, а вот нвме нет в таком кол-ве что бы потесить.

Ivan

Ivan

Autumn

Autumn

сата ssd банально дороже.

Тут дело в том что надо фулл флеш сторадж, но моно сторадж собрать не получится, в ЦОДе готовы выдать сата ссд + нвме ссд, в разных комбинациях. Саташки 3.8ТБ, нвме 7.6 ТБ.

Kot

Kot

Вадим «Дым» Илларионов ☭

Вадим «Дым» Илларионов ☭

Maksim

Maksim