> Я когда последний раз fio тесты гонял, его данные не жмутся

для этого что-то делалось? просто по дефолту его данные как раз очень хорошо жмутся, зависит от recordsize, конечно

root@s:~# zfs get mounted,mountpoint,logicalused,logicalreferenced,compressratio,compression nvpool/test

NAME PROPERTY VALUE SOURCE

nvpool/test mounted yes -

nvpool/test mountpoint /mnt/nvpool/test inherited from nvpool

nvpool/test logicalused 1.00G -

nvpool/test logicalreferenced 1.00G -

nvpool/test compressratio 1.00x -

nvpool/test compression zstd inherited from nvpool

@scar83 Конфиг fio следующий:

[global]

filename=/mnt/nvpool/test/fio.file

size=1G

time_based

runtime=10

direct=0

buffered=1

ioengine=libaio

numjobs=1

[SEQ_16K_Q8]

stonewall

rw=read

bs=16K

iodepth=32

[SEQ_16K_Q1]

stonewall

rw=read

bs=16K

iodepth=1

[RND_16K_Q32]

stonewall

rw=randread

bs=16K

iodepth=32

[RND_16K_Q1]

stonewall

rw=randread

bs=16K

iodepth=1

[SEQ_16K_Q8]

stonewall

rw=write

bs=16K

iodepth=32

[SEQ_16K_Q1]

stonewall

rw=write

bs=16K

iodepth=1

[RND_16K_Q32]

stonewall

rw=randwrite

bs=16K

iodepth=32

[RND_16K_Q1]

stonewall

rw=randwrite

bs=16K

iodepth=1

Станислав

Станислав

@scar83 только размер файла для теста больше нужно выставить, это я сейчас прогнал так, чтобы сжатие увидеть.

George

George

@gmelikov recordsize=16k в датасете.

- recordsize влияет, при таком тесте должно сжаться минимум 25%,

вот пример обратный, lz4, блок дефолтный (128к)

$ fio --filename /tmp/test1.img --rw=write --bs=16k --size=200M --name=test

...

gmelikov@minime:/tmp$ du --apparent-size ./test1.img

204800 ./test1.img

gmelikov@minime:/tmp$ du ./test1.img

47197 ./test1.img

George

George

refill_buffers¶

If this option is given, fio will refill the I/O buffers on everysubmit. Only makes sense if zero_buffers isn’t specified,

naturally. Defaults to being unset i.e., the buffer is only filled atinit time and the data in it is reused when possible but if any of

verify, buffer_compress_percentage ordedupe_percentage are enabled then refill_buffers is also

automatically enabled.

scramble_buffers=bool

If refill_buffers is too costly and the target is using datadeduplication, then setting this option will slightly modify the I/O buffer

contents to defeat normal de-dupe attempts. This is not enough to defeatmore clever block compression attempts, but it will stop naive dedupe of

blocks. Default: true.

вот ключевые параметры

George

George

да, я был слишком ультимативен и там есть попытки рандома, но полагаться на несжимаемость (по дефолту) всё же нельзя

Станислав

Станислав

- recordsize влияет, при таком тесте должно сжаться минимум 25%,

вот пример обратный, lz4, блок дефолтный (128к)

$ fio --filename /tmp/test1.img --rw=write --bs=16k --size=200M --name=test

...

gmelikov@minime:/tmp$ du --apparent-size ./test1.img

204800 ./test1.img

gmelikov@minime:/tmp$ du ./test1.img

47197 ./test1.img

На lz4 я также проверил, не стал выкладывать, там один в один. Проверю на больших объемах сжимаемость.

Art

Art

https://www.youtube.com/watch?v=caUzFaLgoeA&t=187s

Georg🎞️🎥

Georg🎞️🎥

Georg🎞️🎥

Georg🎞️🎥

Станислав

Станислав

Но похоже что в случае с zfs эту штуку заменит тупо много оперативы :))))🤷🏻♂️

Сброс с оперативы в пул всё равно нужен, а при большой нагрузке заметно замедлится запись. К тому же ресурс неограниченный у оперативы в этих модулях

Georg🎞️🎥

Georg🎞️🎥

Сброс с оперативы в пул всё равно нужен, а при большой нагрузке заметно замедлится запись. К тому же ресурс неограниченный у оперативы в этих модулях

А у нас типа ограничен ? ))) таже оператива🤔 запись воооще не волнует - речь о чтение .. я вот фиг знает - 512 … проще сервер расширить наверно до 700 или полтро теров - atto оч дорогин девайсы ((( ну или это способ увеличить скорости доступа, когда уже у себя оперативы максимум ))

Станислав

Станислав

Станислав

Станислав

Т.е. в видеопроизводстве редко что-то пишется? Или же редко, но метко?)) Я полагаю, что объемы записанных данных в день там не малые.

Maksim

Maksim

Т.е. в видеопроизводстве редко что-то пишется? Или же редко, но метко?)) Я полагаю, что объемы записанных данных в день там не малые.

скорее всего процесс такой, что дампят данные с камеры, что не очень принципиально сколько занимает по времени, а потом при монтаже только чтение, пока финал не рендерится, что тоже не очень важно сколько времени происходит

Georg🎞️🎥

Georg🎞️🎥

Т.е. в видеопроизводстве редко что-то пишется? Или же редко, но метко?)) Я полагаю, что объемы записанных данных в день там не малые.

Никакие … маваалкий файл в пару мегов - проект , результат работы .

Много пишите на стадии загрузки исходников в хранилище …👋Типа привезли несколько терабайт - вы их скопировали и работаете.

Georg🎞️🎥

Georg🎞️🎥

скорее всего процесс такой, что дампят данные с камеры, что не очень принципиально сколько занимает по времени, а потом при монтаже только чтение, пока финал не рендерится, что тоже не очень важно сколько времени происходит

Верно 👍 но рендер быстрый тоже нужен , когда пачку финалов отдать надо , но да , терпимо

Станислав

Станислав

Никакие … маваалкий файл в пару мегов - проект , результат работы .

Много пишите на стадии загрузки исходников в хранилище …👋Типа привезли несколько терабайт - вы их скопировали и работаете.

Т.е. по окончании монтажа в хранилище не сохраняется какой-то видео файл?

Maksim

Maksim

Верно 👍 но рендер быстрый тоже нужен , когда пачку финалов отдать надо , но да , терпимо

ну рендер всё-таки обычно в проц и видимокарту упирается, нет?

Georg🎞️🎥

Georg🎞️🎥

Т.е. по окончании монтажа в хранилище не сохраняется какой-то видео файл?

Нет, только файл проекта. По нему вы всегда можете посчитать либо финальное видео жирное , в зависимости от тех требований , либо как правило маленький h264 просмотровый для творческий единиц на утверждение 👋

Georg🎞️🎥

Georg🎞️🎥

ну рендер всё-таки обычно в проц и видимокарту упирается, нет?

В скорость линейного чтения еще .. жирные непожатые исходники требуют быстрых дисков // хранилищ

Станислав

Станислав

Нет, только файл проекта. По нему вы всегда можете посчитать либо финальное видео жирное , в зависимости от тех требований , либо как правило маленький h264 просмотровый для творческий единиц на утверждение 👋

Буду знать. Тогда в видеомонтаже действительно мало толку, если весь необходимый контент помешается в оперативку.

Georg🎞️🎥

Georg🎞️🎥

Буду знать. Тогда в видеомонтаже действительно мало толку, если весь необходимый контент помешается в оперативку.

Ну прикол в том, что не влезет :((( исходники оч тяжелые ((то есть прои монтаже самом используют пересчитанные легкие файлы, а про фин подготовке уже переходят на исходник … к примеру исходник фильма может быть 40-50 тер, какой там в оперативку :((((

Georg🎞️🎥

Georg🎞️🎥

Но раздавать мелкие файлы на кучу станций вполне 🤔может пойти , или у звука … у них файлу маленькие но их оч много😱😱😱

Станислав

Станислав

Ну прикол в том, что не влезет :((( исходники оч тяжелые ((то есть прои монтаже самом используют пересчитанные легкие файлы, а про фин подготовке уже переходят на исходник … к примеру исходник фильма может быть 40-50 тер, какой там в оперативку :((((

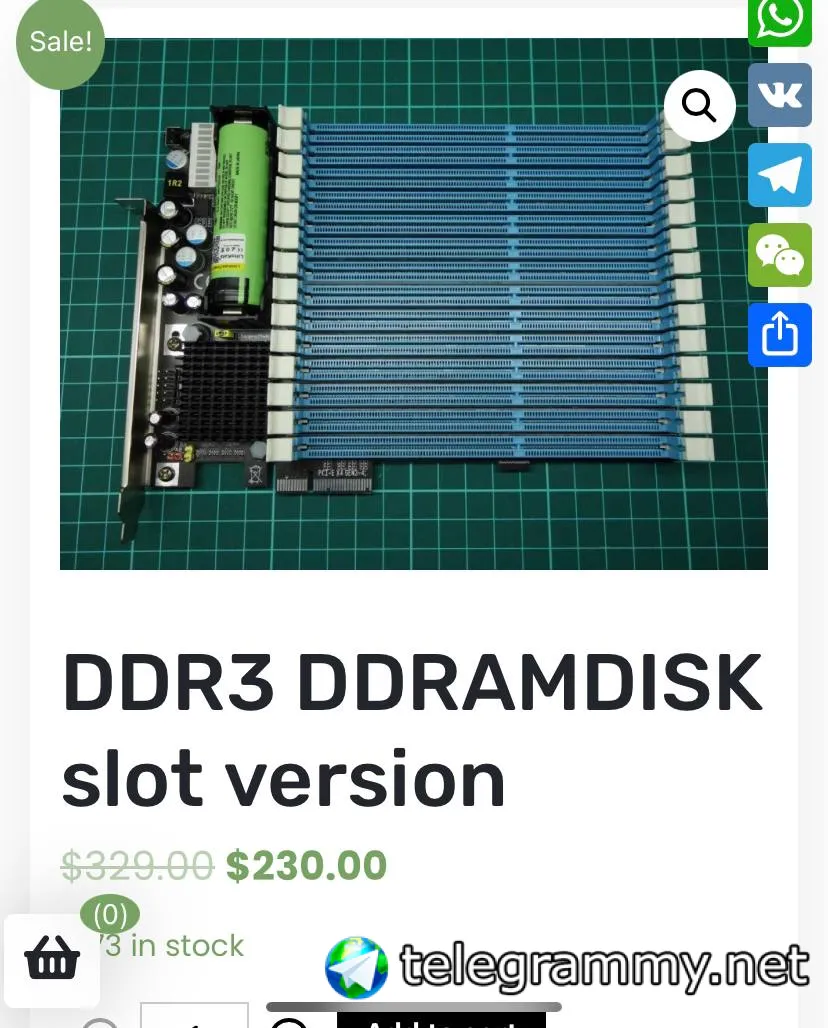

У ddramdisk есть готовые модули на основе ddr3 объемом 2TB. Стоит всего 2000$

Georg🎞️🎥

Georg🎞️🎥

У ddramdisk есть готовые модули на основе ddr3 объемом 2TB. Стоит всего 2000$

О 😱это круто … где посмотреть ?😱

central

central

Нет, только файл проекта. По нему вы всегда можете посчитать либо финальное видео жирное , в зависимости от тех требований , либо как правило маленький h264 просмотровый для творческий единиц на утверждение 👋

А кеш куда девать? 4к видосы требуют терабайт кешированный данных чтобы можно нормально работать с видео

Georg🎞️🎥

Georg🎞️🎥

А кеш куда девать? 4к видосы требуют терабайт кешированный данных чтобы можно нормально работать с видео

Кэш монтажная программа делает там , где скажете 🤷🏻♂️обычно внешний ssd , терабайт это вы загнули ))) короче немного не так все ))

central

central

Кэш монтажная программа делает там , где скажете 🤷🏻♂️обычно внешний ssd , терабайт это вы загнули ))) короче немного не так все ))

Нет желания спорить но не думаю что ссд на пару терабайт в серьезным кино производстве можно обойтись

Станислав

Станислав

О 😱это круто … где посмотреть ?😱

Только они без батарейного питания. Но есть модули для DDR4, которые с LiPo аккумом сменным и даже плашки обычные вставляются. Я посчитал, можно 16ю модулями набрать 1024Гб

Georg🎞️🎥

Georg🎞️🎥

Нет желания спорить но не думаю что ссд на пару терабайт в серьезным кино производстве можно обойтись

Можно 🤷🏻♂️не создаются там кэши на кучу всего поверьте 👋 системный диск толком не можем засрать два года )) а у него жалкий терабайт ))) и еще 700 свободно )))

Georg🎞️🎥

Georg🎞️🎥

Только они без батарейного питания. Но есть модули для DDR4, которые с LiPo аккумом сменным и даже плашки обычные вставляются. Я посчитал, можно 16ю модулями набрать 1024Гб

А куда это подрубать ? К серверу zfs прикрутить бы ))

Станислав

Станислав

Только они без батарейного питания. Но есть модули для DDR4, которые с LiPo аккумом сменным и даже плашки обычные вставляются. Я посчитал, можно 16ю модулями набрать 1024Гб

Кстати, они уже в PCI-E x8. На видео как раз этот модуль

Станислав

Станислав

А куда это подрубать ? К серверу zfs прикрутить бы ))

Так в ОС это как обычный NVMe накопитель.

Georg🎞️🎥

Georg🎞️🎥

Во все свободные слоты воткнуть тоже можно))

Заманчиво 😱… но вот будет ли веселее , чем хороший u2 ssd

Станислав

Станислав

Заманчиво 😱… но вот будет ли веселее , чем хороший u2 ssd

Думаю, что в разы веселее, если узкое горлышко в нём

central

central

Станислав

Станислав

Добрый день , подскажите пожалуйста как посмотреть текущее значение ashift?

Любые свойства можно посмотреть командами:

zpool get all <pool>

zfs get all <pool>/<dataset>

Только ashift:

zpool get ashift <pool>

Роман

Роман

Станислав

Станислав

А дефолтное значение 9?

Кажется zfs выбирает его при создании пула на основании данных о дисках

Роман

Роман

Кажется zfs выбирает его при создании пула на основании данных о дисках

Это понятно, а как узнать что он выбрал?) по размеру сектора диска?)

Станислав

Станислав

Это понятно, а как узнать что он выбрал?) по размеру сектора диска?)

zdb -C <pool> | grep ashift

Станислав

Станислав

Интересно , zfs это схавает как ssd pci ?🤔

Так я же выше писал, что для ОС это обычный NVMe

Georg🎞️🎥

Georg🎞️🎥

В таком объем меньше будет, как я понял. По идее 512Гб

Этот хватит

500-700 в сервер и еще 500 на этой штуке

Georg🎞️🎥

Georg🎞️🎥

Заявляют, что без внешнего питания аккумулятора хватит на год хранения инфы

Меня волнует как кэш))) объем все равно смешной для серьёзной работы , а вот чтение рандомное😱😱😱

Aba

Aba

Заявляют, что без внешнего питания аккумулятора хватит на год хранения инфы

Ну и это конечно же чушь) Даже если будет установлена одна плашка с энергопотреблением в 0.5Вт протянет она не больше суток

Ivan

Ivan

Ну и это конечно же чушь) Даже если будет установлена одна плашка с энергопотреблением в 0.5Вт протянет она не больше суток

когда оно работает, то питание с сервера идет. а когда сервер выключен, то нужно куда меньше мощности на поддержание заряда.

Aba

Aba

когда оно работает, то питание с сервера идет. а когда сервер выключен, то нужно куда меньше мощности на поддержание заряда.

По этому я и взял в 0.5Вт, а не 4Вт

central

central

Заявляют, что без внешнего питания аккумулятора хватит на год хранения инфы

В ддр разве стабильна для длительного хранения данных?

Artem

Artem

Fedor

Fedor